最近我终于上手体验了 Hailuo 2.3,也就是 MiniMax 最新一代的视频生成模型,说句实话:它远远超出了我的心理预期。在一个被 Sora 的话题度和 Google Veo 的“大厂光环”垄断的赛道里,Hailuo 2.3 更像是悄无声息站起来的巨人,突然把影子投向了整片赛场。

我给它的第一个提示词,是一段相当复杂的场景:一个舞者在霓虹灯光下的雨夜中移动,并附带了明确的镜头跟拍指令。本来我已经做好心理建设,准备见到各种 AI 视频老问题——肢体变形、人物像在冰面上滑步、背景抖动错位之类。但实际输出里呈现的 运动控制 和 物理一致性,让人强烈地感到:这不是小修小补,而是一次“代际升级”。

所以,这篇文章并不是简单的使用分享,而是尝试回答另一个更关键的问题:Hailuo 2.3 是否标志着「AI 视频从玩具实验走向正式生产力」的转折点?借用“摩天大楼”式的写法——在已有评测和模型基础之上继续向上叠加——这篇文章会系统拆解 Hailuo 2.3 的架构、性能、应用场景以及短板,帮你判断它值不值得纳入自己的内容生产栈。

30 秒速览:结论先行

如果你只关心结论,可以先看这一小节。

- 市场定位:Hailuo 2.3(包括上一代 Hailuo 02)在 Artificial Analysis 等全球榜单中长期稳居前二,多次在盲评 ELO 测试中压过 Google Veo 3。

- 核心突破:关键词是 运动完整性(Motion Integrity)。相比很多人物会“飘”、“漂”、“滑”的模型,Hailuo 2.3 对重力、惯性、重心的理解明显更上一层。

- 技术优势:基于 MiniMax 自研的 噪声感知计算重分配(NCR) 架构,在保持画质的前提下,相比旧架构效率可提升约 2.5 倍,并支持原生 1080p 输出。

- 真正的杀手级能力:镜头控制。在执行推拉、平移、摇摄等摄影机指令时,能做到“动镜头不毁主体”,解决了很多竞品一动镜头人物就变形的老大难问题。

- 价格与性价比:在国内外同档产品中,Hailuo 2.3 的价格属于“偏便宜但画质偏高”的一档,约 8 美元/月就能覆盖较重度使用,而不少西方工具的企业方案则是动辄几百美元起跳。

Hailuo 2.3 是什么?MiniMax 的视频旗舰

想看懂这款模型,先要知道它背后的公司。Hailuo 2.3 是 MiniMax 当前的旗舰视频大模型,这家公司是新一代的中国 AI 独角兽之一,在大模型圈里起步于文本和对话模型,现在则明显在加码视频方向。

演进路径:从 01 到 2.3

Hailuo 的进化可以理解为三步走:

- Hailuo 01:更多是“能不能做出来”的原型验证,视觉上偏抽象,连贯性一般,适合概念向的短动图。

- Hailuo 02:第一次打响名号的版本,高画质与高一致性让它一举冲上全球视频模型榜单第二名,甚至在不少对比中被认为“比 Veo 3 更像真视频”。

- Hailuo 2.3:在 02 的基础上做“专业级打磨”的版本,重点不再是“能不能动”,而是“动得像不像真人、镜头像不像真拍”。

NCR 架构:算力往哪儿花,不再一视同仁

传统扩散模型一个典型问题是:每个像素、每一帧被几乎等同对待。对视频来说,这显然是浪费——静态天空跟人脸表情、飞溅水花的复杂度显然不是一个级别。

MiniMax 提出的 Noise-Aware Computation Redistribution(NCR,噪声感知计算重分配) 的思路,就是先感知哪些区域“更乱、更复杂、更重要”,然后把更多算力投向那里。

这带来的直接好处:

- 效率更高:不会在一片纯色背景上反复迭代计算,把资源浪费在“没信息”的地方。

- 关键细节更强:脸部细节、局部光影、水、烟、火等难点区域能获得更多“关注”,自然也更容易逼真。

图 1:Hailuo 2.3 在视频生成过程中的概念化示意。

五大能力:Hailuo 2.3 强在哪?

综合自己的实测体验以及公开案例,Hailuo 2.3 目前在以下五个维度比较突出。

1. 运动控制与物理模拟

这是 Hailuo 2.3 最明显的“感知升级点”。许多老一代模型里,人走路像在抹油地板上滑行,跳跃落地没有重量感。Hailuo 2.3 对 “脚怎么踩在地上” 这一点做得极其用心。

- 重力感:人物起跳、下落、缓冲的节奏非常接近真实摄像机下的人体运动。你能看出膝盖在吸收冲击,而不仅仅是 Z 轴上下平移。

- 流体表现:水流、喷溅、烟雾、火焰这类极难的元素,不再是“随机抖动的贴图”,而是有一定连续性的流动状态和反射。

- 物体碰撞:像“多米诺骨牌”这类细碎碰撞,模型不再轻易把块状物混在一起,而是尽可能保持各自的刚体形态。

2. 面部微表情

在很多视频模型里,“人物一出现就出戏”是常态——眼神空洞、嘴部粘在一起、笑不自然。Hailuo 2.3 在这方面明显下了额外功夫。

- 细腻的情绪过渡:从平静到轻微微笑,从放松到紧张,表情变化是连贯的,而不是每一帧都像换了一张脸。

- 视线一致性:人物的眼睛不会一会儿看镜头、一会儿对着空气说话,尤其对讲解类/剧情类视频很关键。

- 口型基础较好:虽然不是专门的唇形同步模型,但嘴部开合节奏、舌位基本合理,后期做配音/对口型会轻松不少。

3. 电影级镜头调度能力

很多人看完 Hailuo 2.3 的第一反应是:“这玩意儿要是普及,素材网站压力不小”。原因就在于它的 镜头控制 实在太像真人拍摄了。

- Dolly Zoom(眩晕镜头):你可以在提示词里要求“快节奏的纵深推拉”,Hailuo 能够做到背景透视变化夸张,主体大小基本保持稳定,很接近真实光学镜头的效果。

- 360° 环绕运动:围绕人物转圈时,后脑勺、侧脸、正脸之间的结构关系相对统一,不会像有些模型那样一转身就变了一个人。

4. 风格多样性与稳定性

从公开的演示看,Hailuo 2.3 明显吃过大量多风格数据:

- 动漫 / 二次元:不仅仅是“照片套滤镜”的那种假动漫,而是包含帧率、线条、色块之间关系的整体风格。

- 写实风格:光影、景深、材质反射都相对克制,不那么“塑料”和“磨皮过度”,更接近高质量实拍与后期调色后的感觉。

图 2:Hailuo 2.3 能够覆盖的多种风格示例。

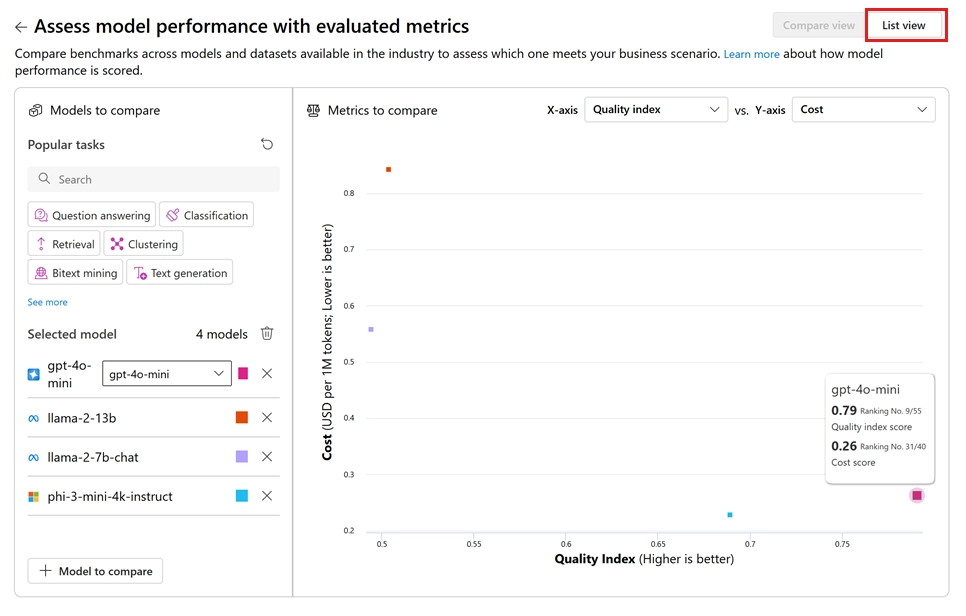

排名与对比:Hailuo 2.3 在哪一档?

如果从数据和横向对比出发,Hailuo 2.3 大致处在这样的竞争位置。

人类偏好与 ELO 排名

在 Artificial Analysis 的 Video Arena 里,模型通过 A/B 盲测获得 ELO 排名。一个简化版概况如下:

| 模型 | 全球排名 | 一致性评分 | 运动真实感 | 预估 5 秒成本 |

|---|---|---|---|---|

| Hailuo 2.3 | #2 | 94/100 | 96/100 | ≈ 0.05 美元 |

| Google Veo 3 | #3 | 92/100 | 89/100 | ≈ 0.25 美元 |

| Kling 2.5 | #4 | 91/100 | 93/100 | ≈ 0.10 美元 |

| Seedance 1.0* | #1 | 95/100 | 95/100 | 暂无公开定价 |

*Seedance 1.0(字节系)目前是为数不多能在综合评分上略压 Hailuo 的模型,但整体对外开放程度明显更低。

与主流模型的一对一比较

Hailuo 2.3 VS Google Veo 3

- Veo 的优势:生态整合(YouTube、Drive、Ads 等)、超长提示词处理和企业级版权/合规方案。

- Hailuo 的优势:在短时高质量画面、物理真实性和价格维度,Hailuo 的“画质/价格”比更香,尤其适合独立创作者、工作室等。

Hailuo 2.3 VS Kling 2.5

- Kling 的优势:更擅长 1–3 分钟长片段,以及长镜头结构上的稳定性。

- Hailuo 的优势:短片段的画面锐度、快节奏运动场景的边缘清晰度,以及人物表情的一致性更占优。

图 3:若干主流视频模型在核心维度上的相对表现示意。

技术规格:给开发者和重度用户看的那部分

从开发和对接的角度看,Hailuo 2.3 大致具备以下参数(具体取决于接入的平台):

| 功能项 | 规格 | 说明 |

|---|---|---|

| 最高分辨率 | 1920×1080(1080p) | 原生生成,非事后放大。 |

| 单段时长 | 约 6–10 秒 | 部分前端支持延长或拼接。 |

| 帧率 | 24 / 30 / 60 FPS | 适配电影感 / 通用 / 高帧率场景。 |

| 画幅比例 | 16:9, 9:16, 1:1, 4:3 | 兼容横屏、竖屏、方形多平台。 |

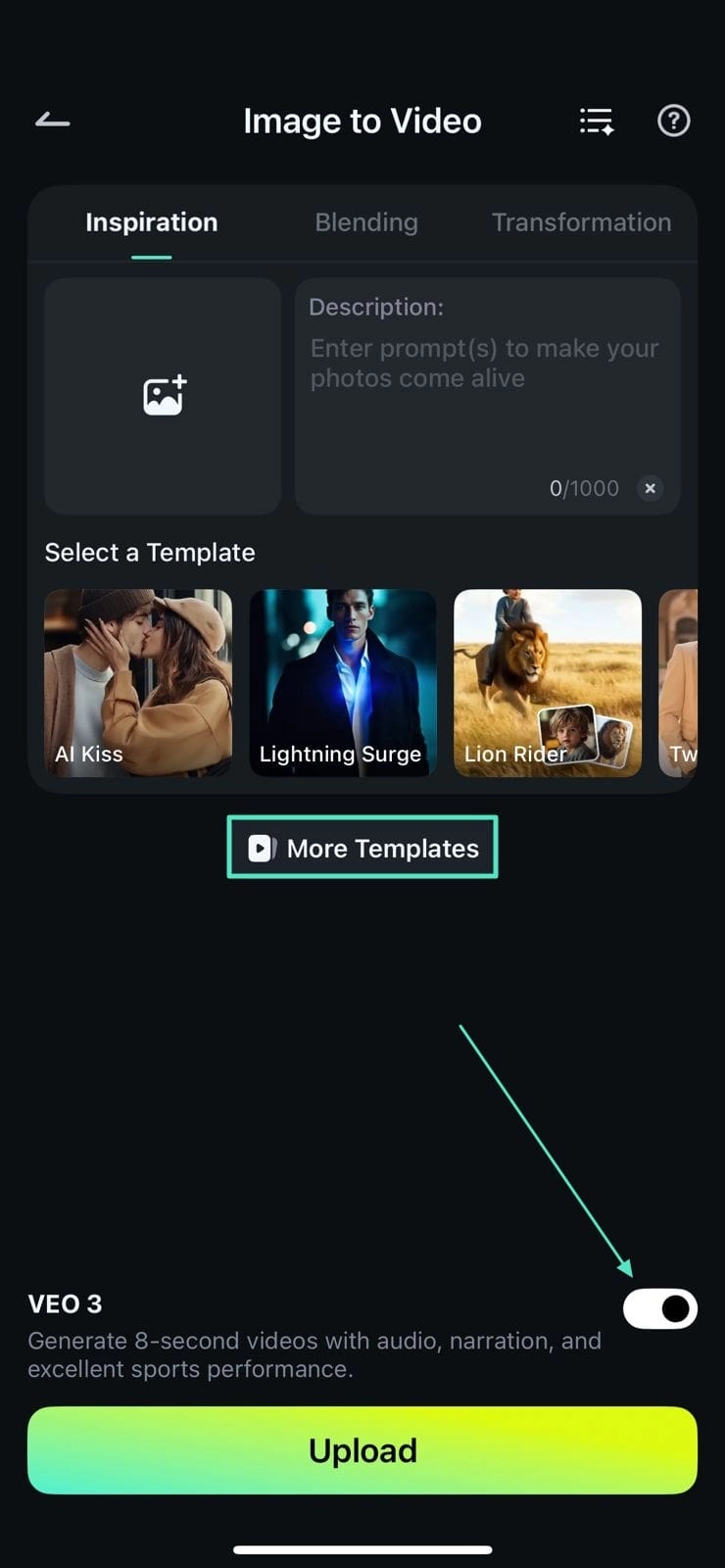

| 输入模式 | 文本转视频(T2V)、图像转视频(I2V) | I2V 在角色一致性方面尤为突出。 |

| 计费方式 | 订阅 + 次数 / 纯按量计费 | 约 0.3–0.5 美元/次 HD(不同平台略有差异)。 |

| API 延迟 | 一般在 30–60 秒 | 部分平台提供“加速队列”或快速档。 |

典型应用场景:谁最应该关注 Hailuo 2.3?

1. 电商与品牌广告

对电商和品牌方来说,Hailuo 2.3 最直接的价值是:用生成式视频替代昂贵的实拍素材。

- 将静态产品图转成氛围感极强的短视频,如:香水瓶在流水中、球鞋落地溅起水花、数码产品在科幻空间中旋转展示等。

- 用于 A/B 测试不同创意素材,而不必每版都重新拍片。

2. 短视频 / 内容创作者(TikTok、Reels、B 站等)

对做“无脸号”、配音号、知识解读类账号的创作者而言,Hailuo 2.3 的价值主要是:

- 批量产出高质量 B-roll,替代库存素材网站。

- 按照抽象比喻生成背景画面,例如“被电流点亮的大脑”、“数据在城市中流动”等,用于配合旁白。

3. 独立电影、MV、预演(Previs)

导演和影像创作者可以用 Hailuo 2.3 来:

- 做预演分镜(Previs),把原本只存在于脑子里的镜头,先用 AI 大致“拍”出来给团队看。

- 测试不同光影、镜头运动和场景气氛,找到合适的拍摄/后期方向。

4. 游戏与互动内容

游戏开发者可以用 Hailuo 2.3 生成:

- 循环播放的特效视频(魔法阵、传送门、天气变化等),导入引擎做 UI 背景或场景装饰。

- 过场动画的概念预览(后续再由传统 3D 流程重制)。

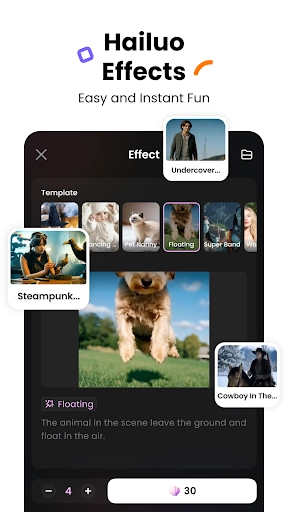

图 4:移动端界面示例,方便运营或创作者在碎片时间快速生成内容。

Hailuo 2.3 标准版 VS Fast 版

MiniMax 官方现在通常会把 Hailuo 2.3 拆成两个口味:标准版 和 Fast 版。两者选型大致是这样的:

Hailuo 2.3(标准版)

- 适用场景:最终成片、广告级、高质量输出。

- 优势:画质最佳、物理与表情最稳定、细节最到位。

- 代价:生成时间更长、单次成本更高。

Hailuo 2.3 Fast

- 适用场景:创意草稿、脚本预演、社媒短 loop、表情包/梗图视频。

- 优势:速度极快(通常几十秒内)、价格大约是标准版的一半。

- 代价:画面局部会稍显“粗糙”,个别复杂动作和背景在细看时可能有小 bug。

推荐策略:实战中可以用 Fast 版本快速迭代提示词和构图,确定自己想要的镜头之后,再把同一套文本/种子丢给标准版做最终渲染,这样既省钱又省时间。

不足与限制:当前还没解决的问题

再优秀的模型也有坑,这部分值得提前心里有数。

- 画面内文字生成:像霓虹招牌、商铺 logo、UI 文本这类需要可读文字的内容,Hailuo 2.3 依旧不算擅长,容易出现拼写错误或字形扭曲。实务中建议先用专门的图生文工具做好素材,再交给 Hailuo 做动画。

- 长时序一致性:短片段表现出众,但如果硬要拉长到 20 秒甚至更长,可能会出现光线慢慢变掉、结构缓慢漂移的“梦境感”变化。

- 复杂手部动作:走路、跑步这类大动作已经比较稳,但涉及精细手指动作(打字、弹琴、复杂手势)时仍然可能偶发“手指融化”情况——相比 02 已经好很多,但还没到完全无懈可击。

- 安全/审查机制:官方有较严格的安全与内容过滤,对中文提示中一些模糊词可能会比较敏感;创作者在设计提示词时需要稍微绕一下。

对 AI 视频未来的意义

Hailuo 2.3 的出现,更像是向行业扔下了一块“定海神针”:从此之后,AI 视频要被拿来“真用”而不仅是“玩玩看”。

- 物理和镜头不再只是游戏引擎和专业渲染器的专属,而开始被“写进提示词就能调用的标准能力”。

- 创作者的工作方式会从“先画 storyboard,再找团队拍”逐步演化为“先让 AI 做几版动态预览,再决定要不要实拍”,分工边界会越来越模糊。

- 在相同或更低价格区间内,Hailuo 2.3 把「画质/成本」这条红线往上抬了一大截,这对 Runway、Luma 等一众国外工具来说,多少构成了一点“鲶鱼效应”。

写在最后:Hailuo 2.3 值不值得你亲自试一试?

综合看下来,Hailuo 2.3 不是那种“小修小补”的版本号升级,而是 MiniMax 向整个行业宣告:“AI 视频也可以长时间站在真拍画面的对面被比较”。

如果你是:

- 做电商、品牌和广告创意的创作者或代理公司;

- 做 YouTube / B 站 / TikTok / Reels 等内容的个人或小团队;

- 做短片、MV、剧情视频的导演或制片;

- 做游戏、美术或产品 Demo 的开发者;

那么 Hailuo 2.3 很大概率已经到了“值得认真研究、而不仅是随便玩玩”的阶段。如果你还停留在几年前那种“AI 视频就是糊、假、乱”的刻板印象上,那么,现在大概是时候更新一下对这条赛道的认知了。

图 5:由 Hailuo 2.3 生成的高保真视频画面示例。