Die Landschaft der KI-Videogenerierung hat Anfang 2026 einen entscheidenden Wendepunkt erreicht. Nach Jahren schrittweiser Verbesserungen verfügen wir nun über Produktionsmodelle, die in der Lage sind, synchronisierten Ton parallel zum Video zu erzeugen, die Konsistenz der Charaktere über verschiedene Einstellungen hinweg zu wahren und komplexe kreative Anweisungen mit verblüffender Präzision zu befolgen. Unter den führenden Konkurrenten stechen zwei Modelle durch ihre fortschrittlichen Fähigkeiten und ihre Einsatzbereitschaft hervor: Seedance 2 von ByteDance und Wan 2.6 aus dem Alibaba-Ökosystem.

Dieser umfassende Vergleich untersucht die technischen Spezifikation, den Funktionsumfang, die reale Leistung und die praktischen Anwendungen beider Modelle. Wir haben Benchmark-Daten, Community-Feedback und Praxistests analysiert, um Ersteller, Vermarkter und Produktionsteams darüber zu informieren, welches Modell am besten für ihre spezifischen Anforderungen geeignet ist.

Executive Summary: Die wichtigsten Unterschiede auf einen Blick

Bevor wir in die detaillierte Analyse eintauchen, hier das Wichtigste, was diese beiden branchenführenden Modelle unterscheidet:

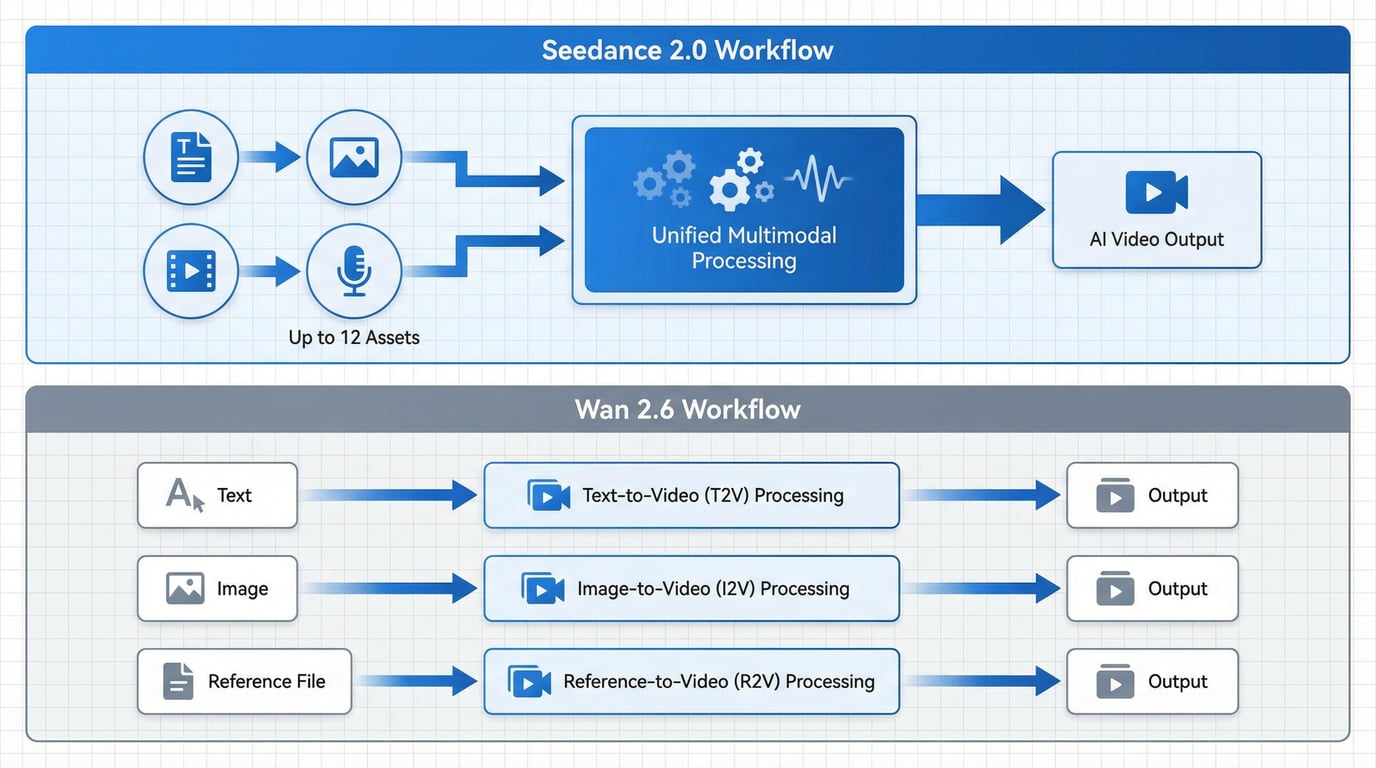

Seedance 2 brilliert bei der multimodalen Referenzsteuerung, dem filmischen Storytelling und der natürlichen audiovisuellen Synchronisation. Das Modell kann bis zu 12 verschiedene Eingabe-Assets gleichzeitig verarbeiten (einschließlich Bilder, Videos, Audiodateien und Text-Prompts) und diese zu einer kohärenten narrativen Sequenz zusammenführen. Dies macht Seedance 2 besonders leistungsstark für komplexe kreative Projekte, die eine präzise Kontrolle über mehrere visuelle und auditive Elemente erfordern.

Wan 2.6 priorisiert strukturierte Produktions-Workflows, Reproduzierbarkeit und praktische Formatunterstützung mit drei dedizierten Generierungspfaden: Text-to-Video (T2V), Image-to-Video (I2V) und Reference-to-Video (R2V). Jeder Pfad ist für spezifische Anwendungsfälle optimiert und bietet klare Produktionsvorgaben sowie vorhersehbare Ergebnisse. Wan 2.6 profitiert zudem von der Open-Source-Verfügbarkeit und umfangreichen API-Integrationsmöglichkeiten.

Technische Spezifikationen: Die Grundlage der Leistung

Das Verständnis der technischen Fähigkeiten jedes Modells bietet den wesentlichen Kontext für die Bewertung ihrer praktischen Anwendung.

Auflösung und Ausgabequalität

Beide Modelle bieten eine professionelle Ausgabe, die für den kommerziellen Einsatz geeignet ist:

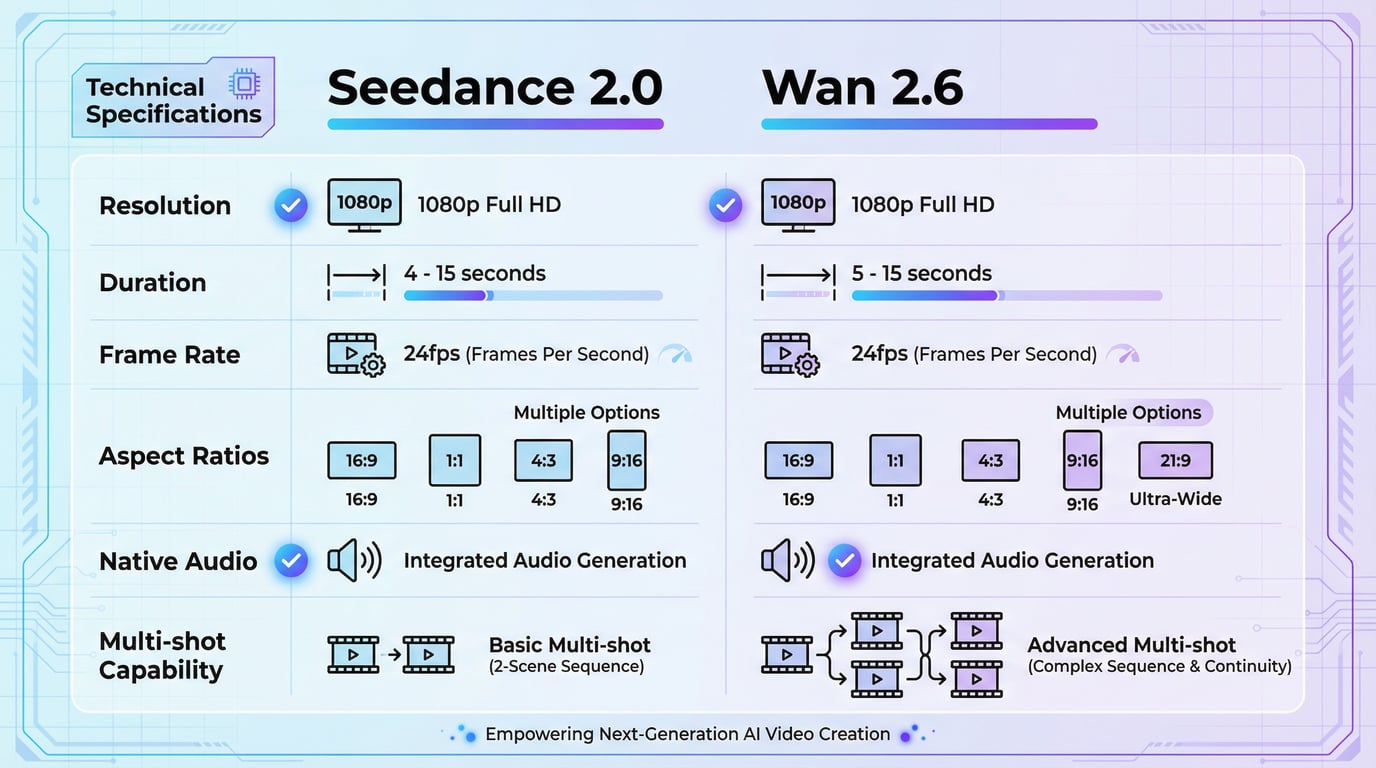

| Spezifikation | Seedance 2 | Wan 2.6 |

|---|---|---|

| Maximale Auflösung | Bis zu 1080p | Bis zu 1080p |

| Bildrate | 24 fps | 24 fps |

| Dauer | 4-15 Sekunden | 5-15 Sekunden |

| Seitenverhältnisse | 16:9, 9:16, 4:3, 3:4, 21:9, 1:1 | 16:9, 9:16, 1:1 (je nach Modus) |

| Nativer Ton | Ja, synchronisiert | Ja, synchronisiert |

| Multi-Shot-Fähigkeit | Ja, mit natürlichen Übergängen | Ja, mit Szenenteilung |

Beide Modelle liefern Dateien mit einer Auflösung von 1080p bei 24 Bildern pro Sekunde, was dem aktuellen Industriestandard für KI-generierte Videoinhalte entspricht. Während einige Wettbewerber wie Kling 3.0 beginnen, in den Bereich von nativem 4K vorzustoßen, bleibt die 1080p-Ausgabe von Seedance 2 und Wan 2.6 für die überwiegende Mehrheit der kommerziellen Anwendungen, einschließlich Social Media, Werbung und Webinhalte, voll einsatzfähig.

Architektur und Modelldesign

Die architektonischen Unterschiede zwischen diesen beiden Modellen beeinflussen maßgeblich ihr Verhalten und ihre optimalen Anwendungsfälle.

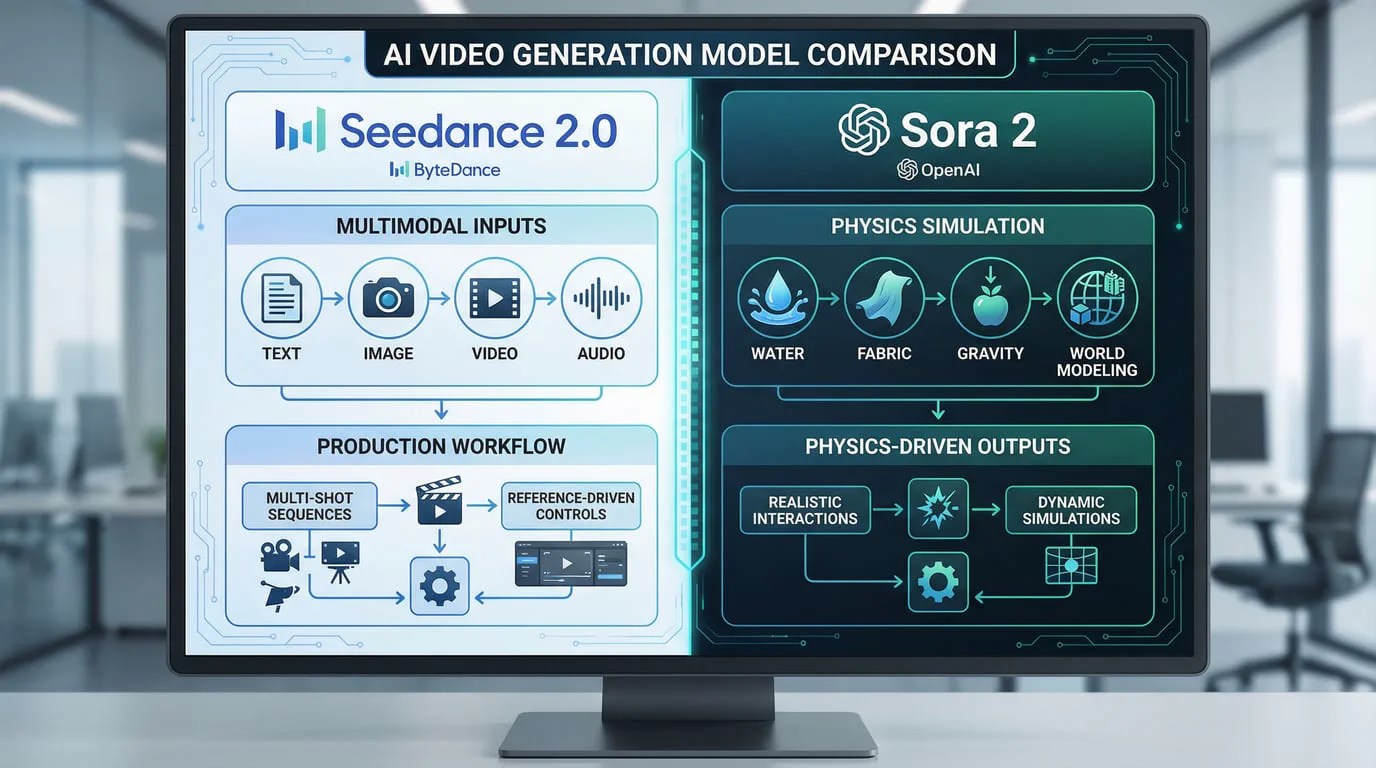

Seedance 2 verwendet eine einheitliche multimodale Audio-Video-Joint-Generation-Architektur. Dieses Design ermöglicht es dem Modell, Text, Bilder, Videoreferenzen und Audioeingaben gleichzeitig innerhalb einer einzigen Generierungspipeline zu verarbeiten. Die Dual-Branch-Architektur verbessert insbesondere die Präzision der Lippensynchronisation und die Darstellung von Mikro-Expressionen, was sie außergewöhnlich effektiv für dialogbasierte Inhalte und emotionale Darstellungen macht.

Wan 2.6 nutzt eine modulare Architektur mit drei unterschiedlichen Generierungspfaden. Die T2V-, I2V- und R2V-Pfade sind unabhängig voneinander für ihre jeweiligen Eingabetypen optimiert. Diese Trennung bietet klarere Produktionsvorgaben und ein vorhersehbareres Verhalten, wovon Teams profitieren, die konsistente und reproduzierbare Ergebnisse bei der Produktion von Inhalten in großem Maßstab benötigen. Insbesondere der R2V-Pfad stellt einen großen Fortschritt dar, wenn es darum geht, die Konsistenz der Charaktere über mehrere Einstellungen hinweg zu wahren.

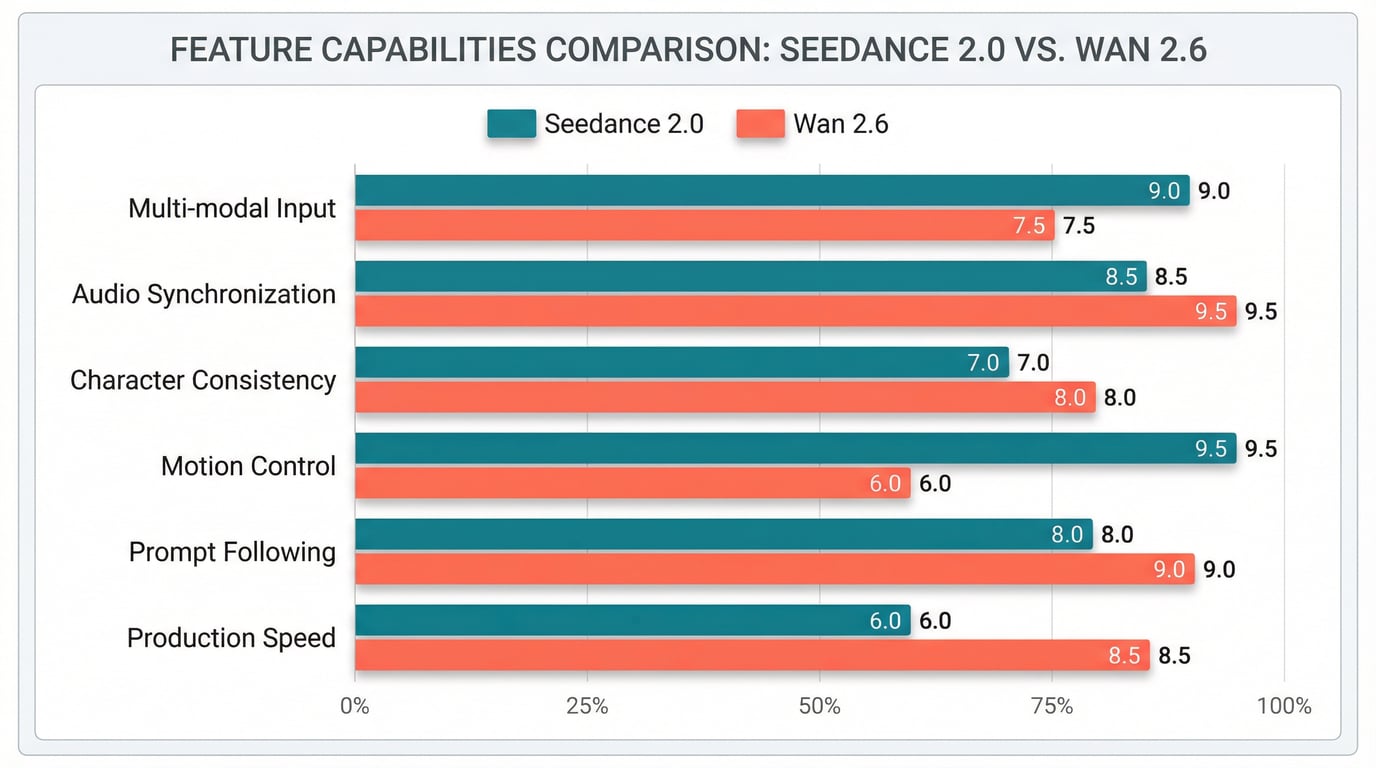

Funktionsvergleich: Die entscheidenden Fähigkeiten

Verarbeitung multimodaler Eingaben

Dies ist einer der wichtigsten Differenzierungspunkte zwischen den beiden Modellen.

Seedance 2 unterstützt umfassende multimodale Eingaben und kann bis zu 12 verschiedene Assets in einer einzigen Generierungsanfrage verarbeiten. Benutzer können gleichzeitig Referenzbilder für den visuellen Stil, Videoclips für Bewegung und Bildkomposition, Audiospuren für Rhythmus und Tempo sowie detaillierte Text-Prompts für die narrative Führung bereitstellen. Das Modell verwendet ein auf natürlicher Sprache basierendes @-Erwähnungssystem, um festzulegen, wie jedes hochgeladene Asset in der finalen Ausgabe verwendet werden soll.

Diese multimodale Fähigkeit ermöglicht eine beispiellose kreative Kontrolle. Zum Beispiel kann ein Ersteller die Kameraführung eines bestimmten Films über einen Videoclip referenzieren, die Farbabstimmung einer Fotografie anwenden, das Timing mit einer Musikspur synchronisieren und die Erzählung per Text steuern – alles in einer einzigen Generierung.

Wan 2.6 verfolgt einen strukturierteren Ansatz mit drei dedizierten Endpunkten. Der Text-to-Video-Pfad übernimmt die rein Prompt-basierte Generierung mit einer verbesserten LLM-basierten Prompt-Erweiterung, die den narrativen Kontext über Schnitte hinweg bewahrt; der Image-to-Video-Pfad konzentriert sich auf die Konsistenz der Action bei der Animation von Standbildern; und der Reference-to-Video-Pfad widmet sich speziell der Herausforderung der Charakterkonsistenz, indem er es Erstellern ermöglicht, die Identität des Motivs über mehrere generierte Clips hinweg zu stabilisieren.

Obwohl der Ansatz von Wan 2.6 weniger Flexibilität bei der gleichzeitigen Eingabe bietet als Seedance 2, bieten seine dedizierten Pfade eine klarere Führung und vorhersehbarere Ergebnisse für spezifische Produktionsszenarien.

Audiovisuelle Synchronisation

Beide Modelle erzeugen nativen Ton parallel zum Video, wodurch die Notwendigkeit einer Audio-Nachbearbeitung entfällt – eine wesentliche Verbesserung des Workflows im Vergleich zu früheren KI-Videomodellen.

Seedance 2 beweist außergewöhnliche Stärke bei der Genauigkeit der Lippensynchronisation und der emotionalen Audio-Performance. Die Dual-Branch-Architektur verarbeitet Audio und Video parallel, was eine framegenau synchronisierte Darstellung von Dialogen, Gesichtsausdrücken und Mundbewegungen ermöglicht. Community-Feedback hebt oft "Seedance-Momente" hervor, in denen die audiovisuelle Synchronisation eine fast fotorealistische Qualität erreicht, insbesondere in Nahaufnahmen von Dialogen und emotionalen Szenen.

Das Modell erzeugt Dialoge, Umgebungsgeräusche und Echtzeit-Soundeffekte, die framegenau auf den visuellen Inhalt abgestimmt sind. Dieser integrierte Ansatz führt zu einer natürlichen, sprachgesteuerten Animation, die sich filmisch und nicht synthetisch anfühlt, was sie extrem wertvoll für narrative Inhalte, charaktergesteuerte Geschichten und alle Anwendungen macht, die glaubwürdige menschliche Interaktionen erfordern.

Wan 2.6 bietet ebenfalls native audiovisuelle Synchronisation mit präzisen Lippensynchronisationsfunktionen. Das Modell integriert Lippensynchronisation und Dialog-Timing direkt bei der Generierung und erstellt so natürliche sprachgesteuerte Animationen, die für professionelle Anwendungen geeignet sind. Während Wan 2.6 in diesem Bereich gut abschneidet, deuten Vergleichstests darauf hin, dass es besser für Werbung und strukturierte Inhaltsvorgaben geeignet ist als für extreme Dialog-Nahaufnahmen, in denen Seedance 2 glänzt.

Bewegungssteuerung und physikalische Genauigkeit

Realistische Bewegungen und physikalische Simulationen sind die Merkmale, die professionelle KI-Videos von offensichtlich synthetischen Inhalten unterscheiden.

Seedance 2 zeigt eine starke physikalische Genauigkeit: Objekte fallen, kollidieren und interagieren nach den Regeln der realen Welt. Es bewältigt komplexe Kamerabewegungen wie Dolly-Zooms, Schärfeverlagerungen (Rack Focus), Tracking-Shots, POV-Wechsel und flüssige Handkamerabewegungen. Actionsequenzen – einschließlich Kämpfen, Verfolgungsjagden, Explosionen und herabfallenden Trümmern – werden mit überzeugendem physikalischem Verhalten und Bewegungskonsistenz gerendert.

Community-Vergleiche stellen fest, dass Seedance realistische Szenarien besonders gut handhabt; eine Analyse bezeichnet es als "kompetenten Dokumentarfilmer", wobei Realismus die traditionelle Stärke des Modells ist. Das Modell überzeugt bei natürlichen Körperbewegungen und Ausdrücken, obwohl Benutzer in komplexen Szenen vereinzelt von Duplikationsfehlern bei Charakteren berichten.

Wan 2.6 bietet eine verbesserte Bewegungskonsistenz im Vergleich zum Vorgänger Wan 2.5, mit einer besonderen Stärke bei der Aufrechterhaltung der narrativen Kontinuität innerhalb von Multi-Shot-Sequenzen. Die Prompt-Verarbeitung wurde speziell verbessert, um den Kontext über Szenenwechsel hinweg beizubehalten, was den Bedarf an manuellem Prompt-Engineering bei der Erstellung von Szenenabfolgen verringert.

Charakter- und visuelle Konsistenz

Die Beibehaltung eines konsistenten Erscheinungsbilds der Charaktere über mehrere Einstellungen und Szenen hinweg ist eine kritische Herausforderung bei der KI-Videogenerierung.

Seedance 2 hat eine signifikante Verbesserung der globalen Konsistenz für Gesichter, Kleidung, Text, Szenen und visuelle Stile erfahren. Das Modell bewahrt ein stabiles Erscheinungsbild der Charaktere zwischen Frames und Einstellungen und löst damit gängige Probleme wie Charakter-Drift, Stil-Inkonsistenzen und Detailverluste, die in KI-Videos häufig vorkommen. Das multimodale Referenzsystem erlaubt es Erstellern, das Aussehen eines bestimmten Charakters mithilfe von Referenzbildern "einzufrieren", während andere Aspekte der Szene verändert werden.

Wan 2.6 adressiert die Herausforderung der Konsistenz gezielt durch seinen Reference-to-Video-Pfad (R2V). Dieser dedizierte Modus konzentriert sich auf die Motivkonsistenz und ermöglicht es Erstellern, die Identität eines Charakters über mehrere generierte Clips hinweg stabil zu halten. Der R2V-Pfad stellt eine der wichtigsten Verbesserungen von Wan 2.6 gegenüber Wan 2.5 dar und geht direkt das größte Problem an, das bisher die breite Akzeptanz von KI-Videowerkzeugen in professionellen Produktionsumgebungen verhindert hat.

Prompt-Treue und Instruktionstreue

Die Fähigkeit, komplexe kreative Anweisungen präzise zu interpretieren und auszuführen, bestimmt die Anzahl der manuellen Iterationen, die erforderlich sind, um das gewünschte Ergebnis zu erzielen.

Seedance 2 legt Wert auf detaillierte Instruktionstreue, insbesondere bei Szenen, die mehrere Motive, Aktionen und Kamerasignale gleichzeitig erfordern. Das Modell versteht und führt komplexe Prompts präzise aus, und das Steuerungssystem in natürlicher Sprache erlaubt es Erstellern, intuitiv zu beschreiben, wie die Referenzen verwendet werden sollen. Je detaillierter der Prompt ist – einschließlich spezifischer Kamerawinkel, Timings und Referenzanweisungen –, desto präziser ist die Ausgabe.

Wan 2.6 bietet eine stärkere Instruktionstreue als Wan 2.5 mit einer verbesserten Prompt-Verarbeitung, die den narrativen Kontext zwischen den Schnitten besser bewahrt. Das LLM-basierte Prompt-Erweiterungssystem wurde verfeinert, um Reibungsverluste bei der Erstellung von Szenenabfolgen zu verringern. Diese Verbesserung macht Wan 2.6 zugänglicher für Benutzer, die keine umfangreiche Erfahrung im Schreiben optimaler KI-Prompts haben.

Performance-Benchmarks: Testergebnisse unter realen Bedingungen

Community-Tests und Benchmark-Vergleiche bieten wertvolle Einblicke darin, wie diese Modelle in verschiedenen Szenarien abschneiden.

Artificial Analysis Ranking

Auf Artificial Analysis, einer Plattform, die Videogeneratoren nach öffentlicher Abstimmung statt nach internen Metriken einstuft, belegte Seedance 1.0 den ersten Platz sowohl bei der Text-to-Video- als auch bei der Image-to-Video-Generierung und übertraf damit Veo 3, Kling 2.0, Sora von OpenAI, Runway Gen4 und Wan 2.1. Obwohl diese Platzierungen vor der Veröffentlichung von Wan 2.6 erfolgten, untermauern sie die starke Position von Seedance in der breiteren KI-Videolandschaft.

Performance nach Szenario

Vergleichstests in spezifischen Szenarien offenbaren deutliche Stärken:

Crowd-Szenen und großflächige Bewegungen: Seedance zeigt eine starke Leistung bei der Darstellung von realistischen Menschenmengen und großflächigen Bewegungen, obwohl es gelegentlich zu einem leichten Kamera-Drift kommen kann (der durch Prompt-Anpassung korrigiert werden kann). Wan 2.6 ist für kleinere Crowd-Szenen akzeptabel, zeigt aber Artefakte in dichten Szenen.

Action und Effekte: Bei dynamischen Actionsequenzen wie Explosionen oder Feuer und visuellen Effekten zeigt Seedance eine starke Rauchsimulation und gutes Timing, wobei die Beleuchtung gelegentlich zu hell sein kann. Wan 2.6 beweist Fähigkeiten in strukturierten Actionsequenzen, kann aber in extremen Szenen Instabilitäten zeigen.

Charakteranimation: Seedance brilliert bei natürlichen Körperbewegungen und Ausdrücken mit hervorragender Lippensynchronisationsqualität, insbesondere bei dialoglastigen Inhalten. Wan 2.6 bietet solide Charakteranimationen, die für Werbung und strukturierte Inhalte geeignet sind, wobei der R2V-Pfad gezielt den Bedarf an Charakterkonsistenz erfüllt.

Generierungsgeschwindigkeit

Seedance 2 soll Berichten zufolge 30 % schneller sein als sein Vorgänger Seedance 1.5, wobei die Generierung je nach Komplexität und Dauer in der Regel innerhalb weniger Minuten abgeschlossen ist. Community-Feedback sieht Seedance 1.5 bereits als Geschwindigkeitsführer unter den großen Modellen, was darauf hindeutet, dass Seedance 2 sehr wettbewerbsfähige Generierungszeiten beibehält.

Wan 2.6 erreicht schnelle Generierungsgeschwindigkeiten, insbesondere beim Zugriff über optimierte Plattformen. Die Generierung dauert in der Regel zwischen 1 und 3 Minuten, abhängig von der Videolänge und Komplexität. Der strukturierte Ansatz mit dedizierten Pfaden trägt wahrscheinlich zu vorhersehbaren Verarbeitungszeiten über verschiedene Generierungsmodi hinweg bei.

Praktische Anwendungen: Welches Modell für welchen Anwendungsfall

Die Wahl des besten Modells hängt von den spezifischen Produktionsanforderungen, der Art des Inhalts und den Workflow-Einschränkungen ab.

Seedance 2 ist ideal für:

Narrative und filmische Inhalte: Das multimodale Referenzsystem und die überlegene audiovisuelle Synchronisation machen Seedance 2 ideal für Storytelling-Anwendungen, die emotionale Tiefe, charaktergesteuerte Erzählungen und filmische Qualität erfordern. Filmemacher, die Storyboards, Proof-of-Concept-Sequenzen oder atmosphärische Szenen erstellen, können von der Fähigkeit des Modells profitieren, mehrere kreative Referenzen zu einer kohärenten visuellen Erzählung zu synthetisieren.

Dialoglastige Inhalte: Die überlegene Lippensynchronisationsgenauigkeit und die Darstellung von Mikro-Expressionen machen es zur ersten Wahl für Inhalte mit menschlichen Dialogen, emotionalen Ausdrücken und Charakter-Interaktionen in Nahaufnahme. Ersteller von Bildungsinhalten, Produzenten von Erklärvideos und alle, die dialogbasierte Inhalte erstellen, werden diese Fähigkeit als immens wertvoll empfinden.

Komplexe Multi-Referenz-Projekte: Wenn ein Projekt die Synthese von Inspirationen aus mehreren Quellen erfordert – wie die Anpassung an die Kameraführung einer Referenz, das Farbschema einer anderen, das Tempo einer Musikspur und einen detaillierten narrativen Prompt –, bietet die Fähigkeit von Seedance 2, bis zu 12 gleichzeitige Eingabe-Assets zu verarbeiten, ein unerreichtes Maß an kreativer Kontrolle.

Realistische Inhalte im Dokumentarstil: Community-Tests bescheinigen Seedance konsequent Realismus als traditionelle Stärke, was es besonders geeignet für dokumentarische Inhalte, realistische Szenarien und alle Anwendungen macht, bei denen Authentizität und natürliche Bewegungen im Vordergrund stehen.

Wan 2.6 ist ideal für:

Strukturiertes Marketing und Werbung: Die drei dedizierten Generierungspfade bieten klare Produktionsvorgaben und reproduzierbare Workflows, ideal für Marketingteams, die konsistente Markeninhalte produzieren. Der strukturierte Ansatz gewährleistet vorhersehbare Ergebnisse über Kampagnen hinweg und macht Wan 2.6 zu einer sichereren Standardwahl für repetitive Produktionsumgebungen.

Anforderungen an die Charakterkonsistenz: Der Reference-to-Video-Pfad (R2V) adressiert gezielt die Herausforderung, die Identität eines Charakters über mehrere Clips hinweg beizubehalten. Maskottchen-Inhalte, Serien mit festen Charakteren oder alle Anwendungen, die ein konsistentes Erscheinungsbild in mehreren Videos erfordern, profitieren von dieser speziellen Funktion.

Narrative Multi-Shot-Kampagnen: Die starken Multi-Shot-Fähigkeiten von Wan 2.6 unterstützen ein konsistentes Storytelling über Szenen hinweg und eignen sich für Markenfilme, Bildungsserien und strukturierte Videokampagnen, die eine narrative Kontinuität über mehrere Segmente hinweg wahren müssen.

Entwickler-Integration und API-Workflows: Die Open-Source-Verfügbarkeit von Wan 2.6 und die umfangreichen API-Integrationsoptionen machen es extrem attraktiv für Entwickler, die Videogenerierung in Anwendungen einbetten, für Plattformen, die eine On-Premise-Bereitstellung benötigen, und für Teams, die das Modellverhalten für spezifische Anwendungsfälle anpassen müssen.

Budgetbewusste Produktionen: Die Open-Source-Natur von Wan 2.6 und die wettbewerbsfähigen API-Preise machen es zu einer wirtschaftlichen Wahl für Produktions-Workflows mit hohem Volumen, bei denen die Kosten pro Video ein wichtiger Faktor sind.

Zugriff auf die Modelle: Verfügbarkeit auf Plattformen

Beide Modelle sind über mehrere Plattformen zugänglich, wobei die Verfügbarkeit je nach Region und Zugriffsmethode variiert.

Seedance 2 ist derzeit in China verfügbar, der globale Rollout ist für das 2. Quartal 2026 geplant. Der Zugriff ist über verschiedene API-Anbieter und Plattformen möglich, die die Videogenerierungsfunktionen von ByteDance integriert haben. Für Ersteller und Unternehmen, die die fortschrittlichen Fähigkeiten von Seedance 2 sofort erleben möchten, bietet Seedance 2.0 einen bequemen Zugang zu seinen multimodalen Generierungsfunktionen.

Wan 2.6 genießt aufgrund seiner Open-Source-Natur und der Integration in zahlreiche Plattformen eine breitere Verfügbarkeit. Das Modell ist über mehrere API-Anbieter, Entwicklerplattformen und Drittanbieter-Integrationen erhältlich. Ersteller können über Wan 2.6 darauf zugreifen, was einen optimierten Zugang zu allen drei Generierungspfaden (T2V, I2V, R2V) innerhalb einer einheitlichen Oberfläche bietet.

Die SeaDanceAI-Plattform bietet Zugriff auf mehrere hochmoderne Video- und Bildgenerierungsmodelle und gibt Erstellern die Flexibilität, das beste Modell für jedes spezifische Projekt zu wählen, ohne mehrere separate Integrationen verwalten zu müssen. Dieser einheitliche Zugriffspunkt vereinfacht das Workflow-Management für Teams, die mit unterschiedlichen Inhaltstypen und Produktionsanforderungen arbeiten.

Die breitere Wettbewerbslandschaft

Obwohl sich dieser Vergleich auf Seedance 2 und Wan 2.6 konzentriert, ist es hilfreich, ihre Position im Verhältnis zu anderen wichtigen Modellen zu verstehen.

Kuaishous Kling 3.0 bietet natives 4K/60fps und integrierte Multi-Shot-Storyboarding-Funktionen und stellt damit die derzeit höchstmögliche Auflösungsoption dar. Dies geht jedoch mit einer Premium-Preisgestaltung einher, die für viele Produktionsszenarien, in denen eine 1080p-Ausgabe ausreicht, möglicherweise überdimensioniert ist.

Google DeepMinds Veo 3.1 führt die geschlossenen Modelle mit dem umfassendsten Audio-Paket an, das Dialoge, Foley, Atmosphäre und Musikverständnis in einer einzigen Generierung umfasst. Veo 3.1 bietet auch eine echte 4K-Ausgabe, obwohl der Zugriff durch den kontrollierten Release-Prozess von Google weiterhin eingeschränkt bleibt.

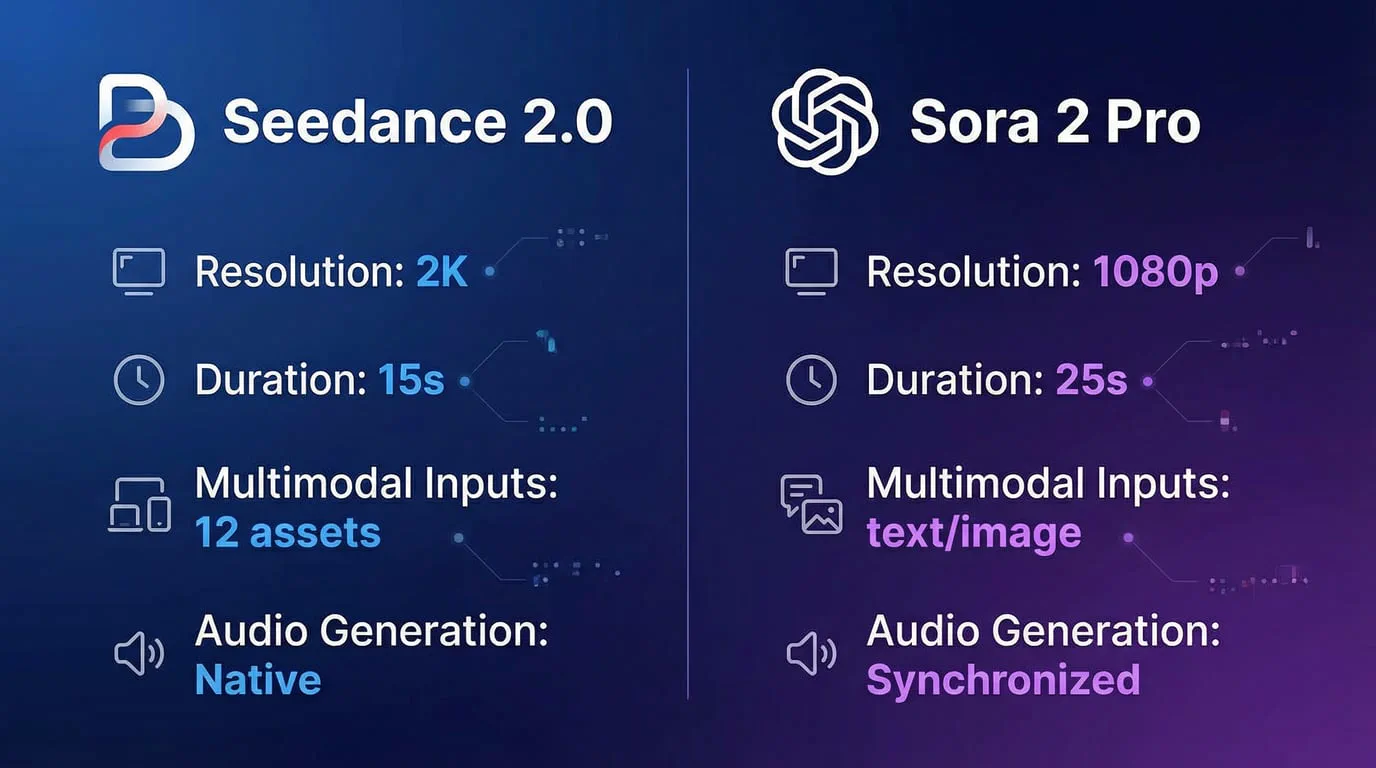

OpenAIs Sora 2 erreicht eine überlegene physikalische Genauigkeit und umfassende Audio-Generierung und setzt in vielen Dimensionen die Qualitätsmaßstäbe. Der Zugriff bleibt jedoch begrenzt, und die Preisgestaltung für die kommerzielle Nutzung wurde noch nicht veröffentlicht.

In diesem Wettbewerbsumfeld zeichnen sich Seedance 2 und Wan 2.6 durch ihre sofortige praktische Nutzbarkeit, ihre Produktionsqualität und ihre klaren Wertversprechen für spezifische Anwendungsfälle aus. Keines von beiden versucht, in jeder Dimension das "Beste" zu sein; stattdessen brilliert jedes dort, wo es für unterschiedliche Produktionsanforderungen darauf ankommt.

Entscheidungsrahmen: Die Wahl Ihres Modells

Statt einen einzelnen "Gewinner" zu küren, erfordert der reife KI-Videomarkt des Jahres 2026 die Abstimmung der Modellstärken auf die spezifischen Produktionsanforderungen.

Wählen Sie Seedance 2, wenn:

-

Die Qualität der audiovisuellen Synchronisation entscheidend ist

-

Das Projekt die Synthese mehrerer kreativer Referenzen erfordert

-

Dialoge, Emotionen und Charakterdarstellung im Mittelpunkt des Inhalts stehen

-

Filmische Qualität und atmosphärisches Storytelling Priorität haben

-

Sie höchste Qualität bei Lippensynchronisation und Mikro-Expressionen benötigen

-

Ihr Fokus auf realistischen Inhalten im Dokumentarstil liegt

Wählen Sie Wan 2.6, wenn:

-

Ein reproduzierbarer, konsistenter Produktions-Workflow unerlässlich ist

-

Charakterkonsistenz über mehrere Clips hinweg erforderlich ist

-

Sie strukturierte Marketing- oder Werbeinhalte produzieren

-

Entwickler-Integration und API-Flexibilität Priorität haben

-

Budgetbeschränkungen Open-Source-Optionen begünstigen

-

Ihr Team klare Produktionspfade und vorhersehbare Ergebnisse schätzt

Ziehen Sie die Nutzung beider Modelle in Betracht, wenn:

-

Sie verschiedene Arten von Inhalten produzieren, die die Stärken jedes Modells nutzen

-

Sie dynamisch verschiedene Modellleistungen für dasselbe kreative Briefing testen möchten

-

Ihr Produktionsvolumen die Aufrechterhaltung mehrerer Tool-Integrationen rechtfertigt

-

Verschiedene Teammitglieder unterschiedliche Fähigkeiten und Workflow-Präferenzen haben

Die Zukunft der KI-Videogenerierung

Die rasanten Fortschritte von Seedance 1.0 zu Seedance 2 und von Wan 2.5 zu Wan 2.6 verdeutlichen das beschleunigte Innovationstempo bei der KI-Videogenerierung. Es zeichnen sich mehrere Trends ab, die die nächste Generation von Werkzeugen prägen werden:

Steigende Auflösungen und Bildraten werden 4K und 60fps weiterhin von Premium-Features zu Standardausgaben machen. Obwohl der aktuelle Standard von 1080p/24fps die meisten Anforderungen erfüllt, ist die Richtung klar.

Längere Zeiträume sprengen die derzeitige Grenze von 15 Sekunden. Die Generierung von Langform-Inhalten bleibt eine Herausforderung in Bezug auf Rechenaufwand und Konsistenz, aber mit jeder Modelliteration zeigen sich schrittweise Verbesserungen.

Verbesserte Steuerungsschnittstellen entwickeln sich von Text-Prompts und Referenzbildern hin zu intuitiveren kreativen Steuerungssystemen. Das auf natürlicher Sprache basierende @-Erwähnungssystem von Seedance 2 ist ein Beispiel; zukünftige Iterationen werden wahrscheinlich noch ausgefeiltere Steuerungsmechanismen integrieren.

Integration in Produktions-Workflows wird immer wichtiger, da diese Werkzeuge von experimentellen Neuheiten zu unverzichtbarer Produktionsinfrastruktur werden. API-Zuverlässigkeit, Batch-Verarbeitungsfunktionen und die Integration in bestehende Kreativsoftware werden Profi-Werkzeuge von Consumer-Apps unterscheiden.

Fazit: Die produktionsreife KI-Videogeneration ist da

Der Vergleich zwischen Seedance 2 und Wan 2.6 offenbart eine grundlegende Wahrheit über den aktuellen Stand der KI-Videogenerierung: Wir haben die Frage, ob KI professionelle Videos erstellen kann, bereits hinter uns gelassen und befinden uns in der nuancierteren Phase der Frage, welches spezialisierte Werkzeug welche kreativen Anforderungen am besten erfüllt.

Seedance 2 repräsentiert die Spitze der multimodalen kreativen Kontrolle und filmischen Qualität und schneidet außergewöhnlich gut bei audiovisueller Synchronisation, emotionaler Darstellung und komplexer Referenzsynthese ab. Seine einheitliche Architektur und die Fähigkeit, bis zu 12 gleichzeitige Eingabe-Assets zu verarbeiten, bieten eine beispiellose kreative Flexibilität für narrative und charaktergesteuerte Inhalte.

Wan 2.6 bietet durch dedizierte Generierungspfade, die für spezifische Anwendungsfälle optimiert sind, einen strukturierten, reproduzierbaren Produktions-Workflow. Seine Reference-to-Video-Fähigkeit adressiert den kritischen Bedarf an Charakterkonsistenz, während seine Open-Source-Natur und umfangreiche API-Integrationsmöglichkeiten es extrem attraktiv für Entwickler und budgetbewusste Produktionsteams machen.

Keines der Modelle ist universell überlegen; jedes brilliert in Dimensionen, die für unterschiedliche Produktionsszenarien wichtig sind. Der reife Ansatz besteht darin, diese Stärken zu verstehen und für jedes spezifische Projekt das richtige Werkzeug zu wählen.

Für Ersteller, Vermarkter und Produktionsteams, die sich in dieser Landschaft bewegen, ist der praktische Rat klar: Testen Sie beide Modelle mit Inhalten, die repräsentativ für Ihre tatsächliche Produktionslinie sind. Der Unterschied in der Ausgabequalität, der Workflow-Effizienz und der kreativen Kontrolle wird schnell deutlich werden und es Ihnen ermöglichen, fundierte Entscheidungen auf der Grundlage realer Ergebnisse statt technischer Spezifikationen zu treffen.

Die Revolution der KI-Videogenerierung ist keine Vorhersage mehr; sie ist da. Werkzeuge wie Seedance 2 und Wan 2.6 produzieren bereits Inhalte für Werbespots, Social-Media-Kampagnen, Bildungsmaterialien und kreative Projekte weltweit. Die Frage ist nicht mehr, ob diese Werkzeuge eingesetzt werden sollen, sondern wie man sie am effektivsten in den eigenen kreativen Workflow integriert.

Greifen Sie über einheitliche Plattformen wie Seedance 2.0 und Wan 2.6 auf beide Modelle zu, um deren Fähigkeiten selbst zu erleben und herauszufinden, welches Modell Ihre einzigartige kreative Vision am besten unterstützt.