Die Landschaft der KI-Videogenerierung hat im Jahr 2026 einen Wendepunkt erreicht. Zwei Modelle dominieren die Gespräche zwischen Kreativen, Vermarktern und Entwicklern: Seedance 2.0 von ByteDance und Sora 2 Pro von OpenAI. Beide stellen den Höhepunkt von KI-generiertem Video dar, verfolgen jedoch grundlegend unterschiedliche Ansätze zur Lösung derselben kreativen Herausforderungen.

Dieser umfassende Vergleichsleitfaden untersucht jede kritische Dimension – technische Fähigkeiten, Ausgabequalität, Preismodelle, Workflow-Effizienz und reale Leistung – um Ihnen zu helfen, eine fundierte Entscheidung darüber zu treffen, welches Modell am besten zu Ihren Produktionsanforderungen passt.

Das Fundament: Architektur und Kernfähigkeiten

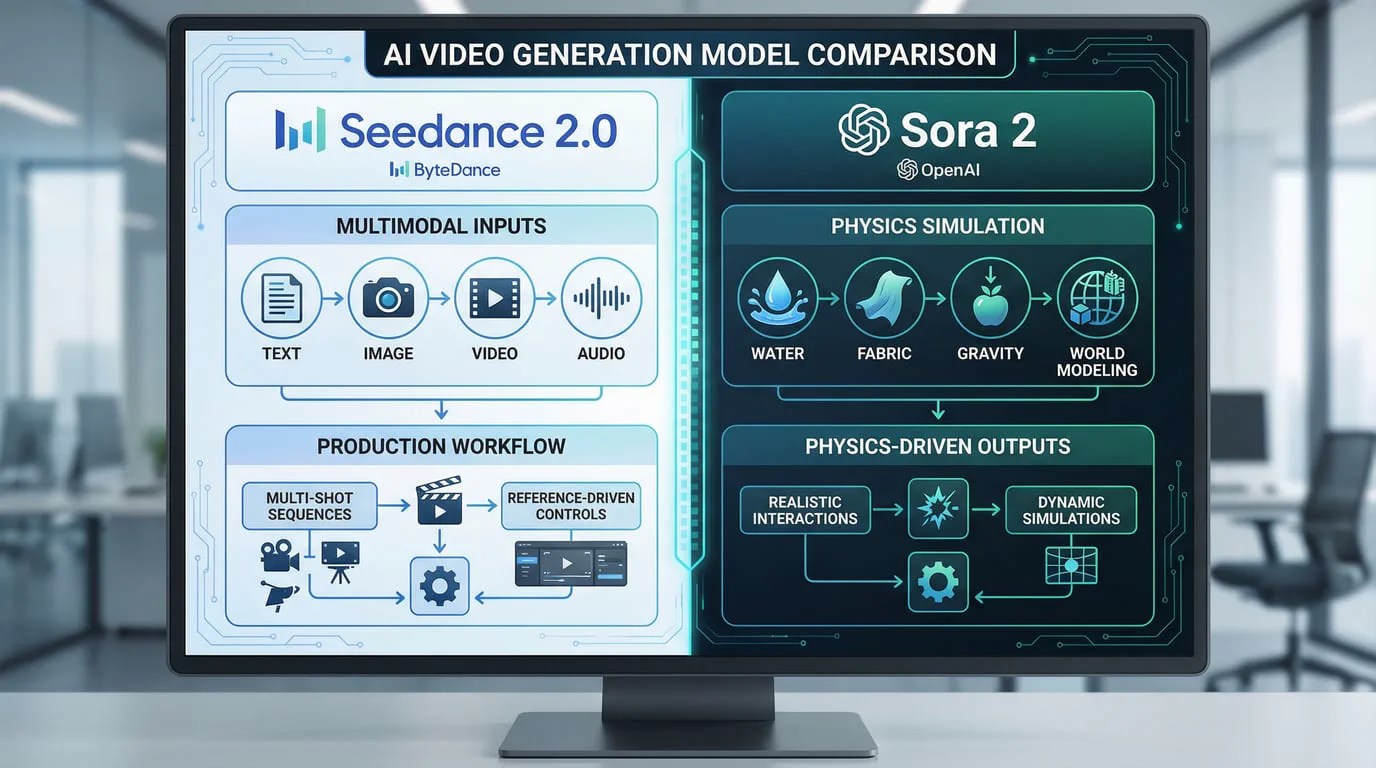

Seedance 2.0 ist die Antwort von ByteDance auf die Herausforderung der multimodalen Videogenerierung. Aufgebaut auf einer vereinheitlichten multimodalen Audio-Video-Co-Generationsarchitektur, unterstützt es gleichzeitig Text-, Bild-, Audio- und Videoeingaben. Diese architektonische Entscheidung verleiht Seedance 2.0 das, was ByteDance als „die branchenweit umfassendsten multimodalen Inhaltsreferenz- und Bearbeitungsfähigkeiten“ bezeichnet. Das Modell kann bis zu 12 Inhaltselemente in einer einzigen Generierung akzeptieren (9 Bilder, 3 Videos und 3 Audioclips), wobei jede Video- oder Audioeingabe bis zu 15 Sekunden Inhalt unterstützt.

Sora 2 Pro hingegen baut auf OpenAIs Ansatz der Weltsimulation auf. Das Modell zeichnet sich durch das Verständnis und die Nachbildung der realen Physik aus, was es besonders stark für die Generierung von Inhalten macht, die präzise physikalische Dynamiken erfordern. OpenAI beschreibt Sora 2 Pro als fähig, „olympische Turnroutinen, Rückwärtssaltos auf einem Paddleboard, die Auftriebs- und Steifigkeitsdynamiken präzise modellieren, und einen dreifachen Axel einer Katze, die um ihr Leben kämpft“, zu bewältigen. Dieser physikzentrierte Fokus bedeutet, dass Sora 2 Pro Videos mit synchronisiertem Audio generieren und reichhaltige, detaillierte dynamische Clips aus natürlicher Sprache oder Bildern erstellen kann.

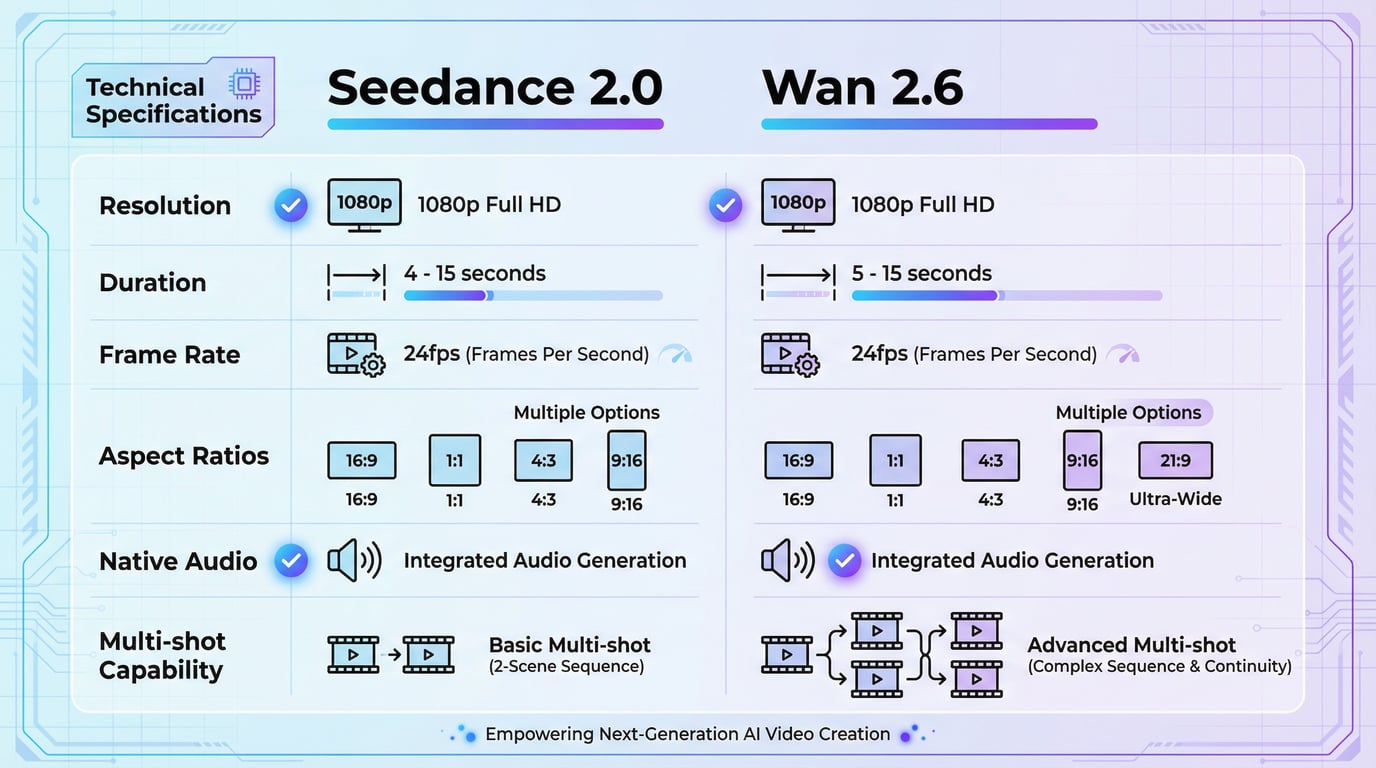

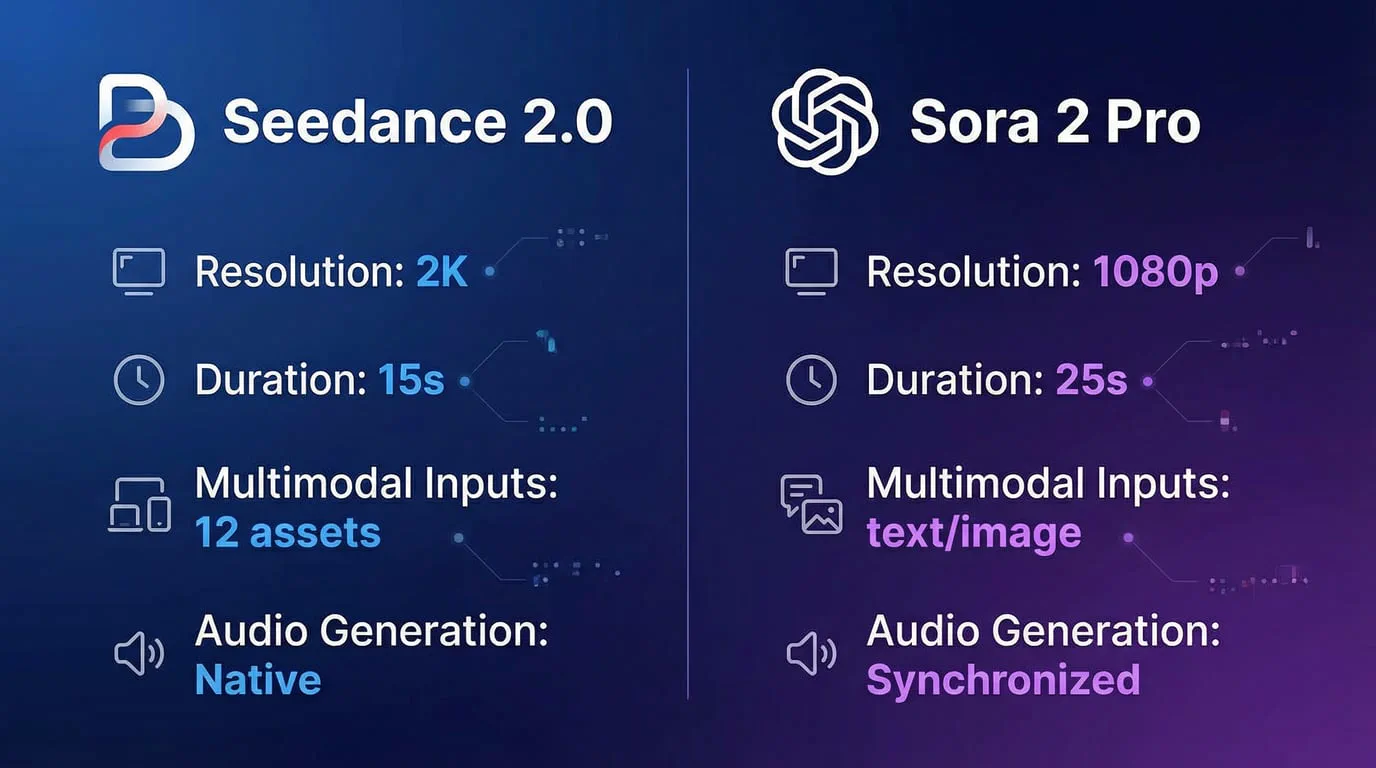

Technische Spezifikationen: Auflösung, Dauer und Ausgabequalität

Die Auflösung ist einer der wichtigsten Unterscheidungsfaktoren zwischen diesen beiden Modellen. Seedance 2.0 generiert Videos in einer nativen 2K-Auflösung (2160p) und unterstützt mehrere Seitenverhältnisse, darunter 16:9, 9:16, 4:3, 3:4, 21:9 und 1:1. Dieser Auflösungsvorteil macht Seedance 2.0 besonders wertvoll für großformatige Displays, hochauflösende Werbung und alle Inhalte, die für professionelle Produktionsumgebungen bestimmt sind. Das Modell produziert Videos zwischen 4 und 15 Sekunden mit deutlich verbesserter Konsistenz bei Gesichtern, Kleidung, Text, Szenen und visuellen Stilen.

Sora 2 Pro bleibt bei einer 1080p-Auflösung, gleicht dies jedoch durch längere Dauerfähigkeiten aus. Die Pro-Version unterstützt eine konsistente Generierung von bis zu 25 Sekunden in einer einzigen Ausgabe, während das Standard-Sora 2 bei 10–15 Sekunden stoppt. Diese verlängerte Dauer ermöglicht die Erstellung kompletter Erzählungen in einer einzigen Generierung, ohne dass mehrere Segmente bearbeitet werden müssen. Das Modell behält die visuelle und auditive Konsistenz über diese längeren Erzählbögen bei und löst damit eine der grundlegenden Herausforderungen der KI-Videogenerierung.

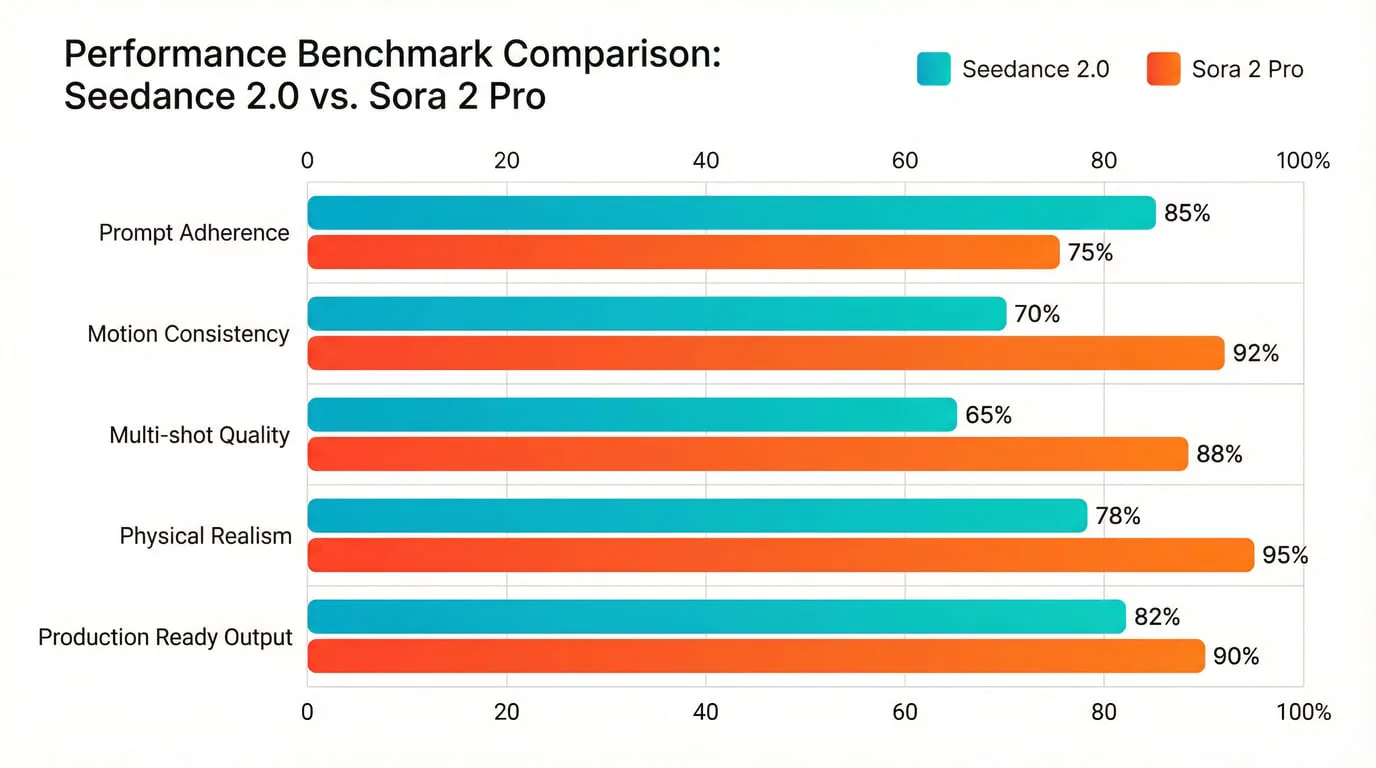

Unabhängige Tests Anfang 2026 von neun führenden KI-Videomodellen zeigten nuancierte Leistungsmerkmale. Sora 2 belegte den ersten Platz in physikalischem Realismus und langfristiger Kontinuität. Seedance 2.0 bewies Exzellenz bei der Befolgung von Anweisungen (Prompt-Adhärenz), der Konsistenz über mehrere Aufnahmen hinweg und der Produktion von produktionsreifen Ergebnissen, die minimale Nachbearbeitung erfordern.

Multimodale Steuerung: Der Seedance 2.0-Vorteil

Das entscheidende Merkmal von Seedance 2.0 ist sein beispielloses multimodales Referenzsystem. Das Modell akzeptiert nicht nur mehrere Eingabetypen; es versteht, wie man sie zusammen verwendet. Durch die Bereitstellung von Quellvideos kann Seedance 2.0 Bewegungslogik, Spezialeffekte und Charakteraktionen direkt aus dem Quellmaterial lernen. Audio-Referenzen ermöglichen es dem Modell, Rhythmus, Atmosphäre und Sounddesign zu verstehen und diese Qualitäten dann in der generierten Ausgabe zu replizieren. Diese Fähigkeit erstreckt sich auf rhythmusbasierte visuelle Übergänge und sogar Lippensynchronisation auf Phonemebene, was Seedance 2.0 zu einem unglaublich leistungsstarken Werkzeug für Musikvideos, dynamische Präsentationen und alle Inhalte macht, die eine strikte Audio-Video-Synchronisation erfordern.

Die praktischen Auswirkungen dieses multimodalen Ansatzes sind tiefgreifend. Wenn Sie Markeninhalte erstellen und über mehrere Videos hinweg bestimmte visuelle Stile beibehalten müssen, können Sie Seedance 2.0 Referenzbilder zur Verfügung stellen, die Ihre Markenästhetik festlegen. Wenn Sie eine Serie produzieren, in der die Charakterkonsistenz an erster Stelle steht, behält das Modell ein stabiles Charakterbild über Bilder und Aufnahmen hinweg bei und löst damit das häufige Problem der Charakterdrift und Stilinkonsistenzen in KI-Videos.

Sora 2 Pro verfolgt einen anderen Ansatz. Anstatt mehrere Referenz-Assets zu akzeptieren, konzentriert es sich auf das Verständnis von Beschreibungen in natürlicher Sprache mit außergewöhnlicher Tiefe. Sie können komplexe Kamerabewegungen beschreiben – Dolly-Zooms, Schärfeverlagerungen, Verfolgungsjagden, POV-Wechsel – und das Modell führt sie präzise aus. Die Stärke des Modells liegt in seiner Fähigkeit, reale Physik und Umweltinteraktionen zu simulieren. Kampfszenen, Fahrzeugverfolgungsjagden, Explosionen und fallende Trümmer verhalten sich gemäß realistischen physikalischen Gesetzen.

Audiogenerierung: Native Integration vs. Synchronisierte Ausgabe

Beide Modelle generieren Videos mit Audio, aber ihre Ansätze unterscheiden sich deutlich. Seedance 2.0 bietet dank seiner vereinheitlichten Architektur eine native Audio-Video-Co-Generierung. Das Modell generiert automatisch Dialoge, Umgebungsgeräusche und Soundeffekte, die Bild für Bild in Echtzeit mit dem Visuellen übereinstimmen. Dies macht eine manuelle Audiobearbeitung in der Nachbearbeitung überflüssig. Die integrierte Audiogenerierungsfunktion wurde von den Benutzern besonders gelobt; wie einer anmerkte: „Die Soundeffekte passen perfekt zur Action, und die Funktion zur Synchronisierung mit dem Takt der Musik ist unglaublich hilfreich für Tanz- und Musikinhalte.“

Sora 2 Pro generiert Videos mit synchronisiertem Audio; das bedeutet, dass das Audio passend zum visuellen Inhalt erstellt wird, jedoch über einen etwas anderen Prozess. Als Allzweck-Video-zu-Audio-Generierungssystem erstellt es anspruchsvolle Hintergrundgeräusche, Sprache und Soundeffekte mit einem hohen Grad an Realismus. Die Integration von Umgebungsgeräuschen bedeutet, dass Umgebungsgeräusche wie Wind, Verkehr und Schritte kontextbezogen basierend auf den in Ihrem Prompt beschriebenen visuellen Elementen generiert werden.

Multi-Shot-Sequenzen und narrative Kontinuität

Seedance 2.0 ermöglicht es Kreativen, Multi-Shot-Sequenzen zu produzieren, die natürlich zwischen Kamerawinkeln und Perspektiven wechseln und dabei die visuelle Konsistenz beibehalten. Diese Fähigkeit verleiht dem Storytelling Dynamik und eignet sich daher für filmische Szenen, Dialoge und Markeninhalte, die Energie und Engagement erfordern. Das Modell kann mehrere Aufnahmen mit natürlichen Schnitten und Übergängen innerhalb eines 15-sekündigen Generierungsfensters generieren, wodurch sich eine einzelne Ausgabe wie eine bearbeitete Sequenz und nicht wie ein einzelner kontinuierlicher Clip anfühlt.

Ein wesentlicher Unterscheidungsfaktor liegt in der Umgebungskonsistenz. Sora 2-Videos weisen manchmal Momente auf, in denen Hintergründe zwischen Aufnahmen unnatürlich glatt oder verschwommen erscheinen und die Immersion stören. Seedance 2.0 mildert dies erheblich ab und behält über die Schnitte hinweg scharfe Hintergrunddetails und eine konsistente Beleuchtung bei.

Die Stärke von Sora 2 Pro bei Multi-Shot-Sequenzen liegt in seiner verlängerten Dauer von 25 Sekunden. Diese zusätzliche Zeit ermöglicht komplexere narrative Entwicklungen innerhalb einer einzigen Generierung. Das Modell behält die zeitliche Konsistenz über diese verlängerten Sequenzen hinweg bei und stellt sicher, dass das Aussehen der Charaktere, Umgebungsdetails und die Beleuchtung von Anfang bis Ende konstant bleiben.

Performance-Benchmarks: Testergebnisse aus der Praxis

Mehrere unabhängige Bewertungen haben diese Modelle unter kontrollierten Bedingungen verglichen. Laut Testanalysen von Anfang 2026 demonstrierte Seedance 2.0 eine Erfolgsquote von über 90 % bei der Darstellung komplexer physikalischer Aktionen und erweist sich damit als eine der robustesten Alternativen auf Unternehmensniveau, die derzeit verfügbar sind.

Vergleichstests mit identischen Prompts auf beiden Modellen zeigen unterschiedliche Leistungsprofile. Bei der direkten Generierung aus einfachen Prompts liefern beide Modelle hervorragende Ergebnisse. Um die kreative Kontrolle durch spezifische Referenzmaterialien zu maximieren – einen zu replizierenden Bewegungsstil, einen zu synchronisierenden Rhythmus oder eine zu folgende Vorlage – erweist sich das multimodale Referenzsystem von Seedance 2.0 als unübertroffen. Für physikalischen Realismus in Szenarien mit komplexen Dynamiken und Umweltinteraktionen bleibt Sora 2 der Standard.

Wie ein Analyst anmerkte: „Sora ist nach wie vor beeindruckend, insbesondere beim Verständnis groß angelegter Szenen, aber Seedance hat es in Bezug auf Kontrollierbarkeit und Stabilität überholt und die filmische Lücke geschlossen.“ Diese Bewertung deutet darauf hin, dass ByteDance nicht nur aufgeholt, sondern seine Werkzeuge für Kreative optimiert hat und ab 2026 gewinnt.

Preisgestaltung und Zugänglichkeit: Analyse der Kosteneffizienz

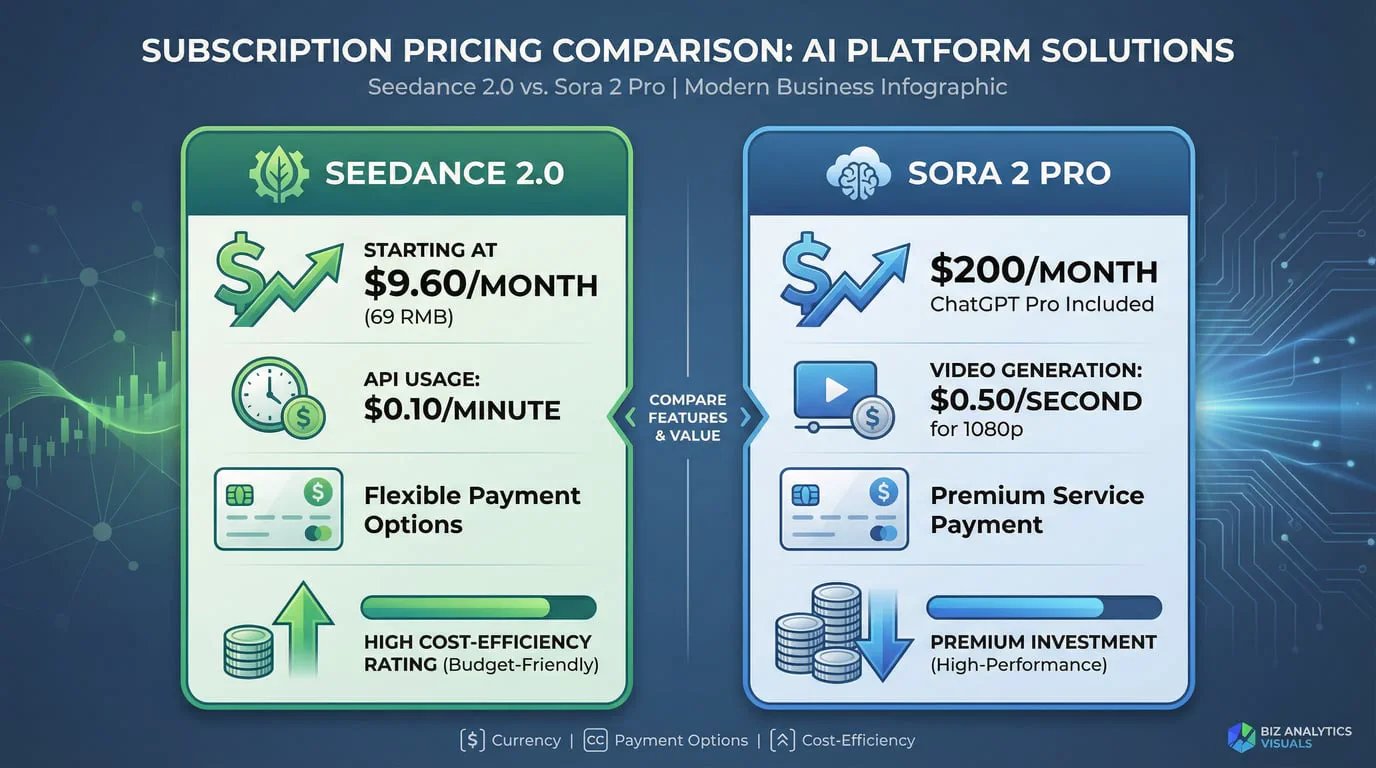

Die Preisstrukturen dieser beiden Modelle unterscheiden sich drastisch und spiegeln ihre Marktpositionierung und Zugriffsstrategien wider. Seedance 2.0 bietet mehrere Zugangswerte. Über die Jimeng (Dreamina)-Plattform von ByteDance beginnen Premium-Mitgliedschaften bei etwa 69 RMB (9,60 USD) pro Monat. Die Xiaoyunque-App befindet sich derzeit in einer zeitlich begrenzten kostenlosen Testphase, während die Doubao-App und das Web-Interface eine tägliche kostenlose Videogenerierungskapazität für Gelegenheitskreative bieten.

Für den API-Zugriff folgt Seedance 2.0 einem Pay-as-you-go-Modell, das bei etwa 0,10 USD pro generierter Videominute beginnt. Diese Preisgestaltung ist für Produktions-Workflows äußerst kosteneffizient. Eine Analyse ergab, dass bei einem 90-Minuten-Projekt basierend auf den bestehenden Erfolgsquoten bei anderen Modellen über 100 USD für fehlgeschlagene Generierungen ausgegeben werden könnten, während die hohe Erfolgsquote von Seedance 2.0 es ermöglichte, dasselbe Projekt für etwa 20 USD abzuschließen, was einer Ersparnis von 80 % bei den Produktionskosten entspricht.

Sora 2 Pro erfordert ein ChatGPT Pro-Abonnement im Wert von 200 USD pro Monat. Dieses Abonnement bietet Zugriff auf Sora 2 Pro im Wert von 10.000 monatlichen Credits. ChatGPT Plus-Benutzer (20 USD pro Monat) erhalten einen begrenzten Zugriff auf Sora 2 mit 1.000 monatlichen Credits, aber diese Stufe ist auf 720p-Auflösung und 10-sekündige Videos mit Wasserzeichen beschränkt. Die Pro-Stufe schaltet die 1080p-Auflösung frei und entfernt die Wasserzeichen, was sie zur minimal praktikablen Option für professionelle Arbeit macht.

Für den API-Zugriff kostet Sora 2 Pro 0,50 USD pro Sekunde für 1080p-Ausgabe. Diese Preisgestaltung bedeutet, dass die Generierung eines 25-sekündigen Videos 12,50 USD kostet, im Vergleich zu etwa 0,25 USD für ein 15-sekündiges Video über Seedance 2.0.

Workflow-Integration und Plattform-Zugänglichkeit

Die Zugriffsmuster für die Modelle spiegeln unterschiedliche Bereitstellungsstrategien wider. Seedance 2.0 ist über BytePlus (die Unternehmensplattform von ByteDance) und Drittanbieter wie WaveSpeedAI, Replicate und Atlas Cloud verfügbar. Diese plattformübergreifende Verfügbarkeit bietet Entwicklern Flexibilität bei der Integration des Modells in ihre eigenen Anwendungen.

Geografische Einschränkungen gelten für jedes Modell unterschiedlich. Seedance 2.0 war ursprünglich primär in China über die Jimeng-Plattform verfügbar, wobei der internationale Zugang schrittweise über Drittanbieter von APIs erweitert wurde. Sora 2 Pro schränkte die Verfügbarkeit ursprünglich auf bestimmte Länder ein, was einen VPN-Zugang oder alternative Plattformlösungen für Benutzer in nicht unterstützten Regionen erforderte.

Ein aufkommender Trend im Jahr 2026 ist der Aufstieg von Multi-Modell-Plattformen, die über eine einzige Schnittstelle einen einheitlichen Zugriff auf mehrere KI-Videogenerationsmodelle, einschließlich Seedance 2.0 und Sora 2 Pro, bieten. Diese Plattformen ermöglichen es Benutzern, die besten Videomodelle zusammen mit den Bildgenerationsfähigkeiten verschiedener Spitzenmodelle zu nutzen. Dieser Ansatz macht separate Abonnements überflüssig, erspart das Erlernen unterschiedlicher Oberflächen und vereinfacht die Verfolgung individueller Credit-Systeme.

Anwendungsfall-Optimierung: Wann welches Modell wählen?

Die optimale Modellwahl hängt stark von Ihren spezifischen Workflow-Anforderungen und Produktionszielen ab. Seedance 2.0 glänzt in Szenarien, die vorlagenbasierte Aufgaben, Inhalts-Remixing und eine strikte Audio-Video-Synchronisation erfordern. Wenn Sie schnell mehrere Variationen von Marketinginhalten produzieren, die Charakterkonsistenz über Szenen hinweg beibehalten oder Videos generieren müssen, die minimale Nachbearbeitung erfordern, bietet Seedance 2.0 genau diese Workflow-Optimierung. Das multimodale Referenzsystem ist ideal für Markeninhalte, bei denen die Beibehaltung spezifischer visueller Stile über mehrere Ausgaben hinweg entscheidend ist.

Die nativen Audiogenerations- und Beat-Matching-Fähigkeiten des Modells sind besonders leistungsstark für Musikvideos, Tanzinhalte und jedes Szenario, in dem das Timing entscheidend ist. Wie ein Benutzer anmerkte: „Ich referenziere eine komplexe Actionsequenz aus einem Film und Seedance 2.0 stellt sie mit meinem Charakter nach. Die Bewegungspräzision ist mit nichts vergleichbar, was ich bisher in KI-Videos gesehen habe.“

Sora 2 Pro ist die erste Wahl, wenn physikalischer Realismus und Weltsimulation die Prioritäten sind. Für Szenarien mit komplexer Physik wie Fahrzeugdynamik, Wassersimulationen oder realistischen Charakterbewegungen in anspruchsvollen Umgebungen liefert der physikzentrierte Ansatz von Sora 2 Pro überlegene Ergebnisse. Seine verlängerte Dauer von 25 Sekunden ist ideal für längere narrative Sequenzen, bei denen die Konsistenz über mehrere Story-Punkte innerhalb einer einzigen Generierung beibehalten werden muss.

Bei der direkten Text-zu-Video-Generierung ohne Referenzmaterialien – also der bloßen Beschreibung einer Szene – sind beide Modelle exzellent. In diesem Fall hängt die Entscheidung davon ab, ob Sie der Auflösung (2K-Ausgabe von Seedance 2.0) oder der Dauer (bis zu 25 Sekunden von Sora 2 Pro) Vorrang einräumen.

Überlegungen zum Produktions-Workflow

Echte Produktions-Workflows umfassen oft mehrere Phasen der Ideenfindung, Generierung, Überprüfung, Iteration und Finalisierung. Die hohe Erfolgsquote von Seedance 2.0 (über 90 %) bedeutet weniger verschwendete Generierungen und schnellere Iterationszyklen. Die Möglichkeit, Referenzmaterialien im Voraus bereitzustellen, reduziert die Anzahl der benötigten Generierungsversuche, um das gewünschte Ergebnis zu erzielen. Sie können dem Modell die gewünschte Bewegung, den Stil oder die Atmosphäre zeigen, anstatt sie nur mit Text zu beschreiben, was einen Großteil der Mehrdeutigkeit eliminiert, die oft zu unbefriedigenden Ergebnissen führt.

Die Steuerungsfunktionen für natürliche Sprache von Seedance 2.0 wurden für ihre Intuitivität gelobt. Ein Benutzer berichtete: „Man erklärt einfach, worauf man sich beziehen möchte und wie man es tun möchte, und das Modell versteht es perfekt.“ Diese Benutzerfreundlichkeit verkürzt die Lernkurve und ermöglicht es Kreativen, sich mehr auf kreative Entscheidungen als auf Prompt-Engineering zu konzentrieren.

Der Workflow von Sora 2 Pro dreht sich um detailliertes Prompt-Engineering. Das Modell zeichnet sich durch das Befolgen komplexer und spezifischer Anweisungen aus, erfordert jedoch ein Verständnis dafür, wie man Prompts effektiv strukturiert, um die besten Ergebnisse zu erzielen. Sie müssen Kamerawinkel – wie „Nahaufnahme der Hände“ oder „Weitwinkel-Luftaufnahme“ – explizit angeben, um zufällige Ausschnitte zu vermeiden. Die Stärke des Modells beim Verständnis der Filmsprache bedeutet, dass Kreative mit filmischem Hintergrund vertraute Terminologie nutzen können, um präzise Ergebnisse zu erzielen.

API-Integration und Entwicklererfahrung

Für Entwickler, die KI-Videogenerierung in ihre eigenen Produkte integrieren möchten, bieten beide Modelle robuste APIs mit tragfähigen Preisstrukturen, obwohl sie die volle Reife einer Unternehmensinfrastruktur noch nicht ganz erreicht haben. Die Landschaft zwischen 2025 und Anfang 2026 wandelte sich rasant, wobei die Veröffentlichung von Seedance 2.0, die Stabilisierung von Sora nach anfänglichen Herausforderungen und die kontinuierlichen API-Erweiterungen alle innerhalb von Monaten stattfanden.

Die API von Seedance 2.0 über Volcengine bietet programmatischen Zugriff auf die gesamte multimodale Generationssuite. Entwickler können mehrere Asset-Typen in einem einzigen API-Aufruf übergeben, und das Modell behält automatisch die Konsistenz über alle bereitgestellten Referenzen hinweg bei. Der Preis von etwa 0,10 USD pro generierter Videominute ist für Anwendungen, die eine Hochvolumen-Generierung erfordern, äußerst kosteneffizient.

Der API-Zugriff für Sora 2 Pro wurde nach seiner Veröffentlichung für Endverbraucher schrittweise erweitert. Die API-Preisgestaltung von 0,50 USD pro Sekunde für 1080p-Ausgabe positioniert es als Premium-Option. Für Anwendungen, bei denen physikalischer Realismus und lange Dauer nicht verhandelbare Anforderungen sind, kann die überlegene Ausgabequalität in diesen spezifischen Dimensionen den Premium-Preis rechtfertigen.

Vergleichende Analyse: Hauptunterscheidungsmerkmale

| Merkmal | Seedance 2.0 | Sora 2 Pro |

|---|---|---|

| Maximale Auflösung | 2K (2160p) | 1080p |

| Videodauer | 4-15 Sekunden | Bis zu 25 Sekunden |

| Multimodale Eingabe | Text, 9 Bilder, 3 Videos, 3 Audio | Text, Bild |

| Audiogenerierung | Native Video-Audio-Co-Generierung | Synchronisiertes Audio |

| Seitenverhältnisse | 16:9, 9:16, 4:3, 3:4, 21:9, 1:1 | Standardformate |

| Abonnementkosten | Ab 9,60 USD/Monat | 200 USD/Monat (ChatGPT Pro) |

| API-Preisgestaltung | ~0,10 USD / Minute | 0,50 USD / Sekunde (1080p) |

| Erfolgsquote | >90 % (Gemeldet) | Hoch (Nicht offengelegt) |

| Kernstärken | Multimodale Steuerung, Konsistenz | Physik-Realismus, Dauer |

| Bestens geeignet für | Vorlagenarbeit, Markenidentität | Physikalische Simulation, Narrative |

Der Vorteil der vereinheitlichten Plattform

Anstatt sich ausschließlich für eines dieser Modelle zu entscheiden, nutzen viele Produktionsteams mittlerweile Multi-Modell-Plattformen, die über eine einzige Schnittstelle Zugriff auf sowohl Seedance 2.0 als auch Sora 2 Pro bieten. Dieser Ansatz bietet mehrere Vorteile: Sie können für jede spezifische Aufgabe das am besten geeignete Modell auswählen, ohne separate Abonnements pflegen zu müssen, die Ergebnisse verschiedener Modelle direkt miteinander vergleichen und zwischen den Modellen wechseln, wenn sich die Projektanforderungen ändern.

Plattformen, die einen einheitlichen Zugang zu verschiedenen produktionsreifen KI-Video- und Bildgenerationsmodellen bieten, ersparen die Verwaltung mehrerer Konten, das Erlernen unterschiedlicher Benutzeroberflächen und das Nachverfolgen separater Guthabensysteme. Für Teams, die Inhalte in verschiedenen Formaten produzieren, ist diese Flexibilität von unschätzbarem Wert. Sie können Seedance 2.0 für Marken-Social-Media-Inhalte nutzen, bei denen Konsistenz und schnelle Bearbeitungszeiten entscheidend sind, und für „Hero“-Videos, bei denen physikalischer Realismus und lange Dauer die höheren Kosten rechtfertigen, auf Sora 2 Pro umsteigen.

Zugang zur fortschrittlichen KI-Videogenerierung

Für Kreative und Unternehmen, die die Leistung dieser hochmodernen Modelle nutzen möchten, bieten wir einen bequemen Zugang zu Seedance 2.0, Sora 2 Pro und anderen führenden Videogenerationsmodellen. Unsere Plattform umfasst auch den Zugriff auf mehrere fortschrittliche Bildgenerationsmodelle wie Flux, Stable Diffusion und DALL-E 3 und bietet so eine umfassende Suite für alle Ihre Anforderungen an die KI-Inhaltserstellung.

Entdecken Sie Seedance 2.0: https://seadanceai.com/seedance-2

Entdecken Sie Sora 2 Pro: https://seadanceai.com/sora-2

Dieser vereinheitlichte Ansatz stellt sicher, dass Sie die Flexibilität haben, das richtige Modell für jedes Projekt zu wählen, und eliminiert die Komplexität der Verwaltung mehrerer Abonnements und Plattformen. Egal, ob Sie die multimodale Steuerung von Seedance 2.0 für Markeninhalte oder den physikalischen Realismus von Sora 2 Pro für filmische Sequenzen benötigen, Sie können auf beide an einem Ort zugreifen.

Zukünftige Entwicklung und Modell-Evolution

Die Landschaft der KI-Videogenerierung entwickelt sich rasant weiter. Sowohl ByteDance als auch OpenAI aktualisieren ihre Modelle aktiv und führen regelmäßige Verbesserungen bei der Generationsgeschwindigkeit, Ausgabequalität und dem Funktionsumfang ein. Der Wettbewerbsdruck zwischen diesen führenden Ansätzen treibt Innovationen voran, von denen die gesamte kreative Gemeinschaft profitiert.

Branchenbeobachter erwarten, dass bis Ende 2026 der „Generations-Überprüfungs-Iterations“-Zyklus eher in Sekunden als in Minuten gemessen wird. Diese Transformation wird KI-Video von einem Produktionswerkzeug in ein kreatives Instrument verwandeln – etwas, das man eher „spielt“ als nur benutzt.

Die Konvergenz der Fähigkeiten wird wahrscheinlich dazu führen, dass beide Modelle ihre aktuellen Einschränkungen überwinden. Seedance 2.0 könnte seine maximale Dauer verlängern, während Sora 2 Pro anspruchsvollere multimodale Eingabeverarbeitungsfunktionen hinzufügen könnte. Da jedes Modell die Stärken des anderen integriert, werden die Unterschiede zwischen ihnen subtiler werden.

Ihre Entscheidung treffen

Die Wahl zwischen Seedance 2.0 und Sora 2 Pro hängt letztendlich von Ihren spezifischen Produktionsanforderungen, Budgetbeschränkungen und Workflow-Präferenzen ab. Berücksichtigen Sie die folgenden Entscheidungsfaktoren:

Wählen Sie Seedance 2.0, wenn:

- Sie eine hochauflösende Ausgabe (2K) für professionelle Displays oder Werbung benötigen.

- Sie multimodale Referenzfunktionen mit spezifischen Stilen, Bewegungen oder Audio-Vorlagen benötigen.

- Sie eine großflächige, kosteneffiziente Produktion mit hohen Erfolgsquoten anstreben.

- Sie eine native Audio-Video-Synchronisation mit Beat-Matching-Fähigkeiten benötigen.

- Sie mehrere Variationen von Markeninhalten mit einer konsistenten visuellen Identität erstellen.

- Sie eine schnelle Iteration mit minimaler Nachbearbeitung wünschen.

Wählen Sie Sora 2 Pro, wenn:

- Sie eine verlängerte Dauer (bis zu 25 Sekunden) für komplette narrative Sequenzen benötigen.

- Sie überlegenen physikalischen Realismus für komplexe Dynamiken und Umweltinteraktionen priorisieren.

- Sie sich auf längerfristiges Storytelling in einzelnen Generierungen konzentrieren.

- Eine Integration in bestehende ChatGPT Pro-Workflows erforderlich ist.

- Sie maximale Qualität für Szenarien suchen, die realistische physikalische Simulationen beinhalten.

Erwägen Sie eine Multi-Modell-Plattform, wenn:

- Sie die Flexibilität benötigen, für jedes spezifische Projekt das optimale Modell zu wählen.

- Sie auf beide Modelle zugreifen möchten, ohne separate Abonnements zu führen.

- Sie die Ergebnisse vor der Entscheidung für die endgültigen Renderings direkt vergleichen möchten.

- Sie eine umfassende Tool-Suite benötigen, die sowohl Video- als auch Bildgenerationsfunktionen umfasst.

Fazit: Zwei Wege zur Exzellenz

Seedance 2.0 und Sora 2 Pro repräsentieren zwei unterschiedliche Philosophien der KI-Videogenerierung. Seedance 2.0 ist auf kreative Kontrolle optimiert und bietet beispiellose multimodale Eingabefähigkeiten, mit denen Sie dem Modell genau zeigen können, was Sie wollen, anstatt es nur mit Worten zu beschreiben. Dieser Ansatz, kombiniert mit nativer 2K-Auflösung und kosteneffizienter Preisgestaltung, macht es ideal für Produktions-Workflows, die Konsistenz, Effizienz und kreative Kontrolle erfordern.

Sora 2 Pro priorisiert physikalischen Realismus und Weltsimulation und glänzt in Szenarien, in denen präzise Physik und eine verlängerte narrative Dauer am wichtigsten sind. Mit seiner maximalen Dauer von 25 Sekunden und seiner überlegenen Handhabung komplexer Dynamiken bleibt es der Goldstandard für filmischen Realismus.

Keines der Modelle ist dem anderen universell überlegen; jedes spezialisiert sich auf unterschiedliche Dimensionen. Die beste Wahl hängt von Ihrem spezifischen Anwendungsfall, Ihren Produktionsanforderungen und Budgetbeschränkungen ab. Für viele Kreative und Produktionsteams ist die optimale Lösung der Zugang zu beiden Modellen über eine vereinheitlichte Plattform, die es Ihnen ermöglicht, das richtige Werkzeug für jede spezifische Aufgabe zu wählen.

Während die KI-Videogenerierung ihre rasante Entwicklung fortsetzt, werden beide Modelle ihre Fähigkeiten weiter verfeinern und ausbauen. Der Wettbewerb zwischen diesen führenden Ansätzen fördert Innovationen, die der gesamten kreativen Gemeinschaft zugutekommen. Egal, ob Sie sich für die multimodale Steuerung von Seedance 2.0, den physikalischen Realismus von Sora 2 Pro oder beides über eine Multi-Modell-Plattform entscheiden – Sie arbeiten mit der fortschrittlichsten KI-Videogenerierungstechnologie, die im Jahr 2026 verfügbar ist.

Die Zukunft der Videoproduktion ist da, und sie ist zugänglicher, leistungsstärker und kreativer als je zuvor.