O cenário da geração de vídeo por IA atingiu um ponto de inflexão crítico no início de 2026. Após anos de melhorias incrementais, agora temos modelos de produção capazes de gerar áudio sincronizado em conjunto com o vídeo, manter a consistência dos personagens entre os cortes e seguir instruções criativas complexas com uma precisão impressionante. Entre os principais competidores, dois modelos se destacam pelas suas capacidades avançadas e prontidão para produção: o Seedance 2 da ByteDance e o Wan 2.6 do ecossistema Alibaba.

Esta comparação abrangente examina as especificações técnicas, os conjuntos de funcionalidades, o desempenho no mundo real e as aplicações práticas de ambos os modelos. Analisamos dados de benchmark, feedback da comunidade e testes práticos para informar criadores, profissionais de marketing e equipas de produção sobre qual o modelo que melhor se adapta às suas necessidades específicas.

Resumo Executivo: Principais Diferenças Num Relance

Antes de mergulhar na análise detalhada, eis o que separa estes dois modelos líderes da indústria:

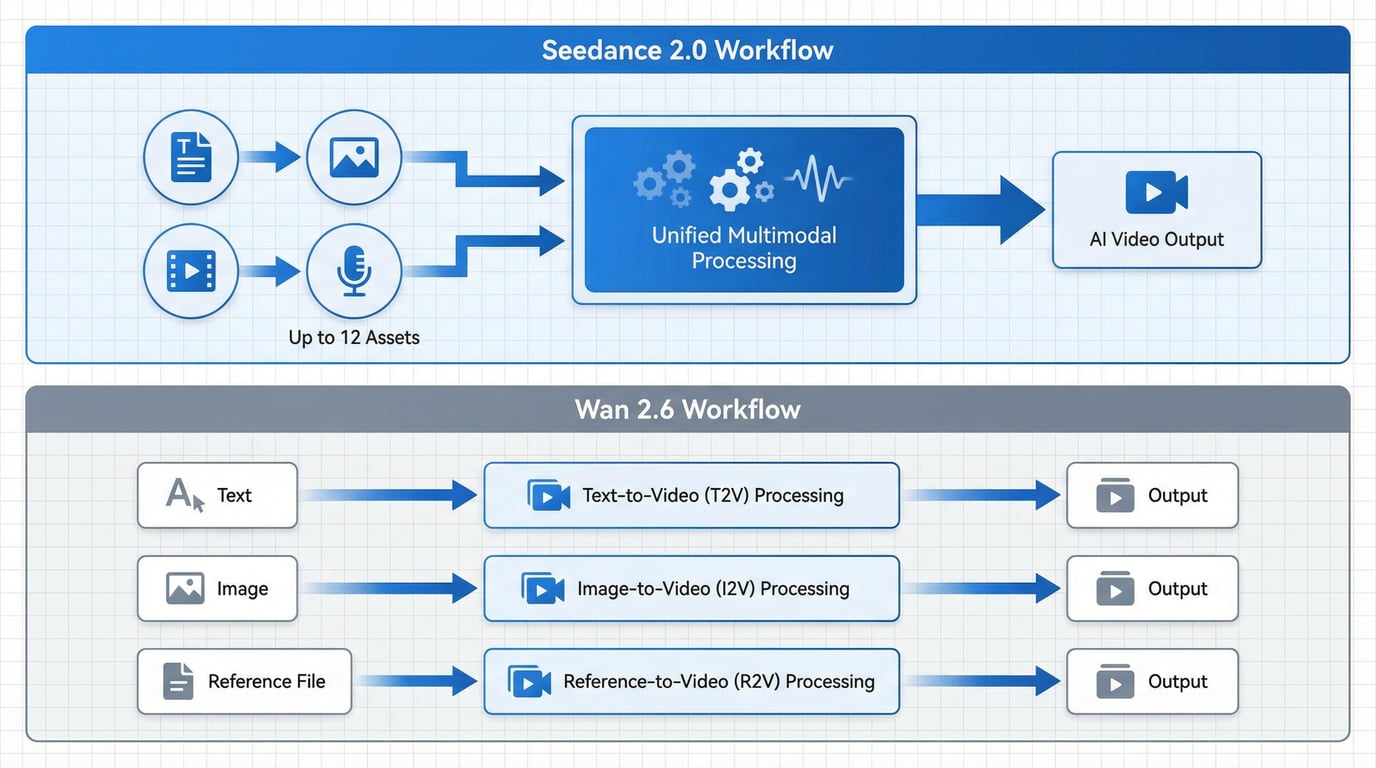

O Seedance 2 destaca-se no controlo de referência multimodal, na narrativa cinematográfica e na sincronização audiovisual natural. O modelo pode aceitar até 12 ativos de entrada diferentes simultaneamente (incluindo imagens, vídeos, ficheiros de áudio e comandos de texto) e sintetizá-los numa sequência narrativa coerente. Isto torna o Seedance 2 particularmente poderoso para projetos criativos complexos que requerem um controlo preciso sobre múltiplos elementos visuais e auditivos.

O Wan 2.6 prioriza fluxos de trabalho de produção estruturados, repetibilidade e suporte de formatos práticos com três vias de geração dedicadas: Text-to-Video (T2V), Image-to-Video (I2V) e Reference-to-Video (R2V). Cada via é otimizada para casos de uso específicos, oferecendo restrições de produção claras e resultados previsíveis. O Wan 2.6 também beneficia da disponibilidade em código aberto e de amplas opções de integração de API.

Especificações Técnicas: A Base do Desempenho

Compreender as capacidades técnicas de cada modelo fornece o contexto essencial para avaliar a sua aplicação no mundo real.

Resolução e Qualidade de Saída

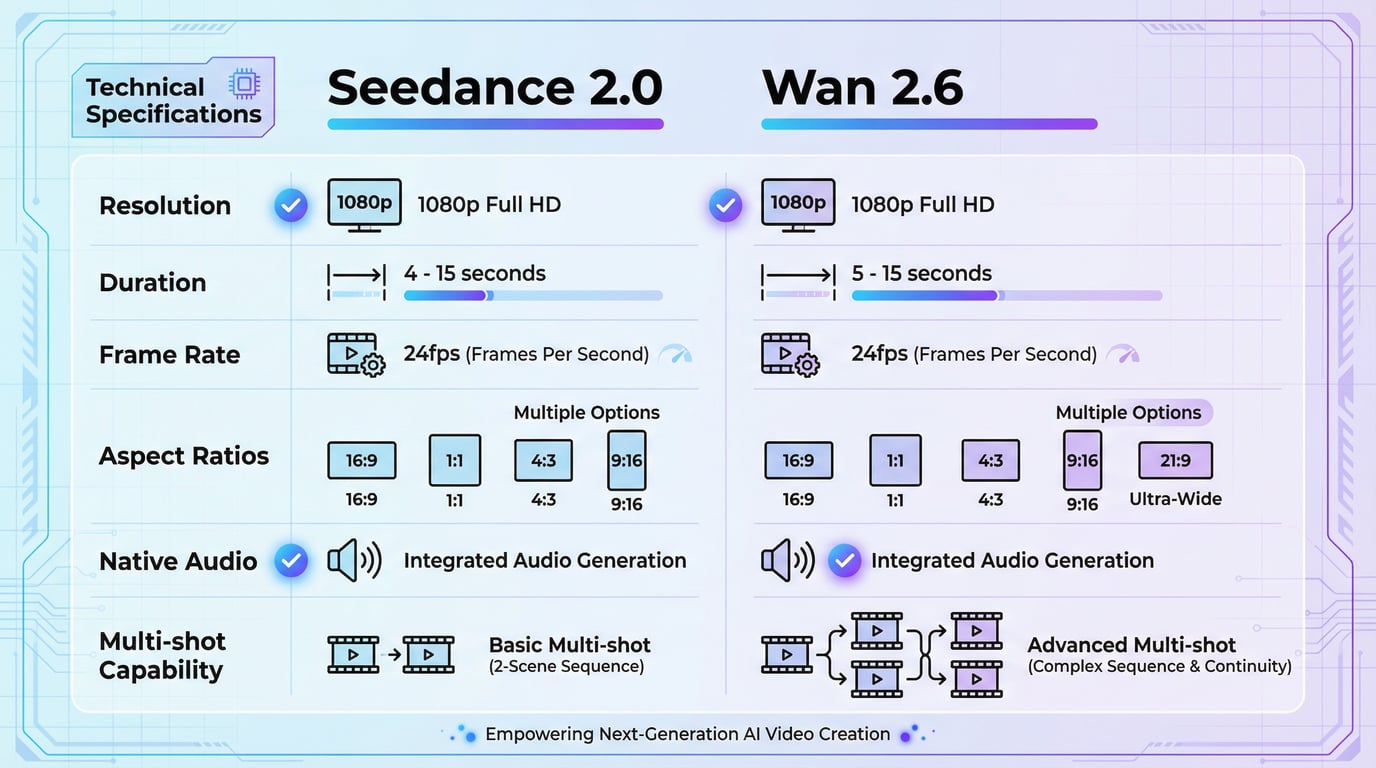

Ambos os modelos oferecem uma saída de nível profissional adequada para distribuição comercial:

| Especificação | Seedance 2 | Wan 2.6 |

|---|---|---|

| Resolução Máxima | Até 1080p | Até 1080p |

| Taxa de Frames | 24 fps | 24 fps |

| Intervalo de Duração | 4-15 segundos | 5-15 segundos |

| Relações de Aspeto | 16:9, 9:16, 4:3, 3:4, 21:9, 1:1 | 16:9, 9:16, 1:1 (conforme o modo) |

| Áudio Nativo | Sim, sincronizado | Sim, sincronizado |

| Capacidade Multi-shot | Sim, com transições naturais | Sim, com divisão de cena |

Ambos os modelos produzem ficheiros com resolução de 1080p e uma taxa de 24 fotogramas por segundo, o que representa o padrão atual da indústria para conteúdos de vídeo gerados por IA. Embora alguns concorrentes como o Kling 3.0 comecem a aventurar-se no território do 4K nativo, a saída de 1080p do Seedance 2 e do Wan 2.6 permanece pronta para produção para a grande maioria das aplicações comerciais, incluindo redes sociais, publicidade e conteúdos web.

Arquitetura e Design do Modelo

As diferenças arquitetónicas entre estes dois modelos impactam significativamente o seu comportamento e os casos de uso ideais.

O Seedance 2 utiliza uma arquitetura de geração conjunta de áudio e vídeo multimodal unificada. Este design permite ao modelo processar simultaneamente texto, imagens, referências de vídeo e entradas de áudio dentro de um único pipeline de geração. A arquitetura de ramificação dupla melhora especificamente a precisão da sincronização labial (lip-sync) e a renderização de micro-expressões, tornando-o excecionalmente eficaz para conteúdos focados em diálogos e performances emocionais.

O Wan 2.6 utiliza uma arquitetura modular com três vias de geração distintas. As vias T2V, I2V e R2V são otimizadas independentemente para os seus respetivos tipos de entrada. Esta separação oferece restrições de produção mais claras e um comportamento mais previsível, beneficiando equipas que requerem resultados consistentes e repetíveis na produção de conteúdos em larga escala. A via R2V, em particular, representa um avanço importante na manutenção da consistência dos personagens em múltiplos planos.

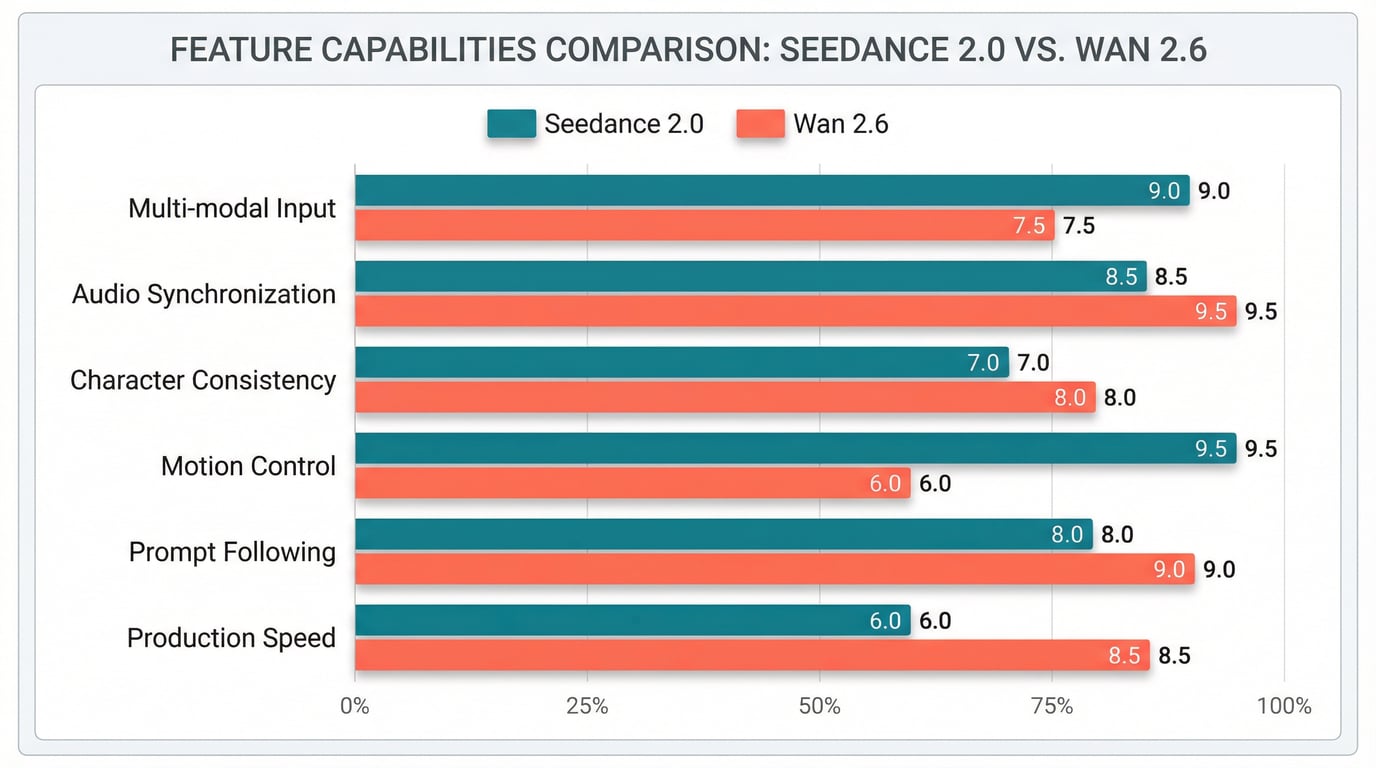

Comparação de Funcionalidades: As Capacidades que Importam

Processamento de Entradas Multimodais

Este é um dos pontos de diferenciação mais significativos entre os dois modelos.

O Seedance 2 suporta uma entrada multimodal abrangente, capaz de aceitar até 12 ativos diferentes num único pedido de geração. Os utilizadores podem fornecer simultaneamente imagens de referência para o estilo visual, clipes de vídeo para o movimento e enquadramento, faixas de áudio para o ritmo e tempo, e comandos de texto detalhados para orientação narrativa. O modelo utiliza um sistema de @menções em linguagem natural para especificar como cada ativo carregado deve ser utilizado na saída final.

Esta capacidade multimodal permite um controlo criativo sem precedentes. Por exemplo, um criador pode referenciar a cinematografia de um filme específico através de um clipe de vídeo, aplicar a gradação de cor de uma fotografia, sincronizar o ritmo com uma faixa musical e dirigir a narrativa através de texto — tudo numa única geração.

O Wan 2.6 adota uma abordagem mais estruturada com três endpoints dedicados. A via Text-to-Video lida com a geração baseada puramente em comandos com uma extensão de comando melhorada baseada em LLM que preserva o contexto narrativo através dos cortes; a via Image-to-Video foca-se na coerência da ação ao animar imagens estáticas; e a via Reference-to-Video aborda especificamente o desafio da coerência do personagem, permitindo aos criadores estabilizar a identidade do sujeito em múltiplos clipes gerados.

Embora a abordagem do Wan 2.6 ofereça menos flexibilidade de entrada simultânea do que o Seedance 2, as suas vias dedicadas fornecem uma orientação mais clara e saídas mais previsíveis para cenários de produção específicos.

Sincronização Audiovisual

Ambos os modelos geram áudio nativo em conjunto com o vídeo, eliminando a necessidade de trabalho de áudio em pós-produção — uma melhoria importante no fluxo de trabalho em comparação com os primeiros modelos de vídeo por IA.

O Seedance 2 demonstra uma força extraordinária na precisão da sincronização labial e no desempenho de áudio emocional. A arquitetura de ramificação dupla processa o áudio e o vídeo em paralelo, permitindo uma sincronização precisa ao nível do frame do diálogo, das expressões faciais e do movimento da boca. O feedback da comunidade destaca frequentemente os "momentos Seedance", onde a sincronização audiovisual atinge uma qualidade quase fotorrealista, particularmente em cenas de diálogo em grande plano e performances emocionais.

O modelo gera diálogos, sons ambientes e efeitos sonoros em tempo real que correspondem ao conteúdo visual frame a frame. Esta abordagem integrada resulta numa animação movida a voz natural que parece cinematográfica em vez de sintética, tornando-a extremamente valiosa para conteúdos narrativos, histórias baseadas em personagens e qualquer aplicação que requeira interações humanas credíveis.

O Wan 2.6 também oferece sincronização audiovisual nativa com capacidades precisas de lip-sync. O modelo integra a sincronização labial e o tempo do diálogo ao nível da geração, criando uma animação movida a voz natural adequada para aplicações profissionais. Embora o Wan 2.6 tenha um bom desempenho nesta área, testes comparativos sugerem que é mais adequado para publicidade e cenários de conteúdos estruturados do que para as cenas de diálogo extremo em grande plano onde o Seedance 2 brilha.

Controlo de Movimento e Precisão Física

O movimento realista e a simulação física são as marcas que separam o vídeo por IA de nível profissional dos conteúdos sintéticos óbvios.

O Seedance 2 apresenta uma forte precisão física, com objetos que caem, colidem e interagem seguindo as regras do mundo real. Gere movimentos de câmara complexos, incluindo dolly zooms, rack focus, planos de acompanhamento (tracking shots), mudanças de POV e movimentos fluidos de câmara na mão. Sequências de ação — incluindo lutas, perseguições de carros, explosões e destroços a cair — são renderizadas com um comportamento físico e uma coerência de movimento convincentes.

Comparações da comunidade referem que o Seedance gere particularmente bem cenários realistas, com uma análise a apelidá-lo de "diretor de documentários competente", onde o realismo é a sua força tradicional. O modelo destaca-se nos movimentos corporais e expressões naturais, embora alguns utilizadores relatem casos ocasionais de duplicação de personagens em cenas complexas.

O Wan 2.6 oferece uma coerência de movimento melhorada em comparação com o seu predecessor Wan 2.5, com uma força particular na manutenção da continuidade narrativa dentro de sequências multi-shot. O processamento de comandos foi especificamente melhorado para reter o contexto através das mudanças de cena, reduzindo a necessidade de engenharia manual de comandos ao criar sequências multi-cena.

Personagem e Coerência Visual

Manter uma aparência de personagem consistente em múltiplos planos e cenas é um desafio crítico na geração de vídeo por IA.

O Seedance 2 teve uma melhoria significativa na coerência global para rostos, roupas, texto, cenas e estilos visuais. O modelo mantém uma aparência de personagem estável entre frames e planos, resolvendo problemas comuns de deriva do personagem (character drift), inconsistência de estilo e perda de detalhes frequentes no vídeo por IA. O sistema de referência multimodal permite aos criadores fixar a aparência de um personagem específico utilizando imagens de referência enquanto alteram outros aspetos da cena.

O Wan 2.6 aborda especificamente o desafio da coerência através da sua via Reference-to-Video (R2V). Este modo dedicado foca-se na coerência do sujeito, permitindo aos criadores manter a identidade do personagem em múltiplos clipes gerados. A via R2V representa uma das melhorias mais significativas do Wan 2.6 em relação ao Wan 2.5, atacando diretamente a principal dor que impedia a adoção generalizada de ferramentas de vídeo por IA em ambientes de produção profissional.

Fidelidade ao Comando e Obediência a Instruções

A capacidade de interpretar e executar com precisão instruções criativas complexas determina o número de iterações manuais necessárias para atingir o resultado pretendido.

O Seedance 2 enfatiza o cumprimento detalhado de instruções, particularmente para cenas que requerem múltiplos sujeitos, ações e sinais de câmara simultaneamente. O modelo compreende e executa comandos complexos com precisão, e o sistema de controlo em linguagem natural permite aos criadores descrever intuitivamente como as referências devem ser usadas. Quanto mais detalhado for o comando — incluindo ângulos de câmara específicos, tempos e instruções de referência — mais precisa será a saída.

O Wan 2.6 oferece uma conformidade de instruções mais forte do que o Wan 2.5, com um processamento de comandos melhorado que preserva melhor o contexto narrativo entre os cortes. O sistema de extensão de comando baseado em LLM foi refinado para eliminar fricções ao criar sequências multi-cena. Esta melhoria torna o Wan 2.6 mais acessível a utilizadores que não tenham vasta experiência na escrita de comandos de IA ideais.

Benchmarks de Desempenho: Resultados de Testes no Mundo Real

Testes da comunidade e comparações de benchmark fornecem informações valiosas sobre como estes modelos funcionam em vários cenários.

Ranking da Artificial Analysis

No Artificial Analysis, uma plataforma que classifica geradores de vídeo por voto público em vez de métricas internas, o Seedance 1.0 obteve o primeiro lugar tanto para a geração Text-to-Video como Image-to-Video, superando o Veo 3, Kling 2.0, Sora da OpenAI, Runway Gen4 e Wan 2.1. Embora estes rankings precedam o lançamento do Wan 2.6, eles estabelecem a forte posição do Seedance no cenário de vídeo IA em geral.

Desempenho por Cenário

Testes de desempenho comparativo em cenários específicos revelam forças distintas:

Cenas de multidão e movimento em larga escala: O Seedance apresenta um forte desempenho na gestão de comportamentos de multidão realistas e movimentos em larga escala, embora ocasionalmente possa adicionar uma ligeira deriva da câmara (que pode ser corrigida com ajustes no comando). O Wan 2.6 é aceitável para pequenas cenas de multidão, mas apresenta artefactos em cenas densas.

Ação e efeitos: Para sequências de ação dinâmica, como explosões ou fogo, e efeitos visuais, o Seedance mostra uma forte simulação de fumo e tempo, embora a iluminação possa ser ocasionalmente demasiado brilhante. O Wan 2.6 demonstra capacidades em sequências de ação estruturadas, mas pode mostrar instabilidade em cenários extremos.

Animação de personagens: O Seedance destaca-se em movimentos corporais e expressões naturais com uma qualidade de lip-sync excecional, particularmente para conteúdos ricos em diálogos. O Wan 2.6 fornece uma animação de personagem sólida adequada para publicidade e conteúdos estruturados, com a via R2V a resolver especificamente a necessidade de coerência do personagem.

Velocidade de Geração

É reportado que o Seedance 2 é 30% mais rápido do que o seu predecessor Seedance 1.5, com gerações que normalmente terminam em poucos minutos, dependendo da complexidade e duração. O feedback da comunidade considera o Seedance 1.5 como o líder de velocidade entre os principais modelos, sugerindo que o Seedance 2 mantém tempos de geração muito competitivos.

O Wan 2.6 atinge velocidades de geração rápidas, particularmente quando acedido através de plataformas otimizadas. As gerações demoram normalmente entre 1 a 3 minutos, dependendo do comprimento e complexidade do vídeo. A abordagem de vias estruturadas contribui provavelmente para tempos de processamento previsíveis nos diferentes modos de geração.

Aplicações Práticas: Qual o Modelo para Qual Caso de Uso

A escolha do melhor modelo depende dos requisitos de produção específicos, do tipo de conteúdo e das restrições do fluxo de trabalho.

O Seedance 2 é ideal para:

Conteúdos Narrativos e Cinematográficos: O sistema de referência multimodal e a sincronização audiovisual superior tornam o Seedance 2 ideal para aplicações de storytelling que requerem profundidade emocional, narrativas baseadas em personagens e qualidade cinematográfica. Cineastas que criam storyboards, sequências de prova de conceito ou cenas de atmosfera podem beneficiar da capacidade do modelo de sintetizar múltiplas referências criativas numa narrativa visual coerente.

Conteúdos Ricos em Diálogos: A precisão superior do lip-sync e a renderização de micro-expressões da arquitetura de ramificação dupla tornam-no na primeira escolha para conteúdos que envolvem diálogos humanos, expressões emocionais e interações de personagens em grande plano. Criadores de conteúdos educativos, produtores de vídeos explicativos e qualquer pessoa que crie conteúdos conversacionais considerarão esta capacidade imensamente valiosa.

Projetos Multi-referência Complexos: Quando um projeto requer sintetizar inspiração de múltiplas fontes — como combinar a cinematografia de uma referência, o esquema de cores de outra, o ritmo de uma faixa musical e um comando narrativo detalhado — a capacidade do Seedance 2 de aceitar até 12 ativos de entrada simultâneos oferece um nível de controlo criativo inigualável.

Conteúdos Realistas de Estilo Documental: Testes da comunidade citam consistentemente o realismo como a força tradicional do Seedance, tornando-o particularmente adequado para conteúdos de estilo documental, cenários realistas e qualquer aplicação onde a autenticidade e o movimento natural sejam primordiais.

O Wan 2.6 é ideal para:

Marketing Estruturado e Publicidade: As três vias de geração dedicadas oferecem restrições de produção claras e fluxos de trabalho repetíveis, ideais para equipas de marketing que produzem conteúdos de marca consistentes. A abordagem estruturada garante saídas previsíveis através das campanhas, tornando o Wan 2.6 uma escolha padrão mais segura para ambientes de produção repetitivos.

Requisitos de Coerência de Personagem: A via Reference-to-Video (R2V) aborda especificamente o desafio de manter a identidade do personagem em múltiplos clipes. Conteúdos com mascotes, séries com personagens recorrentes ou qualquer aplicação que requeira uma aparência de personagem consistente em vários vídeos beneficiarão desta capacidade dedicada.

Campanhas Narrativas Multi-shot: As fortes capacidades multi-shot do Wan 2.6 suportam uma narrativa coerente entre as cenas, adequadas para filmes de marca, séries de conteúdos educativos e campanhas de vídeo estruturadas que precisam de manter a continuidade narrativa em múltiplos segmentos.

Integração de Programadores e Fluxos de Trabalho API: A disponibilidade em código aberto do Wan 2.6 e as amplas opções de integração de API tornam-no extremamente atraente para programadores que incorporam a geração de vídeo em aplicações, para plataformas que requerem implementação no local e para equipas que precisam de personalizar o comportamento do modelo para casos de uso específicos.

Produções Conscientes do Orçamento: A natureza em código aberto do Wan 2.6 e o preço competitivo da API tornam-no numa escolha económica para fluxos de trabalho de produção de alto volume, onde o custo por vídeo é uma consideração importante.

Acesso aos Modelos: Disponibilidade em Plataformas

Ambos os modelos são acessíveis através de múltiplas plataformas, embora a disponibilidade varie por região e método de acesso.

O Seedance 2 está atualmente disponível na China com um lançamento global previsto para o segundo trimestre de 2026. O modelo pode ser acedido através de vários fornecedores de API e plataformas que integraram as capacidades de geração de vídeo da ByteDance. Para criadores e empresas que procuram experimentar as capacidades avançadas do Seedance 2 imediatamente, o Seedance 2.0 oferece uma porta de entrada conveniente para as suas funcionalidades de geração multimodal.

O Wan 2.6 goza de uma disponibilidade mais ampla devido à sua natureza em código aberto e integração em inúmeras plataformas. O modelo está disponível através de múltiplos fornecedores de API, plataformas de programadores e integrações de terceiros. Os criadores podem aceder-lhe através do Wan 2.6, que fornece acesso simplificado a todas as três vias de geração (T2V, I2V, R2V) dentro de uma interface unificada.

A plataforma SeaDanceAI oferece acesso a múltiplos modelos de ponta de geração de vídeo e imagem, dando aos criadores a flexibilidade de escolher o melhor modelo para cada projeto específico sem terem de gerir múltiplas integrações separadas. Este ponto de acesso unificado simplifica a gestão do fluxo de trabalho para equipas que lidam com diversos tipos de conteúdo e requisitos de produção.

O Cenário Competitivo Mais Amplo

Embora esta comparação se foque no Seedance 2 e no Wan 2.6, é útil compreender a sua posição em relação a outros modelos importantes.

O Kling 3.0 da Kuaishou oferece 4K/60fps nativo e capacidades integradas de storyboarding multi-shot, representando a opção de resolução mais elevada atualmente disponível. No entanto, isto vem acompanhado de um preço premium que pode ser excessivo para muitos cenários de produção onde a saída de 1080p é suficiente.

O Veo 3.1 da Google DeepMind lidera os modelos fechados com o pacote de áudio mais abrangente, incluindo diálogo, foley, ambiente e consciência musical numa única geração. O Veo 3.1 também oferece uma saída 4K real, embora o acesso permaneça limitado pelo processo de lançamento controlado da Google.

O Sora 2 da OpenAI atinge uma precisão física superior e uma geração de áudio abrangente, estabelecendo o teto da qualidade em muitas dimensões. No entanto, o acesso permanece restrito e o preço para uso comercial ainda não foi tornado público.

Neste cenário competitivo, o Seedance 2 e o Wan 2.6 distinguem-se pela utilidade prática imediata, qualidade de nível de produção e propostas de valor claras para casos de uso específicos. Nenhum deles tenta ser o "melhor" em todas as dimensões; em vez disso, cada um sobressai onde é relevante para diferentes necessidades de produção.

Estrutura de Decisão: Escolher o Seu Modelo

Em vez de declarar um único "vencedor", o mercado maduro de vídeo por IA em 2026 exige a correspondência entre as forças do modelo e os requisitos de produção específicos.

Escolha o Seedance 2 se:

-

A qualidade da sincronização audiovisual é crítica

-

O projeto requer sintetizar múltiplas referências criativas

-

O diálogo, a emoção e a performance do personagem estão no centro do conteúdo

-

A qualidade cinematográfica e a narrativa atmosférica são prioridades

-

Necessita de lip-sync e micro-expressões da mais alta qualidade

-

O seu foco é em conteúdos realistas de estilo documental

Escolha o Wan 2.6 se:

-

Um fluxo de trabalho de produção repetível e consistente é essencial

-

É necessária coerência de personagem em múltiplos clipes

-

Está a produzir conteúdos de marketing ou publicidade estruturados

-

A integração de programador e a flexibilidade da API são prioridades

-

Restrições orçamentais favorecem opções em código aberto

-

A sua equipa valoriza vias de produção claras e saídas previsíveis

Considere usar ambos se:

-

Produz diversos tipos de conteúdo que aproveitam as forças de cada modelo

-

Quer testar dinamicamente diferentes desempenhos de modelos para o mesmo brief criativo

-

O seu volume de produção justifica a manutenção de múltiplas integrações de ferramentas

-

Diferentes membros da equipa têm diferentes níveis de competência e preferências de fluxo de trabalho

O Futuro da Geração de Vídeo por IA

Os rápidos avanços do Seedance 1.0 para o Seedance 2 e do Wan 2.5 para o Wan 2.6 demonstram o ritmo acelerado de inovação na geração de vídeo por IA. Estão a emergir várias tendências que moldarão a próxima geração de ferramentas:

O aumento da resolução e das taxas de frames continuará a empurrar o 4K e os 60fps para saídas padrão em vez de funcionalidades premium. Embora os atuais 1080p/24fps satisfaçam a maioria das necessidades, a trajetória é clara.

A extensão da duração está a ultrapassar o limite atual de 15 segundos. Gerar conteúdos de longa duração continua a ser um desafio em termos de requisitos computacionais e manutenção da coerência, mas melhorias incrementais surgem a cada iteração de modelo.

Interfaces de controlo melhoradas estão a evoluir de comandos de texto e imagens de referência para sistemas de direção criativa mais intuitivos. O sistema de @menções em linguagem natural do Seedance 2 é um exemplo; as iterações futuras irão provavelmente integrar mecanismos de controlo ainda mais sofisticados.

A integração de fluxos de trabalho de produção está a tornar-se cada vez mais vital à medida que estas ferramentas passam de novidades experimentais para uma infraestrutura de produção indispensável. A fiabilidade das API, as capacidades de processamento em lote e a integração com software criativo existente irão diferenciar as ferramentas de nível profissional das aplicações de consumo.

Conclusão: O Vídeo por IA Pronto para Produção Chegou

A comparação entre o Seedance 2 e o Wan 2.6 revela uma verdade fundamental sobre o estado atual da geração de vídeo por IA: já ultrapassámos a questão de saber se a IA pode criar vídeos profissionais para entrar na fase mais matizada de saber qual a ferramenta especializada que melhor serve as necessidades criativas específicas.

O Seedance 2 representa a vanguarda do controlo criativo multimodal e da qualidade cinematográfica, com um desempenho excecionar na sincronização audiovisual, na performance emocional e na síntese de referências complexas. A sua arquitetura unificada e a capacidade de processar até 12 entradas simultâneas oferecem uma flexibilidade criativa sem precedentes para conteúdos narrativos e baseados em personagens.

O Wan 2.6 fornece um fluxo de trabalho de produção estruturado e repetível através de vias de geração dedicadas otimizadas para casos de uso específicos. A sua capacidade de referência para vídeo responde à necessidade crítica de coerência de personagens, enquanto a sua natureza em código aberto e amplas opções de integração de API o tornam extremamente atraente para programadores e equipas de produção conscientes do orçamento.

Nenhum dos modelos é universalmente superior; cada um destaca-se em dimensões que importan para diferentes cenários de produção. A abordagem madura consiste em compreender estas forças e fazer corresponder a ferramenta certa a cada projeto específico.

Para os criadores, profissionais de marketing e equipas de produção que navegam neste cenário, o conselho prático é claro: teste ambos os modelos em conteúdos representativos da sua linha de produção real. A diferença na qualidade da saída, na eficiência do fluxo de travail e no controlo criativo tornar-se-á evidente rapidamente, permitindo-lhe tomar decisões informadas baseadas em resultados reais em vez de especificações técnicas.

A revolução da geração de vídeo por IA já não é uma previsão; ela está aqui. Ferramentas como o Seedance 2 e o Wan 2.6 já estão a produzir conteúdos para anúncios comerciais, campanhas em redes sociais, materiais educativos e projetos criativos em todo o mundo. A questão já não é se deve adotar estas ferramentas, mas sim como integrá-las de forma mais eficaz no seu fluxo criativo.

Aceda a ambos os modelos através de plataformas unificadas como o Seedance 2.0 e o Wan 2.6 para experimentar as suas capacidades em primeira mão e encontrar o que melhor servirá a sua visão criativa única.