Il panorama della generazione video tramite Intelligenza Artificiale ha raggiunto un punto di svolta critico all'inizio del 2026. Dopo anni di miglioramenti incrementali, disponiamo ora di modelli di produzione in grado di generare audio sincronizzato insieme al video, mantenere la coerenza dei personaggi tra le inquadrature e seguire istruzioni creative complesse con una precisione sbalorditiva. Tra i principali contendenti, due modelli si distinguono per le loro capacità avanzate e la prontezza per l'uso professionale: Seedance 2 di ByteDance e Wan 2.6 dell'ecosistema Alibaba.

Questo confronto completo esamina le specifiche tecniche, il set di funzionalità, le prestazioni nel mondo reale e le applicazioni pratiche di entrambi i modelli. Abbiamo analizzato i dati dei benchmark, i feedback della comunità e i test sul campo per informare creatori, esperti di marketing e team di produzione su quale modello si adatti meglio alle loro specifiche esigenze.

Sintesi operativa: Le differenze chiave a colpo d'occhio

Prima di immergerci nell'analisi dettagliata, ecco cosa separa questi due modelli leader del settore:

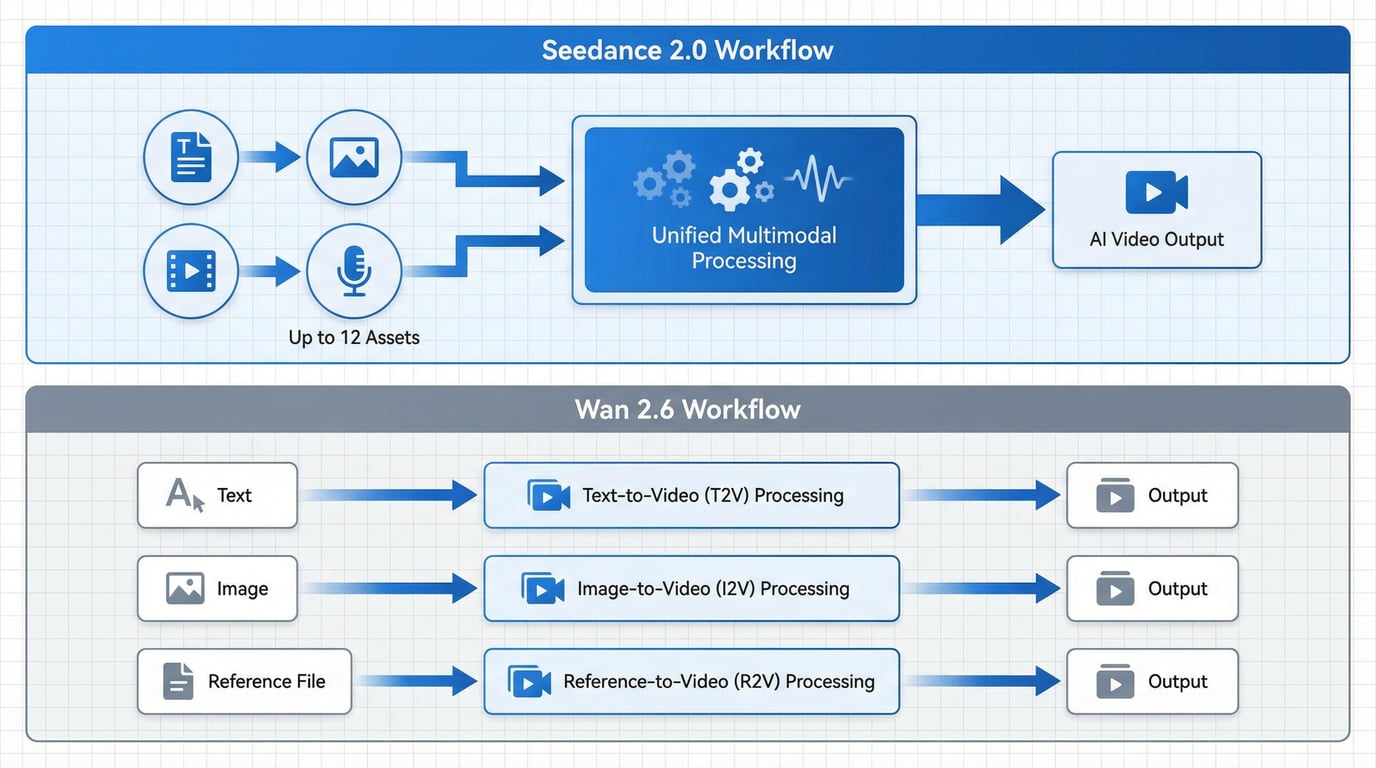

Seedance 2 eccelle nel controllo multimodale dei riferimenti, nella narrazione cinematografica e nella sincronizzazione audiovisiva naturale. Il modello può accettare fino a 12 diversi asset di input simultaneamente (inclusi immagini, video, file audio e prompt testuali) e sintetizzarli in una sequenza narrativa coerente. Ciò rende Seedance 2 particolarmente potente per progetti creativi complessi che richiedono un controllo preciso su molteplici elementi visivi e uditivi.

Wan 2.6 privilegia flussi di produzione strutturati, riproducibilità e supporto di formati pratici con tre percorsi di generazione dedicati: Text-to-Video (T2V), Image-to-Video (I2V) e Reference-to-Video (R2V). Ogni percorso è ottimizzato per casi d'uso specifici, offrendo vincoli di produzione chiari e output prevedibili. Wan 2.6 beneficia anche della disponibilità open-source e di ampie opzioni di integrazione API.

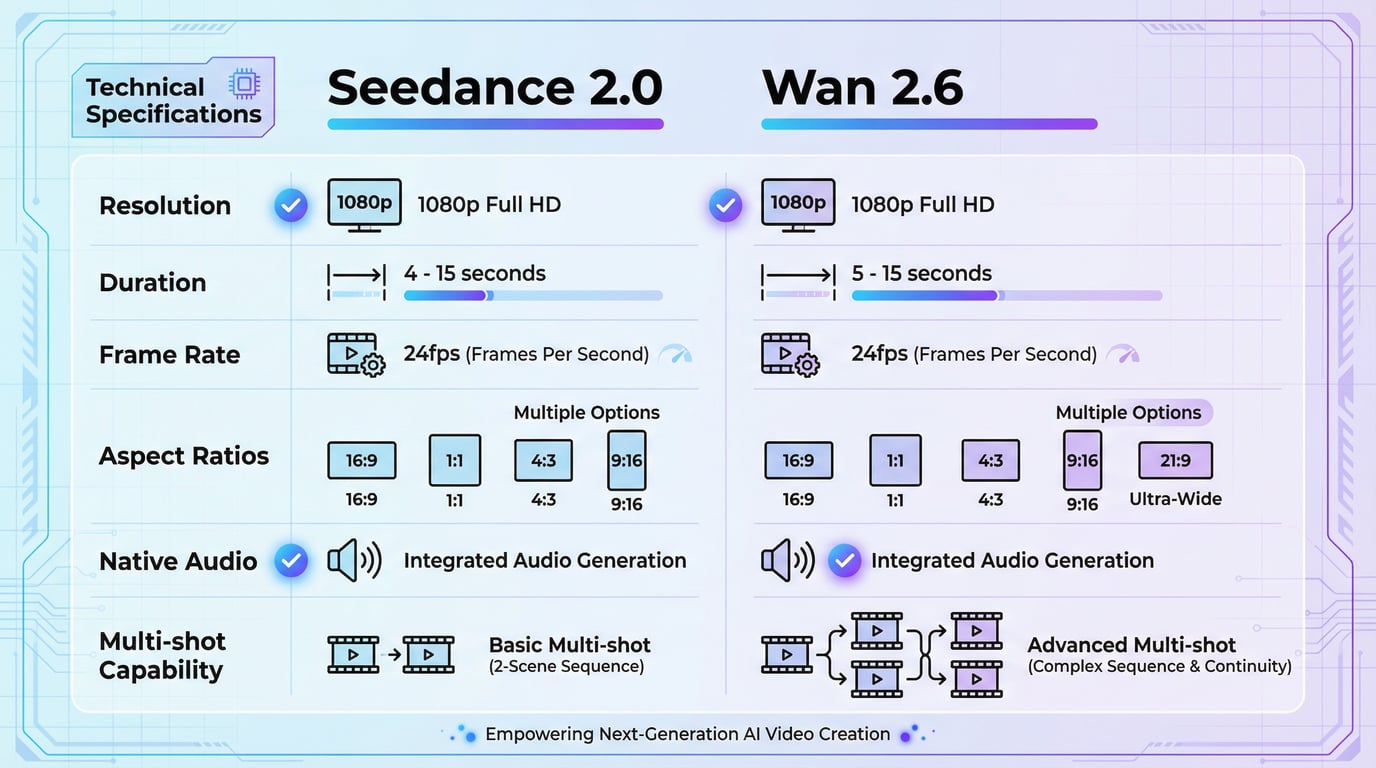

Specifiche tecniche: La base delle prestazioni

Comprendere le capacità tecniche di ciascun modello fornisce il contesto essenziale per valutarne l'applicazione nel mondo reale.

Risoluzione e qualità dell'output

Entrambi i modelli offrono output di livello professionale adatti alla distribuzione commerciale:

| Specifica | Seedance 2 | Wan 2.6 |

|---|---|---|

| Risoluzione massima | Fino a 1080p | Fino a 1080p |

| Frame rate | 24 fps | 24 fps |

| Durata | 4-15 secondi | 5-15 secondi |

| Rapporti d'aspetto | 16:9, 9:16, 4:3, 3:4, 21:9, 1:1 | 16:9, 9:16, 1:1 (secondo la modalità) |

| Audio nativo | Sì, sincronizzato | Sì, sincronizzato |

| Capacità multi-scatto | Sì, con transizioni naturali | Sì, con divisione scena |

Entrambi i modelli producono file a una risoluzione di 1080p con un frame rate di 24 fotogrammi al secondo, che rappresenta l'attuale standard del settore per i contenuti video generati dall'AI. Mentre alcuni concorrenti come Kling 3.0 iniziano ad avventurarsi nel territorio del 4K nativo, l'output a 1080p di Seedance 2 e Wan 2.6 rimane pronto per la produzione per la stragrande maggioranza delle applicazioni commerciali, inclusi social media, pubblicità e contenuti web.

Architettura e design del modello

Le differenze architettoniche tra questi due modelli influenzano significativamente il loro comportamento e i casi d'uso ottimali.

Seedance 2 utilizza un'architettura di generazione congiunta audio-video multimodale unificata. Questo design consente al modello di elaborare simultaneamente testo, immagini, riferimenti video e input audio all'interno di una singola pipeline di generazione. L'architettura dual-branch migliora specificamente la precisione del lip-sync e la resa delle micro-espressioni, rendendolo eccezionalmente efficace per contenuti incentrati sul dialogo e performance emotive.

Wan 2.6 impiega un'architettura modulare con tre percorsi di generazione distinti. I percorsi T2V, I2V e R2V sono ottimizzati indipendentemente per i rispettivi tipi di input. Questa separazione offre vincoli di produzione più chiari e un comportamento più prevedibile, a vantaggio dei team che richiedono risultati coerenti e ripetibili nella produzione di contenuti su larga scala. Il percorso R2V, in particolare, rappresenta un importante passo avanti nel mantenimento della coerenza dei personaggi attraverso più inquadrature.

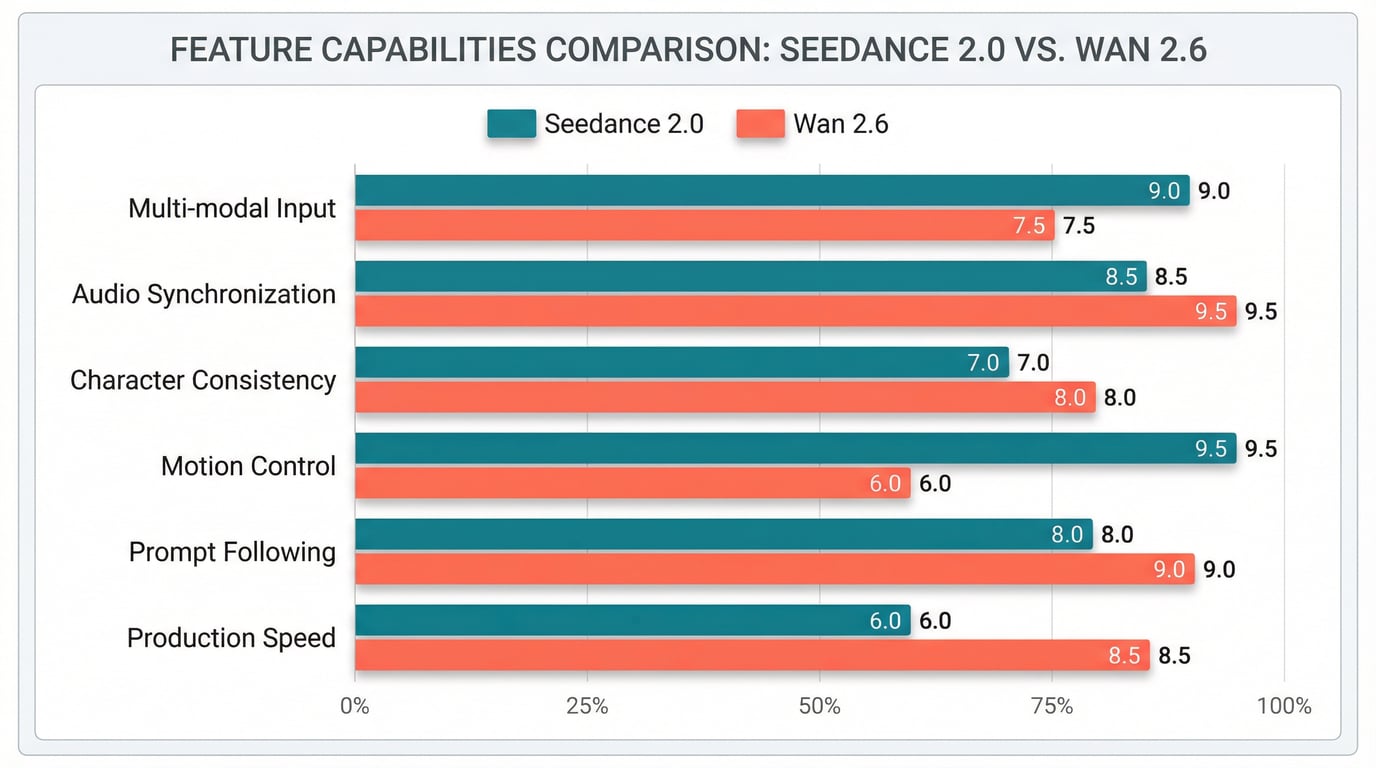

Confronto delle funzionalità: Le capacità che contano

Elaborazione degli input multimodali

Questo è uno dei punti di differenziazione più significativi tra i due modelli.

Seedance 2 supporta un input multimodale completo, in grado di accettare fino a 12 diversi asset in una singola richiesta di generazione. Gli utenti possono fornire contemporaneamente immagini di riferimento per lo stile visivo, clip video per il movimento e l'inquadratura, tracce audio per il ritmo e il tempo, e prompt testuali dettagliati per la guida narrativa. Il modello utilizza un sistema di @menzioni in linguaggio naturale per specificare come ogni asset caricato debba essere utilizzato nell'output finale.

Questa capacità multimodale consente un controllo creativo senza precedenti. Ad esempio, un creatore può fare riferimento alla cinematografia di un film specifico tramite una clip video, applicare il color grading di una fotografia, sincronizzare il ritmo con una traccia musicale e dirigere la narrazione tramite testo — il tutto in un'unica generazione.

Wan 2.6 adotta un approccio più strutturato con tre endpoint dedicati. Il percorso Text-to-Video gestisce la generazione basata su soli prompt con un'estensione dei prompt basata su LLM migliorata che preserva il contesto narrativo attraverso i tagli; il percorso Image-to-Video si concentra sulla coerenza dell'azione quando si animano immagini statiche; e il percorso Reference-to-Video affronta specificamente la sfida della coerenza del personaggio, consentendo ai creatori di stabilizzare l'identità del soggetto attraverso più clip generate.

Sebbene l'approccio di Wan 2.6 offra meno flessibilità di input simultaneo rispetto a Seedance 2, i suoi percorsi dedicati forniscono una guida più chiara e output più prevedibili per scenari di produzione specifici.

Sincronizzazione audiovisiva

Entrambi i modelli generano audio nativo in tandem con il video, eliminando la necessità di post-produzione audio — un importante miglioramento del flusso di lavoro rispetto ai primi modelli video AI.

Seedance 2 dimostra una forza straordinaria nella precisione del lip-sync e nelle prestazioni audio emotive. L'architettura dual-branch elabora audio e video in parallelo, consentendo una sincronizzazione al fotogramma del dialogo, delle espressioni facciali e del movimento della bocca. I feedback della comunità sottolineano spesso i "momenti Seedance" in cui la sincronizzazione audiovisiva raggiunge una qualità quasi fotorealistica, specialmente in scene di dialogo in primo piano e performance emotive.

Il modello genera dialoghi, suoni ambientali ed effetti sonori in tempo reale che corrispondono al contenuto visivo fotogramma per fotogramma. Questo approccio integrato si traduce in un'animazione naturale guidata dalla voce che appare cinematografica piuttosto che sintetica, rendendola estremamente preziosa per contenuti narrativi, storie guidate dai personaggi e qualsiasi applicazione che richieda interazioni umane credibili.

Wan 2.6 offre anche una sincronizzazione audiovisiva nativa con capacità di lip-sync precise. Il modello integra il lip-sync e il timing del dialogo a livello di generazione, creando un'animazione vocale naturale adatta ad applicazioni professionali. Sebbene Wan 2.6 si comporti bene in quest'area, i test comparativi suggeriscono che sia più adatto alla pubblicità e a scenari di contenuti strutturati piuttosto che alle scene di dialogo estremo in primo piano in cui Seedance 2 eccelle.

Controllo del movimento e precisione fisica

Il movimento realistico e la simulazione fisica sono i tratti distintivi che separano i video AI di livello professionale dai contenuti sintetici evidenti.

Seedance 2 mostra una forte precisione fisica, con oggetti che cadono, si scontrano e interagiscono seguendo le regole del mondo reale. Gestisce movimenti di camera complessi, inclusi dolly zoom, rack focus, tracking shot, cambi di POV e fluidi movimenti a mano libera. Le sequenze d'azione — inclusi combattimenti, inseguimenti in auto, esplosioni e caduta di detriti — sono renderizzate con un comportamento fisico e una coerenza di movimento convincenti.

I confronti della comunità rilevano che Seedance gestisce particolarmente bene gli scenari realistici, con un'analisi che lo definisce un "regista di documentari competente" dove il realismo è la sua forza tradizionale. Il modello eccelle nei movimenti del corpo e nelle espressioni naturali, anche se alcuni utenti segnalano rari casi di duplicazione dei personaggi in scene complesse.

Wan 2.6 offre una coerenza di movimento migliorata rispetto al suo predecessore Wan 2.5, con una forza particolare nel mantenere la continuità narrativa all'interno di sequenze multi-scatto. L'elaborazione dei prompt è stata specificamente migliorata per conservare il contesto attraverso i cambi di scena, riducendo la necessità di ingegneria manuale dei prompt durante la creazione di sequenze multi-scena.

Coerenza del personaggio e visiva

Mantenere un aspetto coerente del personaggio in più inquadrature e scene è una sfida critica nella generazione di video AI.

Seedance 2 ha visto un miglioramento significativo nella coerenza globale per volti, abbigliamento, testo, scene e stili visivi. Il modello mantiene un aspetto stabile del personaggio tra i fotogrammi e le inquadrature, risolvendo i problemi comuni di deriva del personaggio, incoerenza stilistica e perdita di dettagli frequenti nei video AI. Il sistema di riferimento multimodale consente ai creatori di bloccare l'aspetto di un personaggio specifico utilizzando immagini di riferimento pur cambiando altri aspetti della scena.

Wan 2.6 affronta specificamente la sfida della coerenza attraverso il suo percorso Reference-to-Video (R2V). Questa modalità dedicata si concentra sulla coerenza del soggetto, consentendo ai creatori di mantenere l'identità del personaggio attraverso più clip generate. Il percorso R2V rappresenta uno dei miglioramenti più significativi di Wan 2.6 rispetto a Wan 2.5, affrontando direttamente il principale punto dolente che impediva l'adozione diffusa degli strumenti video AI in ambienti di produzione professionali.

Fedeltà ai prompt e obbedienza alle istruzioni

La capacità di interpretare ed eseguire con precisione istruzioni creative complesse determina il numero di iterazioni manuali necessarie per ottenere il risultato desiderato.

Seedance 2 enfatizza il rispetto dettagliato delle istruzioni, in particolare per scene che richiedono più soggetti, azioni e segnali di camera simultaneamente. Il modello comprende ed esegue prompt complessi con precisione, e il sistema di controllo in linguaggio naturale consente ai creatori di descrivere intuitivamente come utilizzare i riferimenti. Più il prompt è dettagliato — inclusi angoli di camera specifici, timing e istruzioni di riferimento — più l'output è preciso.

Wan 2.6 offre una conformità alle istruzioni più forte rispetto a Wan 2.5, con un'elaborazione dei prompt migliorata che preserva meglio il contesto narrativo tra i tagli. Il sistema di estensione dei prompt basato su LLM è stato perfezionato per ridurre l'attrito durante la creazione di sequenze multi-scena. Questo miglioramento rende Wan 2.6 più accessibile agli utenti che non hanno una vasta esperienza nella scrittura di prompt AI ottimali.

Benchmark di prestazioni: Risultati dei test nel mondo reale

I test della comunità e i confronti dei benchmark forniscono preziose informazioni su come questi modelli si comportano in vari scenari.

Classifica Artificial Analysis

Su Artificial Analysis, una piattaforma che classifica i generatori video tramite voto pubblico anziché metriche interne, Seedance 1.0 ha ottenuto il primo posto sia per la generazione Text-to-Video che Image-to-Video, superando Veo 3, Kling 2.0, Sora di OpenAI, Runway Gen4 e Wan 2.1. Sebbene queste classifiche precedano il rilascio di Wan 2.6, esse stabiliscono la solida posizione di Seedance nel più ampio panorama dei video AI.

Prestazioni per scenario

Test di prestazioni comparativi su scenari specifici rivelano punti di forza distinti:

Scene di folla e movimenti su larga scala: Seedance mostra una solida prestazione nella gestione di comportamenti realistici della folla e movimenti su larga scala, anche se occasionalmente può aggiungere una leggera deriva della fotocamera (che può essere corretta con una regolazione del prompt). Wan 2.6 è accettabile per piccole scene di folla ma presenta artefatti in scene dense.

Azione ed effetti: Per sequenze d'azione dinamiche come esplosioni o fuoco ed effetti visivi, Seedance mostra una solida simulazione di fumo e tempismo, anche se l'illuminazione può essere occasionalmente troppo luminosa. Wan 2.6 dimostra capacità in sequenze d'azione strutturate ma può mostrare instabilità in scenari estremi.

Animazione dei personaggi: Seedance eccelle nei movimenti del corpo e nelle espressioni naturali con un'eccezionale qualità del lip-sync, in particolare per contenuti ricchi di dialoghi. Wan 2.6 fornisce una solida animazione dei personaggi adatta alla pubblicità e ai contenuti strutturati, con il percorso R2V che risolve specificamente la necessità di coerenza del personaggio.

Velocità di generazione

Seedance 2 è riportato essere il 30% più veloce del suo predecessore Seedance 1.5, con generazioni che solitamente si completano in pochi minuti a seconda della complessità e della durata. I feedback della comunità considerano Seedance 1.5 come il leader di velocità tra i modelli principali, suggerendo che Seedance 2 mantenga tempi di generazione molto competitivi.

Wan 2.6 raggiunge velocità di generazione rapide, specialmente se acceduto tramite piattaforme ottimizzate. Le generazioni richiedono solitamente tra 1 e 3 minuti a seconda della lunghezza e della complessità del video. L'approccio dei percorsi strutturati probabilmente contribuisce a tempi di elaborazione prevedibili tra le diverse modalità di generazione.

Applicazioni pratiche: Quale modello per quale caso d'uso

La scelta del miglior modello dipende dai requisiti di produzione specifici, dal tipo di contenuto e dai vincoli del flusso di lavoro.

Seedance 2 è ideale per:

Contenuti narrativi e cinematografici: Il sistema di riferimento multimodale e la superiore sincronizzazione audiovisiva rendono Seedance 2 ideale per applicazioni di storytelling che richiedono profondità emotiva, narrazioni guidate dai personaggi e qualità cinematografica. I registi che creano storyboard, sequenze proof-of-concept o scene d'atmosfera possono beneficiare della capacità del modello di sintetizzare molteplici riferimenti creativi in una narrazione visiva coerente.

Contenuti ricchi di dialoghi: La precisione superiore del lip-sync e la resa delle micro-espressioni dell'architettura dual-branch lo rendono la prima scelta per contenuti che coinvolgono dialoghi umani, espressioni emotive e interazioni dei personaggi in primo piano. I creatori di contenuti educativi, i produttori di video esplicativi e chiunque crei contenuti conversazionali troveranno questa capacità immensamente preziosa.

Progetti complessi multi-riferimento: Quando un progetto richiede di sintetizzare l'ispirazione da più fonti — come abbinare la cinematografia di un riferimento, lo schema colori di un altro, il ritmo di una traccia musicale e un prompt narrativo dettagliato — la capacità di Seedance 2 di accettare fino a 12 asset di input simultanei offre un livello di controllo creativo impareggiabile.

Contenuti in stile documentario realistico: I test della comunità citano costantemente il realismo come forza tradizionale di Seedance, rendendolo particolarmente adatto a contenuti in stile documentario, scenari realistici e qualsiasi applicazione in cui l'autenticità e il movimento naturale sono fondamentali.

Wan 2.6 è ideale per:

Marketing e pubblicità strutturati: I tre percorsi di generazione dedicati offrono vincoli di produzione chiari e flussi di lavoro ripetibili, ideali per i team di marketing che producono contenuti di marca coerenti. L'approccio strutturato garantisce output prevedibili attraverso le campagne, rendendo Wan 2.6 una scelta predefinita più sicura per ambienti di produzione ripetitivi.

Requisiti di coerenza del personaggio: Il percorso Reference-to-Video (R2V) affronta specificamente la sfida di mantenere l'identità del personaggio attraverso più clip. I contenuti con mascotte, le serie con personaggi ricorrenti o qualsiasi applicazione che richieda un aspetto coerente del personaggio in più video beneficeranno di questa capacità dedicata.

Campagne narrative multi-scatto: Le forti capacità multi-scatto di Wan 2.6 supportano uno storytelling coerente tra le scene, adatto per film di marca, serie di contenuti educativi e campagne video strutturate che devono mantenere la continuità narrativa su più segmenti.

Integrazione per sviluppatori e flussi di lavoro API: La disponibilità open-source di Wan 2.6 e le ampie opzioni di integrazione API lo rendono estremamente attraente per gli sviluppatori che incorporano la generazione video nelle applicazioni, per le piattaforme che richiedono la distribuzione on-premise e per i team che devono personalizzare il comportamento del modello per casi d'uso specifici.

Produzioni attente al budget: La natura open-source di Wan 2.6 e i prezzi competitivi dell'API lo rendono una scelta economica per flussi di produzione ad alto volume in cui il costo per video è una considerazione importante.

Accesso ai modelli: Disponibilità delle piattaforme

Entrambi i modelli sono accessibili tramite più piattaforme, sebbene la disponibilità vari in base alla regione e al metodo di accesso.

Seedance 2 è attualmente disponibile in Cina con un lancio globale previsto per il secondo trimestre del 2026. È possibile accedere al modello tramite vari fornitori di API e piattaforme che hanno integrato le capacità di generazione video di ByteDance. Per i creatori e le aziende che desiderano sperimentare immediatamente le capacità avanzate di Seedance 2, Seedance 2.0 offre un comodo accesso alle sue funzioni di generazione multimodale.

Wan 2.6 gode di una disponibilità più ampia grazie alla sua natura open-source e all'integrazione in numerose piattaforme. Il modello è disponibile tramite più fornitori di API, piattaforme di sviluppo e integrazioni di terze parti. I creatori possono accedervi tramite Wan 2.6, che fornisce un accesso semplificato a tutti e tre i percorsi di generazione (T2V, I2V, R2V) all'interno di un'unica interfaccia unificata.

La piattaforma SeaDanceAI offre l'accesso a molteplici modelli di generazione video e immagini all'avanguardia, offrendo ai creatori la flessibilità di scegliere il modello migliore per ogni specifico progetto senza dover gestire più integrazioni separate. Questo punto di accesso unificato semplifica la gestione del flusso di lavoro per i team che gestiscono diversi tipi di contenuto e requisiti di produzione.

Il più ampio panorama competitivo

Sebbene questo confronto si concentri su Seedance 2 e Wan 2.6, è utile comprenderne la posizione rispetto ad altri modelli importanti.

Kling 3.0 di Kuaishou offre 4K/60fps nativo e capacità di storyboarding multi-scatto integrate, rappresentando l'opzione a più alta risoluzione attualmente disponibile. Tuttavia, ciò comporta prezzi premium che potrebbero essere eccessivi per molti scenari di produzione in cui l'output a 1080p è sufficiente.

Veo 3.1 di Google DeepMind guida i modelli chiusi con il pacchetto audio più completo, includendo dialogo, foley, atmosfera e consapevolezza musicale in un'unica generazione. Veo 3.1 offre anche un vero output 4K, sebbene l'accesso rimanga limitato dal processo di rilascio controllato di Google.

Sora 2 di OpenAI raggiunge una precisione fisica superiore e una generazione audio completa, fissando il tetto della qualità in molte dimensioni. Tuttavia, l'accesso rimane limitato e i prezzi per l'uso commerciale non sono stati resi pubblici.

In questo panorama, Seedance 2 e Wan 2.6 si distinguono per l'utilità pratica immediata, la qualità professionale e le chiare proposte di valore per casi d'uso specifici. Nessuno dei due cerca di essere il "migliore" in ogni dimensione; piuttosto, ciascuno eccelle dove conta per le diverse esigenze di produzione.

Quadro decisionale: Scegliere il proprio modello

Piuttosto che dichiarare un singolo "vincitore", il maturo mercato dei video AI nel 2026 richiede di abbinare i punti di forza del modello ai requisiti di produzione specifici.

Scegli Seedance 2 se:

-

La qualità della sincronizzazione audiovisiva è critica

-

Il progetto richiede di sintetizzare molteplici riferimenti creativi

-

Il dialogo, l'emozione e la performance del personaggio sono al centro del contenuto

-

La qualità cinematografica e lo storytelling d'atmosfera sono priorità

-

Hai bisogno di lip-sync e micro-espressioni della massima qualità

-

Il tuo obiettivo sono contenuti realistici in stile documentario

Scegli Wan 2.6 se:

-

Un flusso di produzione riproducibile e coerente è essenziale

-

È richiesta la coerenza del personaggio su più clip

-

Stai producendo contenuti di marketing o pubblicitari strutturati

-

L'integrazione per sviluppatori e la flessibilità dell'API sono priorità

-

I vincoli di budget favoriscono le opzioni open-source

-

Il tuo team apprezza percorsi di produzione chiari e output prevedibili

Considera di usare entrambi se:

-

Produci diversi tipi di contenuto che sfruttano i punti di forza di ciascun modello

-

Vuoi testare dinamicamente diverse prestazioni dei modelli per lo stesso brief creativo

-

Il tuo volume di produzione giustifica il mantenimento di più integrazioni di strumenti

-

I diversi membri del team hanno diversi livelli di abilità e preferenze del flusso di lavoro

Il futuro della generazione video AI

I rapidi progressi da Seedance 1.0 a Seedance 2 e da Wan 2.5 a Wan 2.6 dimostrano il ritmo accelerato dell'innovazione nella generazione video AI. Stanno emergendo diverse tendenze che plasmeranno la prossima generazione di strumenti:

L'aumento della risoluzione e del frame rate continuerà a spingere il 4K e i 60fps verso output standard piuttosto che funzionalità premium. Sebbene l'attuale 1080p/24fps soddisfi la maggior parte delle esigenze, la traiettoria è chiara.

L'estensione della durata sta superando l'attuale limite di 15 secondi. La generazione di contenuti a lunga durata rimane una sfida in termini di requisiti computazionali e mantenimento della coerenza, ma miglioramenti incrementali appaiono ad ogni iterazione del modello.

Interfacce di controllo migliorate si stanno evolvendo da prompt testuali e immagini di riferimento verso sistemi di direzione creativa più intuitivi. Il sistema di @menzioni in linguaggio naturale di Seedance 2 ne è un esempio; le future iterazioni integreranno probabilmente meccanismi di controllo ancora più sofisticati.

L'integrazione del flusso di lavoro di produzione sta diventando sempre più vitale man mano che questi strumenti passano da novità sperimentali a infrastrutture di produzione indispensabili. L'affidabilità delle API, le capacità di elaborazione batch e l'integrazione con i software creativi esistenti differenzieranno gli strumenti di livello professionale dalle app di consumo.

Conclusione: I video AI pronti per la produzione sono arrivati

Il confronto tra Seedance 2 e Wan 2.6 rivela una verità fondamentale sullo stato attuale della generazione video AI: abbiamo già superato la questione se l'AI possa creare video professionali per entrare nella fase più sfumata di quale strumento specializzato serva meglio a specifiche esigenze creative.

Seedance 2 rappresenta l'avanguardia del controllo creativo multimodale e della qualità cinematografica, con prestazioni eccezionali nella sincronizzazione audiovisiva, nella performance emotiva e nella sintesi di riferimenti complessi. La sua architettura unificata e la capacità di elaborare fino a 12 input simultanei offrono una flessibilità creativa senza precedenti per contenuti narrativi e basati sui personaggi.

Wan 2.6 fornisce un flusso di produzione strutturato e riproducibile attraverso percorsi di generazione dedicati ottimizzati per casi d'uso specifici. La sua capacità Reference-to-Video risponde alla critica necessità di coerenza dei personaggi, mentre la sua natura open-source e le ampie opzioni di integrazione API lo rendono estremamente attraente per gli sviluppatori e i team di produzione attenti al budget.

Nessuno dei due modelli è universalmente superiore; ciascuno eccelle in dimensioni che contano per diversi scenari di produzione. L'approccio maturo consiste nel comprendere questi punti di forza e abbinare lo strumento giusto a ogni specifico progetto.

Per creatori, esperti di marketing e team di produzione che navigano in questo panorama, il consiglio pratico è chiaro: testate entrambi i modelli su contenuti rappresentativi della vostra reale linea di produzione. La differenza nella qualità dell'output, nell'efficienza del flusso di lavoro e nel controllo creativo diventerà rapidamente evidente, consentendovi di prendere decisioni informate basate su risultati reali piuttosto che su specifiche tecniche.

La rivoluzione della generazione video AI non è più una previsione; è qui. Strumenti come Seedance 2 e Wan 2.6 stanno già producendo contenuti per annunci commerciali, campagne sui social media, materiali educativi e progetti creativi in tutto il mondo. La domanda non è più se adottare questi strumenti, ma come integrarli nel modo più efficace nel proprio flusso creativo.

Accedi a entrambi i modelli tramite piattaforme unificate come Seedance 2.0 e Wan 2.6 per sperimentare le loro capacità di persona e trovare quello che meglio servirà la tua visione creativa unica.