Il panorama della generazione video tramite intelligenza artificiale ha raggiunto un momento cruciale nel 2026. Due modelli dominano ora la conversazione tra creatori, esperti di marketing e sviluppatori: Seedance 2.0 di ByteDance e Sora 2 di OpenAI. Entrambi rappresentano progressi significativi nella tecnologia di sintesi video, ma servono filosofie creative e flussi di lavoro di produzione fondamentalmente diversi.

Questo confronto completo esamina entrambi i modelli attraverso dimensioni critiche — capacità tecniche, benchmark delle prestazioni reali, feedback della community e casi d'uso pratici — per aiutarti a prendere una decisione informata su quale strumento soddisfa meglio le tue esigenze di produzione video.

Comprendere la filosofia di base: Efficienza produttiva vs Simulazione fisica

Prima di immergersi nelle specifiche tecniche, è essenziale comprendere la filosofia di progettazione fondamentale che distingue questi due modelli.

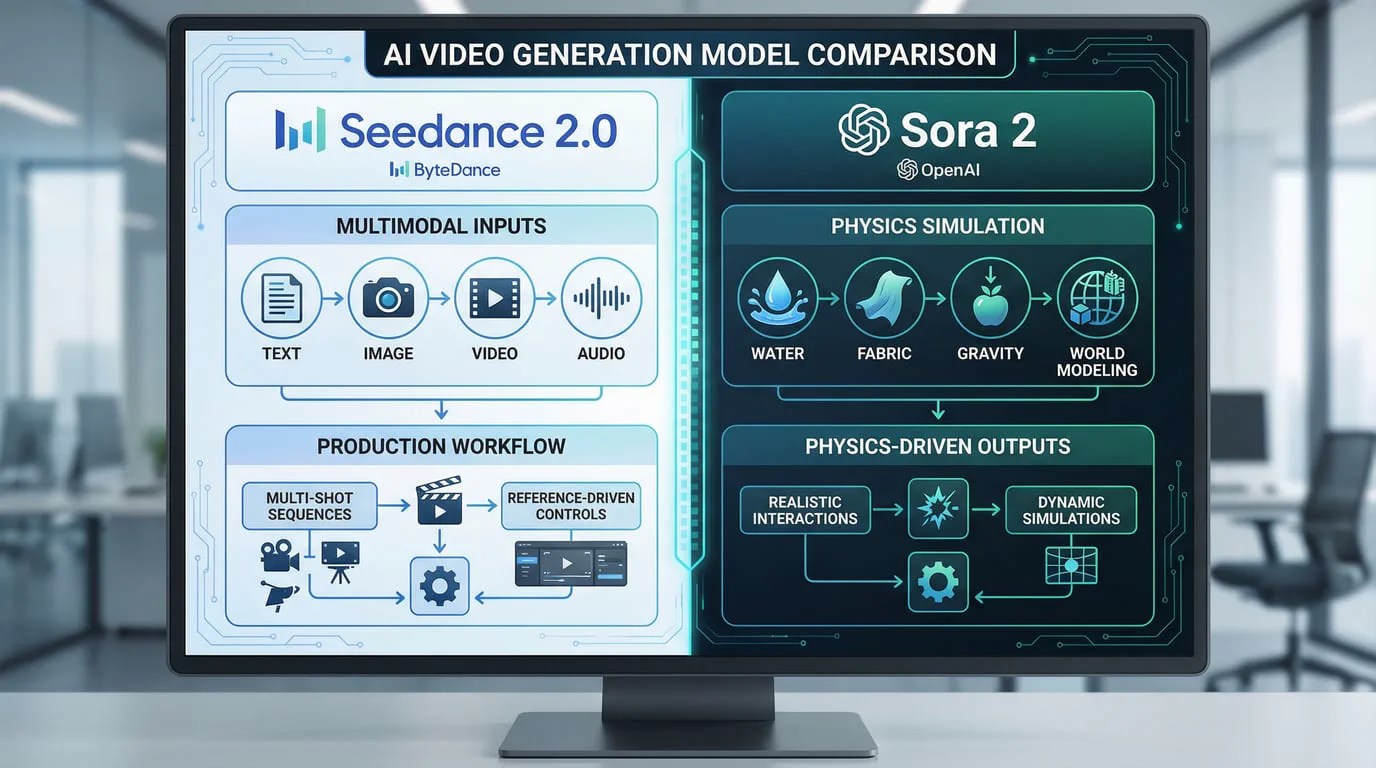

Seedance 2.0 si posiziona come un motore orientato alla produzione, progettato per un'iterazione rapida e flussi di lavoro commerciali. ByteDance ha progettato questo modello pensando ai creatori di contenuti, alle agenzie pubblicitarie e ai produttori di social media. L'attenzione è rivolta alla generazione di narrazioni multi-shot, al controllo basato su riferimenti e all'integrazione senza soluzione di continuità nelle pipeline creative esistenti. Quando devi produrre rapidamente più varianti di contenuti di marketing, mantenere la coerenza dei personaggi in diverse scene o generare video che richiedono un editing di post-produzione minimo, Seedance 2.0 offre esattamente questa ottimizzazione del flusso di lavoro.

Sora 2, al contrario, rappresenta l'impegno di OpenAI per la simulazione del mondo e il realismo basato sulla fisica. Questo modello eccelle nella comprensione e nella replicazione delle leggi fondamentali della fisica: gravità, quantità di moto, dinamica dei fluidi, rifrazione della luce e proprietà dei materiali. Quando la tua visione creativa richiede una fedeltà visiva senza precedenti, interazioni fisiche complesse o sequenze cinematografiche sperimentali che spingono i confini del possibile, Sora 2 fornisce la potenza di calcolo e la precisione della simulazione per ottenere tali risultati.

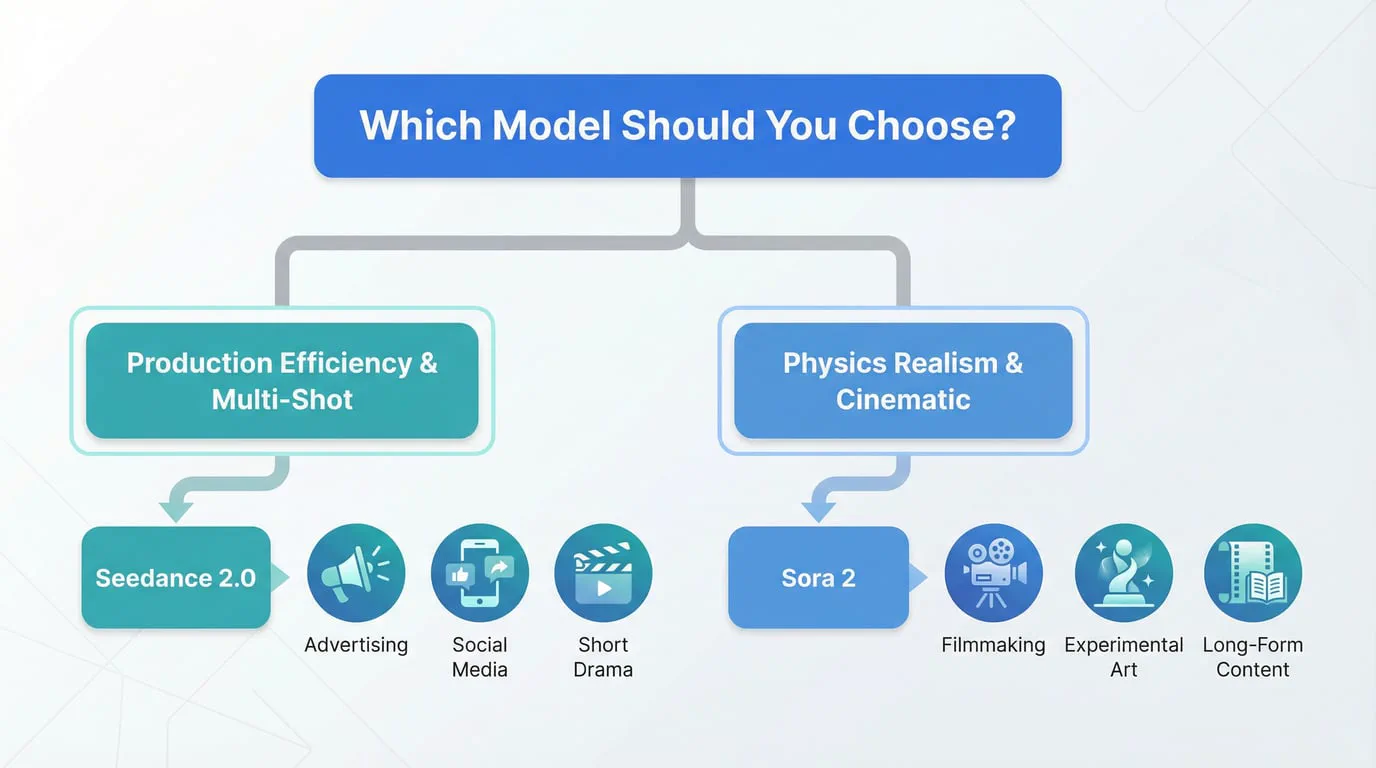

La scelta tra questi modelli non riguarda quale sia "migliore" in senso assoluto. Si tratta di allineare lo strumento con i tuoi specifici requisiti di produzione e obiettivi creativi.

Capacità tecniche: Un'analisi approfondita delle metriche delle prestazioni

Architettura di input multimodale

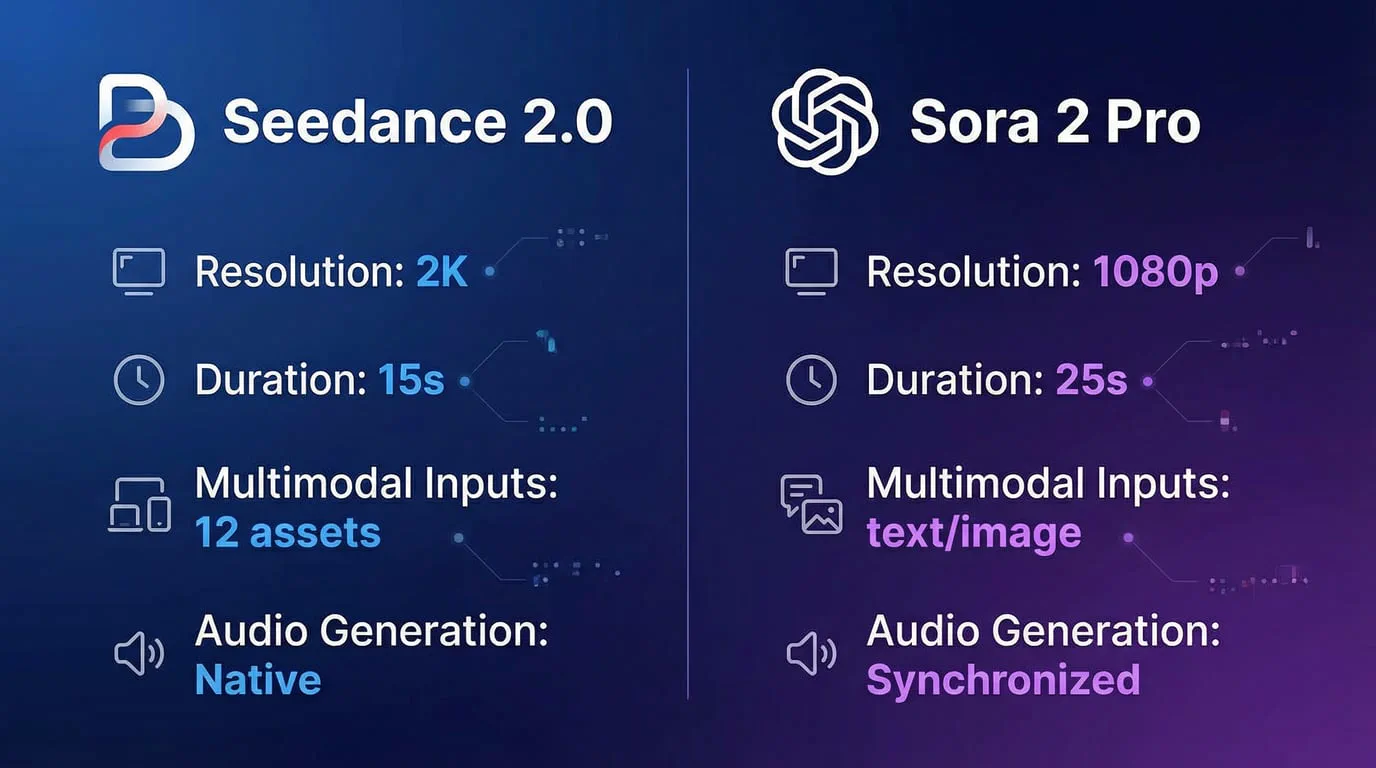

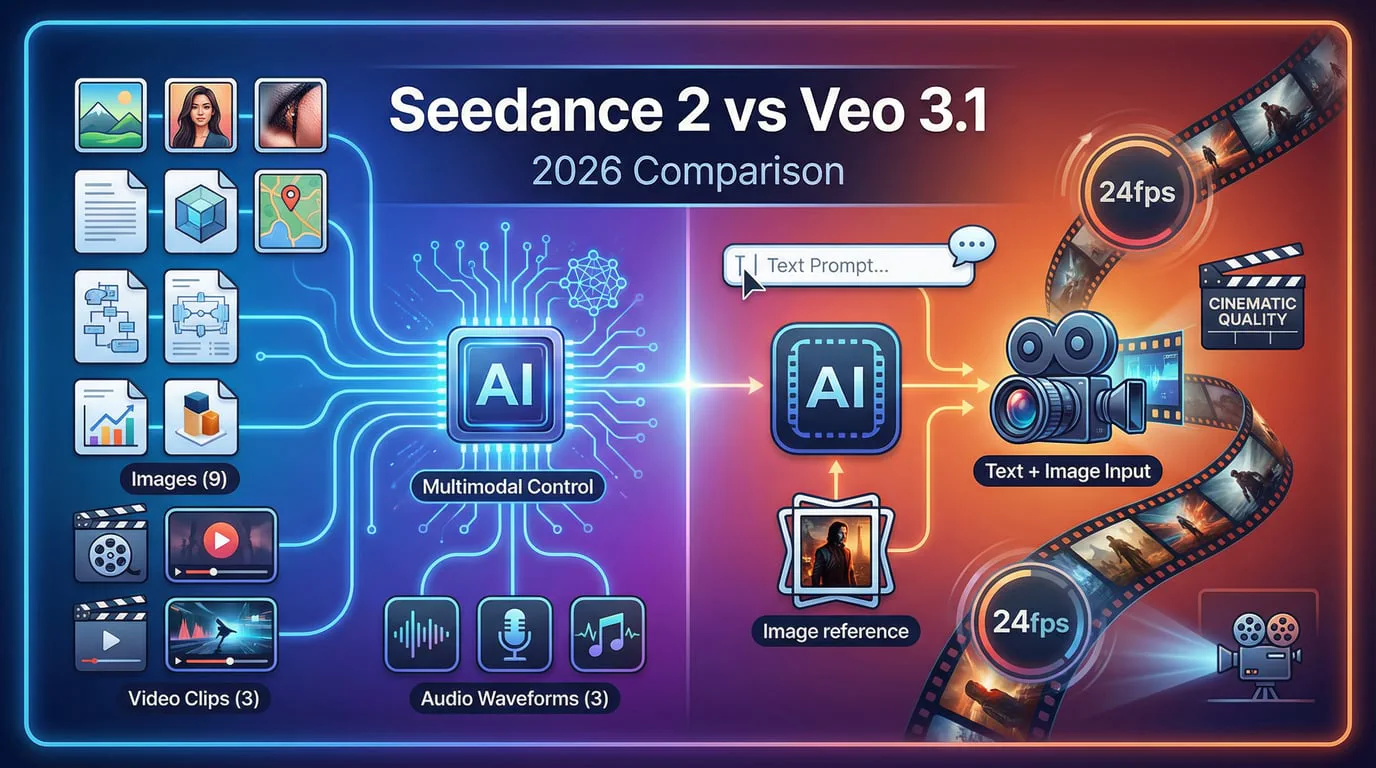

Seedance 2.0 introduce quella che ByteDance chiama "input quad-modale", un approccio rivoluzionario che accetta simultaneamente riferimenti di testo, immagini, video e audio all'interno di un unico flusso di lavoro di generazione. Questa capacità trasforma il modo in cui i creatori approcciano la produzione video. Puoi fornire un video di riferimento per la dinamica del movimento, una traccia audio per la sincronizzazione del ritmo, un'immagine del personaggio per la coerenza dell'aspetto e un prompt di testo per la descrizione della scena — tutto in un'unica richiesta unificata. Il modello sintetizza questi input disparati in un output coerente che rispetta ogni dimensione di riferimento.

Questa architettura multimodale si rivela particolarmente preziosa per scenari di produzione che richiedono un controllo creativo preciso. I creatori di video di danza possono fare riferimento a coreografie da clip esistenti sostituendo i propri personaggi. Le agenzie pubblicitarie possono mantenere l'identità visiva del marchio fornendo immagini di riferimento dello stile mentre generano scenari completamente nuovi. Il sistema comprende non solo cosa rappresenta ogni input, ma anche come quegli elementi dovrebbero interagire e completarsi a vicenda nell'output finale.

Sora 2 adotta un approccio più tradizionale ma altamente raffinato all'elaborazione degli input. Il modello accetta prompt di testo e riferimenti di immagini singole, con recenti aggiunte che includono la funzione "Cameo" che consente agli utenti di caricare foto personali per l'integrazione dei personaggi. Sebbene ciò rappresenti meno modalità di input rispetto a Seedance 2.0, Sora 2 compensa con un'eccezionale comprensione dei prompt e la capacità di dedurre comportamenti fisici complessi da una descrizione testuale minima. Il modello dimostra una notevole capacità di comprendere i requisiti impliciti: quando descrivi "spruzzi d'acqua", non solo anima il movimento del liquido, ma simula accuratamente la tensione superficiale, la formazione delle goccioline e la rifrazione della luce attraverso l'acqua.

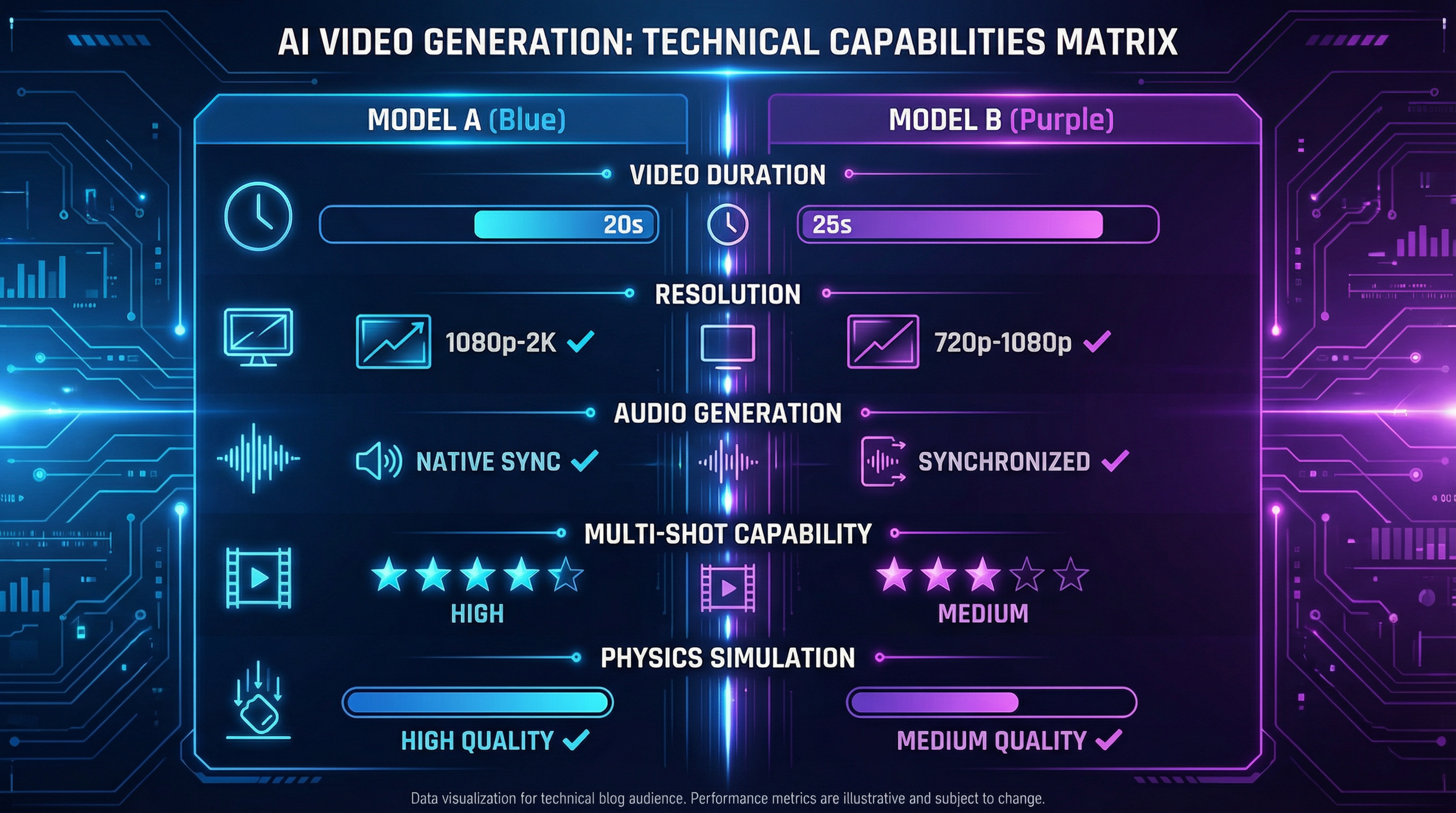

Specifiche di durata e risoluzione video

Seedance 2.0 genera video fino a 20 secondi di durata a risoluzioni che raggiungono i 2160p (4K) nella sua modalità di massima qualità. L'output standard offre una risoluzione di 1080p, che soddisfa la stragrande maggioranza dei requisiti per social media, pubblicità e video commerciali. La durata di 20 secondi si rivela ideale per Instagram Reels, contenuti TikTok, YouTube Shorts e spot pubblicitari: i formati dominanti del marketing digitale odierno.

Sora 2 estende la generazione video a un massimo di 25 secondi, con capacità di risoluzione che vanno da 480p (livello ChatGPT Plus) a 1080p (livello ChatGPT Pro) e fino a 1792×1024 pixel tramite accesso API. I cinque secondi extra possono sembrare marginali, ma per la narrazione e le sequenze cinematografiche, quella durata aggiuntiva fornisce un respiro cruciale per inquadrature di stabilimento, sviluppo dei personaggi e ritmo emotivo. La forza del modello non risiede nei numeri di risoluzione grezzi, ma nella coerenza visiva e nella precisione fisica mantenute per l'intera durata.

Sincronizzazione audio-visiva nativa

Una delle innovazioni più significative di Seedance 2.0 è la generazione audio-visiva nativa. A differenza della maggior parte dei modelli video AI che generano clip silenziosi che richiedono una produzione audio separata, Seedance 2.0 sintetizza il suono sincronizzato insieme al contenuto video. Il sistema produce dialoghi con sincronizzazione labiale accurata a livello di fonema in più lingue, paesaggi sonori ambientali che corrispondono all'atmosfera della scena ed effetti sonori in tempo reale che corrispondono esattamente alle azioni sullo schermo. Quando una porta si chiude nel video, senti il suono di chiusura appropriato nel fotogramma esatto del contatto. Quando i personaggi parlano, i loro movimenti della bocca si allineano con il dialogo generato a livello di fonema: non solo un tempismo approssimativo, ma una reale precisione di articolazione.

Questa capacità elimina un'intera fase del flusso di lavoro di post-produzione. La produzione video tradizionale richiede la registrazione o l'approvvigionamento audio separato, quindi la sincronizzazione manuale di effetti sonori, dialoghi e audio ambientale con elementi visivi. Seedance 2.0 gestisce questa integrazione automaticamente, riducendo drasticamente i tempi di produzione e la complessità tecnica.

Sora 2 dispone anche di generazione audio sincronizzata, producendo dialoghi, effetti sonori e paesaggi sonori di sottofondo con alto realismo. L'implementazione di OpenAI si concentra sulla qualità audio e sull'accuratezza ambientale: l'acustica di una cattedrale suona in modo appropriato con riverbero, le scene all'aperto includono un rumore ambientale appropriato e gli effetti sonori dimostrano un posizionamento spaziale corretto. Sebbene entrambi i modelli offrano la generazione audio, la sincronizzazione labiale a livello di fonema di Seedance 2.0 gli conferisce un netto vantaggio per i contenuti ricchi di dialogo e le narrazioni guidate dai personaggi.

Coerenza multi-shot e continuità narrativa

Seedance 2.0 è stato progettato specificamente per la narrazione multi-shot. Il modello mantiene l'aspetto del personaggio, lo stile visivo, la coerenza dell'illuminazione e la continuità atmosferica attraverso le transizioni di scena all'interno di un singolo flusso di lavoro di generazione. Ciò affronta una delle sfide più persistenti nella generazione video AI: mantenere la coerenza visiva durante il taglio tra diverse inquadrature o angoli di ripresa.

Per la produzione video commerciale, questa capacità si rivela trasformativa. Puoi generare un annuncio completo di 20 secondi con più angoli di ripresa, cambi di scena e interazioni dei personaggi mantenendo una perfetta coerenza visiva. Il modello comprende convenzioni cinematografiche come inquadrature di stabilimento, primi piani e inquadrature di reazione, generando transizioni appropriate che sembrano montate professionalmente piuttosto che concatenate artificialmente.

Sora 2 gestisce la coerenza della scena in modo diverso. Mentre eccelle nel mantenere la coerenza all'interno di una singola ripresa continua, la generazione di più scene distinte con personaggi coerenti richiede in genere passaggi di generazione separati. La forza del modello risiede nelle sequenze estese a ripresa singola con movimenti di camera complessi e azione in evoluzione. Per una ripresa di inseguimento di 25 secondi che segue un personaggio attraverso più ambienti, Sora 2 offre una continuità e una plausibilità fisica senza pari.

Simulazione fisica e modellazione del mondo

Questa dimensione rappresenta il vantaggio competitivo più significativo di Sora 2. OpenAI ha investito molto nella simulazione del mondo basata sulla fisica, consentendo al modello di comprendere e replicare fenomeni fisici complessi con eccezionale precisione. Quando richiedi un rimbalzo di un pallone da basket, Sora 2 calcola la deformazione appropriata all'impatto, la traiettoria precisa basata su gravità e momento, e la rotazione realistica durante il volo. L'acqua scorre con la corretta dinamica dei fluidi, il tessuto si drappeggia e si muove secondo le proprietà del materiale e le forze del vento, e la luce interagisce con le superfici attraverso riflessi, rifrazione e proiezione di ombre accurati.

Le valutazioni indipendenti classificano costantemente Sora 2 come leader del settore nel realismo fisico. Quando la tua visione creativa richiede una fisica credibile — atleti che eseguono movimenti complessi, fenomeni naturali come meteo e acqua, o sistemi meccanici con parti interagenti — Sora 2 offre una qualità di simulazione che si avvicina alla precisione fotorealistica.

Seedance 2.0 dimostra forti capacità di simulazione fisica, rappresentando un miglioramento significativo rispetto alle versioni precedenti. Il modello gestisce gravità, momento e causalità di base in modo eccellente. Gli oggetti cadono realisticamente, i personaggi si muovono con peso e inerzia appropriati e le semplici interazioni fisiche sembrano convincenti. Tuttavia, in scenari altamente complessi che coinvolgono più sistemi fisici interagenti — come un personaggio che si tuffa in acqua mentre il tessuto ondeggia al vento — Sora 2 mantiene una precisione e una credibilità visiva superiori.

Per la maggior parte delle applicazioni video commerciali, la simulazione fisica di Seedance 2.0 si rivela del tutto sufficiente. I contenuti dei social media, la pubblicità, le dimostrazioni di prodotti e la narrazione narrativa raramente richiedono l'estrema precisione fisica che distingue Sora 2. La differenza diventa evidente principalmente nei casi limite: film d'arte sperimentali, visualizzazione scientifica o sequenze cinematografiche specificamente progettate per mostrare fenomeni fisici.

Benchmark delle prestazioni: VBench e test reali

La valutazione obiettiva dei modelli video AI richiede quadri di riferimento standardizzati. VBench, la suite di benchmark per la generazione video più completa, valuta i modelli su più dimensioni, tra cui qualità estetica, coerenza dello sfondo, grado dinamico, qualità dell'immagine, fluidità del movimento e coerenza del soggetto.

Secondo le recenti valutazioni VBench, il divario di prestazioni tra i modelli leader si è ridotto drasticamente. Open-Sora 2.0 (un'implementazione open source) ha ridotto il divario di prestazioni con Sora di OpenAI dal 4,52% ad appena lo 0,69%, dimostrando che la tecnologia di generazione video ha raggiunto una soglia di maturità in cui più modelli raggiungono livelli di qualità comparabili.

Test indipendenti su nove modelli video AI leader all'inizio del 2026 hanno rivelato caratteristiche di prestazioni sfumate. Sora 2 si è costantemente classificato più in alto per realismo fisico e continuità di forma lunga. Seedance 2.0 ha eccelso nell'aderenza ai prompt, nella coerenza multi-shot e nell'output pronto per la produzione che richiede un editing minimo. Veo 3.1 di Google ha ottenuto i punteggi migliori nella qualità visiva complessiva e nell'accuratezza dell'illuminazione, mentre altri modelli come Runway Gen-4 e Kling 2.6 hanno dimostrato prestazioni competitive in casi d'uso specifici.

I test utente reali forniscono un contesto aggiuntivo oltre i punteggi di benchmark. I creatori di contenuti riferiscono che Seedance 2.0 richiede in genere meno tentativi di generazione per ottenere i risultati desiderati, grazie al suo sistema di controllo basato su riferimenti. Fornendo riferimenti visivi per stile, movimento e aspetto dei personaggi, i creatori ottengono risultati più prevedibili rispetto ai soli prompt di testo. Ciò si traduce direttamente in risparmi sui costi e tempi di produzione più rapidi.

Gli utenti di Sora 2 sottolineano la capacità del modello di gestire prompt complessi e astratti che altri modelli faticano a interpretare. Quando si descrivono scenari surreali, concetti visivi sperimentali o interazioni fisiche complesse, Sora 2 dimostra una comprensione superiore dei prompt e un'interpretazione creativa. Tuttavia, questa raffinatezza comporta un aumento del tempo di generazione: Sora 2 richiede in genere un'elaborazione più lunga rispetto a Seedance 2.0 per una durata video equivalente.

Feedback della community ed esperienza di produzione reale

Oltre alle specifiche tecniche e ai punteggi di benchmark, le intuizioni più preziose provengono dai creatori che utilizzano attivamente questi modelli in ambienti di produzione. Il feedback della community da Reddit, YouTube, Twitter e forum di creatori professionisti rivela modelli distinti di esperienza e soddisfazione dell'utente.

Accoglienza della community di Seedance 2.0

La community dei creatori ha risposto con entusiasmo all'approccio orientato alla produzione di Seedance 2.0. Diversi creatori di YouTube hanno pubblicato recensioni pratiche descrivendo il modello come "SCHIACCIANTE" e osservando che "DISTRUGGE ogni altro modello video AI" in termini di usabilità pratica per i flussi di lavoro di produzione di contenuti.

Elogio all'efficienza produttiva: I creatori di contenuti sottolineano costantemente la capacità di Seedance 2.0 di generare output pronti per la produzione con un'iterazione minima. Un utente Reddit ha riferito di aver creato un mini-film di 10 minuti in circa 8 ore di lavoro, osservando che la coerenza multi-shot ha eliminato ore di editing manuale che sarebbero tipicamente necessarie quando si uniscono clip generati separatamente. Il flusso di lavoro basato su riferimenti riceve elogi particolari: i creatori apprezzano la capacità di mostrare al modello esattamente cosa vogliono attraverso esempi visivi piuttosto che lottare con l'ingegneria dei prompt di testo.

Impatto dell'integrazione audio: La capacità di sincronizzazione audio-visiva nativa ha cambiato radicalmente i flussi di lavoro per molti creatori. I produttori di social media riferiscono che l'eliminazione della fase separata di produzione e sincronizzazione audio riduce il tempo totale di produzione del 40-50%. I creatori di contenuti di danza lodano specificamente la funzione di sincronizzazione del ritmo, che consente loro di fornire una traccia musicale e far allineare automaticamente i movimenti video generati con la struttura del ritmo.

Svolta nella narrazione multi-shot: Le agenzie pubblicitarie e i produttori di video commerciali identificano la coerenza multi-shot come la caratteristica più preziosa di Seedance 2.0. La capacità di generare sequenze narrative complete con più angoli di ripresa, cambi di scena e interazioni dei personaggi mantenendo l'aspetto del personaggio e lo stile visivo risolve quella che in precedenza era la limitazione più significativa nella generazione video AI. Un professionista del marketing l'ha descritto come "avere finalmente un'IA che capisce come deve apparire effettivamente uno spot pubblicitario".

Feedback sulla curva di apprendimento: Gli utenti notano che l'interfaccia multimodale di Seedance 2.0 richiede un po' di apprendimento iniziale per essere utilizzata in modo efficace, ma l'investimento paga dividendi. I creatori che si prendono il tempo per capire come strutturare correttamente gli input di riferimento riportano risultati notevolmente migliori rispetto a coloro che si affidano esclusivamente ai prompt di testo.

Accoglienza della community di Sora 2

Sora 2 ha generato un notevole entusiasmo nella community dei creatori sperimentali e artistici, con particolare entusiasmo da parte di registi e artisti visivi che spingono i confini creativi.

Acclamazione del realismo fisico: Il tema di feedback coerente attorno a Sora 2 è incentrato sulla sua eccezionale simulazione fisica. I creatori che tentano scenari fisici complessi — atleti che eseguono ginnastica, dinamica dei fluidi, simulazione di tessuti — riferiscono che Sora 2 fornisce risultati che altri modelli non possono eguagliare. Un regista ha descritto la generazione di una sequenza di un ginnasta olimpico che esegue una routine a corpo libero, notando che "il peso, lo slancio e la meccanica corporea erano così accurati che sembravano dati di motion capture".

Profondità di comprensione dei prompt: Gli utenti evidenziano la capacità di Sora 2 di comprendere ed eseguire prompt complessi e astratti che confondono altri modelli. Quando si descrivono scenari surreali, concetti visivi sperimentali o composizioni di scene complesse, Sora 2 dimostra un'interpretazione creativa superiore. Tuttavia, questa raffinatezza ha un prezzo: i tempi di generazione sono notevolmente più lunghi rispetto a Seedance 2.0, con prompt complessi che a volte richiedono 10-15 minuti di elaborazione.

Qualità cinematografica per progetti artistici: I registi sperimentali e gli artisti visivi scelgono costantemente Sora 2 per progetti in cui la qualità visiva e la precisione fisica sono fondamentali. La capacità del modello di mantenere la coerenza attraverso lunghe sequenze a ripresa singola con movimenti di camera complessi riceve elogi particolari dai creatori focalizzati sulla cinematografia.

Sfide di iterazione: Alcuni utenti riferiscono che ottenere i risultati desiderati con Sora 2 richiede più tentativi di generazione rispetto all'approccio basato su riferimenti di Seedance 2.0. Senza la capacità di fornire riferimenti visivi per specifici elementi di stile, i creatori dipendono interamente dal perfezionamento dei prompt di testo, che può essere meno prevedibile.

Analisi comparativa del sentiment degli utenti

L'analisi delle discussioni della community sulle piattaforme rivela distinti profili utente che gravitano verso ciascun modello:

Utenti principali di Seedance 2.0: Creatori di contenuti social media, agenzie pubblicitarie, aziende di e-commerce, produttori di video di danza e musicali e chiunque dia priorità all'efficienza produttiva e al volume di output. Questi utenti apprezzano risultati prevedibili, iterazione rapida e video finiti che richiedono una post-produzione minima.

Utenti principali di Sora 2: Registi sperimentali, artisti visivi, creatori di contenuti di marchi premium, professionisti della visualizzazione scientifica e creatori i cui progetti giustificano tempi di generazione più lunghi in cambio della massima fedeltà visiva e precisione fisica.

Terreno comune: Entrambe le community riconoscono che la generazione video AI ha superato una soglia critica da "demo impressionante" a "strumento pronto per la produzione". Il dibattito non riguarda più se il video AI sia fattibile, ma quale strumento serve meglio specifici obiettivi creativi.

Casi d'uso pratici: Adattare i modelli alle esigenze di produzione

Quando Seedance 2.0 eccelle

Produzione di contenuti per social media: La combinazione di 20 secondi di durata (perfetta per Reels, TikTok, Shorts), capacità multi-shot, generazione audio nativa e prezzi accessibili rende Seedance 2.0 la scelta ottimale per i creatori di social media. Genera rapidamente più varianti di contenuto, mantieni la coerenza dei personaggi nella tua libreria di contenuti e produci video finiti senza editing audio aggiuntivo.

Video pubblicitari e di marketing: La produzione video commerciale richiede un'iterazione rapida, coerenza del marchio ed efficienza dei costi. Il flusso di lavoro basato su riferimenti di Seedance 2.0 consente alle agenzie di mantenere l'identità visiva del marchio generando più varianti di campagna. La capacità multi-shot consente narrazioni pubblicitarie complete all'interno di singoli passaggi di generazione, riducendo drasticamente le tempistiche di produzione.

Video di prodotti e-commerce: Le dimostrazioni di prodotti, i punti salienti delle funzionalità e i contenuti lifestyle per le piattaforme di e-commerce beneficiano dell'efficienza produttiva di Seedance 2.0. Genera più video di prodotti in diversi scenari, mantieni un aspetto coerente del prodotto e produci output di qualità professionale su larga scala.

Contenuti narrativi in formato breve: Web serie, contenuti a episodi e brevi produzioni drammatiche sfruttano la coerenza multi-shot e la continuità dei personaggi di Seedance 2.0. Mantieni la coerenza visiva attraverso gli episodi, genera in modo efficiente più scene e produci contenuti ricchi di dialoghi con sincronizzazione labiale automatica.

Video educativi e tutorial: I contenuti didattici che richiedono una chiara comunicazione visiva, più angoli di dimostrazione e narrazione esplicativa beneficiano delle capacità multimodali e della generazione audio nativa di Seedance 2.0.

Quando Sora 2 eccelle

Cinema e film sperimentale: I progetti che danno priorità all'arte visiva, al realismo fisico e alla sperimentazione creativa beneficiano della simulazione fisica e della modellazione del mondo superiori di Sora 2. Il modello gestisce concetti astratti, scenari surreali e interazioni fisiche complesse che altri modelli faticano a interpretare.

Visualizzazione scientifica e tecnica: Quando l'accuratezza dei fenomeni fisici è importante — dimostrazione di sistemi meccanici, processi naturali o concetti scientifici — la simulazione basata sulla fisica di Sora 2 fornisce la precisione e la credibilità necessarie.

Sequenze a ripresa singola di lunga durata: Riprese di inseguimento estese, sequenze d'azione continue e movimenti di camera cinematografici mostrano la forza di Sora 2 nel mantenere la coerenza per durate più lunghe. La durata massima di 25 secondi offre tempo aggiuntivo cruciale per inquadrature di stabilimento e ritmo narrativo.

Contenuti di marca ad alta fedeltà: I marchi premium che richiedono la massima qualità visiva e realismo fisico per campagne di punta possono giustificare il costo più elevato di Sora 2 attraverso la qualità di output superiore e la precisione fisica.

Pubblicità sperimentale: Le campagne creative progettate per spingere i confini, presentare scenari impossibili o dimostrare capacità di prodotti attraverso una fisica esagerata beneficiano delle capacità di simulazione del mondo di Sora 2.

Accesso e integrazione: Disponibilità della piattaforma

Accesso a Seedance 2.0

Produzione di contenuti per social media: La combinazione di 20 secondi di durata (perfetta per Reels, TikTok, Shorts), capacità multi-shot e generazione audio nativa rende Seedance 2.0 la scelta ottimale per i creatori di social media. Genera rapidamente più varianti di contenuto, mantieni la coerenza dei personaggi nella tua libreria di contenuti e produci video finiti senza editing audio aggiuntivo.

Video pubblicitari e di marketing: La produzione video commerciale richiede un'iterazione rapida e coerenza del marchio. Il flusso di lavoro basato su riferimenti di Seedance 2.0 consente alle agenzie di mantenere l'identità visiva del marchio generando più varianti di campagna. La capacità multi-shot consente narrazioni pubblicitarie complete all'interno di singoli passaggi di generazione, riducendo drasticamente le tempistiche di produzione.

Seedance 2.0 è attualmente disponibile tramite la piattaforma Jimeng (Dreamina) di ByteDance, accessibile a Dreamina per gli utenti internazionali. La piattaforma richiede la creazione di un account e opera principalmente con metodi di pagamento cinesi (Alipay, WeChat Pay) per gli utenti in Cina, sebbene l'accesso internazionale si stia espandendo.

Piattaforme di terze parti, tra cui Atlas Cloud, Kie AI e FLUX Context, stanno iniziando a offrire l'accesso API a Seedance 2.0 con opzioni di pagamento più accessibili per gli sviluppatori internazionali. Queste piattaforme forniscono interfacce unificate per accedere a più modelli video AI, semplificando l'integrazione per le aziende che integrano la generazione video nei loro prodotti.

Il modello è accessibile anche tramite varie piattaforme di aggregazione di strumenti AI che forniscono interfacce semplificate per utenti non tecnici. Queste piattaforme in genere addebitano commissioni di ricarico ma eliminano la complessità dell'integrazione API diretta.

Accesso a Sora 2

Sora 2 è disponibile attraverso tre canali principali:

-

Interfaccia ChatGPT: Gli utenti con abbonamenti ChatGPT Pro ($200/mese) accedono a Sora 2 Pro direttamente tramite l'interfaccia web e l'app mobile di ChatGPT. Questo offre l'esperienza più user-friendly con prompt conversazionali e perfezionamento iterativo.

-

OpenAI API: Gli sviluppatori possono integrare Sora 2 nelle applicazioni tramite l'API ufficiale di OpenAI, utilizzando prezzi pay-per-use. Ciò richiede l'autenticazione tramite chiave API e l'integrazione programmatica, ma offre la massima flessibilità per flussi di lavoro personalizzati.

-

Piattaforme di terze parti: Servizi come Artlist, Krea e Higgsfield offrono accesso a Sora 2 tramite le loro piattaforme, spesso con strumenti di editing e funzionalità di flusso di lavoro aggiuntivi. Queste piattaforme possono offrire diverse strutture di prezzo o servizi in bundle.

Si applicano restrizioni geografiche all'accesso a Sora 2, con disponibilità iniziale limitata a paesi specifici. Gli utenti al di fuori delle regioni supportate potrebbero richiedere un accesso VPN o alternative di piattaforme di terze parti.

L'ecosistema più ampio: Piattaforme multi-modello

Una tendenza emergente nel 2026 è l'ascesa di piattaforme multi-modello che forniscono un accesso unificato a più modelli di generazione video AI tramite singole interfacce. Piattaforme come Seedance AI esemplificano questo approccio, offrendo agli utenti l'accesso a Seedance 2.0, Sora 2 e altri modelli di generazione video leader insieme a capacità di generazione di immagini utilizzando Flux, Stable Diffusion, DALL-E 3 e altri modelli di immagine all'avanguardia.

Questo approccio multi-modello offre diversi vantaggi strategici:

Flessibilità: Diversi progetti hanno requisiti diversi. L'accesso a più modelli tramite un'unica piattaforma elimina la necessità di mantenere abbonamenti separati e apprendere interfacce diverse.

Ottimizzazione dei costi: Utilizza il modello più conveniente per ogni compito specifico piuttosto che impegnarti in un unico abbonamento costoso. Genera contenuti per social media con Seedance 2.0, produci sequenze cinematografiche con Sora 2 e crea immagini di marketing con Flux: tutto in un flusso di lavoro unificato.

Integrazione del flusso di lavoro: Le piattaforme multi-modello forniscono spesso strumenti di editing integrati, gestione delle risorse e funzionalità di flusso di lavoro che semplificano la produzione oltre la semplice generazione. Combina generazione di immagini, sintesi video e capacità di editing in linee di produzione coese.

A prova di futuro: Man mano che emergono nuovi modelli e quelli esistenti si evolvono, le piattaforme multi-modello aggiornano le loro offerte senza richiedere agli utenti di migrare a nuovi servizi o apprendere nuove interfacce.

Per le aziende e i creatori professionisti, piattaforme come Seedance 2 offrono un comodo accesso all'intero spettro delle capacità di generazione AI, consentendo ai team di scegliere lo strumento ottimale per ogni sfida creativa senza complessità infrastrutturali o impegni di abbonamento multipli.

Ottimizzazione delle prestazioni: Ottenere i migliori risultati

Best Practice per Seedance 2.0

Sfrutta gli input di riferimento: L'architettura multimodale di Seedance 2.0 funziona meglio quando vengono forniti materiali di riferimento chiari. Fornisci immagini di riferimento dello stile per la coerenza visiva, video di riferimento del movimento per sequenze d'azione e riferimenti audio per la sincronizzazione del ritmo.

Struttura narrazioni multi-shot: Pianifica il tuo video come una sequenza di riprese distinte con transizioni chiare. Descrivi lo scopo di ogni ripresa, l'angolo della telecamera e la relazione con le riprese adiacenti. Il modello comprende le convenzioni cinematografiche e genera transizioni appropriate.

Itera sulla coerenza del personaggio: Quando generi contenuti con personaggi ricorrenti, stabilisci l'aspetto del personaggio tramite immagini di riferimento iniziali, quindi mantieni la coerenza nelle generazioni successive facendo riferimento agli output precedenti.

Ottimizza l'integrazione audio: Per i contenuti ricchi di dialogo, fornisci descrizioni di script chiare con l'identificazione di chi parla. La sincronizzazione labiale a livello di fonema del modello funziona meglio con un'attribuzione esplicita del dialogo.

Best Practice per Sora 2

Descrizioni fisiche dettagliate: La simulazione fisica di Sora 2 risponde a descrizioni specifiche dei materiali. Invece di "una persona che salta", specifica "una persona con abiti larghi di cotone che salta su un trampolino, il tessuto che ondeggia a ogni rimbalzo". Il contesto fisico aggiuntivo consente una simulazione più accurata.

Specifica del movimento della telecamera: Descrivi esplicitamente i movimenti della telecamera, gli angoli e i cambiamenti di lunghezza focale. Sora 2 comprende la terminologia cinematografica e genera un comportamento appropriato della telecamera quando viene richiesto con istruzioni specifiche.

Perfezionamento iterativo: Utilizza l'interfaccia conversazionale di Sora 2 (quando accedi tramite ChatGPT) per perfezionare iterativamente gli output. Genera una versione iniziale, identifica gli elementi specifici che richiedono una regolazione e richiedi modifiche mirate.

Sfrutta la durata estesa: Approfitta della durata massima di 25 secondi di Sora 2 per inquadrature di stabilimento, sviluppo dei personaggi e ritmo emotivo che durate più brevi non possono accogliere.

Il panorama competitivo: Altri modelli degni di nota

Sebbene Seedance 2.0 e Sora 2 dominino le discussioni attuali, diversi altri modelli meritano considerazione per casi d'uso specifici:

Google Veo 3.1: Ottiene i punteggi di benchmark migliori per qualità visiva e accuratezza dell'illuminazione. Particolarmente forte per la visualizzazione di prodotti e contenuti in stile fotografia commerciale. I prezzi partono da circa $ 19,99/mese tramite il piano AI Ultra di Google.

Runway Gen-4: Offre una robusta integrazione API e strumenti di editing integrati. Una scelta solida per i team che richiedono una stretta integrazione con i flussi di lavoro di editing video esistenti. I prezzi variano in base ai livelli di utilizzo.

Kling 2.6: Dimostra prestazioni competitive nella qualità del movimento e nella coerenza del soggetto. Offre prezzi aggressivi per scenari di generazione ad alto volume.

HunyuanVideo: Alternativa open source che raggiunge prestazioni paragonabili ai modelli commerciali. Ideale per gli sviluppatori che richiedono il pieno controllo sulla distribuzione e sulla personalizzazione.

La diversità dei modelli disponibili riflette la maturazione della tecnologia di generazione video AI. Piuttosto che un'unica soluzione dominante, il mercato offre ora strumenti specializzati ottimizzati per diversi requisiti di produzione, vincoli di budget e obiettivi creativi.

Prospettive future: Cosa c'è in arrivo nel 2026 e oltre

Il mercato della generazione video AI continua a evolversi a un ritmo straordinario. Diverse tendenze plasmeranno il panorama per tutto il 2026:

Durata estesa: I modelli attuali raggiungono il limite a 20-25 secondi. Aspettati rapidi progressi verso capacità di generazione di 60 secondi e infine multi-minuto man mano che l'efficienza computazionale migliora.

Generazione in tempo reale: I tempi di generazione attuali variano da minuti a ore a seconda della complessità. Le tecniche di ottimizzazione emergenti promettono una generazione quasi in tempo reale, consentendo la sintesi video dal vivo e applicazioni interattive.

Capacità di fine-tuning: L'addestramento di modelli personalizzati su stili visivi specifici del marchio, librerie di personaggi e schemi di movimento consentirà una coerenza e un allineamento del marchio senza precedenti.

Interfacce di controllo migliorate: Oltre ai prompt di testo e alle immagini di riferimento, aspettati meccanismi di controllo sofisticati, tra cui composizione di scene 3D, editing basato su timeline e controlli di animazione parametrici.

Flussi di lavoro ibridi: L'integrazione tra generazione AI e strumenti di produzione video tradizionali sfumerà il confine tra filmati sintetici e catturati, consentendo flussi di lavoro di compositing e miglioramento senza soluzione di continuità.

Prendere la tua decisione: Un quadro per la selezione del modello

La scelta tra Seedance 2.0 e Sora 2 richiede una valutazione onesta dei tuoi requisiti specifici in più dimensioni:

Vincoli di budget: Se l'efficienza dei costi è fondamentale e il volume di produzione è elevato, Seedance 2.0 offre un valore notevolmente migliore. Per una produzione di alta qualità a basso volume in cui il costo per video è meno importante della qualità dell'output, Sora 2 può giustificare il suo prezzo premium.

Volume di produzione: La produzione di contenuti ad alto volume (oltre 50 video mensili) favorisce fortemente la struttura dei prezzi di Seedance 2.0. La produzione a basso volume (meno di 20 video mensili) può assorbire più facilmente il costo per video più elevato di Sora 2.

Tipo di contenuto: I contenuti di social media, pubblicitari e commerciali si allineano con i punti di forza di Seedance 2.0. I contenuti cinematografici, sperimentali e intensivi dal punto di vista fisico beneficiano delle capacità di Sora 2.

Requisiti tecnici: Se la generazione audio nativa, la coerenza multi-shot e il controllo basato su riferimenti sono fondamentali, Seedance 2.0 fornisce queste funzionalità pronte all'uso. Se il massimo realismo fisico e la durata estesa non sono negoziabili, Sora 2 offre prestazioni superiori.

Integrazione del flusso di lavoro: Considera la tua pipeline di produzione esistente. Se hai bisogno dell'integrazione API per flussi di lavoro automatizzati, valuta la maturità dell'API e la documentazione di ciascun modello. Se preferisci interfacce facili da usare per la generazione manuale, entrambi i modelli offrono piattaforme accessibili.

Disponibilità geografica: Sora 2 deve affrontare restrizioni geografiche che possono complicare l'accesso a seconda della tua posizione. L'espansione della disponibilità internazionale di Seedance 2.0 tramite piattaforme come Seedance 2 offre un accesso globale più coerente.

Conclusione: Lo strumento giusto per il lavoro giusto

La concorrenza tra Seedance 2.0 e Sora 2 rappresenta una sana maturazione della tecnologia di generazione video AI. Piuttosto che un'unica soluzione dominante, i creatori hanno ora accesso a strumenti specializzati ottimizzati per diverse filosofie di produzione e casi d'uso.

Seedance 2.0 eccelle come motore orientato alla produzione progettato per flussi di lavoro commerciali, iterazione rapida e creazione di contenuti conveniente su larga scala. La sua architettura di input multimodale, la generazione audio nativa, la coerenza multi-shot e i prezzi accessibili lo rendono la scelta ottimale per i creatori di social media, le agenzie pubblicitarie, le aziende di e-commerce e i produttori di contenuti che danno priorità all'efficienza e al volume.

Sora 2 si pone come leader del settore nella simulazione fisica, nella modellazione del mondo e nel realismo cinematografico. La sua gestione superiore delle interazioni fisiche complesse, la capacità di durata estesa e l'eccezionale comprensione dei prompt lo rendono la scelta preferita per registi sperimentali, contenuti di marchi premium, visualizzazione scientifica e progetti creativi in cui la fedeltà visiva giustifica un prezzo premium.

Per molti creatori professionisti e aziende, la strategia ottimale prevede di sfruttare entrambi i modelli tramite piattaforme multi-modello come SeaDance 2. Questo approccio offre la flessibilità di scegliere lo strumento giusto per ogni progetto specifico mantenendo un'integrazione del flusso di lavoro unificata e l'ottimizzazione dei costi.

La rivoluzione della generazione video AI è passata dalla fase sperimentale all'implementazione pratica della produzione. Che tu scelga Seedance 2.0, Sora 2 o un approccio multi-modello, la tecnologia ora esiste per trasformare i flussi di lavoro di produzione video, ridurre drasticamente costi e tempistiche e sbloccare possibilità creative che erano semplicemente impossibili solo pochi mesi fa.

La domanda non è più se la generazione video AI sia pronta per l'uso professionale: lo è dimostrabilmente. La domanda è quale strumento si allinea meglio con la tua visione creativa specifica, i requisiti di produzione e gli obiettivi aziendali. Con il confronto dettagliato fornito in questa guida, ora hai le informazioni necessarie per prendere quella decisione con sicurezza e strategia.

Pronto a sperimentare la generazione video AI all'avanguardia? Esplora Seedance AI per un accesso unificato a Seedance 2.0, Sora 2 e molteplici modelli di generazione video e immagine AI leader: tutto in una comoda piattaforma progettata per creatori professionisti e aziende.