Il panorama della generazione video AI ha subito un cambiamento sismico all'inizio del 2026, quando ByteDance ha rilasciato silenziosamente Seedance 2.0, scatenando un'ondata immediata di eccitazione – e ansia – in tutta la comunità dei creator. Nel giro di poche ore dal lancio, videografi professionisti, creatori di contenuti e appassionati di AI stavano segnalando risultati che sembravano quasi troppo belli per essere veri: coerenza dell'aspetto dei personaggi su più inquadrature, dinamiche di movimento di qualità cinematografica e sincronizzazione audio nativa che eliminava ore di lavoro di post-produzione.

Questa recensione completa di Seedance 2 esamina se l'ultimo modello video AI di ByteDance è all'altezza dell'hype, come si confronta con concorrenti come Sora 2 e Veo 3 e, soprattutto, se è lo strumento giusto per il tuo flusso di lavoro creativo.

Che cos'è Seedance 2? Comprendere l'ultimo modello video AI di ByteDance

Seedance 2 rappresenta la terza generazione della tecnologia di generazione video di ByteDance, basata sulle fondamenta stabilite da Seedance 1.0 e 1.5 Pro. A differenza dei suoi predecessori, Seedance 2 introduce un innovativo sistema di input multimodale che cambia radicalmente il modo in cui i creator interagiscono con la generazione video AI.

Fondamentalmente, Seedance 2 è un sistema AI pronto per la produzione che trasforma prompt di testo, immagini, video e audio in sequenze video di alta qualità. Ciò che lo distingue dai precedenti strumenti video AI è la sua capacità di mantenere la coerenza narrativa, la coerenza dei personaggi e il realismo fisico su più inquadrature – capacità che le generazioni precedenti faticavano a raggiungere in modo affidabile.

Il modello supporta sia la generazione text-to-video che image-to-video, con risoluzioni di output fino a 1080p e durate che vanno da 4 a 15 secondi per generazione. Ancora più importante, introduce ciò che ByteDance chiama "controllo a livello di regista", consentendo ai creator di specificare esattamente come i materiali di riferimento dovrebbero influenzare l'output finale.

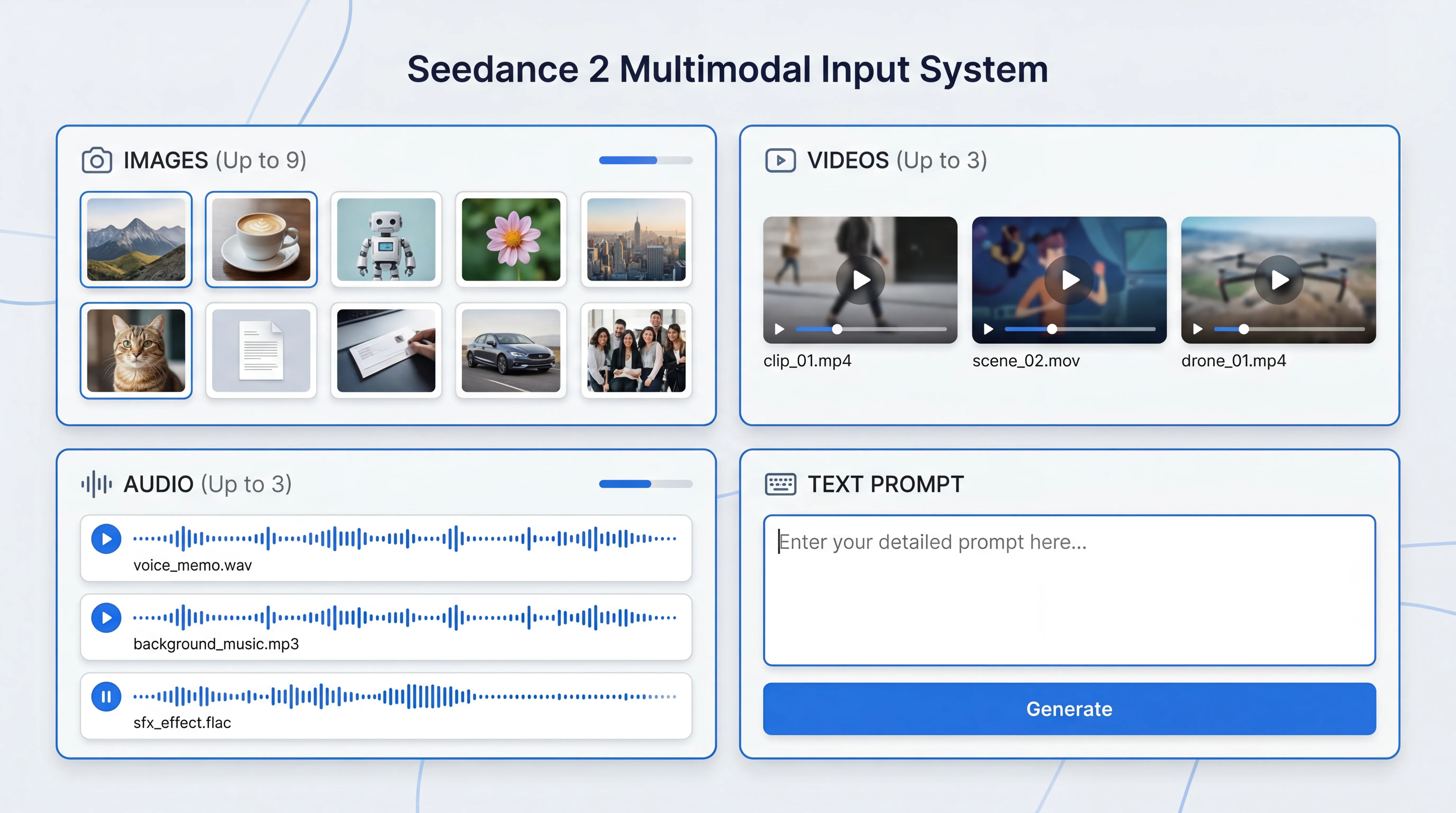

La rivoluzione multimodale: Come Seedance 2 cambia la creazione video

La caratteristica distintiva di Seedance 2 è il suo sistema di input quadrimodale, che accetta fino a 12 file di riferimento in una singola generazione:

-

Immagini (fino a 9): Bloccare l'aspetto dei personaggi, definire la composizione della scena, stabilire lo stile visivo

-

Video (fino a 3, max 15s ciascuno): Replicare i movimenti della telecamera, copiare sequenze d'azione, fare riferimento alle dinamiche di movimento

-

Audio (fino a 3, max 15s ciascuno): Sincronizzare il video ai ritmi musicali, abbinare i pattern ritmici, generare visual dal suono

-

Prompt di testo: Fornire contesto narrativo, specificare dettagli, guidare la direzione creativa

Questo approccio multimodale risolve uno dei problemi più frustranti nella generazione video AI: l'imprevedibilità. Invece di scrivere prompt di testo sempre più complessi e sperare che l'AI capisca la tua visione, ora puoi mostrare al modello esattamente cosa vuoi attraverso i materiali di riferimento.

Il sistema di menzione @: Controllo di precisione su ogni elemento

Seedance 2 introduce un intuitivo sistema di menzione @ che offre ai creator un controllo esplicito su come ogni risorsa caricata influenza la generazione. Nel tuo prompt di testo, puoi fare riferimento a file specifici e definire il loro scopo:

@Image1 come primo fotogramma, riferimento @Video1 per il movimento della telecamera,

usa @Audio1 per il ritmo della musica di sottofondoQuesto livello di specificità era precedentemente impossibile nella generazione video AI. Non sei più alla mercé dell'interpretazione del modello: lo stai dirigendo con una precisione paragonabile a quella di istruire una troupe cinematografica umana.

Capacità principali di Seedance 2: Cosa fa meglio

1. Coerenza dei personaggi che funziona davvero

La lamentela più comune sui generatori video AI è sempre stata la deriva del personaggio – il fenomeno per cui l'aspetto di un personaggio cambia in modo sottile (o drammatico) tra le inquadrature o anche all'interno di una singola sequenza. Seedance 2 affronta questo problema di petto con quella che i tester descrivono come coerenza del personaggio "bloccata".

Carica un'immagine di riferimento di un personaggio e Seedance 2 manterrà i tratti del viso, le proporzioni, l'abbigliamento e persino dettagli sottili come gli accessori di quel personaggio attraverso più generazioni. Questo non è un successo occasionale: è il comportamento predefinito. I creator riferiscono che la coerenza dei personaggi è ora abbastanza affidabile per applicazioni commerciali, inclusi contenuti di marca e storytelling narrativo.

2. Storytelling multi-shot con coerenza narrativa

Forse la capacità più impressionante è la generazione nativa multi-shot di Seedance 2. A differenza degli strumenti che producono clip isolate, Seedance 2 può generare sequenze con 2-3 transizioni di inquadratura in un singolo video di 10-15 secondi, complete di:

-

Transizioni fluide della telecamera tra campi lunghi, medi e primi piani

-

Illuminazione e atmosfera coerenti attraverso i tagli

-

Progressione narrativa logica che segue i ritmi della storia

-

Continuità mantenuta di personaggi e ambiente

Questo trasforma il video AI da un "generatore di clip" in un vero strumento di storytelling. Ora puoi creare scene complete con inizio, centro e fine, tutto in una generazione.

3. Movimento e realismo fisicamente accurati

Uno dei segni rivelatori del video generato dall'AI è stato storicamente il movimento innaturale: oggetti che non obbediscono alla gravità, liquidi che si comportano in modo strano o movimenti umani che sembrano robotici. Seedance 2 dimostra una comprensione sofisticata delle leggi fisiche:

-

Gravità e quantità di moto realistiche nel movimento degli oggetti

-

Dinamica dei fluidi naturale per acqua, fumo e altri effetti

-

Meccanica del corpo umano e distribuzione del peso credibili

-

Comportamento accurato della riflessione della luce e delle ombre

Il risultato è un video che supera il "test dell'occhio": gli spettatori non lo riconoscono immediatamente come generato dall'AI basandosi solo sulla qualità del movimento.

4. Sincronizzazione audio-visiva nativa

A differenza dei modelli precedenti che richiedevano una post-produzione audio separata, Seedance 2 genera audio sincronizzato insieme al contenuto video. Questo include:

-

Dialogo con sincronizzazione labiale accurata

-

Effetti sonori contestualmente appropriati

-

Audio ambientale che corrisponde alla scena

-

Generazione guidata dalla musica in cui i movimenti video si sincronizzano con i ritmi audio

Per i creator che lavorano su contenuti ricchi di dialoghi o video musicali, questa capacità audio nativa elimina ore di lavoro di sincronizzazione manuale.

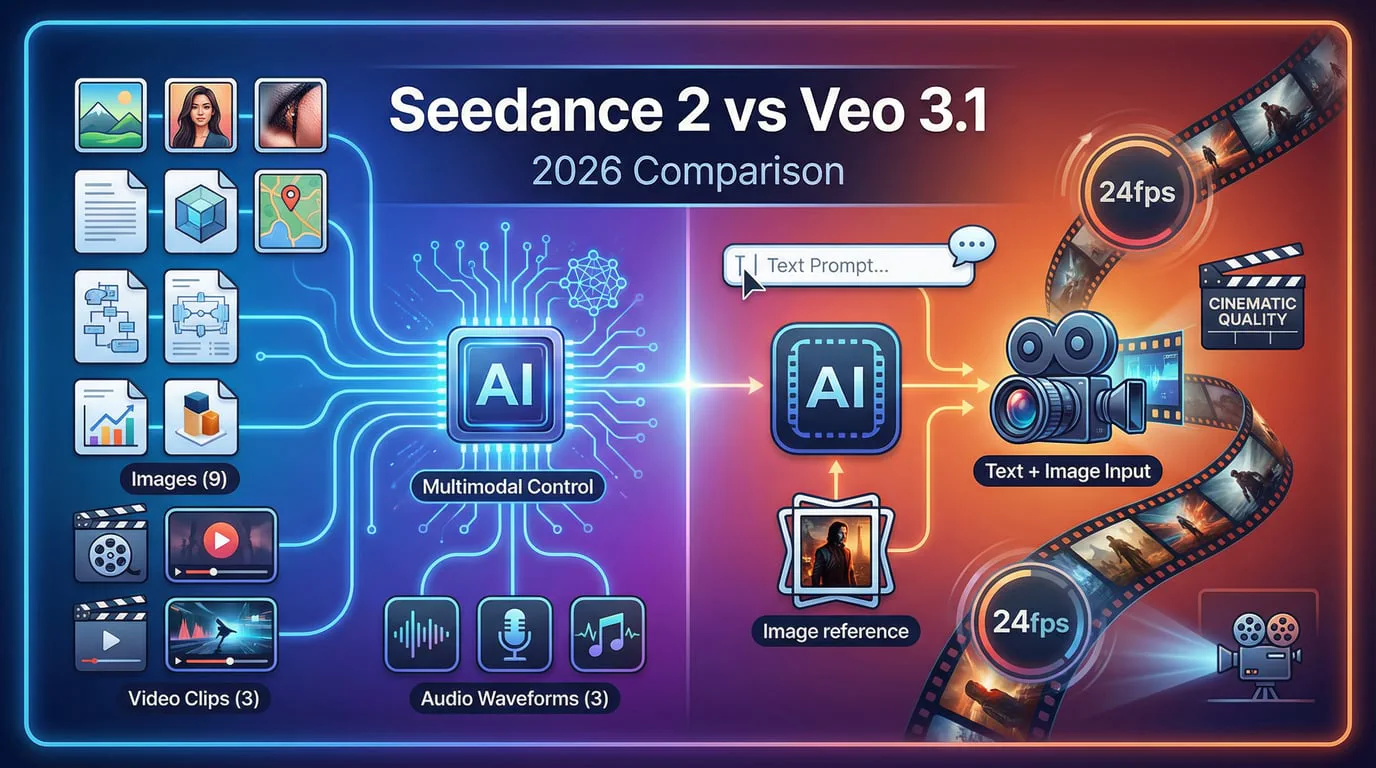

Seedance 2 vs Concorrenti: Come si confronta

| Funzionalità | Seedance 2 | Sora 2 | Veo 3.1 | Kling 3.0 |

|---|---|---|---|---|

| Durata Max | 15 secondi | 20 secondi | 8 secondi | 10 secondi |

| Risoluzione | 1080p | 1080p | 1080p | 1080p |

| Input Multimodale | 4 tipi (12 file) | Limitato | Limitato | 2 tipi |

| Coerenza Personaggio | Eccellente | Eccellente | Buona | Molto Buona |

| Multi-Shot Nativo | Sì (2-3 inquadrature) | Sì | No | No |

| Audio Nativo | Sì (dialogo + SFX) | Sì (completo) | Limitato | Sì |

| Velocità Generazione | 3-5 minuti | 4-7 minuti | 2-4 minuti | 3-6 minuti |

| Realismo Fisico | Molto Buono | Eccellente | Molto Buono | Buono |

| Prezzo per 10s | ~$3.00 | ~$1.50 | ~$2.00 | ~$2.50 |

Seedance 2 vs Sora 2: Il testa a testa

Il confronto più comune che fanno i creator è tra Seedance 2 e Sora 2 di OpenAI. Entrambi rappresentano l'attuale stato dell'arte nella generazione video AI, ma eccellono in aree diverse.

Vantaggi di Seedance 2:

-

Controllo multimodale superiore con il sistema di menzione @

-

Combinazioni di input più flessibili (12 file vs multimodale limitato di Sora)

-

Migliore replicazione dei modelli e trasferimento dello stile

-

Iterazione più rapida per testare più varianti creative

Vantaggi di Sora 2:

-

Durata massima più lunga (20 secondi vs 15)

-

Generazione audio più completa, inclusa la musica di sottofondo

-

Simulazione fisica leggermente migliore in scenari complessi

-

Output più fotorealistico in determinate condizioni di illuminazione

Il verdetto: Scegli Seedance 2 quando hai bisogno di un controllo preciso su elementi specifici e prevedi di utilizzare ampiamente materiali di riferimento. Scegli Sora 2 quando hai bisogno di clip più lunghe o stai creando contenuti che richiedono un'accuratezza fisica assoluta.

Seedance 2 vs Veo 3.1: Lo sfidante di Google

Veo 3.1 di Google adotta un approccio diverso, dando priorità al fotorealismo e alla qualità dell'illuminazione rispetto alla durata e alla flessibilità multimodale.

Seedance 2 vince su:

-

Durata (15s vs 8s)

-

Varietà di input multimodali

-

Generazione nativa multi-shot

-

Coerenza del personaggio tra le inquadrature

Veo 3.1 vince su:

-

Qualità di rendering fotorealistica

-

Precisione di illuminazione e ombre

-

Velocità di generazione

-

Color grading cinematografico

Veo 3.1 è ideale per showcase di prodotti e scenari che richiedono la massima fedeltà visiva in clip più brevi. Seedance 2 è migliore per contenuti narrativi e situazioni in cui è necessario mantenere la coerenza su più inquadrature.

Test nel mondo reale: Analisi delle prestazioni di Seedance 2

Per valutare Seedance 2 oltre le affermazioni di marketing, abbiamo condotto test approfonditi su più casi d'uso che rappresentano le esigenze comuni dei creator.

Test 1: Controllo dell'espressione del personaggio

Obiettivo: Generare un video che mostri sottili transizioni emotive da neutro a preoccupato a leggermente sorridente.

Metodo: Ritratto di un singolo personaggio come primo fotograma, prompt di testo dettagliato che specifica i cambiamenti di espressione con il timing.

Risultati: Seedance 2 ha renderizzato con successo micro-espressioni tra cui il movimento delle sopracciglia, la dilatazione delle pupille e la progressione controllata del sorriso. Le transizioni sono sembrate naturali piuttosto che esagerate. Critica minore: il sorriso tendeva leggermente al "professionale" piuttosto che al genuinamente caloroso, ma è rimasto entro parametri accettabili per la maggior parte delle applicazioni.

Tasso di successo: 8/10 generazioni hanno soddisfatto gli standard di qualità senza rigenerazione.

Test 2: Movimento complesso della telecamera

Obiettivo: Creare un'inquadratura push-in fluida da corpo intero a primo piano del viso, mantenendo a fuoco e composizione per tutto il tempo.

Metodo: Immagine di riferimento per il personaggio, descrizione dettagliata del movimento della telecamera nel prompt.

Risultati: Il movimento della telecamera è stato fluido senza scatti o incoerenze di velocità. Il modello ha mantenuto una messa a fuoco corretta durante tutto il push-in e l'inquadratura finale era ben composta. L'illuminazione è rimasta coerente dall'inizio alla fine.

Tasso di successo: 9/10 generazioni erano utilizzabili senza modifiche.

Test 3: Scena di combattimento multimodale

Obiettivo: Generare una sequenza d'azione combinando immagini dei personaggi, video di riferimento per la coreografia di combattimento e audio per il timing dell'impatto.

Metodo:

-

@Image1: Riferimento personaggio principale

-

@Image2: Riferimento avversario

-

@Video1: Riferimento arti marziali per lo stile di movimento

-

@Audio1: Effetti sonori di impatto per il timing

-

Prompt di testo: Coreografia di combattimento dettagliata

Risultati: Questo è stato il test più ambizioso e i risultati sono stati misti. Quando ha avuto successo, Seedance 2 ha prodotto un'azione notevolmente coerente con un timing adeguato ai segnali audio. La coerenza del personaggio ha retto anche durante i movimenti rapidi. Tuttavia, scene complesse con più soggetti hanno richiesto 2-3 tentativi per ottenere i risultati desiderati.

Tasso di successo: 6/10 generazioni hanno soddisfatto gli standard, ma gli output riusciti erano di qualità eccezionale.

Test 4: Replicazione di template

Obiettivo: Replicare un formato video di tendenza utilizzando solo un video di riferimento e nuove immagini dei personaggi.

Metodo: Caricare un template video di tendenza come @Video1, specificare nuovi personaggi tramite @Image1 e @Image2, prompt di testo minimo.

Risultati: Seedance 2 ha eccelso in questo compito, catturando accuratamente il ritmo, le transizioni e la struttura generale del video di riferimento integrando perfettamente i nuovi personaggi. Questa capacità è particolarmente preziosa per i creator di social media che devono adattare rapidamente i formati di tendenza.

Tasso di successo: 9/10 generazioni hanno replicato con successo la struttura del template.

Applicazioni pratiche: Chi dovrebbe usare Seedance 2?

Creator di social media

Le capacità di replicazione dei template e di iterazione rapida di Seedance 2 lo rendono ideale per i creatori di contenuti che devono produrre grandi volumi di video in formato di tendenza. La capacità di mantenere la coerenza dei personaggi su più video consente di costruire contenuti di marca riconoscibili.

Migliori casi d'uso:

-

Adattamenti di formati di tendenza

-

Serie di storytelling basate sui personaggi

-

Video dimostrativi di prodotti

-

Contenuti educativi con presentatore coerente

Professionisti del marketing e della pubblicità

Il sistema di controllo multimodale consente ai marketer di mantenere la coerenza del marchio testando rapidamente più varianti creative. La generazione audio nativa riduce significativamente i tempi di produzione.

Migliori casi d'uso:

-

Video vetrina prodotti

-

Contenuti di brand storytelling

-

Test A/B di concetti creativi

-

Variazioni di annunci sui social media

Registi indipendenti e animatori

La capacità narrativa multi-shot e la coerenza dei personaggi consentono ai creator di produrre cortometraggi e contenuti animati che in precedenza erano impossibili senza risorse di produzione tradizionali.

Migliori casi d'uso:

-

Pre-visualizzazione di cortometraggi

-

Produzione di serie animate

-

Creazione di video musicali

-

Dimostrazioni proof-of-concept

Creator di e-commerce e prodotti

Per le aziende che vendono prodotti fisici, Seedance 2 consente la rapida creazione di video dimostrativi senza costosi servizi fotografici.

Migliori casi d'uso:

-

Dimostrazioni delle funzionalità del prodotto

-

Video tutorial sull'utilizzo

-

Video di contesto lifestyle

-

Contenuti di confronto

Limitazioni e considerazioni

Nonostante le sue impressionanti capacità, Seedance 2 ha notevoli limitazioni che i creator dovrebbero comprendere:

1. Vincoli di durata

Il massimo di 15 secondi per generazione richiede pianificazione per contenuti più lunghi. Mentre la funzione di estensione video aiuta, la creazione di narrazioni di oltre 60 secondi richiede più generazioni e un'attenta gestione della continuità.

2. Sfide delle scene complesse

Le scene con più personaggi che eseguono azioni simultanee diverse sfidano ancora il modello. I tassi di successo diminuiscono quando si superano i 2-3 soggetti principali con sequenze d'azione indipendenti.

3. Testo e tipografia

Sebbene migliorata rispetto alle versioni precedenti, la generazione di testo sullo schermo rimane incoerente. Per i contenuti che richiedono una tipografia precisa, pianifica di aggiungere testo in post-produzione.

4. Controllo motorio fine

I movimenti dettagliati delle mani, in particolare per attività come suonare strumenti o digitare, non corrispondono ancora al realismo di livello umano. Le inquadrature larghe funzionano meglio dei primi piani estremi delle mani.

5. Costo di generazione

A circa $3 per video di 10 secondi, i costi possono accumularsi rapidamente durante la fase di iterazione. I creator attenti al budget dovrebbero pianificare le generazioni con attenzione e utilizzare modelli a basso costo per i test iniziali.

6. Curva di apprendimento

La potenza del sistema multimodale comporta complessità. I nuovi utenti hanno bisogno di tempo per comprendere le combinazioni ottimali di file e le strutture dei prompt. Aspettati un periodo di apprendimento di 10-20 generazioni prima di ottenere risultati coerenti.

Come iniziare con Seedance 2

Seedance 2 è accessibile attraverso più piattaforme, ma per il set di funzionalità più completo e l'integrazione fluida del flusso di lavoro, consigliamo di utilizzare SeaDanceAI.com.

Guida rapida

Passaggio 1: Prepara le tue risorse

-

Raccogli immagini di riferimento (PNG o JPG, consigliata alta risoluzione)

-

Prepara video di riferimento se necessario (MP4, max 15 secondi)

-

Tieni pronti i file audio se usi la sincronizzazione del ritmo (MP3 o WAV, max 15 secondi)

Passaggio 2: Struttura il tuo prompt

-

Inizia con l'azione centrale o la narrazione

-

Usa menzioni @ per fare riferimento a file specifici

-

Specifica movimenti della telecamera e transizioni

-

Includi descrittori di stile e umore

Passaggio 3: Configura le impostazioni di generazione

-

Seleziona la durata (4-15 secondi)

-

Scegli le proporzioni in base alla piattaforma (16:9 per YouTube, 9:16 per TikTok/Reels)

-

Imposta il livello di qualità (standard per i test, alto per l'output finale)

Passaggio 4: Generare e iterare

-

Rivedi l'output iniziale

-

Identifica gli elementi da regolare

-

Affina il prompt o modifica i materiali di riferimento

-

Rigenera con modifiche

Best practice per risultati ottimali

1. Inizia semplice, poi aggiungi complessità

Inizia con generazioni di base text-to-video o a immagine singola prima di incorporare più file di riferimento. Questo ti aiuta a comprendere il comportamento di base del modello.

2. Utilizza materiali di riferimento di alta qualità

Il modello può lavorare solo con la qualità che fornisci. Usa immagini di riferimento chiare e ben illuminate e file audio puliti per ottenere i migliori risultati.

3. Sii specifico sul timing

Quando descrivi sequenze d'azione, specifica il timing: "Nei primi 3 secondi... poi per i successivi 5 secondi... infine..."

4. Sfrutta la funzione di estensione

Per narrazioni più lunghe, genera prima la sequenza di apertura, quindi usa l'estensione video per continuare la storia mantenendo la continuità.

5. Crea una libreria di riferimento

Costruisci una raccolta di video di riferimento di successo per movimenti della telecamera, immagini dei personaggi per personaggi coerenti e clip audio per pattern ritmici comuni.

Prezzi e accessibilità di Seedance 2

Seedance 2 è disponibile attraverso diverse piattaforme con diverse strutture di prezzo:

Piattaforme ufficiali:

-

Jimeng (即梦): Richiede un abbonamento mensile di 119 yuan (~$17) per l'accesso standard

-

Xiaoyunque (小云雀): Piattaforma alternativa ByteDance con prezzi simili

-

Seedance 2: Sistema flessibile basato su crediti a partire da $0.30 al secondo

Confronto costi:

-

Video di 10 secondi: ~$3.00

-

Video di 5 secondi: ~$1.50

-

Estensione video (5s): ~$1.50

Per i creator professionisti che producono più video al giorno, i modelli di abbonamento offrono un valore migliore. Per gli utenti occasionali o coloro che testano la piattaforma, i sistemi basati su crediti offrono maggiore flessibilità.

Il futuro della generazione video AI: Dove si colloca Seedance 2

Seedance 2 rappresenta un punto di svolta critico nella generazione video AI. È il primo modello che sembra davvero pronto per la produzione per applicazioni commerciali, non solo per la creazione di contenuti sperimentali.

Il passaggio da "text-to-video" a "multimodal-to-video" cambia radicalmente il processo creativo. Invece di cercare di descrivere tutto a parole, i creator possono ora comunicare attraverso il linguaggio universale del riferimento visivo – lo stesso modo in cui i registi umani lavorano con direttori della fotografia e attori.

Tuttavia, questo alza anche l'asticella per ciò che costituisce un lavoro creativo di valore. Quando l'esecuzione tecnica diventa accessibile a tutti, i fattori di differenziazione diventano:

-

Abilità curatoriale: Trovare i giusti materiali di riferimento

-

Abilità narrativa: Strutturare storie avvincenti

-

Giudizio estetico: Riconoscere la qualità e prendere decisioni di perfezionamento

-

Pensiero strategico: Capire quale contenuto serve ai tuoi obiettivi

Seedance 2 non sostituisce queste capacità umane: le amplifica. I creator che prospereranno saranno quelli che combineranno una forte visione creativa con la competenza tecnica in questi nuovi strumenti.

Verdetto finale: Seedance 2 ne vale la pena?

Seedance 2 riceve una forte raccomandazione per:

✅ Creator di social media che necessitano di una produzione di contenuti ad alto volume

✅ Professionisti del marketing che richiedono variazioni video coerenti con il marchio

✅ Registi indipendenti che esplorano lo storytelling assistito dall'AI

✅ Aziende di prodotti che creano contenuti dimostrativi

✅ Chiunque sia frustrato dall'incoerenza dei personaggi in altri strumenti video AI

Considera alternative se hai bisogno di:

❌ Video più lunghi di 20 secondi in una singola generazione (considera Sora 2)

❌ Fotorealismo massimo assoluto (considera Veo 3.1)

❌ Ampio controllo manuale su ogni fotogramma (considera Runway)

❌ Sperimentazione economica (inizia con alternative di livello gratuito)

In conclusione: Seedance 2 mantiene la sua promessa di controllo a livello di regista nella generazione video AI. Il suo sistema di input multimodale risolve davvero i problemi di coerenza e controllabilità che hanno afflitto il campo. Sebbene non sia perfetto (nessuno strumento video AI lo è), rappresenta l'attuale stato dell'arte nel bilanciare qualità, controllo e usabilità pratica.

Per i creator pronti a integrare il video AI nei flussi di lavoro professionali, Seedance 2 non è più solo un'opzione: sta diventando essenziale. La domanda non è se la generazione video AI trasformerà la creazione di contenuti, ma se sarai tra i primi ad adottare questi strumenti mentre il vantaggio competitivo esiste ancora.

Pronto a provare le capacità di Seedance 2? Inizia con la piattaforma più completa per la generazione video AI su Seedance 2, dove troverai non solo Seedance 2, ma l'accesso a più modelli di generazione video e immagini all'avanguardia in un unico comodo spazio di lavoro.

Ultimo aggiornamento: Febbraio 2026. La tecnologia di generazione video AI si evolve rapidamente. Torna regolarmente per aggiornamenti su nuove funzionalità e capacità.