Il panorama della generazione di video IA ha subito un cambiamento epocale con l'arrivo di Seedance 2.0, il rivoluzionario modello video multimodale di ByteDance. Rilasciato nel febbraio 2026, questo non è solo un altro aggiornamento incrementale: rappresenta una rivisitazione fondamentale del modo in cui i creatori interagiscono con gli strumenti video AI. Mentre concorrenti come Sora 2, Veo 3.1 e Kling 3.0 continuano a perfezionare i loro approcci, Seedance 2.0 introduce un sistema di controllo a livello di regista che trasforma la generazione di video da congetture a produzione cinematografica di precisione.

Per i creatori frustrati dalla natura "scatola nera" degli strumenti video IA di prima generazione, in cui dovevi digitare un messaggio, incrociare le dita e sperare che l'output corrispondesse alla tua visione, Seedance 2.0 offre un paradigma radicalmente diverso. Attraverso il suo innovativo sistema @reference e l'architettura multimodale, ora puoi orchestrare ogni elemento del tuo video con lo stesso livello di controllo che un regista esercita sul set. Questa guida ti mostrerà esattamente come sfruttare questa potenza, con strutture pratiche, approfondimenti tecnici e strategie tratte da test nel mondo reale e feedback della community.

Cosa rende Seedance 2.0 diverso dagli altri modelli video AI

Comprendere l'architettura unica di Seedance 2.0 è essenziale prima di immergersi nelle tecniche di prompt. A differenza dei tradizionali modelli testo-video che trattano le istruzioni come vaghi suggerimenti, Seedance 2.0 impiega un trasformatore di diffusione a doppio ramo che elabora simultaneamente i dati visivi e audio. Questa scelta architettonica elimina il problema comune della deriva audiovisiva, dove i passi non si sincronizzano con il camminare o le esplosioni sembrano disconnesse dal loro impatto visivo.

Il sistema di input multimodale del modello accetta fino a 12 file di riferimento in un'unica generazione: 9 immagini per personaggi, ambienti e riferimenti di stile; 3 videoclip per un totale di 15 secondi per movimenti di telecamera e coreografie d'azione; e 3 file audio per un totale di 15 secondi per musica, dialoghi ed effetti sonori. Ogni riferimento può essere taggato e indirizzato in modo specifico utilizzando il sistema di notazione @reference, offrendoti un controllo granulare su come ciascun elemento influenza l'output finale.

Ciò che distingue veramente Seedance 2.0 è la sua comprensione della fisica del mondo reale. Il modello non si limita ad animare gli oggetti, ma simula il modo in cui si comportano sotto forze fisiche. Quando descrivi un'auto alla deriva, Seedance 2.0 calcola la distribuzione del peso, l'attrito degli pneumatici e la quantità di moto. Quando richiedi la caduta di detriti, comprende la gravità, la dinamica delle collisioni e le proprietà dei materiali. Questa generazione sensibile alla fisica produce video che sembrano autentici piuttosto che artificialmente fluidi, una distinzione fondamentale per le applicazioni professionali.

Seedance AI offre ai creatori l'accesso a questa tecnologia all'avanguardia attraverso una piattaforma intuitiva che integra più modelli all'avanguardia di generazione di video e immagini. Con Seedance AI, puoi sfruttare le potenti funzionalità di Seedance 2.0 insieme ad altri strumenti leader del settore, il tutto all'interno di un unico flusso di lavoro semplificato progettato per la massima efficienza creativa.

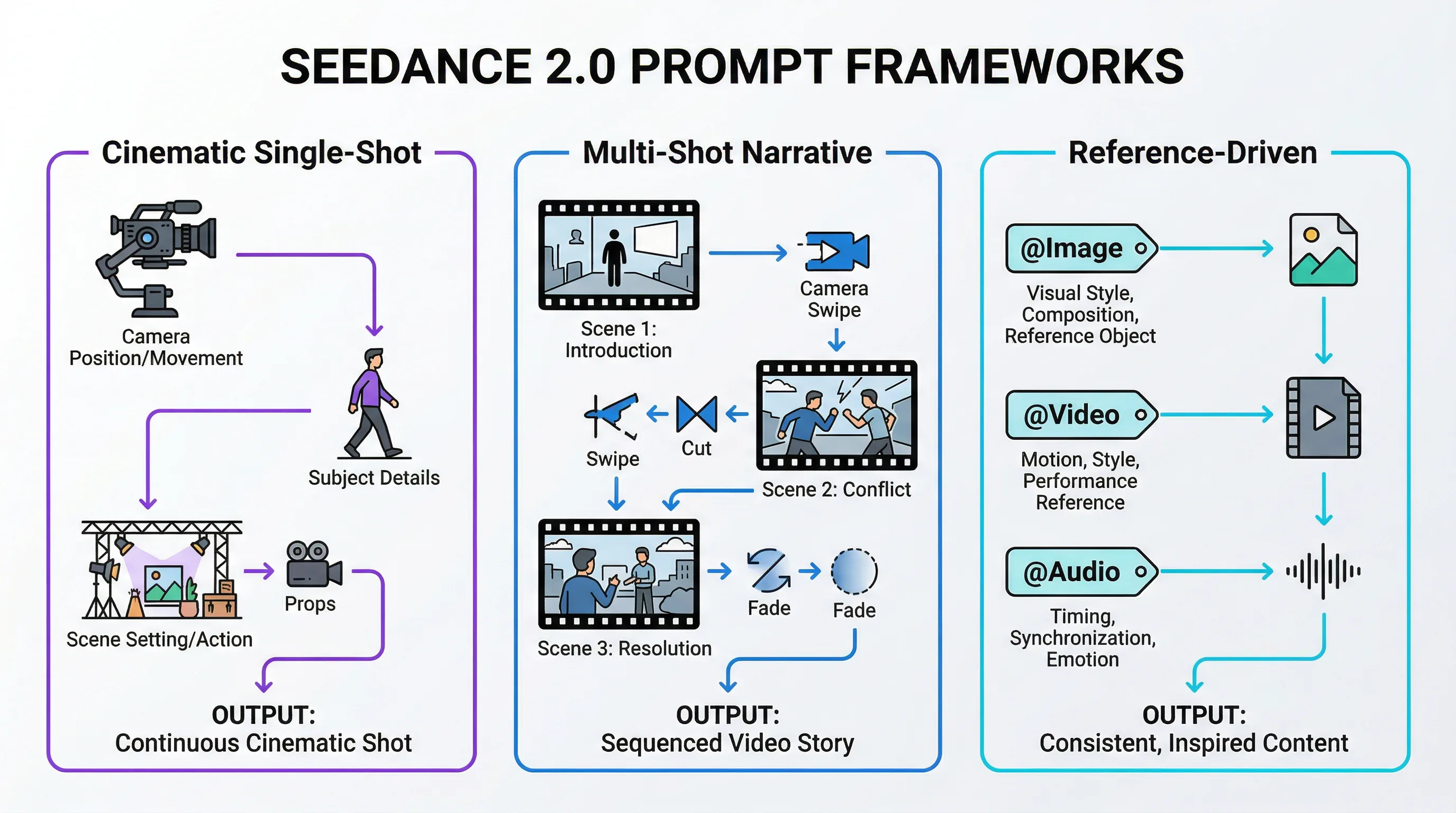

I tre framework di prompt principali che funzionano davvero

Dopo approfonditi test comunitari e analisi delle generazioni di successo, sono emersi tre modelli tempestivi come base per risultati coerenti e di alta qualità. Questi non sono modelli arbitrari: sono modelli strutturali che si allineano al modo in cui l'architettura neurale di Seedance 2.0 interpreta le istruzioni.

Quadro 1: La struttura cinematografica dell'inquadratura singola

Questa struttura funziona meglio per sequenze d'azione continue e momenti emotivamente risonanti in cui è fondamentale mantenere la coerenza visiva per l'intera durata.

Logica di base: Soggetto + Scena/Atmosfera + Azione/Performance + Movimento della telecamera + Stile/Illuminazione

Suggerimento di esempio:

"Una giovane donna con una giacca di pelle rossa sta sul bordo di un tetto bagnato di pioggia di notte, le insegne al neon si riflettono in pozzanghere intorno ai suoi piedi. Si gira lentamente verso la telecamera, il vento le scompiglia i capelli, mentre un tuono lontano rimbomba. La telecamera si tira indietro con un movimento fluido come il carrello, rivelando il vasto paesaggio urbano cyberpunk dietro di lei. Illuminazione cinematografica con contrasto elevato, consistenza della grana della pellicola, gradazione di colore lunatica con toni verde acqua e arancione."

Questa struttura fornisce Seedance 2.0 risposte chiare alle domande che la sua architettura deve risolvere: chi o cosa è il soggetto? Dove avviene questo? Cosa succede durante lo scatto? Come lo cattura la fotocamera? Qual è l'estetica visiva? Quando questi elementi sono definiti esplicitamente, il modello può allocare le sue risorse computazionali in modo efficiente anziché fare ipotesi.

Quadro 2: La sequenza narrativa a più riprese

La capacità unica di Seedance 2.0 di generare video con tagli e transizioni naturali in un unico output di 15 secondi rende questo framework particolarmente potente per le applicazioni di narrazione.

Logica di base: Descrizione inquadratura 1 -> Indicazione di transizione -> Descrizione inquadratura 2 -> (opzionale) Descrizione inquadratura 3

Suggerimento di esempio:

"Inquadratura 1: primo piano di mani che assemblano un dispositivo meccanico, movimenti precisi, illuminazione dall'alto che proietta ombre nette. Taglio su: ripresa media del laboratorio di un inventore ingombro di progetti e strumenti, il dispositivo ora completo sul banco da lavoro. Taglio su: campo lungo attraverso la finestra del laboratorio mentre un'esplosione di luce erutta dal dispositivo, illuminando l'intera stanza. Riprese rapide con energia crescente, fotocamera a mano in stile documentaristico, calda illuminazione al tungsteno che passa alla fredda luce blu."

La chiave del successo di questo framework risiede nell'utilizzo di segnali di transizione espliciti ("Taglia a", "Transizione a", "Sposta a") che segnalano i confini dell'inquadratura al modello. Senza questi marcatori, Seedance 2.0 potrebbe tentare di creare movimenti fluidi della fotocamera tra composizioni che dovrebbero essere inquadrature distinte, risultando in fotogrammi intermedi scomodi.

Quadro 3: La composizione guidata dai riferimenti

Questo framework avanzato sfrutta il sistema @reference di Seedance 2.0 per ottenere un controllo senza precedenti su specifici elementi visivi, schemi di movimento e sincronizzazione audio.

Logica di base: Descrizione di base + Riferimenti @Immagine per elementi visivi + Riferimenti @Video per il movimento + Riferimenti @Audio per il ritmo

Suggerimento di esempio:

"Un ballerino esegue una coreografia contemporanea in un magazzino abbandonato. Usa @Image1 come riferimento al personaggio per l'aspetto e il costume del ballerino. Fai riferimento a @Video1 per lo stile di movimento fluido ed espressivo, in particolare le estensioni delle braccia e il lavoro sul pavimento. Applica @Image2 per l'ambiente di un magazzino industriale con finestre rotte e spettacolari fasci di luce. Sincronizza i ritmi del movimento con il ritmo musicale di @Audio1. La telecamera esegue una rotazione a 360 gradi orbita attorno al ballerino, mantenendo una distanza media, illuminazione ad alto contrasto con raggi di luce volumetrici, tavolozza di colori desaturati con colore selettivo sul costume del ballerino.

Questo quadro richiede un'attenta preparazione: i file di riferimento devono essere di alta qualità (minimo 1080p per le immagini, azioni chiare nei riferimenti video) e concettualmente allineati. Il modello offre prestazioni migliori quando i riferimenti servono a scopi distinti anziché sovrapporsi. Ad esempio, non utilizzare più immagini che tentano tutte di definire il personaggio; usane invece uno per il carattere, uno per l'ambiente e uno per lo stile di illuminazione.

Parametri e impostazioni tecnici che influiscono sulla qualità dell'output

Oltre alla struttura immediata, la comprensione dei parametri tecnici di Seedance 2.0 consente di ottimizzare per casi d'uso specifici e requisiti di qualità.

Selezione della risoluzione e del rapporto d'aspetto

Seedance 2.0 genera video con risoluzioni fino a 1080p, anche se è importante notare che la risoluzione nativa effettiva della generazione è 720p, che viene quindi aumentata. Questa distinzione è importante per le applicazioni professionali in cui sono richieste la gradazione del colore e l'integrazione post-produzione. La profondità di colore limitata rispetto ai filmati nativi 1080p o 4K può creare sfide quando si abbinano contenuti generati dall'intelligenza artificiale con materiale filmato tradizionalmente.

Il modello supporta sei proporzioni, ciascuna ottimizzata per diversi canali di distribuzione:

| Proporzioni | Miglior caso d'uso | Qualità della generazione |

|---|---|---|

| 16:9 | YouTube, video tradizionale, contenuti orizzontali | Eccellente: la maggior parte dei dati di allenamento |

| 9:16 | TikTok, Instagram Reels, contenuto mobile verticale | Eccellente: ottimizzato per i social |

| 4:3 | Estetica vintage, contenuti nostalgici, format televisivo | Buono: meno comune ma supportato |

| 3:4 | Stile fotografico di ritratto, vetrine di prodotti | Buono: verticale con più spazio per la testa |

| 21:9 | Widescreen cinematografico, composizioni drammatiche | Eccellente: vera sensazione cinematografica |

| 1:1 | Instagram post di feed, video del profilo, composizioni simmetriche | Buono: flessibilità del formato quadrato |

La scelta delle giuste proporzioni non riguarda solo il luogo in cui pubblicherai, ma influisce anche sul modo in cui Seedance 2.0 compone lo scatto. Il modello ha appreso diverse convenzioni compositive per ciascun rapporto, quindi un suggerimento di 21:9 favorirà naturalmente inquadrature più ampie e movimenti orizzontali, mentre i suggerimenti di 9:16 tendono verso l'azione verticale e l'inquadratura orientata al ritratto.

Strategia di durata: clip da 4 secondi contro sequenze da 15 secondi

Seedance 2.0 offre durate di generazione da 4 a 15 secondi, ma la scelta ottimale dipende dalla complessità del contenuto e dall'uso previsto.

4-7 Seconde Generazioni:

-

Ideale per: ritmi di azione singola, riprese di reazione, riprese di scena, clip di social media

-

Vantaggi: maggiore coerenza, minori opportunità di deriva, tempi di generazione più rapidi

-

Approccio rapido: concentrarsi su un'azione o un momento chiaro

10-15 seconde generazioni:

-

Ideale per: sequenze multi-ripresa, archi narrativi, coreografie complesse, segmenti di video musicali

-

Vantaggi: ritmo naturale, spazio per le transizioni delle inquadrature, ritmi della storia completi

-

Approccio rapido: struttura con chiara suddivisione inizio-metà-fine o inquadratura per inquadratura

Per i progetti che richiedono contenuti più lunghi, il flusso di lavoro consigliato è generare segmenti di 15 secondi e utilizzare i fotogrammi finali come materiale di riferimento per la generazione successiva, creando estensioni senza interruzioni. Questa tecnica mantiene la coerenza visiva aggirando il limite di lunghezza di una sola generazione.

Tecniche di suggerimento avanzate: controllo della telecamera e dinamica del movimento

Una delle capacità più apprezzate di Seedance 2.0 è la sua sofisticata comprensione della cinematografia. Il modello risponde accuratamente alla terminologia della fotocamera professionale, consentendoti di dirigere le riprese con lo stesso linguaggio che utilizzeresti con un vero operatore della macchina da presa.

Movimenti della fotocamera professionali che funzionano

Seedance 2.0 esegue un lavoro complesso con la fotocamera che i precedenti modelli video AI faticavano a interpretare correttamente. Ecco i movimenti che producono costantemente risultati eccellenti:

Movimenti del carrello:

-

"Dolly in" o "Push in": la fotocamera si sposta in avanti verso il soggetto

-

"Dolly out" o "Pull back": la telecamera si sposta all'indietro, rivelando più contesto

-

"Dolly zoom" o "Effetto Vertigo" - Zoom simultaneo e dolly in direzioni opposte

Tracciamento e seguito:

-

"Scatto con tracciatura seguendo [soggetto]" - La fotocamera si sposta accanto al soggetto

-

"Scatto successivo a mano libera": aggiunge un tremolio naturale e una sensazione umana

-

"Steadicam glide" - Movimento fluido e fluttuante nello spazio

Movimenti di rotazione:

-

"Orbita a 360 gradi attorno a [soggetto]" - Movimento circolare mantenendo la distanza

-

"Gru su e giù" - Sollevamento verticale seguito da un'inclinazione in avanti

-

"Cambio POV da [A] a [B]" - Cambio di prospettiva a metà inquadratura

Tecniche di concentrazione:

-

"Messa a fuoco rack da [primo piano] a [sfondo]" - Sposta il piano di messa a fuoco

-

"Profondità di campo ridotta su [soggetto]" - Sfondo sfocato, soggetto nitido

-

"Messa a fuoco profonda mantenendo la nitidezza ovunque" - Tutto a fuoco

La chiave per una direzione efficace della telecamera è la specificità. Piuttosto che "movimenti della telecamera", descrivi "carrello lento in più di 8 secondi" o "ripresa con tracciamento manuale con leggero rimbalzo verticale". Quanto più precisamente definisci il carattere, la velocità e la traiettoria del movimento, tanto più accuratamente Seedance 2.0 lo eseguirà.

Richiesta di azioni basate sulla fisica

Il motore di simulazione fisica di Seedance 2.0 richiede suggerimenti che riconoscano le forze del mondo reale e le proprietà dei materiali. Le descrizioni generiche delle azioni producono risultati generici; il linguaggio specifico della fisica produce dinamiche convincenti.

Invece di: "Un'auto svolta bruscamente"

Scrivere: "Gli pneumatici dell'auto fumano mentre devia di 90 gradi, la parte posteriore scivola fuori mentre le ruote anteriori mantengono l'aderenza, il peso si sposta visibilmente verso l'esterno"

Invece di: "Gli oggetti cadono dallo scaffale"

Scrivi: "Le bottiglie di vetro cadono dallo scaffale in sequenza, frantumandosi all'impatto con il pavimento, i frammenti si disperdono verso l'esterno con slancio realistico"

Invece di: "Il tessuto si muove nel vento"

Scrivi: "Il tessuto di seta si gonfia e si increspa nel vento, il materiale leggero cattura l'aria e fluttua prima di depositarsi, i bordi più pesanti si tirano verso il basso"

Questo suggerimento basato sulla fisica indica a Seedance 2.0 quali principi fisici dare la priorità nella sua simulazione. Il modello comprende concetti come quantità di moto, attrito, gravità, elasticità e dinamica delle collisioni, ma è necessario invocarli esplicitamente nel prompt per attivare tale comprensione.

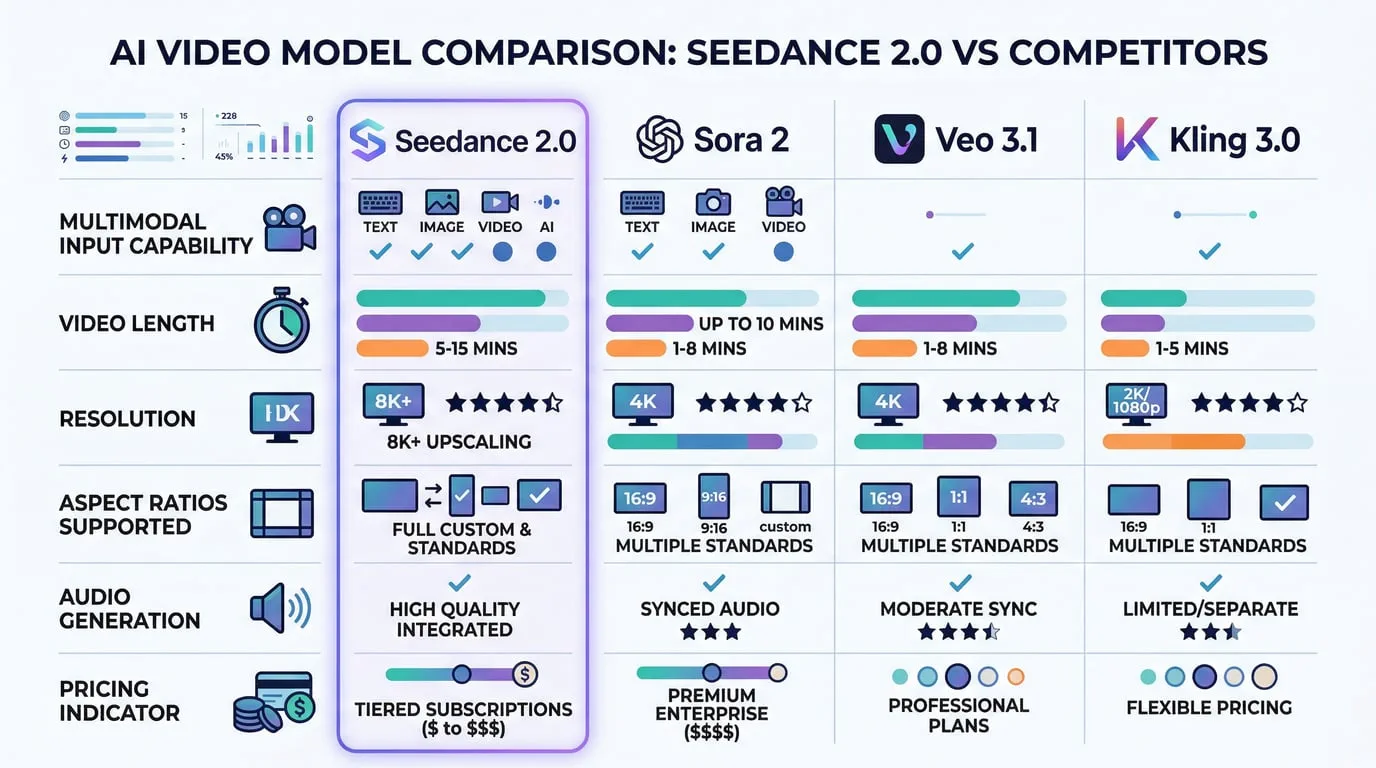

Analisi comparativa: Seedance 2.0 rispetto ai modelli concorrenti

Capire dove Seedance 2.0 eccelle rispetto alla concorrenza ti aiuta a scegliere lo strumento giusto per ogni progetto e a stabilire aspettative realistiche per la qualità dell'output.

Seedance 2.0 rispetto a Sora 2 (OpenAI)

Sora 2 ha costruito la sua reputazione sulla fisica di prima generazione e sulla sottigliezza emotiva. Il modello eccelle nella creazione di video in cui oggetti e ambienti si comportano con convinzione fisica: la gravità funziona correttamente, i materiali rispondono in modo autentico e il movimento sembra radicato nella realtà. Per gli scatti che richiedono emozioni umane naturalistiche o sottili interazioni ambientali, Sora 2 spesso produce risultati più sfumati.

Tuttavia, Seedance 2.0 supera Sora 2 in diverse aree critiche. Il sistema di riferimento multimodale offre un controllo creativo molto maggiore: puoi specificare direttamente schemi di movimento, aspetto dei personaggi e sincronizzazione audio invece di sperare che il modello interpreti correttamente il tuo messaggio di testo. Seedance 2.0 genera anche clip più lunghi (fino a 15 secondi rispetto al limite tipico di 10 secondi di Sora 2) e offre un supporto delle proporzioni più flessibile. I prezzi favoriscono fortemente Seedance 2.0, con costi per generazione significativamente inferiori.

Utilizzare Seedance 2.0 per: Lavori creativi ricchi di riferimenti, sequenze d'azione, contenuti stilizzati, narrazioni con più inquadrature, progetti attenti al budget

Utilizzare Sora 2 per: Scatti che richiedono convinzione fisica, finezza emotiva, comportamento umano naturalistico, quando si preferiscono suggerimenti di solo testo

Seedance 2.0 contro Veo 3.1 (Google)

Il Veo 3.1 di Google trae vantaggio dalla stretta integrazione con l'infrastruttura Vertex AI di Google Cloud, rendendolo interessante per le implementazioni aziendali e gli sviluppatori già integrati nell'ecosistema Google. Veo offre eccellenti capacità di risoluzione e ottime prestazioni sui contenuti architettonici e ambientali.

Le valutazioni della community rivelano una qualità del movimento incoerente in Veo 3.1, in particolare per sequenze di azioni complesse e animazioni di personaggi. La stabilità del movimento e la coerenza fotogramma per fotogramma di Seedance 2.0 generalmente superano Veo, soprattutto per i contenuti che coinvolgono figure umane, animali o lavori dinamici con la telecamera. Il sistema @reference in Seedance 2.0 fornisce inoltre un controllo più diretto su elementi visivi specifici rispetto al modello di input di testo e immagine di Veo.

Utilizzare Seedance 2.0 per: Animazione di personaggi, sequenze di azioni, progetti che richiedono controllo basato su riferimenti, lavoro creativo autonomo

Utilizza Veo 3.1 per: Distribuzioni aziendali, integrazione Google Cloud, visualizzazione dell'architettura, quando l'infrastruttura GCP è già installata

Seedance 2.0 contro Kling 3.0 (Kuaishou)

Kling 3.0 si è costruito una reputazione per la prototipazione rapida e i cicli di iterazione rapidi. Il modello viene generato rapidamente e gestisce istruzioni semplici in modo efficiente, rendendolo utile per l'esplorazione dei concetti e la creazione di bozze.

Nei confronti diretti della qualità, Seedance 2.0 supera costantemente Kling 3.0 in termini di realismo del movimento, coerenza visiva e aderenza immediata. I risultati di Kling possono apparire più "robotici" o artificiali, in particolare nei movimenti umani e nelle espressioni facciali. Anche le capacità di generazione audio di Seedance 2.0 superano significativamente quelle di Kling, con una migliore sincronizzazione e un design del suono più naturale.

Utilizzare Seedance 2.0 per: Risultati finali, lavoro del cliente, contenuti che richiedono perfezionamento, sincronizzazione audiovisiva

Utilizzare Kling 3.0 per: Test rapidi di concetti, fase iniziale di ideazione, quando la velocità conta più della qualità

L'approccio del flusso di lavoro ibrido

Molti team di produzione professionali non scelgono un unico modello, ma utilizzano più strumenti in modo strategico. Un flusso di lavoro comune prevede l'utilizzo di Kling 3.0 per la prototipazione rapida e la convalida dei concetti, il perfezionamento di indicazioni promettenti con Seedance 2.0 per il lavoro basato su modelli e il controllo multimodale, quindi l'utilizzo di Sora 2 o Veo 3.1 per risultati finali di alta qualità quando è richiesto il massimo realismo fisico. Questo approccio ibrido sfrutta i punti di forza di ciascun modello mitigando al contempo i punti deboli individuali.

Errori comuni e come risolverli

Anche i creatori esperti riscontrano schemi di errore coerenti quando richiedono Seedance 2.0. Comprendere queste insidie ti aiuta a evitare generazioni sprecate e risultati frustranti.

Errore 1: sovraccaricare un singolo prompt

Il problema: tentativo di racchiudere più azioni distinte, cambi di scena e narrazioni complesse in un unico prompt senza una struttura chiara.

Esempio di cosa non funziona:

"Un detective entra in una stanza buia, trova un indizio, ha un flashback sulla scena del crimine, poi corre fuori per inseguire un sospetto attraverso strade affollate mentre gli elicotteri volano sopra di loro e sullo sfondo si verificano esplosioni."

Perché fallisce: Seedance 2.0 è in grado di gestire la complessità, ma solo se strutturato in modo chiaro. Questa richiesta richiede posizioni multiple, spostamenti temporali e fili di azione simultanei senza fornire al modello una struttura coerente per organizzarli.

La soluzione: suddividi le narrazioni complesse in generazioni separate o utilizza una struttura di inquadratura esplicita:

"Inquadratura 1: il detective apre una porta cigolante, il raggio di una torcia taglia l'oscurità, rivelando una stanza polverosa. Inquadratura 2: primo piano del volto del detective mentre viene riconosciuto, gli occhi si spalancano. Inquadratura 3: taglio rapido verso l'esterno: il detective irrompe dalla porta e corre lungo il vicolo, seguito dalla telecamera al suo fianco."

Errore 2: direzione vaga della telecamera

Il problema: utilizzo di descrizioni generiche della telecamera che non specificano il tipo di movimento, la velocità o la traiettoria.

Esempio di cosa non funziona:

"La telecamera si muove intorno alla scena"

Perché fallisce: "Si muove intorno" potrebbe significare orbita, panoramica, carrello, movimento manuale o movimento della gru, ognuno dei quali produce risultati completamente diversi. Il modello deve indovinare le tue intenzioni, spesso in modo errato.

La soluzione: Utilizza una terminologia cinematografica specifica:

"La fotocamera esegue un arco uniforme di 180 gradi attorno al soggetto a media distanza, mantenendo l'altezza degli occhi, completando il movimento in 10 secondi"

Errore 3: ignorare la relazione audiovisiva

Il problema: descrivere l'azione visiva senza considerare come sincronizzare l'audio generato o caricare riferimenti audio senza spiegarne il ruolo.

Esempio di cosa non funziona:

"Un batterista suona un assolo intenso" (senza specificazione del ritmo o riferimento audio)

Perché non funziona: Seedance 2.0 genererà sia video che audio, ma senza indicazioni sulla loro relazione, i colpi delle bacchette potrebbero non allinearsi con i suoni di batteria generati.

La soluzione: collega esplicitamente elementi audio e video:

"Un batterista suona un assolo intenso, le bacchette colpiscono il rullante con rapide sedicesime sincronizzate alla traccia ritmica di @Audio1, i piatti si schiantano in corrispondenza dei picchi audio a intervalli di 3 secondi"

Errore 4: contesto ambientale insufficiente

Il problema: concentrarsi interamente sul soggetto e sull'azione trascurando l'ambientazione, l'illuminazione e i dettagli atmosferici.

Esempio di cosa non funziona:

"Una donna cammina avanti"

Perché fallisce: Senza il contesto ambientale, Seedance 2.0 deve inventare l'ambientazione, l'illuminazione, l'ora del giorno, il tempo e l'umore, spesso producendo risultati generici o incoerenti.

La soluzione: Stabilisci il contesto completo della scena:

"Una donna con un ampio abito bianco cammina in avanti attraverso una foresta nebbiosa all'alba, una morbida luce dorata che filtra attraverso gli alberi, la nebbia mattutina che turbina intorno ai suoi piedi, ombre screziate che giocano sul suo cammino"

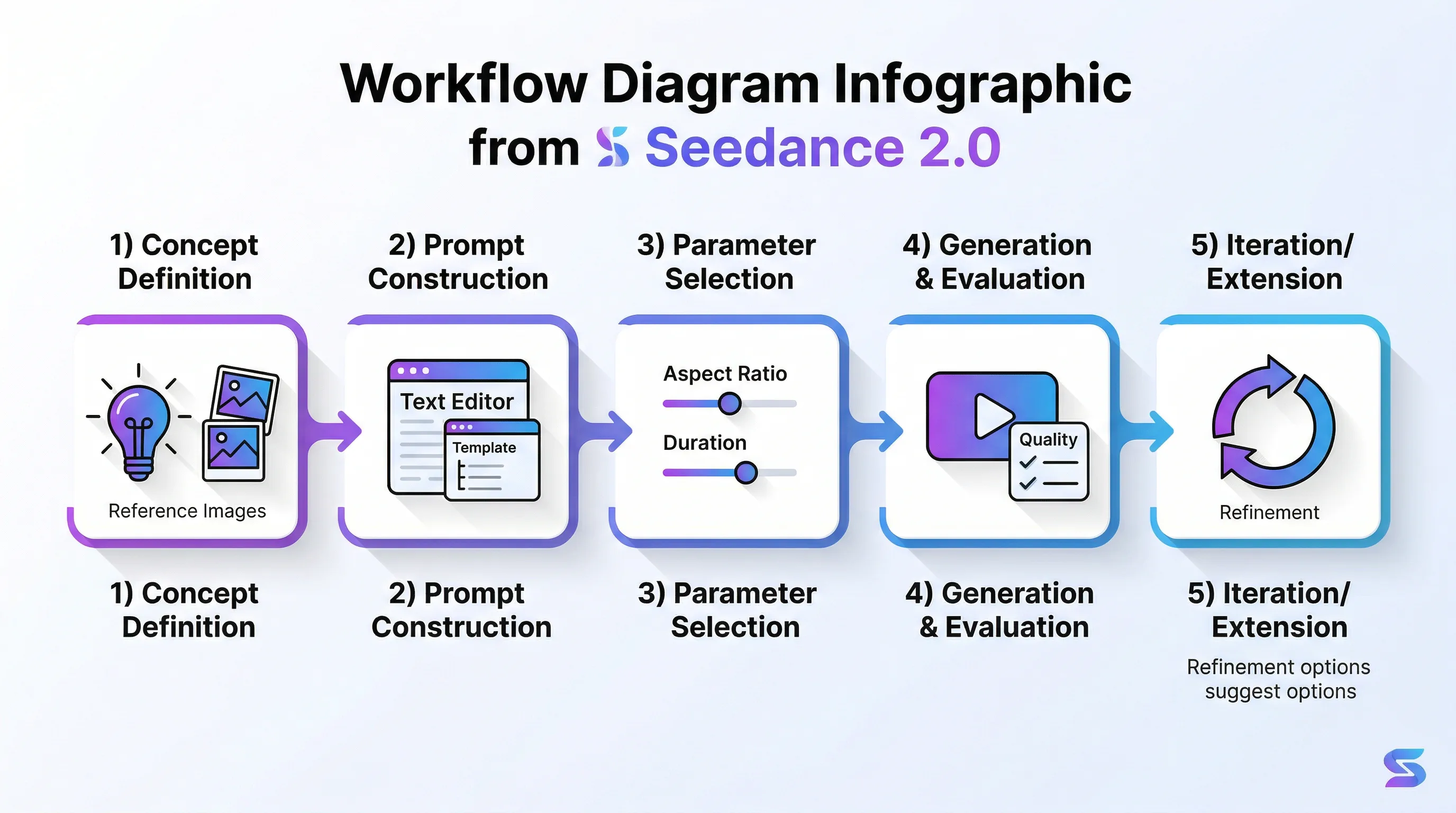

Flusso di lavoro pratico: dal concept al video finale

Comprendere il processo end-to-end ti aiuta a pianificare i progetti in modo efficiente ed evitare i colli di bottiglia comuni del flusso di lavoro.

Fase 1: definizione del concetto e raccolta di riferimenti

Inizia definendo chiaramente cosa vuoi creare. Scrivi una descrizione semplice in un linguaggio semplice: "Voglio un video di un futuristico inseguimento in motocicletta attraverso una città illuminata al neon di notte con angoli di ripresa spettacolari".

Successivamente, raccogli i materiali di riferimento che rappresentano la tua visione:

-

Riferimenti a personaggi/soggetti: Foto o illustrazioni che mostrano lo stile visivo, il costume o l'aspetto che desideri

-

Riferimenti ambientali: Immagini di luoghi, stili architettonici o condizioni atmosferiche

-

Riferimenti al movimento: Video clip che dimostrano lo stile di movimento, la coreografia dell'azione o il lavoro con la telecamera a cui ti rivolgi

-

Riferimenti audio: Tracce musicali, effetti sonori o dialoghi che dovrebbero essere sincronizzati con le immagini

Assicurati che tutti i riferimenti siano di alta qualità: almeno 1080p per le immagini, azioni chiare nei video, audio pulito senza artefatti di compressione. Una scarsa qualità di riferimento peggiora direttamente la qualità dell'output.

Passaggio 2: costruzione rapida

Utilizzando uno dei tre framework principali, crea il tuo prompt strutturato. Inizia con gli elementi di base, quindi aggiungi i dettagli tecnici:

Livello base: Oggetto, ambientazione, azione

Livello tecnico: Movimento della fotocamera, illuminazione, stile

Livello di riferimento: Tag @Image, @Video, @Audio con istruzioni specifiche per ciascuno

Scrivi prima il tuo prompt in un editor di testo, non direttamente nell'interfaccia di generazione. Ciò ti consente di perfezionare il linguaggio, verificarne la chiarezza e garantire che tutti gli elementi necessari siano presenti prima di impegnarti in una generazione.

Passaggio 3: selezione dei parametri

Scegli i tuoi parametri tecnici in base al tipo di contenuto e al canale di distribuzione:

-

Proporzioni: Adatta alla tua piattaforma di pubblicazione

-

Durata: 4-7 secondi per azioni semplici, 10-15 secondi per sequenze

-

Risoluzione: 1080p per la maggior parte delle applicazioni (comprensione della limitazione nativa 720p)

Passaggio 4: generazione e valutazione

Genera il tuo video e valutalo rispetto al tuo concetto originale. Seedance 2.0 produce risultati coerenti, ma nessun modello di intelligenza artificiale raggiunge il 100% di aderenza immediata. Cercare:

-

Qualità del movimento: il movimento sembra naturale e appropriato alla fisica?

-

Coerenza visiva: i personaggi, gli oggetti e gli ambienti mantengono un aspetto stabile?

-

Sincronizzazione audio: i suoni generati corrispondono alle azioni visive?

-

Esecuzione della telecamera: Il movimento della telecamera ha seguito la tua direzione?

Passaggio 5: iterazione o estensione

Se il risultato non soddisfa le tue esigenze, identifica il problema specifico prima di rigenerare. Non limitarti a premere di nuovo Genera con lo stesso prompt: regola l'elemento che non è riuscito:

-

Problemi di movimento -> Aggiungi un linguaggio fisico più specifico

-

Incoerenza visiva -> Aggiungi immagini di riferimento per gli elementi instabili

-

Problemi di sincronizzazione audio -> Fornisci riferimenti audio o segnali temporali più espliciti

-

Problemi con la telecamera -> Utilizza una terminologia cinematografica più precisa

Per i progetti che richiedono contenuti più lunghi di 15 secondi, utilizza i fotogrammi finali della generazione di successo come immagini di riferimento per il segmento successivo, mantenendo la continuità visiva tra più generazioni.

La realtà professionale: dove Seedance 2.0 si inserisce nei flussi di lavoro di produzione

È essenziale stabilire aspettative realistiche sul ruolo attuale della generazione di video tramite intelligenza artificiale nella creazione di contenuti professionali. Nonostante le sue capacità impressionanti, Seedance 2.0 e i suoi concorrenti non hanno "sostituito Hollywood" né eliminato la necessità di competenze cinematografiche tradizionali.

La risoluzione nativa 720p del modello e la profondità di colore limitata creano sfide per i flussi di lavoro di post-produzione professionale, in particolare quando si abbinano contenuti generati dall'intelligenza artificiale con materiale filmato tradizionalmente o si esegue una gradazione del colore avanzata. La qualità dell'output, sebbene impressionante per i contenuti generati dall'intelligenza artificiale, non soddisfa ancora gli standard tecnici richiesti per le principali produzioni in studio, trasmissioni televisive o uscite cinematografiche.

Tuttavia, Seedance 2.0 eccelle in diverse applicazioni professionali in cui i suoi punti di forza sono in linea con i requisiti del progetto:

Previsualizzazione e storyboard: genera rapide rappresentazioni visive delle riprese pianificate per l'approvazione del cliente, la comunicazione del regista o la pianificazione cinematografica prima di impegnarsi in una produzione costosa.

Creazione di contenuti per social media: la risoluzione 720p è più che adeguata per Instagram, TikTok, YouTube Shorts e altre piattaforme social in cui dominano la visualizzazione mobile e la compressione.

Animazione indipendente e aumento degli effetti visivi: i creatori indipendenti possono ottenere effetti visivi e sequenze animate che avrebbero un budget proibitivo utilizzando le tecniche tradizionali.

Sviluppo del concept e materiali per le presentazioni: crea concetti visivi accattivanti per presentazioni, presentazioni di finanziamento o esplorazioni creative senza un investimento completo nella produzione.

Prototipazione rapida per contenuti commerciali: prova rapidamente più direzioni creative per pubblicità, video di marketing o contenuti brandizzati prima di finalizzare gli approcci di produzione.

Seedance AI rende queste applicazioni professionali ancora più accessibili fornendo una piattaforma unificata in cui puoi lavorare con Seedance 2.0 insieme ad altri modelli di intelligenza artificiale all'avanguardia. Questo approccio integrato semplifica i flussi di lavoro, riduce le barriere tecniche e consente ai creatori di concentrarsi sulla narrazione piuttosto che sulla gestione degli strumenti.

Il divario tra le immagini generate dall’intelligenza artificiale e il cinema tradizionale continua a ridursi con ogni generazione di modelli. Seedance 2.0 rappresenta l'attuale stato dell'arte, dimostrando che la generazione di video AI ha varcato la soglia da demo impressionante a strumento veramente utile per specifiche applicazioni professionali.

Conclusione: padroneggiare il nuovo linguaggio della regia video con intelligenza artificiale

Seedance 2.0 introduce un nuovo linguaggio creativo, che fonde la conoscenza cinematografica tradizionale con l'ingegneria tecnica e l'orchestrazione multimodale. Il successo con questo strumento richiede la comprensione non solo di cosa suggerire, ma di come il modello interpreta le istruzioni, elabora i riferimenti e simula la realtà fisica.

I tre framework di prompt principali forniscono una base, ma la vera maestria deriva dalla sperimentazione, dall'iterazione e dallo sviluppo di un'intuizione su come la tua visione creativa si traduce nel linguaggio strutturato che Seedance 2.0 comprende. Pensa come un regista che deve comunicare chiaramente con una troupe altamente capace ma con una mentalità letterale: specificità, struttura e precisione tecnica producono i migliori risultati.

Man mano che la tecnologia di generazione video AI continua la sua rapida evoluzione, le competenze sviluppate lavorando con Seedance 2.0 verranno trasferite ai modelli futuri. I principi fondamentali di comunicazione chiara, suggerimenti strutturati e utilizzo di riferimenti strategici rimangono costanti anche con l’avanzamento della tecnologia sottostante.

Il futuro della creazione video non riguarda la sostituzione dell'intelligenza artificiale con la creatività umana: riguarda piuttosto l'intelligenza artificiale che amplifica ciò che i creatori possono ottenere, rimuove le barriere tecniche e consente una narrazione visiva che prima era impossibile o proibitivamente costosa. Seedance 2.0 rappresenta un passo significativo verso quel futuro e padroneggiarne le capacità ti posiziona in prima linea in questa rivoluzione creativa.

Pronto per iniziare a creare con Seedance 2.0? Seedance AI fornisce un accesso diretto a questo potente modello insieme a una suite completa di strumenti per la generazione di video e immagini con intelligenza artificiale, tutti progettati per aiutarti a dare vita alla tua visione creativa con un controllo ed un'efficienza senza precedenti.