Le paysage de la génération vidéo IA a subi un changement sismique avec l'arrivée de Seedance 2.0, le modèle vidéo multimodal révolutionnaire de ByteDance. Sortie en février 2026, il ne s'agit pas simplement d'une autre mise à jour incrémentielle : elle représente une réinvention fondamentale de la façon dont les créateurs interagissent avec les outils vidéo d'IA. Alors que des concurrents comme Sora 2, Veo 3.1 et Kling 3.0 continuent d'affiner leurs approches, Seedance 2.0 introduit un système de contrôle au niveau du réalisateur qui transforme la génération vidéo de la conjecture en une réalisation de films de précision.

Pour les créateurs frustrés par la nature de « boîte noire » des outils vidéo d'IA de première génération - dans lesquels vous tapez une invite, croisez les doigts et espérez que le résultat correspond à votre vision - Seedance 2.0 propose un paradigme radicalement différent. Grâce à son système innovant @reference et à son architecture multimodale, vous pouvez désormais orchestrer chaque élément de votre vidéo avec le même niveau de contrôle qu'un réalisateur exerce sur le plateau. Ce guide vous montrera exactement comment exploiter cette puissance, avec des cadres d'invite pratiques, des informations techniques et des stratégies tirées de tests réels et des commentaires de la communauté.

Ce qui différencie Seedance 2.0 des autres modèles vidéo IA

Comprendre l'architecture unique de Seedance 2.0 est essentiel avant de se plonger dans les techniques d'invite. Contrairement aux modèles texte-vidéo traditionnels qui traitent les invites comme de vagues suggestions, Seedance 2.0 utilise un transformateur de diffusion à double branche qui traite simultanément les données visuelles et audio. Ce choix architectural élimine le problème courant de la dérive audiovisuelle - où les pas ne se synchronisent pas avec la marche ou où les explosions semblent déconnectées de leur impact visuel.

Le système de saisie multimodal du modèle accepte jusqu'à 12 fichiers de référence en une seule génération : 9 images pour les personnages, les environnements et les références de style ; 3 clips vidéo totalisant 15 secondes pour les mouvements de caméra et la chorégraphie d'action ; et 3 fichiers audio totalisant 15 secondes pour la musique, les dialogues et les effets sonores. Chaque référence peut être étiquetée et spécifiquement dirigée à l'aide du système de notation @reference, vous donnant un contrôle granulaire sur la manière dont chaque élément influence le résultat final.

Ce qui distingue vraiment Seedance 2.0, c'est sa compréhension de la physique du monde réel. Le modèle n'anime pas seulement les objets : il simule leur comportement sous l'effet de forces physiques. Lorsque vous décrivez une voiture qui dérive, Seedance 2.0 calcule la répartition du poids, la friction des pneus et l'élan. Lorsque vous demandez la chute de débris, il comprend la gravité, la dynamique des collisions et les propriétés des matériaux. Cette génération soucieuse de la physique produit des vidéos authentiques plutôt que artificiellement fluides, une distinction essentielle pour les applications professionnelles.

Seedance AI offre aux créateurs un accès à cette technologie de pointe via une plate-forme intuitive qui intègre plusieurs modèles de génération de vidéos et d'images de pointe. Avec Seedance AI, vous pouvez exploiter les puissantes capacités de Seedance 2.0 ainsi que d'autres outils de pointe du secteur, le tout au sein d'un flux de travail unique et rationalisé conçu pour une efficacité créative maximale.

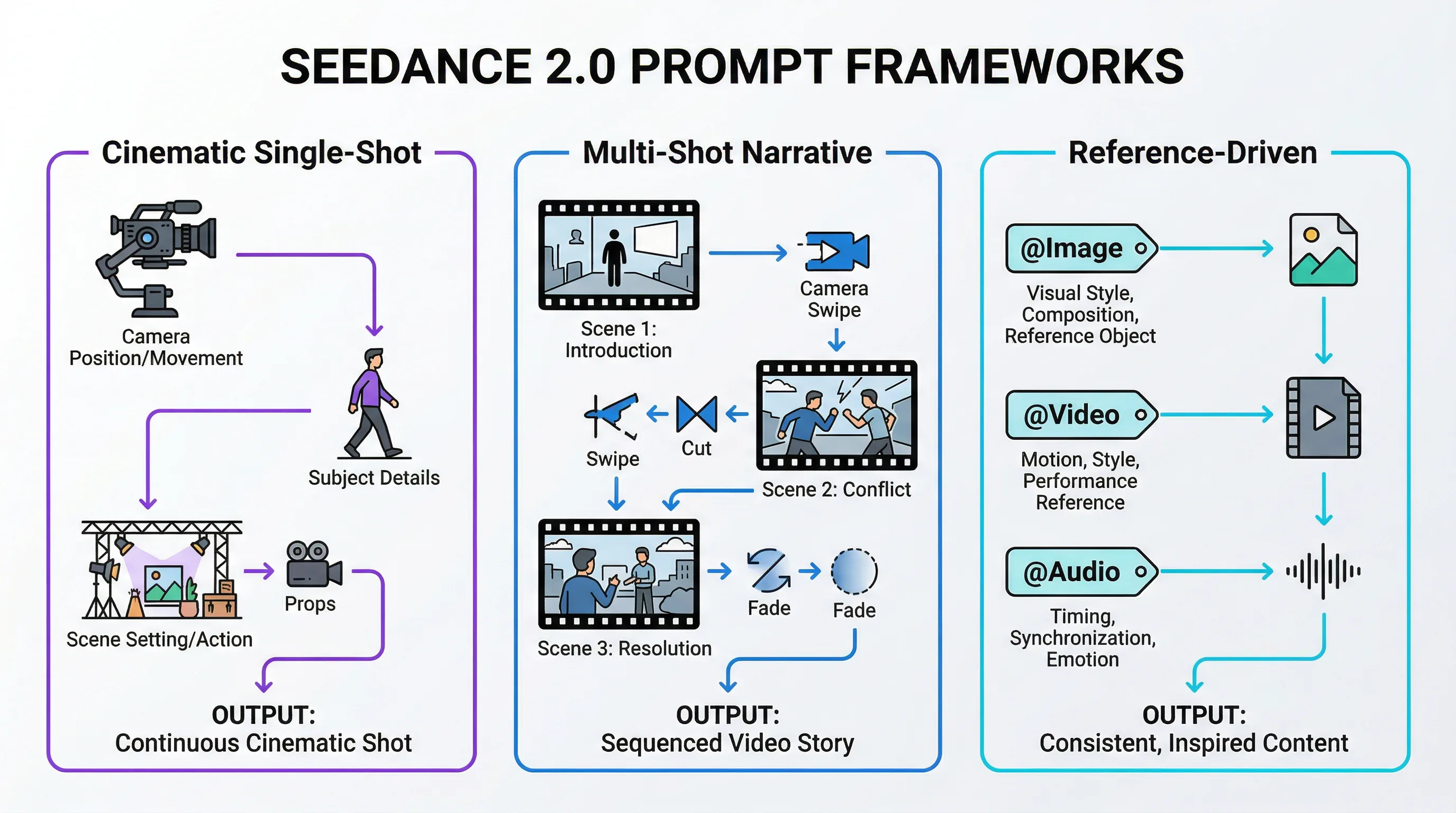

Les trois cadres d'invite de base qui fonctionnent réellement

Après des tests communautaires approfondis et une analyse des générations réussies, trois cadres d'invite ont émergé comme base pour des résultats cohérents et de haute qualité. Ce ne sont pas des modèles arbitraires : ce sont des modèles structurels qui correspondent à la façon dont l'architecture neuronale de Seedance 2.0 interprète les instructions.

Cadre 1 : La structure cinématographique à plan unique

Ce cadre fonctionne mieux pour les séquences d'action continues et les moments à forte résonance émotionnelle où le maintien d'une cohérence visuelle sur toute la durée est primordial.

Logique de base : Sujet + Scène/Atmosphère + Action/Performance + Mouvement de la caméra + Style/Éclairage

Exemple d'invite :

"Une jeune femme vêtue d'une veste en cuir rouge se tient au bord d'un toit détrempé la nuit, des enseignes au néon se reflétant dans des flaques d'eau autour de ses pieds. Elle se tourne lentement vers la caméra, le vent attrapant ses cheveux, tandis que le tonnerre lointain gronde. La caméra recule dans un mouvement de chariot fluide, révélant le paysage urbain cyberpunk tentaculaire derrière elle. Éclairage cinématographique avec un contraste élevé, une texture de grain de film, un étalonnage de couleurs sombres avec des tons sarcelle et orange. "

Cette structure donne Seedance 2.0 des réponses claires aux questions que son architecture doit résoudre : qui ou quoi est le sujet ? Où cela se passe-t-il ? Que se passe-t-il pendant le tournage ? Comment la caméra le capture-t-elle ? Quelle est l'esthétique visuelle ? Lorsque ces éléments sont explicitement définis, le modèle peut allouer efficacement ses ressources de calcul plutôt que de formuler des hypothèses.

Cadre 2 : La séquence narrative à plusieurs plans

La capacité unique de Seedance 2.0 à générer des vidéos avec des coupes et des transitions naturelles en une seule sortie de 15 secondes rend ce cadre particulièrement puissant pour les applications de narration.

Core Logic : Description du plan 1 -> Repérage de transition -> Description du plan 2 -> (facultatif) Description du plan 3

Exemple d'invite :

"Plan 1 : Gros plan de mains assemblant un appareil mécanique, mouvements précis, éclairage au plafond projetant des ombres nettes. Coupure vers : Plan moyen de l'atelier d'un inventeur encombré de plans et d'outils, l'appareil maintenant terminé sur l'établi. Coupure vers : Plan large à travers la fenêtre de l'atelier alors qu'une explosion de lumière jaillit de l'appareil, illuminant toute la pièce. Coupes rapides avec une énergie croissante, caméra portable de style documentaire, éclairage tungstène chaud passant à une lumière bleue froide. "

La clé du succès de ce cadre réside dans l'utilisation d'indices de transition explicites (« Couper vers », « Transition vers », « Maj vers ») qui signalent les limites du plan au modèle. Sans ces marqueurs, Seedance 2.0 pourrait tenter de créer des mouvements de caméra fluides entre des compositions qui devraient être des plans distincts, ce qui entraînerait des interimages gênants.

Cadre 3 : La composition basée sur les références

Ce cadre avancé exploite le système @reference de Seedance 2.0 pour obtenir un contrôle sans précédent sur des éléments visuels spécifiques, des modèles de mouvement et une synchronisation audio.

Core Logic : Description de base + @Références d'image pour les éléments visuels + @Références vidéo pour le mouvement + @Références audio pour le rythme

Exemple d'invite :

"Un danseur exécute une chorégraphie contemporaine dans un entrepôt abandonné. Utilisez @Image1 comme référence de personnage pour l'apparence et le costume du danseur. Référencez @Video1 pour le style de mouvement fluide et expressif, en particulier les extensions de bras et le travail au sol. Appliquez @Image2 pour l'environnement d'un entrepôt industriel avec des fenêtres brisées et des puits de lumière spectaculaires. Synchronisez les battements du mouvement avec le rythme musical de @Audio1. La caméra exécute une orbite à 360 degrés autour le danseur, en maintenant une distance moyenne. Éclairage très contrasté avec rayons lumineux volumétriques, palette de couleurs désaturées avec couleur sélective sur le costume du danseur.

Ce cadre nécessite une préparation minutieuse : vos fichiers de référence doivent être de haute qualité (minimum 1080p pour les images, action claire dans les références vidéo) et alignés conceptuellement. Le modèle fonctionne mieux lorsque les références répondent à des objectifs distincts plutôt que de se chevaucher. Par exemple, n'utilisez pas plusieurs images qui tentent toutes de définir le personnage ; utilisez-en plutôt un pour le caractère, un pour l’environnement et un pour le style d’éclairage.

Paramètres et paramètres techniques ayant un impact sur la qualité de sortie

Au-delà de la structure des invites, la compréhension des paramètres techniques de Seedance 2.0 vous permet d'optimiser des cas d'utilisation spécifiques et des exigences de qualité.

Sélection de la résolution et du rapport hauteur/largeur

Seedance 2.0 génère des vidéos à des résolutions allant jusqu'à 1080p, mais il est important de noter que la résolution native réelle de la génération est de 720p, qui est ensuite mise à l'échelle. Cette distinction est importante pour les applications professionnelles où l'étalonnage des couleurs et l'intégration en post-production sont nécessaires. La profondeur de couleur limitée par rapport aux séquences natives 1080p ou 4K peut créer des difficultés lorsqu'il s'agit de faire correspondre le contenu généré par l'IA avec du matériel filmé de manière traditionnelle.

Le modèle prend en charge six formats d'image, chacun optimisé pour différents canaux de distribution :

| Rapport hauteur/largeur | Meilleur cas d'utilisation | Qualité de génération |

|---|---|---|

| 16:9 | YouTube, vidéo traditionnelle, contenu paysage | Excellent - la plupart des données d'entraînement |

| 9:16 | TikTok, Instagram Reels, contenu mobile vertical | Excellent - optimisé pour les réseaux sociaux |

| 4:3 | Esthétique vintage, contenu nostalgique, format TV | Bon - moins courant mais pris en charge |

| 3:4 | Style de photographie de portrait, vitrines de produits | Bon - vertical avec plus de hauteur libre |

| 21:9 | Compositions dramatiques cinématographiques grand écran | Excellent - véritable sensation cinématographique |

| 1:1 | Instagram publications dans le fil, vidéos de profil, compositions symétriques | Bon - flexibilité du format carré |

Le choix du bon rapport hauteur/largeur ne dépend pas seulement de l'endroit où vous publierez : cela affecte la façon dont Seedance 2.0 compose la photo. Le modèle a appris différentes conventions de composition pour chaque rapport, de sorte qu'une invite 21:9 favorisera naturellement des plans d'établissement plus larges et un mouvement horizontal, tandis que les invites 9:16 tendront vers une action verticale et un cadrage orienté vers le portrait.

Stratégie de durée : clips de 4 secondes contre séquences de 15 secondes

Seedance 2.0 propose des durées de génération de 4 à 15 secondes, mais le choix optimal dépend de la complexité de votre contenu et de l'utilisation prévue.

4-7 deuxièmes générations :

-

Idéal pour : rythmes d'action unique, plans de réaction, plans d'établissement, clips de réseaux sociaux

-

Avantages : cohérence plus élevée, moins de possibilités de dérive, temps de génération plus rapides

-

Approche rapide : concentrez-vous sur une action ou un moment clair

10-15 secondes générations :

-

Idéal pour : séquences multi-plans, arcs narratifs, chorégraphies complexes, segments de vidéoclips

-

Avantages : rythme naturel, espace pour les transitions de plans, rythmes d'histoire complets

-

Approche rapide : structure avec une répartition claire début-milieu-fin ou plan par plan

Pour les projets nécessitant un contenu plus long, le flux de travail recommandé consiste à générer des segments de 15 secondes et à utiliser les images finales comme matériel de référence pour la prochaine génération, créant ainsi des extensions transparentes. Cette technique maintient la cohérence visuelle tout en contournant la limite de longueur d’une seule génération.

Techniques d'invite avancées : contrôle de la caméra et dynamique du mouvement

L'une des capacités les plus célèbres de Seedance 2.0 est sa compréhension sophistiquée de la cinématographie. Le modèle répond avec précision à la terminologie professionnelle des caméras, vous permettant de réaliser des prises de vue avec le même langage que celui que vous utiliseriez avec un véritable caméraman.

Des mouvements de caméra professionnels qui fonctionnent

Seedance 2.0 exécute un travail de caméra complexe que les précédents modèles vidéo d'IA avaient du mal à interpréter correctement. Voici les mouvements qui produisent systématiquement d’excellents résultats :

Mouvements de chariot :

-

« Dolly in » ou « Push in » : la caméra avance vers le sujet

-

"Dolly out" ou "Pull back" : la caméra recule, révélant davantage de contexte

-

"Dolly zoom" ou "Effet Vertigo" - Zoom et Dolly simultanés dans des directions opposées

Suivi et suivi :

-

"Tracking suivant [sujet]" : la caméra se déplace à côté du sujet

-

"Prise de vue suivante à main levée" - Ajoute un tremblement naturel et une sensation humaine

-

"Steadicam glide" - Mouvement fluide et flottant dans l'espace

Mouvements de rotation :

-

"Orbite à 360 degrés autour de [sujet]" - Mouvement circulaire maintenant la distance

-

"Grue de haut en bas" - Montée verticale suivie d'une inclinaison vers l'avant

-

"Passer du POV de [A] à [B]" - Changement de perspective à mi-plan

Techniques de mise au point :

-

"Mise au point en rack de [premier plan] à [arrière-plan]" - Décaler le plan de mise au point

-

"Faible profondeur de champ sur [sujet]" – Arrière-plan flou, sujet net

-

"Mise au point profonde tout en conservant la netteté" - Tout est mis au point

La clé d’une direction réussie de la caméra est la spécificité. Plutôt que « mouvements de caméra », décrivez « chariot lent en plus de 8 secondes » ou « travelling à la main avec un léger rebond vertical ». Plus vous définissez avec précision le caractère, la vitesse et la trajectoire du mouvement, plus Seedance 2.0 l'exécutera avec précision.

Invite à l’action basée sur la physique

Le moteur de simulation physique de Seedance 2.0 nécessite des invites qui reconnaissent les forces et les propriétés des matériaux du monde réel. Les descriptions d'actions génériques produisent des résultats génériques ; un langage spécifique à la physique produit une dynamique convaincante.

Au lieu de : "Une voiture tourne brusquement"

Écrivez : "Les pneus de la voiture fument lorsqu'elle dérive à 90 degrés, l'arrière glisse tandis que les roues avant maintiennent l'adhérence, le poids se déplace visiblement vers l'extérieur"

Au lieu de : "Des objets tombent d'une étagère"

Écrivez : "Les bouteilles en verre tombent de l'étagère en séquence, se brisant lors de l'impact avec le sol, les fragments se dispersant vers l'extérieur avec un élan réaliste"

Au lieu de : "Le tissu bouge avec le vent"

Écrivez : "Le tissu en soie gonfle et ondule au vent, le matériau léger attrape l'air et flotte avant de se déposer, les bords plus lourds tirent vers le bas"

Cette invite basée sur la physique indique à Seedance 2.0 les principes physiques à prioriser dans sa simulation. Le modèle comprend des concepts tels que l'élan, la friction, la gravité, l'élasticité et la dynamique des collisions, mais vous devez les invoquer explicitement dans votre invite pour activer cette compréhension.

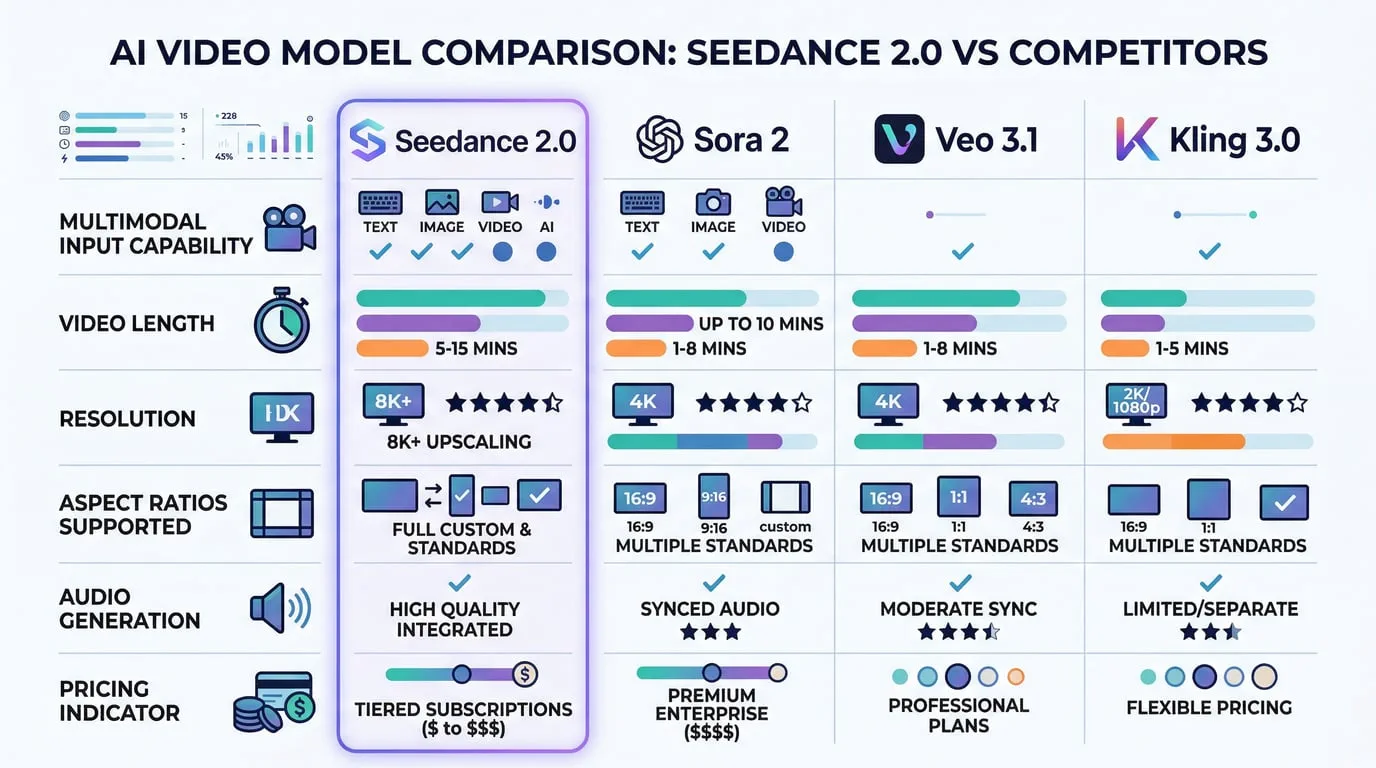

Analyse comparative : Seedance 2.0 par rapport aux modèles concurrents

Comprendre où Seedance 2.0 excelle par rapport à ses concurrents vous aide à choisir le bon outil pour chaque projet et à définir des attentes réalistes en matière de qualité de sortie.

Seedance 2.0 contre Sora 2 (OpenAI)

Sora 2 a bâti sa réputation sur la physique de première génération et la subtilité émotionnelle. Le modèle excelle dans la création de vidéos dans lesquelles les objets et les environnements se comportent avec une conviction physique : la gravité fonctionne correctement, les matériaux réagissent de manière authentique et le mouvement semble ancré dans la réalité. Pour les prises de vue exigeant une émotion humaine naturaliste ou des interactions environnementales subtiles, Sora 2 produit souvent des résultats plus nuancés.

Cependant, Seedance 2.0 surpasse Sora 2 dans plusieurs domaines critiques. Le système de référence multimodal offre un contrôle créatif bien plus important : vous pouvez directement spécifier les modèles de mouvement, les apparences des personnages et la synchronisation audio plutôt que d'espérer que le modèle interprète correctement votre invite de texte. Seedance 2.0 génère également des clips plus longs (jusqu'à 15 secondes par rapport à la limite habituelle de 10 secondes de Sora 2) et offre une prise en charge plus flexible des formats d'image. La tarification favorise fortement Seedance 2.0, avec des coûts par génération nettement inférieurs.

Utilisez Seedance 2.0 pour : les travaux créatifs faisant beaucoup de références, les séquences d'action, le contenu stylisé, les récits multi-plans, les projets soucieux de leur budget.

Utilisez Sora 2 pour : Les prises de vue nécessitant une conviction physique, une subtilité émotionnelle et un comportement humain naturaliste, lorsque les invites textuelles uniquement sont préférées.

Seedance 2.0 contre Veo 3.1 (Google)

Veo 3.1 de Google bénéficie d'une intégration étroite avec l'infrastructure Vertex AI de Google Cloud, ce qui le rend attrayant pour les déploiements d'entreprise et les développeurs déjà intégrés dans l'écosystème Google. Veo offre d'excellentes capacités de résolution et de solides performances sur le contenu architectural et environnemental.

Les évaluations de la communauté révèlent une qualité de mouvement incohérente dans Veo 3.1, en particulier pour les séquences d'action complexes et l'animation des personnages. La stabilité de mouvement et la cohérence image par image de Seedance 2.0 surpassent généralement Veo, en particulier pour les contenus impliquant des figures humaines, des animaux ou un travail de caméra dynamique. Le système @reference dans Seedance 2.0 offre également un contrôle plus direct sur des éléments visuels spécifiques par rapport au modèle de saisie de texte et d'image de Veo.

Utilisez Seedance 2.0 pour : L'animation de personnages, les séquences d'action, les projets nécessitant un contrôle basé sur des références et le travail de création autonome.

Utilisez Veo 3.1 pour : les déploiements d'entreprise, l'intégration de Google Cloud et la visualisation architecturale, lorsque l'infrastructure GCP est déjà en place.

Seedance 2.0 contre Kling 3.0 (Kuaishou)

Kling 3.0 s'est forgé une réputation en matière de prototypage rapide et de cycles d'itération rapides. Le modèle génère rapidement et gère efficacement les invites simples, ce qui le rend utile pour l'exploration de concepts et la création de brouillons.

Lors de comparaisons directes de qualité, Seedance 2.0 surpasse systématiquement Kling 3.0 en termes de réalisme de mouvement, de cohérence visuelle et d'adhésion rapide. Les résultats de Kling peuvent paraître plus « robotiques » ou artificiels, en particulier dans les mouvements humains et les expressions faciales. Les capacités de génération audio de Seedance 2.0 dépassent également largement celles de Kling, avec une meilleure synchronisation et une conception sonore plus naturelle.

Utilisez Seedance 2.0 pour : Les livrables finaux, le travail du client, le contenu nécessitant un peaufinage, la synchronisation audiovisuelle

Utilisez Kling 3.0 pour : Tests de concept rapides, idéation à un stade précoce, lorsque la vitesse compte plus que la qualité.

L'approche du flux de travail hybride

De nombreuses équipes de production professionnelles ne choisissent pas un seul modèle : elles utilisent plusieurs outils de manière stratégique. Un flux de travail courant consiste à utiliser Kling 3.0 pour un prototypage rapide et une validation de concept, à affiner les orientations prometteuses avec Seedance 2.0 pour un travail basé sur des modèles et un contrôle multimodal, puis à utiliser Sora 2 ou Veo 3.1 pour des livrables finaux de haute qualité lorsqu'un réalisme physique maximal est requis. Cette approche hybride exploite les atouts de chaque modèle tout en atténuant les faiblesses individuelles.

Erreurs d'invite courantes et comment les corriger

Même les créateurs expérimentés rencontrent des modèles d'échec constants lorsqu'ils demandent Seedance 2.0. Comprendre ces pièges vous aide à éviter des générations perdues et des résultats frustrants.

Erreur 1 : surcharger une seule invite

Le problème : Essayer de regrouper plusieurs actions distinctes, changements de scène et récits complexes dans une seule invite sans structure claire.

Exemple de ce qui ne fonctionne pas :

"Un détective entre dans une pièce sombre, trouve un indice, a un flash-back sur une scène de crime, puis court dehors pour poursuivre un suspect dans des rues bondées pendant que des hélicoptères survolent et que des explosions se produisent en arrière-plan."

Pourquoi cela échoue : Seedance 2.0 peut gérer la complexité, mais uniquement lorsqu'il est clairement structuré. Cette invite demande plusieurs emplacements, décalages temporels et fils d'action simultanés sans donner au modèle un cadre cohérent pour les organiser.

La solution : Divisez les récits complexes en générations distinctes ou utilisez une structure de plan explicite :

"Plan 1 : le détective pousse une porte grinçante, le faisceau d'une lampe de poche traverse l'obscurité, révélant une pièce poussiéreuse. Plan 2 : gros plan du visage du détective alors que la reconnaissance se fait jour, les yeux s'écarquillent. Plan 3 : coupe rapide vers l'extérieur - le détective fait irruption à travers la porte et sprinte dans l'allée, la caméra suit à côté.

Erreur 2 : direction vague de la caméra

Le problème : Utilisation de descriptions de caméra génériques qui ne spécifient pas le type de mouvement, la vitesse ou la trajectoire.

Exemple de ce qui ne fonctionne pas :

"La caméra se déplace sur la scène"

Pourquoi cela échoue : "Se déplacer" peut signifier un mouvement d'orbite, de panoramique, de chariot, de visite portative ou de grue - chacun produisant des résultats complètement différents. Le modèle doit deviner votre intention, souvent de manière incorrecte.

Le correctif : Utilisez une terminologie cinématographique spécifique :

"La caméra exécute un arc fluide de 180 degrés autour du sujet à moyenne distance, en maintenant le niveau des yeux, complétant le mouvement en 10 secondes"

Erreur 3 : ignorer la relation audiovisuelle

Le problème : Décrire une action visuelle sans considérer la manière dont l'audio généré doit se synchroniser, ou télécharger des références audio sans expliquer leur rôle.

Exemple de ce qui ne fonctionne pas :

"Un batteur joue un solo intense" (sans spécification de rythme ni référence audio)

Pourquoi cela échoue : Seedance 2.0 générera à la fois de la vidéo et de l'audio, mais sans conseils sur leur relation, les coups de baguette risquent de ne pas s'aligner avec les sons de batterie générés.

Le correctif : Connectez explicitement les éléments audio et visuels :

"Un batteur joue un solo intense, des baguettes frappant la caisse claire en doubles croches rapides synchronisées avec la piste rythmique de @Audio1, des crashs de cymbales correspondant aux pics audio à intervalles de 3 secondes"

Erreur 4 : Contexte environnemental insuffisant

Le problème : Se concentrer entièrement sur le sujet et l'action tout en négligeant le décor, l'éclairage et les détails atmosphériques.

Exemple de ce qui ne fonctionne pas :

"Une femme avance"

Pourquoi cela échoue : Sans contexte environnemental, Seedance 2.0 doit inventer le décor, l'éclairage, l'heure de la journée, la météo et l'ambiance, ce qui produit souvent des résultats génériques ou incohérents.

Le correctif : Établissez le contexte complet de la scène :

"Une femme vêtue d'une robe blanche fluide avance à travers une forêt brumeuse à l'aube, une douce lumière dorée filtrant à travers les arbres, le brouillard matinal tourbillonnant autour de ses pieds, des ombres tachetées jouant sur son chemin"

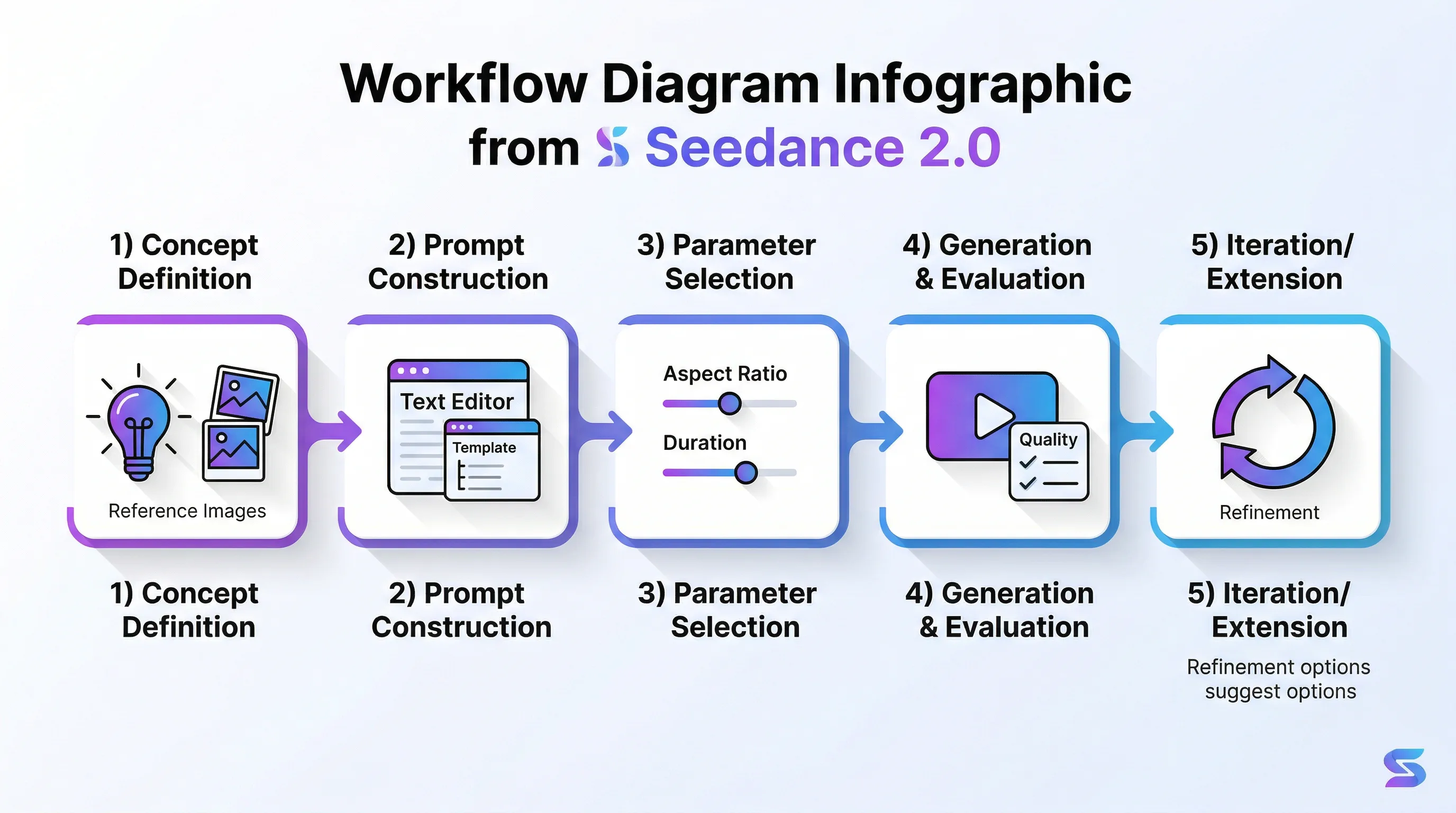

Flux de travail pratique : du concept à la vidéo finale

Comprendre le processus de bout en bout vous aide à planifier efficacement les projets et à éviter les goulots d'étranglement courants du flux de travail.

Étape 1 : Définition du concept et collecte de références

Commencez par définir clairement ce que vous souhaitez créer. Écrivez une description simple dans un langage clair : "Je veux une vidéo d'une course-poursuite futuriste en moto à travers une ville éclairée au néon la nuit avec des angles de caméra spectaculaires."

Ensuite, rassemblez des documents de référence qui représentent votre vision :

-

Références de personnage/sujet : Photos ou illustrations montrant le style visuel, le costume ou l'apparence que vous souhaitez

-

Références environnementales : Images de lieux, de styles architecturaux ou de conditions atmosphériques

-

Références de mouvement : Clips vidéo démontrant le style de mouvement, la chorégraphie d'action ou le travail de caméra que vous ciblez

-

Références audio : Pistes musicales, effets sonores ou dialogues qui doivent être synchronisés avec les visuels

Ensure all references are high quality - minimum 1080p for images, clear action in videos, clean audio without compression artifacts. Une mauvaise qualité de référence dégrade directement la qualité de sortie.

Étape 2 : Construction rapide

À l’aide de l’un des trois frameworks principaux, créez votre invite structurée. Commencez par les éléments de base, puis superposez les détails techniques :

Couche de base : Sujet, paramètre, action

Couche technique : Mouvement de la caméra, éclairage, style

Couche de référence : balises @Image, @Video, @Audio avec des instructions spécifiques pour chacune

Écrivez d'abord votre invite dans un éditeur de texte, pas directement dans l'interface de génération. Cela vous permet d'affiner le langage, de vérifier la clarté et de vous assurer que tous les éléments nécessaires sont présents avant de vous engager dans une génération.

Étape 3 : sélection des paramètres

Choisissez vos paramètres techniques en fonction du type de contenu et du canal de distribution :

-

Rapport d'aspect : Adaptez-vous à votre plate-forme de publication

-

Durée : 4 à 7 secondes pour les actions simples, 10 à 15 secondes pour les séquences

-

Résolution : 1080p pour la plupart des applications (comprenant la limitation native de 720p)

Étape 4 : Génération et évaluation

Générez votre vidéo et évaluez-la par rapport à votre concept original. Seedance 2.0 produit des résultats cohérents, mais aucun modèle d'IA n'atteint une adhésion rapide à 100 %. Rechercher:

-

Qualité du mouvement : Le mouvement semble-t-il naturel et adapté à la physique ?

-

Cohérence visuelle : Les personnages, les objets et les environnements conservent-ils une apparence stable ?

-

Synchronisation audio : Les sons générés correspondent-ils aux actions visuelles ?

-

Exécution de la caméra : Le mouvement de la caméra a-t-il suivi votre direction ?

Étape 5 : itération ou extension

Si le résultat ne répond pas à vos besoins, identifiez le problème spécifique avant de régénérer. Ne vous contentez pas de cliquer à nouveau sur Générer avec la même invite : ajustez l'élément qui a échoué :

-

Problèmes de mouvement -> Ajouter un langage physique plus spécifique

-

Incohérence visuelle -> Ajouter des images de référence pour les éléments instables

-

Problèmes de synchronisation audio -> Fournir une référence audio ou des indices de synchronisation plus explicites

-

Problèmes de caméra -> Utiliser une terminologie cinématographique plus précise

Pour les projets nécessitant un contenu de plus de 15 secondes, utilisez les images finales de votre génération réussie comme images de référence pour le segment suivant, en maintenant ainsi la continuité visuelle sur plusieurs générations.

La réalité professionnelle : la place de Seedance 2.0 dans les flux de production

Il est essentiel de définir des attentes réalistes quant au rôle actuel de la génération vidéo IA dans la création de contenu professionnel. Malgré des capacités impressionnantes, Seedance 2.0 et ses concurrents n'ont pas « remplacé Hollywood » ni éliminé le besoin de compétences cinématographiques traditionnelles.

La résolution native 720p du modèle et la profondeur de couleur limitée créent des défis pour les flux de travail de post-production professionnels, en particulier lorsqu'il s'agit de faire correspondre le contenu généré par l'IA avec du matériel filmé de manière traditionnelle ou d'effectuer un étalonnage avancé des couleurs. La qualité de sortie, bien qu'impressionnante pour le contenu généré par l'IA, ne répond pas encore aux normes techniques requises pour les grandes productions en studio, la diffusion télévisée ou la sortie en salles.

Cependant, Seedance 2.0 excelle dans plusieurs applications professionnelles où ses atouts correspondent aux exigences du projet :

Prévisualisation et storyboard : Générez des représentations visuelles rapides des plans planifiés pour l'approbation du client, la communication du réalisateur ou la planification cinématographique avant de vous engager dans une production coûteuse.

Création de contenu sur les réseaux sociaux : La résolution 720p est plus que adéquate pour Instagram, TikTok, YouTube Shorts et d'autres plateformes sociales où l'affichage et la compression mobiles dominent.

Animation indépendante et augmentation d'effets visuels : Les créateurs indépendants peuvent réaliser des effets visuels et des séquences animées dont le budget serait prohibitif en utilisant des techniques traditionnelles.

Développement de concepts et supports de présentation : Créez des concepts visuels convaincants pour des présentations, des arguments de financement ou une exploration créative sans investissement complet en production.

Prototypage rapide pour le contenu commercial : Testez rapidement plusieurs directions créatives pour la publicité, les vidéos marketing ou le contenu de marque avant de finaliser les approches de production.

Seedance AI rend ces applications professionnelles encore plus accessibles en fournissant une plate-forme unifiée sur laquelle vous pouvez travailler avec Seedance 2.0 aux côtés d'autres modèles d'IA de pointe. Cette approche intégrée rationalise les flux de travail, réduit les barrières techniques et permet aux créateurs de se concentrer sur la narration plutôt que sur la gestion des outils.

L’écart entre les visuels générés par l’IA et la réalisation cinématographique traditionnelle continue de se réduire à chaque génération de modèles. Seedance 2.0 représente l'état actuel de la technique, démontrant que la génération vidéo IA a franchi le seuil d'une démonstration impressionnante à un outil véritablement utile pour des applications professionnelles spécifiques.

Conclusion : maîtriser le nouveau langage de la réalisation vidéo IA

Seedance 2.0 introduit un nouveau langage créatif, qui allie les connaissances cinématographiques traditionnelles à l'ingénierie technique rapide et à l'orchestration multimodale. Pour réussir avec cet outil, il faut comprendre non seulement ce qu'il faut demander, mais aussi comment le modèle interprète les instructions, traite les références et simule la réalité physique.

Les trois cadres d'invite principaux fournissent une base, mais la véritable maîtrise vient de l'expérimentation, de l'itération et du développement d'une intuition sur la façon dont votre vision créative se traduit dans le langage structuré que Seedance 2.0 comprend. Pensez comme un réalisateur qui doit communiquer clairement avec une équipe hautement compétente mais à l'esprit littéral : la spécificité, la structure et la précision technique produisent les meilleurs résultats.

Alors que la technologie de génération vidéo IA poursuit son évolution rapide, les compétences que vous développez en travaillant avec Seedance 2.0 seront transférées aux futurs modèles. Les principes fondamentaux d’une communication claire, d’incitations structurées et d’utilisation de références stratégiques restent constants même à mesure que la technologie sous-jacente progresse.

L'avenir de la création vidéo ne consiste pas à ce que l'IA remplace la créativité humaine. Il s'agit plutôt d'une IA qui amplifie ce que les créateurs peuvent réaliser, supprime les barrières techniques et permet une narration visuelle qui était auparavant impossible ou d'un coût prohibitif. Seedance 2.0 représente une étape importante vers cet avenir, et la maîtrise de ses capacités vous place à l'avant-garde de cette révolution créative.

Prêt à commencer à créer avec Seedance 2.0 ? Seedance AI offre un accès transparent à ce modèle puissant ainsi qu'à une suite complète d'outils de génération de vidéos et d'images IA, tous conçus pour vous aider à donner vie à votre vision créative avec un contrôle et une efficacité sans précédent.