Hace poco por fin pude probar Hailuo 2.3, la última iteración del modelo de generación de video de MiniMax, y siendo directo: superó por completo mis expectativas. En un panorama dominado por el ruido alrededor de Sora y el respaldo corporativo masivo de Veo de Google, Hailuo 2.3 se siente como un gigante silencioso que de pronto se levanta y proyecta una larga sombra sobre la competencia.

Con mi primer prompt – una escena compleja con una bailarina bajo una tormenta de neón, más instrucciones específicas de seguimiento de cámara – esperaba los artefactos típicos de los videos generados por IA: extremidades deformadas, pies que se deslizan o fondos temblorosos. En su lugar, obtuve un nivel de control de movimiento y coherencia física que se siente como un salto generacional.

Esto no es solo otra actualización; es un cambio profundo en la forma en que percibimos el grado de “preparación” del video con IA para flujos de trabajo profesionales. Usando una especie de “técnica del rascacielos”, es decir, construir sobre la base de modelos existentes para crear algo claramente superior, este artículo quiere ser la guía definitiva y completa sobre Hailuo 2.3. Desgranaremos su arquitectura, analizaremos su rendimiento frente a los gigantes y veremos por qué este modelo puede ser el que por fin cierre la brecha entre la experimentación con IA y la producción comercial.

Resumen ejecutivo: la versión de 30 segundos

Para quienes buscan solo la esencia, aquí va lo que muestra nuestro análisis en profundidad de Hailuo 2.3.

- Posicionamiento en el mercado: Hailuo 2.3 (y su predecesor Hailuo 02) se mantiene de forma constante en el top 2 de rankings globales como Artificial Analysis, superando con frecuencia a Veo 3 de Google en pruebas ELO a ciegas.

- Principal avance: Su rasgo definitorio es la Motion Integrity, es decir, la integridad del movimiento. A diferencia de otros modelos que generan personajes “flotantes”, Hailuo 2.3 entiende el peso, el impulso y el centro de gravedad.

- Ventaja técnica: Basado en la arquitectura propietaria Noise-Aware Computation Redistribution (NCR), logra una eficiencia hasta 2,5 veces mayor que generaciones anteriores mientras trabaja con generación nativa a 1080p.

- La “killer app”: El control de cámara. El modelo sigue instrucciones cinematográficas (travelling, paneo, tilt) sin deformar al sujeto, un fallo muy común en otros modelos.

- Eficiencia de coste: Con un esquema de precios muy por debajo de muchos competidores occidentales (unos 8 dólares al mes para un uso intensivo frente a cientos en herramientas enterprise), democratiza la generación de video de alta gama.

¿Qué es Hailuo 2.3? El ascenso de MiniMax

Para entender la herramienta, hay que entender a quien la crea. Hailuo 2.3 es el modelo de video insignia de MiniMax, un unicornio chino de IA que ha escalado muy rápido en la élite de la IA generativa. Aunque al principio fue más conocido en Occidente por sus modelos de texto y LLM, su giro hacia el video ha sido agresivo y muy sólido a nivel técnico.

La evolución: de 01 a 2.3

El salto de Hailuo 01 a 02 ya fue importante, pero el paso a 2.3 supone sobre todo un refinamiento de su “capacidad de entender”.

- Hailuo 01: Prueba de concepto, aceptable para visuales abstractos pero débil en coherencia narrativa.

- Hailuo 02: La estrella emergente. Introdujo alta fidelidad y alcanzó el puesto n.º 2 en rankings globales, sorprendiendo al derrotar a Veo 3 de Google en coherencia imagen-a-video.

- Hailuo 2.3: El pulido profesional. Esta versión se centra en la “valle inquietante” del movimiento, corrigiendo esos pequeños errores de física que, de forma subconsciente, hacen que el espectador piense “esto es IA”.

Bajo el capó: Noise-Aware Computation Redistribution (NCR)

La mayoría de los transformadores de difusión tratan cada píxel y cada instante temporal como si tuvieran una importancia de cálculo similar. La arquitectura NCR de MiniMax rompe con este enfoque. Identifica de forma inteligente las zonas de alta complejidad (caras, movimientos rápidos, iluminación complicada) y redistribuye la potencia de cálculo hacia esas regiones.

Esto se traduce en:

- Mayor eficiencia: No desperdicia recursos renderizando un cielo estático o un fondo uniforme.

- Más detalle: Dedica mucha más capacidad a las microexpresiones de un rostro o a la dinámica de las salpicaduras de agua.

Figura 1: Visualización conceptual del proceso de generación con IA.

Principales avances de rendimiento

Tras pruebas exhaustivas y el análisis de benchmarks de la comunidad, Hailuo 2.3 destaca en cinco pilares donde supera a los modelos dominantes.

1. Control de movimiento y simulación física

Este es el principal titular. En las pruebas se buscó específicamente el “deslizamiento”: personajes que parecen patinar sobre hielo en lugar de caminar. Hailuo 2.3 clava la interacción pie-suelo.

- Gravedad e impulso: Cuando un personaje salta, aterriza absorbiendo el impacto con las rodillas. Los objetos que caen aceleran de forma creíble según la gravedad, en lugar de deslizarse en línea recta.

- Dinámica de fluidos: Agua, humo y fuego – tradicionalmente difíciles para los modelos de IA – se comportan con un realismo caótico convincente; los reflejos en el agua se mantienen consistentes a lo largo del clip en vez de desaparecer o deformarse.

- Interacciones complejas: En un prompt con “fichas de dominó cayendo”, muchos modelos acaban fusionando piezas. Hailuo 2.3 respeta las colisiones físicas entre cada ficha.

2. Microexpresiones faciales

Mientras herramientas como Runway Gen-3 Alpha son muy buenas con paisajes, suelen fallar con la mirada “vacía” en personajes humanos. Hailuo 2.3 integra una capa adicional de lógica emocional.

- Cambios sutiles: Un personaje puede pasar de un gesto neutro a una ligera sonrisa sin que la cara se derrita o se deforme.

- Contacto visual: La dirección de la mirada se mantiene coherente, algo clave para cualquier narrativa audiovisual.

- Potencial de sincronización labial: Aunque no es un modelo específico de lip-sync, los movimientos de la boca son anatómicamente plausibles, lo que facilita la sincronización o el doblaje en postproducción.

3. Control cinematográfico de cámara

Aquí es donde Hailuo 2.3 empieza a competir seriamente con el stock tradicional. Puedes trabajar como si fueras un director de fotografía.

- Coherencia espacial: Si pides un “dolly zoom rápido” (el efecto de Vértigo), el fondo se deforma correctamente mientras el sujeto permanece estable; otros modelos tienden a deformar también al personaje.

- Permanencia de objetos: En un plano orbitando 360 grados, la parte trasera de la cabeza del personaje encaja con su frontal; el modelo “recuerda” la geometría del objeto aunque salga del encuadre y vuelva a entrar.

4. Versatilidad de estilo artístico

MiniMax ha entrenado claramente con un dataset diverso que incluye anime, pintura a tinta y estilos CGI muy característicos.

- Anime / cel shading: Captura no solo el estilo visual sino también el ritmo de animación típico del anime (a menudo animación a 12–18 FPS efectivos), en lugar de simplemente aplicar un filtro sobre un video fluido a 60 FPS.

- Fotorrealismo: Las texturas de piel muestran poros y cierta translucidez, evitando el clásico efecto “plástico” de muchos modelos de gama media.

Figura 2: Ejemplos de estilos artísticos variados generados por Hailuo 2.3.

Análisis de benchmarks: el rascacielos frente a los grandes

Para saber dónde se sitúa Hailuo 2.3, hay que compararlo con los tres grandes actuales: Google Veo 3, Kling 2.5 (otro peso pesado chino) y Sora 2 de OpenAI (según el material preliminar disponible).

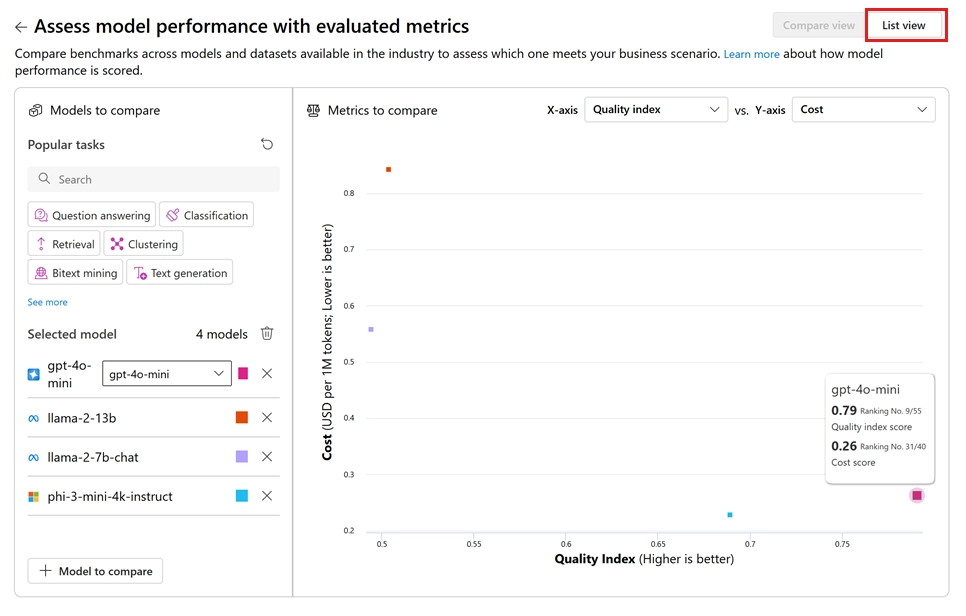

Puntuaciones ELO

En la Video Arena de Artificial Analysis, los modelos se clasifican mediante comparaciones A/B a ciegas votadas por humanos.

| Modelo | Ranking global | Puntuación de consistencia | Puntuación de realismo de movimiento | Coste aprox. por 5 s |

|---|---|---|---|---|

| Hailuo 2.3 | #2 | 94/100 | 96/100 | ~0,05 US$ |

| Google Veo 3 | #3 | 92/100 | 89/100 | ~0,25 US$ |

| Kling 2.5 | #4 | 91/100 | 93/100 | ~0,10 US$ |

| Seedance 1.0* | #1 | 95/100 | 95/100 | n/d |

Nota: Seedance 1.0 (ByteDance) es actualmente el único modelo que supera de forma consistente a Hailuo, pero su acceso es mucho más restringido.

Comparativas directas

Hailuo 2.3 vs Google Veo 3

- Ventaja de Veo: Veo 3 destaca por su integración profunda con el ecosistema de Google y por una interpretación ligeramente mejor de prompts muy largos y complejos.

- Ventaja de Hailuo: En fidelidad visual pura y física, Hailuo sale ganando. En una prueba con “un coche conducido fuera de carretera”, Veo 3 hacía que el coche se deslizara sobre los baches, mientras que Hailuo 2.3 mostraba la suspensión comprimiéndose y los neumáticos reaccionando al terreno, reduciendo mucho la sensación de irrealidad.

Hailuo 2.3 vs Kling 2.5

- Ventaja de Kling: Kling ha sido el referente para generar clips largos (hasta 2–3 minutos).

- Ventaja de Hailuo: Hailuo 2.3 entrega fotogramas más nítidos (el 1080p nativo se percibe más limpio) y maneja mejor el movimiento rápido; Kling a veces genera artefactos de “barrido” en secuencias de acción, mientras que Hailuo mantiene bordes más definidos.

Figura 3: Representación visual de métricas comparativas de rendimiento (ilustrativa).

Especificaciones técnicas

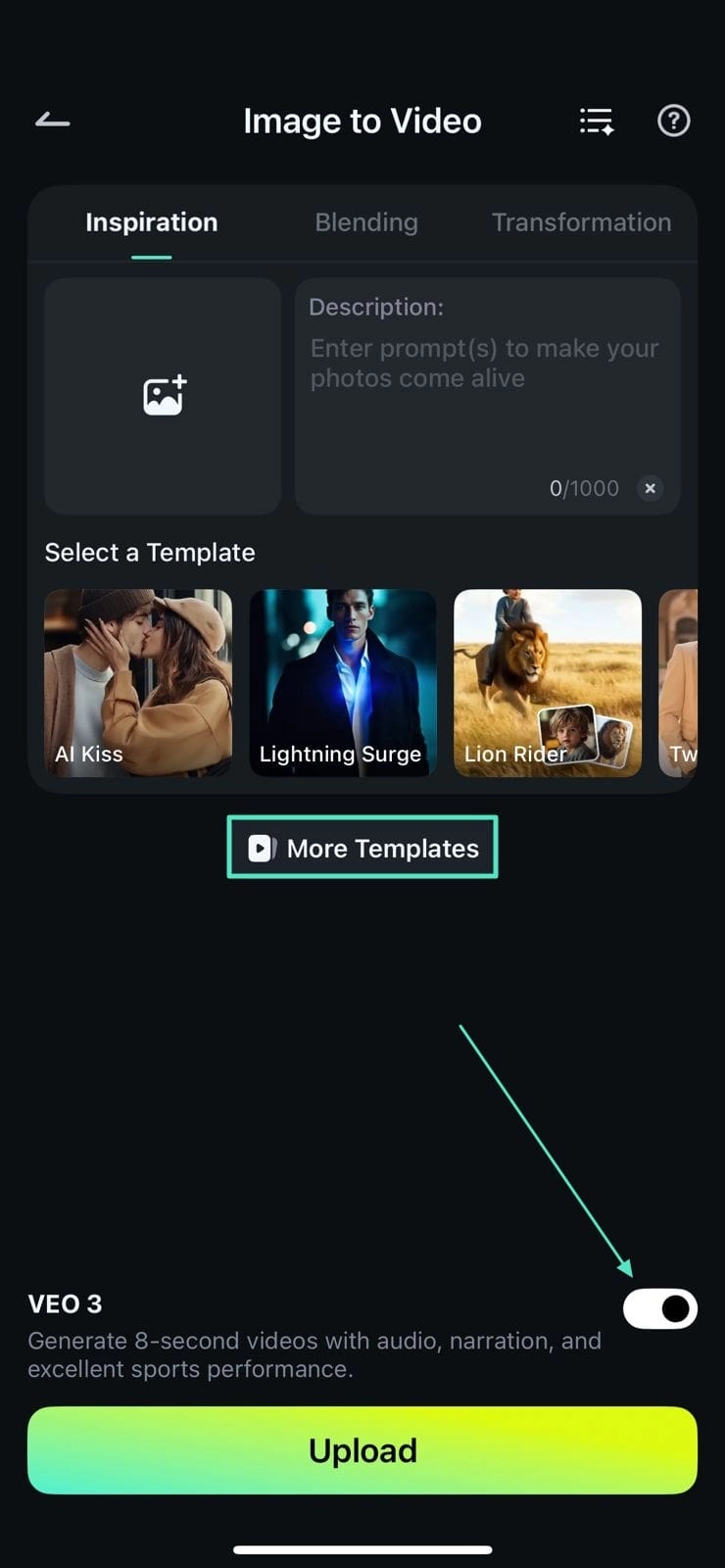

Para desarrolladores y usuarios avanzados, las especificaciones marcan la diferencia. Hailuo 2.3 está disponible mediante interfaz web (por ejemplo, en plataformas como Seadance AI) y también a través de agregadores y proveedores terceros.

| Característica | Especificación | Notas |

|---|---|---|

| Resolución máxima | 1920×1080 (1080p) | Generación nativa, no solo escalado. |

| Duración | Hasta 6–10 segundos | Puede ampliarse con funciones de “extend” en algunas interfaces. |

| Frecuencia de cuadros | 24, 30 o 60 FPS | Seleccionable en modos Pro. |

| Relaciones de aspecto | 16:9, 9:16, 1:1, 4:3 | Soporta formato vertical para TikTok/Shorts. |

| Entradas | Texto-a-video (T2V), imagen-a-video (I2V) | I2V es especialmente fuerte en consistencia de personajes. |

| Modelo de precios | Suscripción / basado en créditos | Aproximadamente 0,30–0,50 US$ por generación HD (según proveedor). |

| Latencia de la API | ~30–60 segundos | Modo estándar; algunos servicios ofrecen modo rápido. |

Aplicaciones reales: ¿para quién es Hailuo 2.3?

Hailuo 2.3 no es un juguete; está entrando en pipelines de producción reales.

1. E‑commerce y publicidad

Este es quizá su caso de uso estrella. La capacidad de tomar una foto de producto (por ejemplo, un frasco de perfume) y generar un video donde aparece en un arroyo o rodeado de pétalos flotando resulta extremadamente potente para las marcas.

- Caso práctico: A partir de una simple foto de zapatilla, se generó un anuncio en el que la sneaker pisa un charco. La física de las salpicaduras resultó tan creíble que no fue necesaria una simulación CGI tradicional, ahorrando miles de dólares en VFX.

2. Contenido para redes sociales (TikTok/Reels)

Con el modelo Hailuo 2.3 Fast, los creadores pueden producir B-roll a gran escala para canales sin rostro. La buena alineación con el prompt permite generar metáforas visuales muy concretas (“un cerebro brillando con energía”) para contenido educativo casi al instante.

3. Cine independiente y previsualización

Directores y directoras usan Hailuo 2.3 para previs. En vez de dibujar storyboards, generan directamente planos animados para mostrar a los equipos de rodaje la intención de luz y movimiento de cámara.

- Ejemplo: “Plano general cinematográfico, travelling de acercamiento, ciudad distópica, niebla naranja.” En unos 60 segundos se obtiene una referencia animada de atmósfera y composición de luz.

4. Desarrollo de videojuegos

Estudios de juegos utilizan el modelo para generar texturas animadas o elementos de fondo (por ejemplo, un portal mágico en bucle), que luego integran en motores como Unity o Unreal.

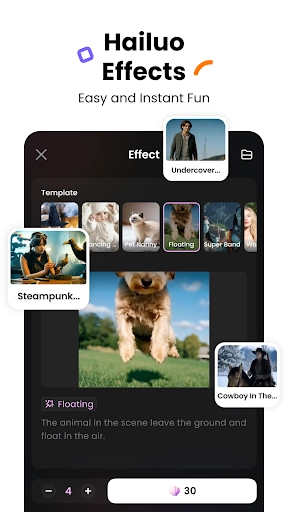

Figura 4: La interfaz móvil facilita la creación de contenido en movimiento para responsables de social media.

Comparativa: Hailuo 2.3 vs Hailuo 2.3 Fast

MiniMax ofrece dos “sabores” del modelo, y elegir el adecuado es clave para controlar costes y tiempos.

Hailuo 2.3 (Standard)

- Mejor para: Render final, anuncios, narrativa cinematográfica.

- Fortalezas: Máxima precisión física, texturas de mayor calidad, cálculos de iluminación más elaborados.

- Desventajas: Tiempos de generación más largos (hasta varios minutos) y coste más alto por segundo de video.

Hailuo 2.3 Fast

- Mejor para: Ideación, storyboard, loops para redes, memes.

- Fortalezas: Velocidad muy alta (a menudo menos de 30 segundos por clip) y coste aproximadamente un 50 % menor.

- Desventajas: Física algo menos precisa; los fondos pueden mostrar pequeñas inconsistencias y las manos en poses complejas siguen siendo un punto débil ocasional.

Recomendación: Utiliza primero Fast para iterar y ajustar el prompt hasta tener el encuadre ideal. Luego, usa el mismo prompt (y la misma seed) con el modelo Standard para el render final de máxima calidad.

Limitaciones y retos actuales

A pesar de todo lo anterior, Hailuo 2.3 no es perfecto. En aras de una crítica equilibrada, vale la pena señalar sus puntos débiles.

- Texto dentro del video: Como la mayoría de modelos de video, tiene dificultades para generar texto legible dentro de la escena (por ejemplo, un cartel de neón con una palabra exacta). Sigue siendo recomendable usar herramientas especializadas como Ideogram para el arte con texto y luego animarlo con Hailuo.

- Consistencia temporal en clips largos: A 6 segundos, la coherencia temporal es excelente, pero al extender clips hasta los 15–20 segundos pueden aparecer transiciones “de sueño”, como un cambio gradual de día a atardecer sin motivo narrativo.

- Interacciones complejas de manos: Aunque caminar y el movimiento del cuerpo completo están prácticamente resueltos, las acciones finas con los dedos (tocar la guitarra, teclear) pueden seguir generando los temidos “dedos de espagueti”, aunque menos que en la versión 02.

- Filtros de seguridad y censura: El modelo incluye fuertes barreras de seguridad. Son necesarias, pero en ocasiones pueden activar falsos positivos ante prompts inocentes, sobre todo cuando hay ambigüedades en el lenguaje usado.

Implicaciones futuras para la video IA

El lanzamiento de Hailuo 2.3 indica que el mercado está madurando. Estamos pasando del simple “wow, se mueve” al “¿es realmente utilizable en producción?”.

- La “comoditización” de la física: MiniMax demuestra que la física realista ya no es dominio exclusivo de motores como Unreal o Unity; los modelos generativos empiezan a aprender las leyes del mundo real.

- Flujos de trabajo centrados en el director: Es probable que futuras actualizaciones permitan cambiar la luz o el ángulo de cámara después de la generación, acercándonos a un sistema de edición de video volumétrico plenamente dirigido por IA.

- Guerra de precios: Con una calidad tan alta a un coste tan bajo, Hailuo obliga a competidores occidentales como Runway o Luma a ajustar precios o a ofrecer una mejora radical de capacidades para seguir siendo relevantes.

Conclusión

Hailuo 2.3 es mucho más que una actualización incremental; es una declaración de intenciones. Al dominar el control del movimiento y la física, MiniMax resuelve dos de las mayores quejas sobre el video generado por IA y acerca todavía más lo generado a lo filmado.

Para marketers, cineastas y creadores, Hailuo 2.3 marca el momento en que el video con IA deja de ser algo “experimental” para convertirse en algo “esencial”. Si aún no lo has probado, estás trabajando con suposiciones ya desfasadas sobre lo que la IA puede hacer hoy. El rascacielos está construido; la vista desde la cima es espectacular.

Figura 5: Ejemplo del tipo de salida de alta fidelidad que se puede obtener con Hailuo 2.3.