Mit der Einführung des bahnbrechenden multimodalen Videomodells von Seedance 2.0, ByteDance hat die KI-Videoerzeugungslandschaft einen seismischen Wandel erfahren. Bei der Veröffentlichung im Februar 2026 handelt es sich nicht nur um ein weiteres inkrementelles Update, sondern um eine grundlegende Neuinterpretation der Art und Weise, wie YouTuber mit KI-Videotools interagieren. Während Konkurrenten wie Sora 2, Veo 3.1 und Kling 3.0 ihre Ansätze weiter verfeinern, führt Seedance 2.0 ein Steuerungssystem auf Regisseurebene ein, das die Videogenerierung von Rätselraten in präzises Filmemachen verwandelt.

Für Entwickler, die von der „Black-Box“-Natur der KI-Videotools der ersten Generation frustriert sind – bei denen Sie eine Eingabeaufforderung eingeben, die Daumen drücken und hoffen, dass die Ausgabe Ihrer Vision entspricht – bietet Seedance 2.0 ein völlig anderes Paradigma. Durch das innovative @reference-System und die multimodale Architektur können Sie jetzt jedes Element Ihres Videos mit dem gleichen Maß an Kontrolle orchestrieren, das ein Regisseur am Set ausübt. Dieser Leitfaden zeigt Ihnen genau, wie Sie diese Leistungsfähigkeit nutzen können, mit praktischen Prompt-Frameworks, technischen Erkenntnissen und Strategien, die aus Tests in der Praxis und Community-Feedback stammen.

Was Seedance 2.0 von anderen KI-Videomodellen unterscheidet

Bevor Sie sich mit Aufforderungstechniken befassen, müssen Sie die einzigartige Architektur von Seedance 2.0 verstehen. Im Gegensatz zu herkömmlichen Text-zu-Video-Modellen, die Eingabeaufforderungen als vage Vorschläge behandeln, verwendet Seedance 2.0 einen Diffusionstransformator mit zwei Zweigen, der visuelle und Audiodaten gleichzeitig verarbeitet. Diese architektonische Wahl beseitigt das häufige Problem der audiovisuellen Drift – wenn Schritte nicht mit dem Gehen synchronisiert werden oder Explosionen den Eindruck erwecken, von ihrer visuellen Wirkung getrennt zu sein.

Das multimodale Eingabesystem des Modells akzeptiert bis zu 12 Referenzdateien in einer einzigen Generation: 9 Bilder für Charaktere, Umgebungen und Stilreferenzen; 3 Videoclips von insgesamt 15 Sekunden für Kamerafahrten und Action-Choreographie; und 3 Audiodateien mit einer Gesamtlänge von 15 Sekunden für Musik, Dialoge und Soundeffekte. Jede Referenz kann mithilfe des Notationssystems @reference mit Tags versehen und gezielt gesteuert werden, sodass Sie genau steuern können, wie jedes Element die endgültige Ausgabe beeinflusst.

Was Seedance 2.0 wirklich auszeichnet, ist sein Verständnis der realen Physik. Das Modell animiert nicht nur Objekte – es simuliert auch, wie sie sich unter physikalischen Kräften verhalten. Wenn Sie das Driften eines Autos beschreiben, berechnet Seedance 2.0 die Gewichtsverteilung, die Reifenreibung und den Impuls. Wenn Sie nach herabfallenden Trümmern fragen, werden Schwerkraft, Kollisionsdynamik und Materialeigenschaften berücksichtigt. Diese physikbewusste Generation produziert Videos, die sich authentisch und nicht künstlich flüssig anfühlen, ein entscheidender Unterschied für professionelle Anwendungen.

Seedance AI bietet Entwicklern Zugriff auf diese Spitzentechnologie über eine intuitive Plattform, die mehrere hochmoderne Video- und Bildgenerierungsmodelle integriert. Mit Seedance AI können Sie die leistungsstarken Funktionen von Seedance 2.0 zusammen mit anderen branchenführenden Tools nutzen, alles in einem einzigen, optimierten Workflow, der auf maximale kreative Effizienz ausgelegt ist.

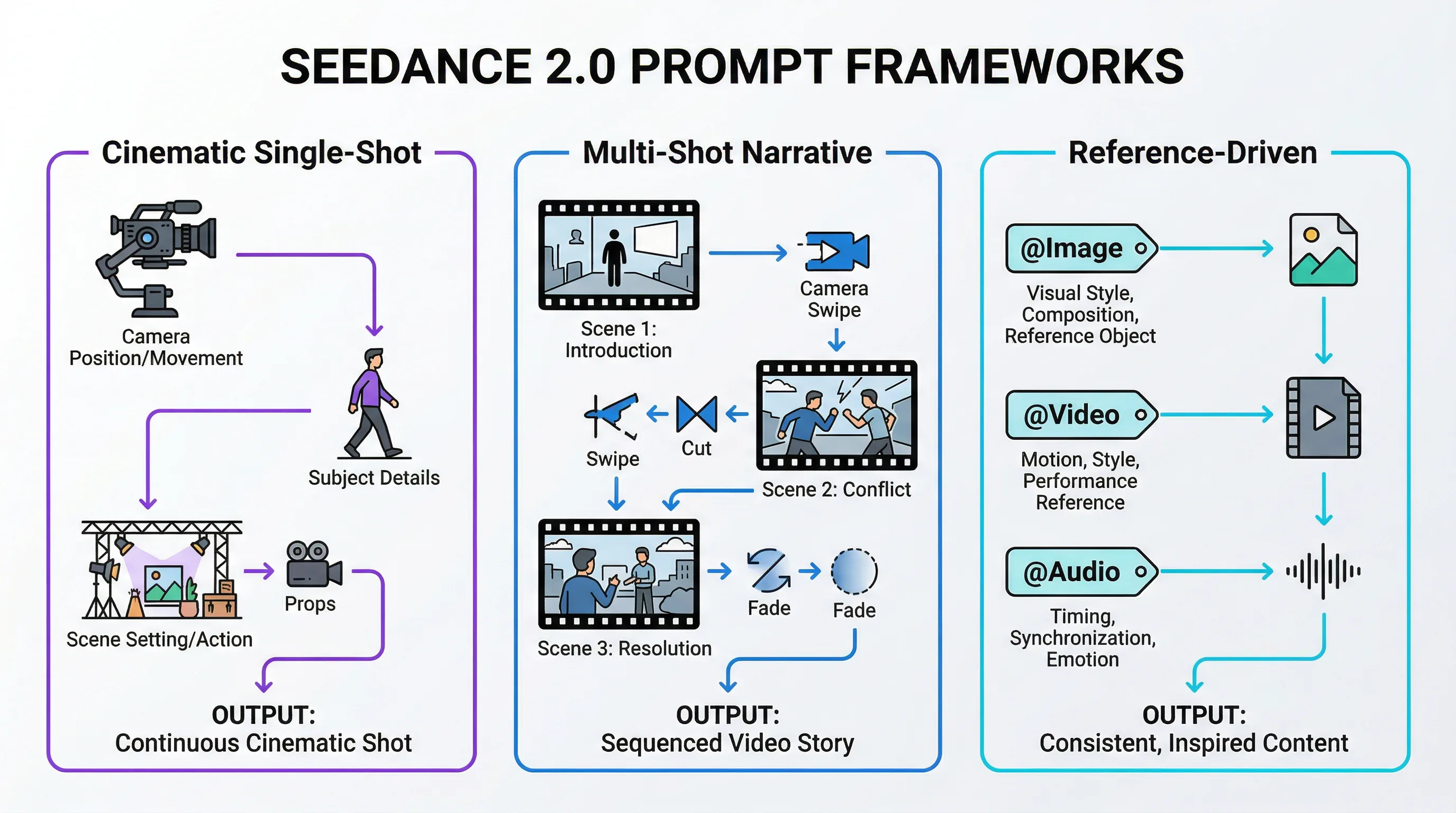

Die drei Kern-Prompt-Frameworks, die tatsächlich funktionieren

Nach umfangreichen Community-Tests und Analysen erfolgreicher Generationen sind drei Prompt-Frameworks als Grundlage für konsistente, qualitativ hochwertige Ergebnisse entstanden. Dabei handelt es sich nicht um willkürliche Vorlagen, sondern um Strukturmuster, die sich an der Art und Weise orientieren, wie die neuronale Architektur von Seedance 2.0 Anweisungen interpretiert.

Rahmen 1: Die filmische Single-Shot-Struktur

Dieses Framework eignet sich am besten für kontinuierliche Actionsequenzen und emotionale Momente, bei denen die Aufrechterhaltung der visuellen Kohärenz über die gesamte Dauer von größter Bedeutung ist.

Kernlogik: Motiv + Szene/Atmosphäre + Aktion/Performance + Kamerabewegung + Stil/Beleuchtung

Beispielaufforderung:

„Eine junge Frau in einer roten Lederjacke steht nachts am Rand eines regennassen Daches, Leuchtreklamen spiegeln sich in Pfützen um ihre Füße. Sie dreht sich langsam zur Kamera, der Wind erfasst ihre Haare, während in der Ferne Donner grollt. Die Kamera fährt in einer sanften Dolly-Bewegung zurück und gibt den Blick auf die weitläufige Cyberpunk-Stadtlandschaft hinter ihr frei. Kinobeleuchtung mit hohem Kontrast, Filmkörnungstextur, stimmungsvolle Farbabstufung mit Blaugrün- und Orangetönen.“

Diese Struktur gibt Seedance 2.0 klare Antworten auf die Fragen, die ihre Architektur lösen muss: Wer oder was ist das Subjekt? Wo findet das statt? Was passiert während der Aufnahme? Wie fängt die Kamera es ein? Wie ist die visuelle Ästhetik? Wenn diese Elemente explizit definiert sind, kann das Modell seine Rechenressourcen effizient zuweisen, anstatt Annahmen zu treffen.

Rahmen 2: Die Multi-Shot-Erzählsequenz

Die einzigartige Fähigkeit von Seedance 2.0, Videos mit natürlichen Schnitten und Übergängen innerhalb einer einzigen 15-Sekunden-Ausgabe zu generieren, macht dieses Framework besonders leistungsstark für Storytelling-Anwendungen.

Kernlogik: Beschreibung von Aufnahme 1 -> Übergangshinweis -> Beschreibung von Aufnahme 2 -> (optional) Beschreibung von Aufnahme 3

Beispielaufforderung:

„Aufnahme 1: Nahaufnahme von Händen, die ein mechanisches Gerät zusammenbauen, präzise Bewegungen, Deckenbeleuchtung, die scharfe Schatten wirft. Schnitt auf: Mittlere Aufnahme der Werkstatt eines Erfinders, vollgestopft mit Bauplänen und Werkzeugen, das Gerät liegt jetzt fertig auf der Werkbank. Schnitt auf: Weitaufnahme durch das Werkstattfenster, während eine Lichtexplosion aus dem Gerät ausbricht und den gesamten Raum erleuchtet. Schnelle Schnitte mit zunehmender Energie, dokumentarische Handkamera, warmes Wolframlicht, das in kühles blaues Licht übergeht.“

Der Schlüssel zum Erfolg dieses Frameworks liegt in der Verwendung expliziter Übergangshinweise („Cut to“, „Transition to“, „Shift to“), die dem Modell Schussgrenzen signalisieren. Ohne diese Markierungen könnte Seedance 2.0 versuchen, flüssige Kamerabewegungen zwischen Kompositionen zu erzeugen, bei denen es sich um unterschiedliche Aufnahmen handeln sollte, was zu unangenehmen Zwischenbildern führen würde.

Framework 3: Die referenzgesteuerte Komposition

Dieses fortschrittliche Framework nutzt das @reference-System von Seedance 2.0, um eine beispiellose Kontrolle über bestimmte visuelle Elemente, Bewegungsmuster und Audiosynchronisation zu erreichen.

Kernlogik: Basisbeschreibung + @Bildreferenzen für visuelle Elemente + @Videoreferenzen für Bewegung + @Audioreferenzen für Rhythmus

Beispielaufforderung:

„Ein Tänzer führt zeitgenössische Choreografie in einem verlassenen Lagerhaus auf. Verwenden Sie @Image1 als Charakterreferenz für das Aussehen und Kostüm des Tänzers. Referenz @Video1 für den flüssigen, ausdrucksstarken Bewegungsstil – insbesondere die Armverlängerungen und die Bodenarbeit. Wenden Sie @Image2 für die industrielle Lagerhausumgebung mit zerbrochenen Fenstern und dramatischen Lichtstrahlen an. Synchronisieren Sie die Bewegungstakte mit dem musikalischen Rhythmus von @Audio1. Die Kamera führt a aus 360-Grad-Umkreisung des Tänzers unter Beibehaltung mittlerer Distanz. Kontrastreiche Beleuchtung mit volumetrischen Lichtstrahlen, entsättigte Farbpalette mit selektiver Farbe auf dem Kostüm des Tänzers.

Dieser Rahmen erfordert eine sorgfältige Vorbereitung – Ihre Referenzdateien müssen von hoher Qualität (mindestens 1080p für Bilder, klare Aktion in Videoreferenzen) und konzeptionell ausgerichtet sein. Das Modell schneidet am besten ab, wenn Referenzen unterschiedlichen Zwecken dienen und sich nicht überschneiden. Verwenden Sie beispielsweise nicht mehrere Bilder, die alle versuchen, den Charakter zu definieren; Verwenden Sie stattdessen eine für den Charakter, eine für die Umgebung und eine für den Beleuchtungsstil.

Technische Parameter und Einstellungen, die sich auf die Ausgabequalität auswirken

Über die Eingabeaufforderungsstruktur hinaus ermöglicht Ihnen das Verständnis der technischen Parameter von Seedance 2.0 eine Optimierung für bestimmte Anwendungsfälle und Qualitätsanforderungen.

Auswahl der Auflösung und des Seitenverhältnisses

Seedance 2.0 generiert Videos mit Auflösungen von bis zu 1080p, wobei zu beachten ist, dass die tatsächliche native Auflösung 720p beträgt, die dann hochskaliert wird. Diese Unterscheidung ist für professionelle Anwendungen wichtig, bei denen Farbkorrektur und Postproduktionsintegration erforderlich sind. Die begrenzte Farbtiefe im Vergleich zu nativem 1080p- oder 4K-Filmmaterial kann bei der Zuordnung von KI-generiertem Inhalt zu traditionell gefilmtem Material zu Herausforderungen führen.

Das Modell unterstützt sechs Seitenverhältnisse, die jeweils für unterschiedliche Vertriebskanäle optimiert sind:

| Seitenverhältnis | Bester Anwendungsfall | Generationsqualität |

|---|---|---|

| 16:9 | YouTube, traditionelles Video, Inhalte im Querformat | Ausgezeichnet – die meisten Trainingsdaten |

| 9:16 | TikTok, Instagram Reels, vertikaler mobiler Inhalt | Ausgezeichnet – optimiert für soziale Netzwerke |

| 4:3 | Vintage-Ästhetik, nostalgischer Inhalt, TV-Format | Gut – weniger verbreitet, aber unterstützt |

| 3:4 | Porträtfotografiestil, Produktpräsentationen | Gut – vertikal mit mehr Kopffreiheit |

| 21:9 | Kinoreifes Breitbild, dramatische Kompositionen | Ausgezeichnet – echtes Kinogefühl |

| 1:1 | Instagram Feedbeiträge, Profilvideos, symmetrische Kompositionen | Gut – Flexibilität im quadratischen Format |

Bei der Auswahl des richtigen Seitenverhältnisses kommt es nicht nur darauf an, wo Sie veröffentlichen, sondern auch darauf, wie Seedance 2.0 die Aufnahme komponiert. Das Modell hat unterschiedliche Kompositionskonventionen für jedes Verhältnis gelernt, sodass eine 21:9-Eingabeaufforderung natürlich breitere Aufnahmeaufnahmen und horizontale Bewegungen bevorzugt, während 9:16-Eingabeaufforderungen eher zu vertikaler Aktion und porträtorientierter Rahmung tendieren.

Dauerstrategie: 4-Sekunden-Clips vs. 15-Sekunden-Sequenzen

Seedance 2.0 bietet Generierungslängen von 4 bis 15 Sekunden, aber die optimale Wahl hängt von der Komplexität Ihres Inhalts und der beabsichtigten Verwendung ab.

4-7 zweite Generationen:

-

Geeignet für: Single-Action-Beats, Reaktionsaufnahmen, Einspielaufnahmen, Social-Media-Clips

-

Vorteile: Höhere Konsistenz, weniger Driftmöglichkeiten, schnellere Generierungszeiten

-

Schnelles Vorgehen: Konzentrieren Sie sich auf eine klare Aktion oder einen klaren Moment

10–15 zweite Generationen:

-

Geeignet für: Mehrfachsequenzen, Erzählstränge, komplexe Choreografien, Musikvideosegmente

-

Vorteile: Natürliches Tempo, Platz für Bildübergänge, komplette Story-Beats

-

Prompter Ansatz: Struktur mit klarer Anfang-Mitte-Ende- oder Schuss-für-Schuss-Aufschlüsselung

Für Projekte, die längere Inhalte erfordern, besteht der empfohlene Arbeitsablauf darin, 15-Sekunden-Segmente zu generieren und die endgültigen Frames als Referenzmaterial für die nächste Generation zu verwenden, um nahtlose Erweiterungen zu erstellen. Diese Technik gewährleistet die visuelle Konsistenz und umgeht gleichzeitig die Längenbeschränkung auf eine Generation.

Fortgeschrittene Aufforderungstechniken: Kamerasteuerung und Bewegungsdynamik

Eine der berühmtesten Fähigkeiten von Seedance 2.0 ist sein ausgefeiltes Verständnis der Kinematographie. Das Modell reagiert genau auf die professionelle Kameraterminologie, sodass Sie Aufnahmen in der gleichen Sprache führen können, die Sie mit einem echten Kameramann verwenden würden.

Professionelle Kamerabewegungen, die funktionieren

Seedance 2.0 führt komplexe Kameraarbeiten aus, die frühere KI-Videomodelle nur schwer richtig interpretieren konnten. Hier sind die Bewegungen, die durchweg hervorragende Ergebnisse liefern:

Dolly-Bewegungen:

-

„Dolly in“ oder „Push in“ – Die Kamera bewegt sich vorwärts auf das Motiv zu

-

„Dolly out“ oder „Pull back“ – Die Kamera bewegt sich rückwärts und gibt so mehr Kontext frei

-

„Dolly-Zoom“ oder „Vertigo-Effekt“ – Gleichzeitiges Zoomen und Dolly in entgegengesetzte Richtungen

Verfolgung und Verfolgung:

-

„Kamerafahrt folgt [Motiv]“ – Kamera bewegt sich neben dem Motiv

-

„Handheld-Folgeaufnahme“ – Fügt natürliche Verwacklungen und ein menschliches Gefühl hinzu

-

„Steadicam-Gleiten“ – Sanfte, schwebende Bewegung durch den Raum

Rotationsbewegungen:

-

„360-Grad-Umlauf um [Subjekt]“ – Kreisbewegung unter Beibehaltung des Abstands

-

„Kran hoch und runter“ – Vertikales Anheben, gefolgt von einer Vorwärtsneigung

-

„POV-Wechsel von [A] nach [B]“ – Perspektivwechsel mitten in der Einstellung

Fokustechniken:

-

„Fokus von [Vordergrund] nach [Hintergrund] verschieben“ – Fokusebene verschieben

-

„Geringe Schärfentiefe bei [Motiv]“ – Unscharfer Hintergrund, scharfes Motiv

-

„Tiefer Fokus mit durchgehender Schärfe“ – Alles im Fokus

Der Schlüssel zu einer erfolgreichen Kameraführung ist Spezifität. Beschreiben Sie statt „Kamerabewegungen“ „langsamer Dolly in über 8 Sekunden“ oder „Handkamerafahrt mit leichtem vertikalen Sprung“. Je genauer Sie den Charakter, die Geschwindigkeit und die Flugbahn der Bewegung definieren, desto genauer wird Seedance 2.0 sie ausführen.

Physikbewusste Handlungsaufforderungen

Die Physiksimulations-Engine von Seedance 2.0 erfordert Eingabeaufforderungen, die reale Kräfte und Materialeigenschaften berücksichtigen. Generische Aktionsbeschreibungen führen zu generischen Ergebnissen. Physikspezifische Sprache erzeugt überzeugende Dynamik.

Statt: „Ein Auto wendet scharf“

Schreiben: „Die Reifen des Autos rauchen, als es um 90 Grad driftet, das Heck rutscht heraus, während die Vorderräder den Grip behalten, das Gewicht verlagert sich sichtbar nach außen.“

Statt: „Gegenstände fallen aus einem Regal“

Schreiben: „Glasflaschen purzeln nacheinander vom Regal, zersplittern beim Aufprall auf den Boden und die Bruchstücke fliegen mit realistischer Dynamik nach außen.“

Statt: „Stoff bewegt sich im Wind“

Schreiben Sie: „Seidenstoff bläht und kräuselt sich im Wind, leichtes Material fängt Luft ein und schwebt, bevor es sich absetzt, schwerere Kanten ziehen nach unten“

Diese physikbewusste Eingabeaufforderung teilt Seedance 2.0 mit, welche physikalischen Prinzipien bei der Simulation Vorrang haben sollen. Das Modell versteht Konzepte wie Impuls, Reibung, Schwerkraft, Elastizität und Kollisionsdynamik – Sie müssen sie jedoch explizit in Ihrer Eingabeaufforderung aufrufen, um dieses Verständnis zu aktivieren.

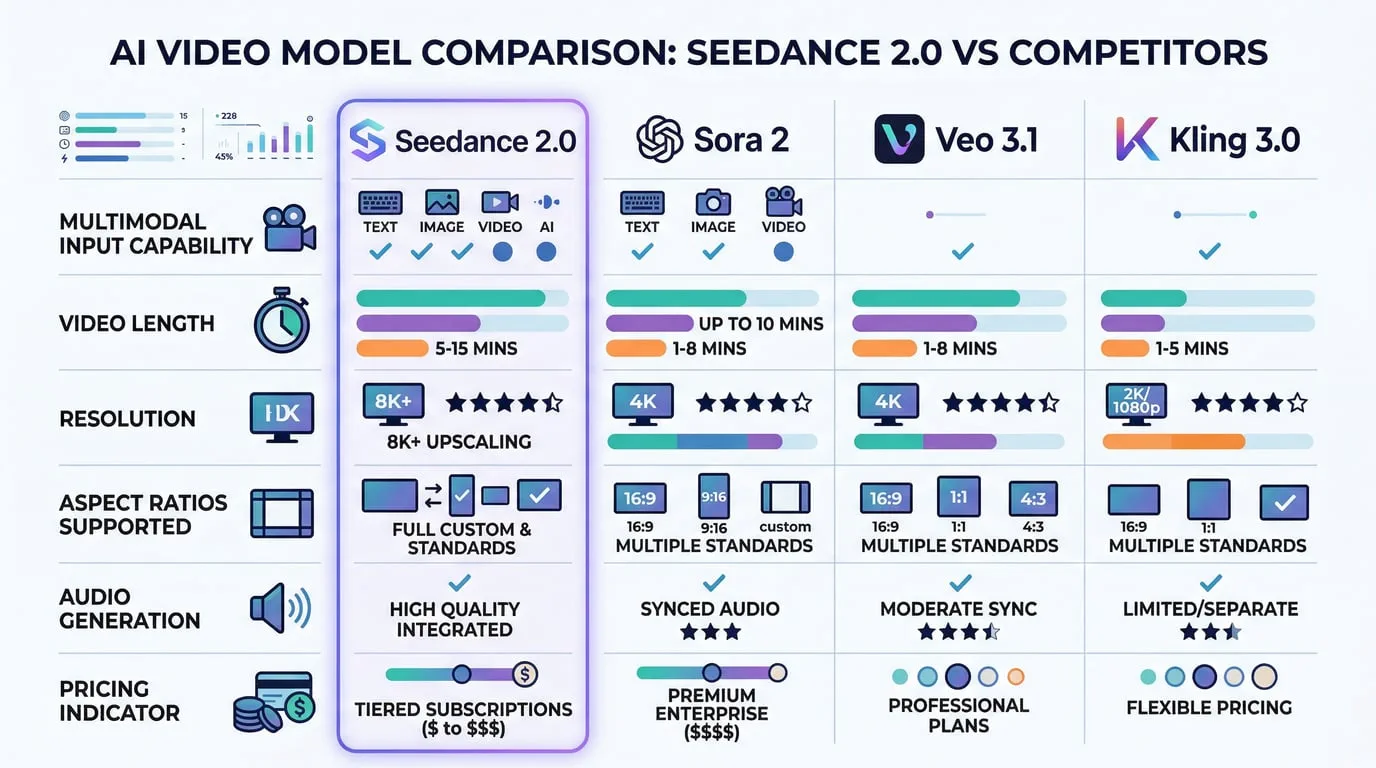

Vergleichende Analyse: Seedance 2.0 vs. konkurrierende Modelle

Wenn Sie wissen, wo sich Seedance 2.0 im Vergleich zu seinen Mitbewerbern auszeichnet, können Sie für jedes Projekt das richtige Tool auswählen und realistische Erwartungen an die Ausgabequalität festlegen.

Seedance 2.0 vs. Sora 2 (OpenAI)

Sora 2 baute seinen Ruf auf der ersten Generation der Physik und emotionaler Subtilität auf. Das Modell zeichnet sich dadurch aus, dass es Videos erstellt, in denen sich Objekte und Umgebungen mit physischer Überzeugung verhalten – die Schwerkraft funktioniert richtig, Materialien reagieren authentisch und Bewegung fühlt sich in der Realität verankert an. Bei Aufnahmen, die natürliche menschliche Emotionen oder subtile Interaktionen mit der Umgebung erfordern, liefert Sora 2 oft differenziertere Ergebnisse.

Allerdings übertrifft Seedance 2.0 Sora 2 in mehreren kritischen Bereichen. Das multimodale Referenzsystem bietet eine weitaus größere kreative Kontrolle – Sie können Bewegungsmuster, Charakterauftritte und Audiosynchronisation direkt festlegen, anstatt darauf zu hoffen, dass das Modell Ihre Textaufforderung richtig interpretiert. Seedance 2.0 generiert auch längere Clips (bis zu 15 Sekunden gegenüber der typischen 10-Sekunden-Grenze von Sora 2) und bietet eine flexiblere Unterstützung für Seitenverhältnisse. Die Preisgestaltung begünstigt stark Seedance 2.0, mit deutlich niedrigeren Kosten pro Generation.

Verwenden Sie Seedance 2.0 für: Referenzintensive kreative Arbeiten, Actionsequenzen, stilisierte Inhalte, Erzählungen mit mehreren Einstellungen, budgetbewusste Projekte

Verwenden Sie Sora 2 für: Aufnahmen, die körperliche Überzeugung, emotionale Subtilität und naturalistisches menschliches Verhalten erfordern, wenn reine Textansagen bevorzugt werden

Seedance 2.0 vs. Veo 3.1 (Google)

Googles Veo 3.1 profitiert von der engen Integration mit der Vertex AI-Infrastruktur von Google Cloud, was es für Unternehmensbereitstellungen und Entwickler, die bereits in das Google-Ökosystem eingebettet sind, attraktiv macht. Veo bietet hervorragende Auflösungsfähigkeiten und starke Leistung bei Architektur- und Umweltinhalten.

Community-Bewertungen zeigen eine inkonsistente Bewegungsqualität in Veo 3.1, insbesondere bei komplexen Actionsequenzen und Charakteranimationen. Die Bewegungsstabilität und die Bild-zu-Bild-Konsistenz von Seedance 2.0 übertreffen im Allgemeinen Veo, insbesondere bei Inhalten mit menschlichen Figuren, Tieren oder dynamischer Kameraführung. Das @reference-System in Seedance 2.0 bietet im Vergleich zum Text- und Bildeingabemodell von Veo auch eine direktere Kontrolle über bestimmte visuelle Elemente.

Verwenden Sie Seedance 2.0 für: Charakteranimationen, Actionsequenzen, Projekte, die eine referenzbasierte Steuerung erfordern, eigenständige kreative Arbeit

Verwenden Sie Veo 3.1 für: Unternehmensbereitstellungen, Google Cloud-Integration, Architekturvisualisierung, wenn die GCP-Infrastruktur bereits vorhanden ist

Seedance 2.0 vs. Kling 3.0 (Kuaishou)

Kling 3.0 hat sich einen Namen für Rapid Prototyping und schnelle Iterationszyklen gemacht. Das Modell lässt sich schnell generieren und verarbeitet einfache Eingabeaufforderungen effizient, sodass es für die Konzepterkundung und die Erstellung grober Entwürfe nützlich ist.

In direkten Qualitätsvergleichen übertrifft Seedance 2.0 durchweg Kling 3.0 in Bezug auf Bewegungsrealismus, visuelle Kohärenz und schnelle Haftung. Klings Ergebnisse können „roboterhafter“ oder künstlicher wirken, insbesondere in Bezug auf menschliche Bewegungen und Gesichtsausdrücke. Auch die Fähigkeiten zur Audioerzeugung von Seedance 2.0 übertreffen die von Kling deutlich, mit besserer Synchronisierung und natürlicherem Klangdesign.

Verwenden Sie Seedance 2.0 für: Endgültige Ergebnisse, Kundenarbeit, Inhalte, die einer Überarbeitung bedürfen, audiovisuelle Synchronisierung

Verwenden Sie Kling 3.0 für: Schnelle Konzepttests, Ideenfindung im Frühstadium, wenn Geschwindigkeit wichtiger ist als Qualität

Der Hybrid-Workflow-Ansatz

Viele professionelle Produktionsteams entscheiden sich nicht für ein einzelnes Modell, sondern nutzen mehrere Tools strategisch. Ein üblicher Arbeitsablauf umfasst die Verwendung von Kling 3.0 für schnelles Prototyping und Konzeptvalidierung, die Verfeinerung vielversprechender Richtungen mit Seedance 2.0 für vorlagenbasierte Arbeit und multimodale Steuerung und die anschließende Verwendung von Sora 2 oder Veo 3.1 für endgültige, qualitativ hochwertige Ergebnisse, wenn ein maximaler physischer Realismus erforderlich ist. Dieser hybride Ansatz nutzt die Stärken jedes Modells und mildert gleichzeitig individuelle Schwächen.

Häufige Aufforderungsfehler und wie man sie behebt

Selbst erfahrene Ersteller stoßen bei der Eingabe von Seedance 2.0 auf konsistente Fehlermuster. Das Verständnis dieser Fallstricke hilft Ihnen, verschwendete Generationen und frustrierende Ergebnisse zu vermeiden.

Fehler 1: Eine einzelne Eingabeaufforderung überladen

Das Problem: Der Versuch, mehrere unterschiedliche Aktionen, Szenenwechsel und komplexe Erzählungen in einer Aufforderung ohne klare Struktur zusammenzufassen.

Beispiel dafür, was nicht funktioniert:

„Ein Detektiv betritt einen dunklen Raum, findet einen Hinweis, hat einen Rückblick auf einen Tatort und rennt dann nach draußen, um einen Verdächtigen durch überfüllte Straßen zu jagen, während Hubschrauber über ihm hinwegfliegen und im Hintergrund Explosionen passieren.“

Warum es fehlschlägt: Seedance 2.0 kann mit Komplexität umgehen, aber nur, wenn es klar strukturiert ist. Diese Eingabe erfordert mehrere Standorte, zeitliche Verschiebungen und gleichzeitige Aktionsstränge, ohne dem Modell einen kohärenten Rahmen für deren Organisation zu geben.

Die Lösung: Teilen Sie komplexe Erzählungen in separate Generationen auf oder verwenden Sie eine explizite Einstellungsstruktur:

„Aufnahme 1: Detektiv stößt eine knarrende Tür auf, der Strahl einer Taschenlampe schneidet durch die Dunkelheit und gibt den Blick auf einen staubigen Raum frei. Aufnahme 2: Nahaufnahme des Gesichts des Detektivs, als das Erkennen dämmert, seine Augen weiten sich. Aufnahme 3: Schneller Schnitt nach draußen – Detektiv stürmt durch die Tür und sprintet die Gasse entlang, die Kamera folgt ihm.“

Fehler 2: Vage Kamerarichtung

Das Problem: Verwendung allgemeiner Kamerabeschreibungen, die weder Bewegungsart, Geschwindigkeit noch Flugbahn angeben.

Beispiel dafür, was nicht funktioniert:

„Kamera bewegt sich um die Szene“

Warum es fehlschlägt: „Umherbewegen“ kann eine Orbit-, Schwenk-, Dolly-, Handheld-Durchgangs- oder Kranbewegung bedeuten – jede führt zu völlig unterschiedlichen Ergebnissen. Das Modell muss Ihre Absicht erraten, oft falsch.

Die Lösung: Verwenden Sie eine bestimmte Kinematographie-Terminologie:

„Die Kamera führt einen sanften 180-Grad-Bogen um das Motiv aus mittlerer Entfernung aus, wobei die Augenhöhe beibehalten wird, und die Bewegung dauert 10 Sekunden.“

Fehler 3: Die audiovisuelle Beziehung ignorieren

Das Problem: Beschreiben visueller Aktionen, ohne darüber nachzudenken, wie generiertes Audio synchronisiert werden soll, oder Hochladen von Audioreferenzen, ohne deren Rolle zu erklären.

Beispiel dafür, was nicht funktioniert:

„Ein Schlagzeuger spielt ein intensives Solo“ (ohne Rhythmusangabe oder Audioreferenz)

Warum es fehlschlägt: Seedance 2.0 generiert sowohl Video als auch Audio, aber ohne Anleitung zu deren Beziehung stimmen die Trommelschläge möglicherweise nicht mit den erzeugten Trommelklängen überein.

Die Lösung: Audio- und visuelle Elemente explizit verbinden:

„Ein Schlagzeuger spielt ein intensives Solo, wobei die Trommelstöcke in schnellen Sechzehntelnoten auf die Snare schlagen, synchronisiert mit der Rhythmusspur von @Audio1, und Beckenschläge, die den Audiospitzen in 3-Sekunden-Intervallen entsprechen.“

Fehler 4: Unzureichender Umweltkontext

Das Problem: Ich konzentriere mich ausschließlich auf Motiv und Handlung und vernachlässige dabei Einstellung, Beleuchtung und atmosphärische Details.

Beispiel dafür, was nicht funktioniert:

„Eine Frau geht vorwärts“

Warum es fehlschlägt: Ohne Umgebungskontext muss Seedance 2.0 die Umgebung, die Beleuchtung, die Tageszeit, das Wetter und die Stimmung erfinden – was oft zu generischen oder inkonsistenten Ergebnissen führt.

Die Lösung: Erstellen Sie einen vollständigen Szenenkontext:

„Eine Frau in einem fließenden weißen Kleid geht im Morgengrauen durch einen nebligen Wald, sanftes goldenes Licht dringt durch die Bäume, Morgennebel wirbelt um ihre Füße, gesprenkelte Schatten spielen quer über ihren Weg.“

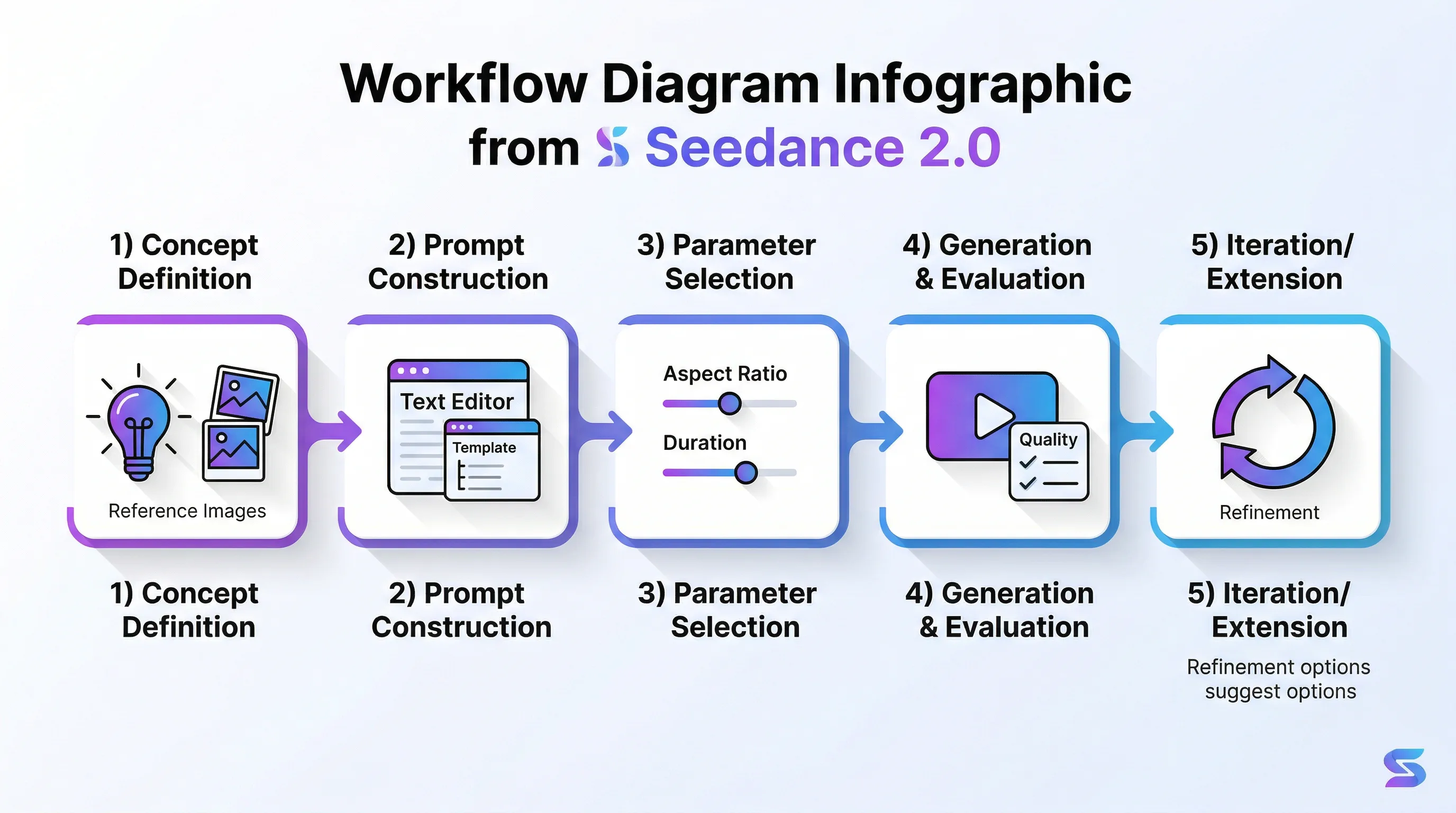

Praktischer Arbeitsablauf: Vom Konzept bis zum fertigen Video

Das Verständnis des End-to-End-Prozesses hilft Ihnen, Projekte effizient zu planen und häufige Workflow-Engpässe zu vermeiden.

Schritt 1: Konzeptdefinition und Referenzsammlung

Beginnen Sie damit, klar zu definieren, was Sie erstellen möchten. Schreiben Sie eine einfache Beschreibung im Klartext: „Ich möchte ein Video einer futuristischen Verfolgungsjagd mit einem Motorrad durch eine neonbeleuchtete Stadt bei Nacht mit dramatischen Kamerawinkeln.“

Sammeln Sie als Nächstes Referenzmaterialien, die Ihre Vision repräsentieren:

-

Charakter-/Themenreferenzen: Fotos oder Illustrationen, die den gewünschten visuellen Stil, das gewünschte Kostüm oder das gewünschte Erscheinungsbild zeigen

-

Umweltreferenzen: Bilder von Orten, Architekturstilen oder atmosphärischen Bedingungen

-

Bewegungsreferenzen: Videoclips, die den Bewegungsstil, die Action-Choreografie oder die Kameraführung veranschaulichen, auf die Sie abzielen

-

Audio-Referenzen: Musiktitel, Soundeffekte oder Dialoge, die mit den Bildern synchronisiert werden sollten

Stellen Sie sicher, dass alle Referenzen von hoher Qualität sind – mindestens 1080p für Bilder, klare Aktionen in Videos, sauberes Audio ohne Komprimierungsartefakte. Eine schlechte Referenzqualität beeinträchtigt direkt die Ausgabequalität.

Schritt 2: Zeitnaher Bau

Erstellen Sie Ihre strukturierte Eingabeaufforderung mithilfe eines der drei Kernframeworks. Beginnen Sie mit den Grundelementen und fügen Sie dann die technischen Details hinzu:

Basisschicht: Betreff, Einstellung, Aktion

Technische Ebene: Kamerabewegung, Beleuchtung, Stil

Referenzebene: @Image-, @Video-, @Audio-Tags mit jeweils spezifischen Anweisungen

Schreiben Sie Ihre Eingabeaufforderung zunächst in einem Texteditor und nicht direkt in der Generierungsoberfläche. Auf diese Weise können Sie die Sprache verfeinern, auf Klarheit prüfen und sicherstellen, dass alle erforderlichen Elemente vorhanden sind, bevor Sie sich auf eine Generation festlegen.

Schritt 3: Parameterauswahl

Wählen Sie Ihre technischen Parameter basierend auf der Art des Inhalts und dem Vertriebskanal:

-

Seitenverhältnis: Passend zu Ihrer Veröffentlichungsplattform

-

Dauer: 4–7 Sekunden für einfache Aktionen, 10–15 Sekunden für Sequenzen

-

Lösung: 1080p für die meisten Anwendungen (Verstehen der nativen Einschränkung 720p)

Schritt 4: Generierung und Auswertung

Erstellen Sie Ihr Video und bewerten Sie es anhand Ihres ursprünglichen Konzepts. Seedance 2.0 liefert konsistente Ergebnisse, aber kein KI-Modell erreicht eine 100 %ige sofortige Einhaltung. Suchen:

-

Bewegungsqualität: Fühlt sich Bewegung natürlich und physikalisch angemessen an?

-

Visuelle Konsistenz: Behalten Charaktere, Objekte und Umgebungen ein stabiles Erscheinungsbild?

-

Audio-Synchronisierung: Stimmen die erzeugten Töne mit visuellen Aktionen überein?

-

Kameraausführung: Folgte die Kamerabewegung Ihrer Richtung?

Schritt 5: Iteration oder Erweiterung

Wenn das Ergebnis nicht Ihren Anforderungen entspricht, identifizieren Sie das spezifische Problem, bevor Sie es neu generieren. Klicken Sie nicht einfach erneut mit derselben Eingabeaufforderung auf „Generieren“, sondern passen Sie das Element an, bei dem der Fehler aufgetreten ist:

-

Bewegungsprobleme -> Spezifischere Physiksprache hinzufügen

-

Visuelle Inkonsistenz -> Referenzbilder für die instabilen Elemente hinzufügen

-

Probleme mit der Audiosynchronisierung -> Geben Sie eine Audioreferenz oder explizitere Timing-Hinweise an

-

Kameraprobleme -> Verwenden Sie eine präzisere Kinematographie-Terminologie

Bei Projekten, die Inhalte mit einer Länge von mehr als 15 Sekunden erfordern, verwenden Sie die letzten Frames Ihrer erfolgreichen Generation als Referenzbilder für das nächste Segment, um die visuelle Kontinuität über mehrere Generationen hinweg aufrechtzuerhalten.

Die berufliche Realität: Wo Seedance 2.0 in Produktionsabläufe passt

Es ist wichtig, realistische Erwartungen an die aktuelle Rolle der KI-Videogenerierung bei der professionellen Inhaltserstellung zu setzen. Trotz beeindruckender Fähigkeiten haben Seedance 2.0 und seine Konkurrenten Hollywood nicht „ersetzt“ oder die Notwendigkeit traditioneller Filmkompetenzen beseitigt.

Die 720p native Auflösung und die begrenzte Farbtiefe des Modells stellen professionelle Postproduktions-Workflows vor Herausforderungen, insbesondere wenn KI-generierte Inhalte mit traditionell gefilmtem Material abgeglichen werden oder eine erweiterte Farbkorrektur durchgeführt wird. Die Ausgabequalität ist zwar für KI-generierte Inhalte beeindruckend, entspricht jedoch noch nicht den technischen Standards, die für große Studioproduktionen, Fernsehübertragungen oder Kinoveröffentlichungen erforderlich sind.

Seedance 2.0 zeichnet sich jedoch in mehreren professionellen Anwendungen aus, bei denen seine Stärken mit den Projektanforderungen übereinstimmen:

Vorvisualisierung und Storyboarding: Erstellen Sie schnelle visuelle Darstellungen geplanter Aufnahmen für die Kundenfreigabe, die Kommunikation mit dem Regisseur oder die Kinematographieplanung, bevor Sie sich auf eine teure Produktion festlegen.

Erstellung von Social-Media-Inhalten: Die 720p-Auflösung ist mehr als ausreichend für Instagram, TikTok, YouTube Shorts und andere soziale Plattformen, bei denen mobile Anzeige und Komprimierung dominieren.

Indie-Animation und VFX-Erweiterung: Unabhängige Entwickler können visuelle Effekte und animierte Sequenzen erzielen, die mit herkömmlichen Techniken zu teuer wären.

Konzeptentwicklung und Pitch-Materialien: Erstellen Sie überzeugende visuelle Konzepte für Präsentationen, Finanzierungs-Pitches oder kreative Erkundungen ohne volle Produktionsinvestitionen.

Rapid Prototyping für kommerzielle Inhalte: Testen Sie schnell mehrere kreative Richtungen für Werbung, Marketingvideos oder Markeninhalte, bevor Sie Produktionsansätze finalisieren.

Seedance AI macht diese professionellen Anwendungen noch zugänglicher, indem es eine einheitliche Plattform bereitstellt, auf der Sie mit Seedance 2.0 neben anderen hochmodernen KI-Modellen arbeiten können. Dieser integrierte Ansatz rationalisiert Arbeitsabläufe, baut technische Hürden ab und ermöglicht es den Entwicklern, sich auf das Storytelling statt auf die Toolverwaltung zu konzentrieren.

Die Kluft zwischen KI-generierten Bildern und traditionellem Filmemachen wird mit jeder Modellgeneration immer kleiner. Seedance 2.0 repräsentiert den aktuellen Stand der Technik und zeigt, dass die KI-Videogenerierung die Schwelle von einer beeindruckenden Demo zu einem wirklich nützlichen Werkzeug für spezifische professionelle Anwendungen überschritten hat.

Fazit: Die neue Sprache der KI-Videoregie beherrschen

Seedance 2.0 führt eine neue kreative Sprache ein – eine, die traditionelles Wissen über das Filmemachen mit technischem Prompt Engineering und multimodaler Orchestrierung verbindet. Um mit diesem Tool Erfolg zu haben, muss nicht nur verstanden werden, was aufgerufen werden soll, sondern auch, wie das Modell Anweisungen interpretiert, Referenzen verarbeitet und die physische Realität simuliert.

Die drei zentralen Prompt-Frameworks bieten eine Grundlage, aber wahre Meisterschaft entsteht durch Experimentieren, Iteration und die Entwicklung einer Intuition dafür, wie Ihre kreative Vision in die strukturierte Sprache übersetzt wird, die Seedance 2.0 versteht. Denken Sie wie ein Regisseur, der klar mit einem äußerst fähigen, aber wörtlich denkenden Team kommunizieren muss – Spezifität, Struktur und technische Präzision führen zu den besten Ergebnissen.

Während sich die KI-Videogenerierungstechnologie rasant weiterentwickelt, werden die Fähigkeiten, die Sie bei der Arbeit mit Seedance 2.0 entwickeln, auf zukünftige Modelle übertragen. Die Grundprinzipien klarer Kommunikation, strukturierter Aufforderung und strategischer Referenznutzung bleiben auch bei Weiterentwicklung der zugrunde liegenden Technologie bestehen.

In der Zukunft der Videoerstellung geht es nicht darum, dass KI die menschliche Kreativität ersetzt – es geht darum, dass KI die Möglichkeiten von YouTubern erweitert, technische Barrieren beseitigt und visuelles Storytelling ermöglicht, das zuvor unmöglich oder unerschwinglich teuer war. Seedance 2.0 stellt einen bedeutenden Schritt in diese Zukunft dar, und wenn Sie seine Fähigkeiten beherrschen, stehen Sie an der Spitze dieser kreativen Revolution.

Bereit, mit der Erstellung mit Seedance 2.0 zu beginnen? Seedance AI bietet nahtlosen Zugriff auf dieses leistungsstarke Modell zusammen mit einer umfassenden Suite von KI-Tools zur Video- und Bildgenerierung, die Ihnen dabei helfen sollen, Ihre kreative Vision mit beispielloser Kontrolle und Effizienz zum Leben zu erwecken.