Die Landschaft der KI-Videogenerierung hat einen entscheidenden Moment erreicht. Nach Monaten inkrementeller Verbesserungen auf verschiedenen Plattformen hat sich ByteDances Seedance 2 als das herauskristallisiert, was Branchenexperten als den "ChatGPT-Moment" für die Videoerstellung bezeichnen. Das ist keine Übertreibung – es stellt einen fundamentalen Wandel dar, wie Kreative die Videoproduktion angehen, weg von einfacher Text-zu-Video-Generierung hin zu sophistizierter multimodaler Orchestrierung.

Wenn Sie von den Einschränkungen bestehender KI-Videotools frustriert waren – inkonsistentes Aussehen von Charakteren, mangelnde Kontrolle über Kamerabewegungen oder die Unfähigkeit, spezifische Stile zu referenzieren – geht Seedance 2 diese Probleme direkt an. Dieser umfassende Leitfaden führt Sie durch alles, was Sie wissen müssen, um dieses bahnbrechende Tool zu meistern, von grundlegenden Konzepten bis hin zu fortgeschrittenen Techniken, die professionelle Kreative genau jetzt nutzen.

Was macht Seedance 2 anders?

Bevor wir in das Wie eintauchen, ist es entscheidend zu verstehen, was Seedance 2 von Konkurrenten wie Sora 2, Veo 3.1, Runway Gen-4 und Kling 3.0 unterscheidet. Die Antwort liegt in seinem multimodalen Referenzsystem – einer Fähigkeit, die den kreativen Workflow grundlegend verändert.

Der multimodale Vorteil

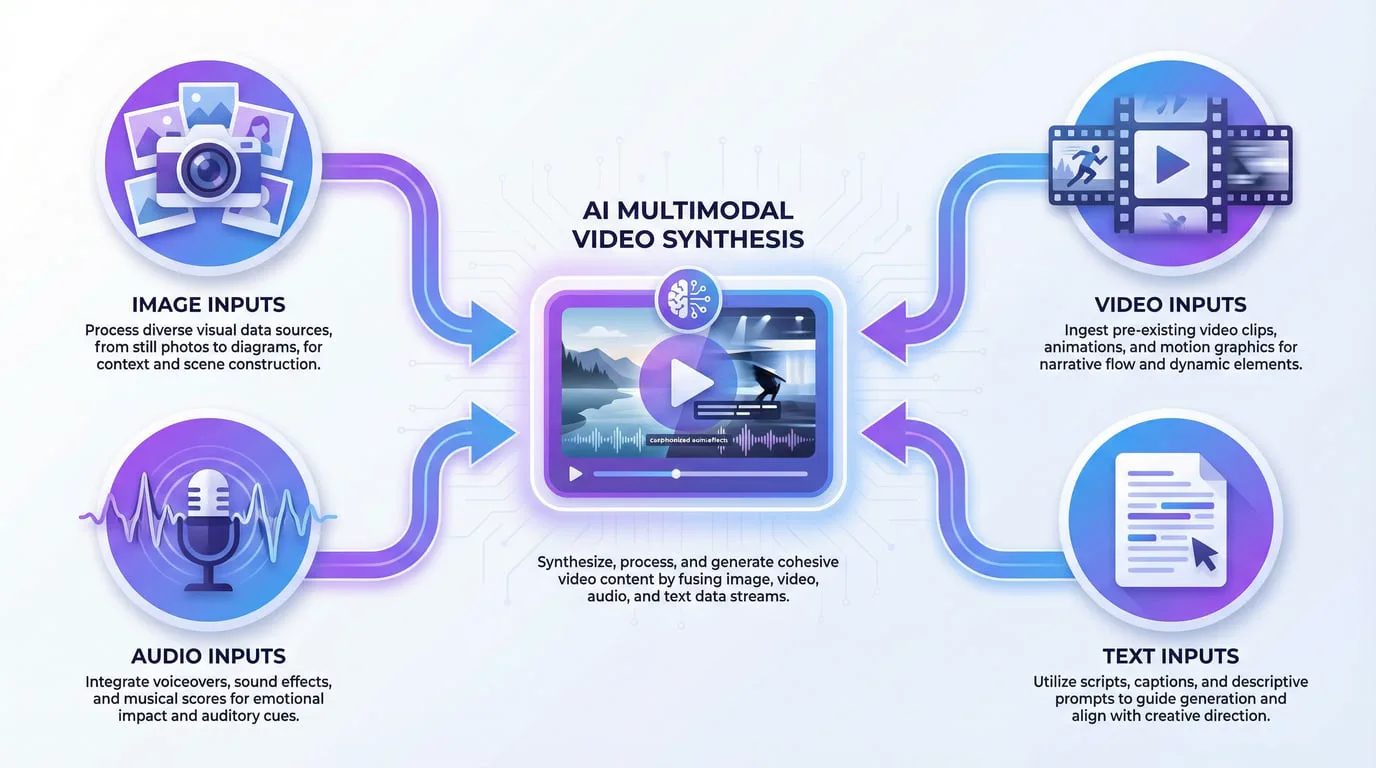

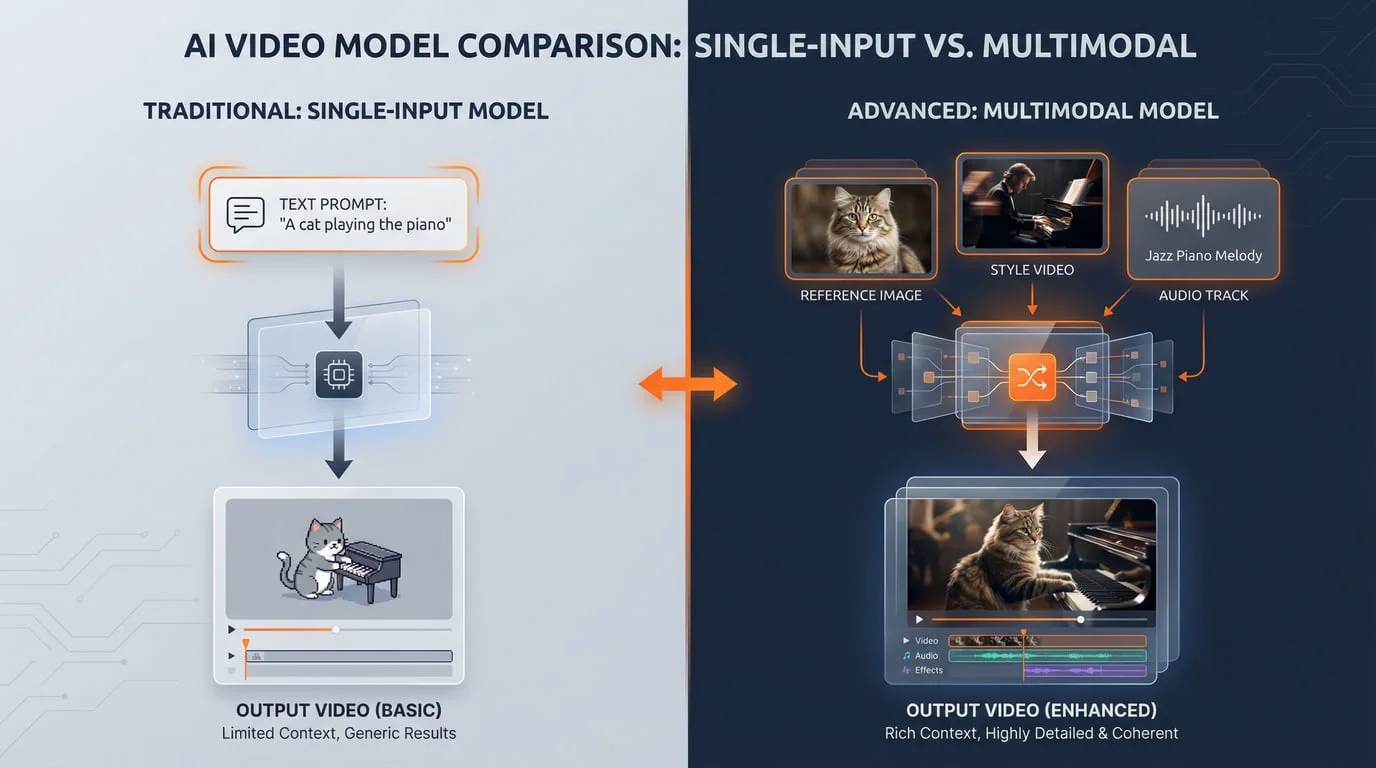

Traditionelle KI-Videogeneratoren arbeiten nach einer einfachen Prämisse: Sie beschreiben im Text, was Sie wollen, und die KI generiert ein Video. Seedance 2 dreht dieses Paradigma um. Anstatt Sie zu zwingen, alles in Worten zu beschreiben, ermöglicht es Ihnen, der KI genau zu zeigen, was Sie wollen, indem Sie bis zu 12 Referenzdateien über vier Modalitäten kombinieren:

-

Bis zu 9 Bilder für Charakterkonsistenz, Szenenkomposition und visuellen Stil

-

Bis zu 3 Videos (15 Sekunden kombiniert) für Kamerabewegungen, Bewegungsmuster und Choreografie

-

Bis zu 3 Audiodateien (15 Sekunden insgesamt) für Rhythmussynchronisation und Beat-Matching

-

Text-Prompts, um die Erzählung zu leiten und zu spezifizieren, wie Referenzen verwendet werden sollen

Dieser multimodale Ansatz löst eines der hartnäckigsten Probleme in der KI-Videogenerierung: Konsistenz. Laut aktuellen Tests von Branchenprofis behält Seedance 2 das Aussehen von Charakteren, Kleidungsdetails und visuellen Stil über Frames hinweg mit beispielloser Zuverlässigkeit bei – eine kritische Anforderung für jede kommerzielle Anwendung.

Wie Seedance 2 im Vergleich zur Konkurrenz abschneidet

Um die Position von Seedance 2 auf dem Markt zu verstehen, lassen Sie uns untersuchen, wie es im Vergleich zu anderen führenden Modellen abschneidet:

| Feature | Seedance 2 | Sora 2 | Veo 3.1 | Runway Gen-4.5 | Kling 3.0 |

|---|---|---|---|---|---|

| Max Auflösung | 1080p (2K Upscaling) | 1080p | 4K nativ | 1080p | 1080p |

| Max Dauer | 4-15 Sekunden (erweiterbar) | 25 Sekunden (Pro) | 8 Sekunden | 16 Sekunden | 10 Sekunden |

| Multimodaler Input | ✓ (Bild + Video + Audio) | Begrenzt (Cameo) | Nur Bild | Nur Bild | Nur Bild |

| Natives Audio | ✓ (Sync + Effekte + Musik) | ✓ | ✓ | ✗ | ✓ |

| Referenzsystem | @-Erwähnungssystem | Begrenzt | Style Transfer | Motion Control | Basis |

| Physischer Realismus | Exzellent | Klassenbester | Exzellent | Sehr Gut | Sehr Gut |

| Preis | Mittelklasse | $20-200/Monat | Variiert | $95/Monat | Wettbewerbsfähig |

Daten zusammengestellt aus mehreren Branchenrezensionen und Testberichten

Wichtige Erkenntnis: Während Sora 2 beim physischen Realismus führend ist und Veo 3.1 eine überlegene Auflösung bietet, gewinnt Seedance 2 entscheidend bei Kontrollierbarkeit und referenzbasierter Generierung. Für Kreative, die spezifische Stile replizieren, Charakterkonsistenz wahren oder Bewegung mit Musik synchronisieren müssen, kommt kein anderes Tool heran.

Erste Schritte mit Seedance 2

Zugriff auf Seedance 2

Seedance 2 ist derzeit über mehrere Plattformen verfügbar, jede mit unterschiedlichen Zugangsmodellen:

Primäre Zugangspunkte:

-

Jimeng (Dreamina) - ByteDances offizielle Plattform

- Neue Nutzer erhalten 3 kostenlose Generierungen

- Tägliche Zuweisung: 120 Punkte

- Kosten: 8 Punkte pro Sekunde Video

- Unterstützt das volle Feature-Set inklusive 2K Upscaling

-

SeaDance AI Plattform - Einheitlicher Zugang

- Zugriff auf Seedance 2 neben anderen hochmodernen Video- und Bildgenerierungsmodellen

- Optimierte Oberfläche für professionelle Workflows

- Flexible Preisoptionen für verschiedene Nutzungsstufen

- Besuchen Sie https://seadanceai.com/seedance-2, um zu beginnen

-

Little Skylark (Xiao Yunque) - Mobile App mit begrenztem kostenlosen Tier

- Zeitlich begrenzter kostenloser Test (Generierungen ziehen keine Punkte ab)

- Muss Seedance 2 manuell aus dem Modell-Dropdown auswählen

- Hinweis: Uploads von echten menschlichen Gesichtern sind aus Compliance-Gründen verboten

Wichtiger Compliance-Hinweis: ByteDance hat Funktionen zur Generierung persönlicher Stimmmerkmale aus Gesichtsfotos aufgrund von Datenschutzbedenken ausgesetzt. Holen Sie immer die Zustimmung für echte menschliche Ähnlichkeiten ein und befolgen Sie lokale Vorschriften bezüglich KI-generierter Medien.

Die Oberfläche verstehen

Sobald Sie auf Seedance 2 zugegriffen haben, werden Sie auf eine Erstellungsoberfläche mit mehreren Schlüsselkomponenten stoßen:

- Referenz-Upload-Bereich: Wo Sie Ihre Bilder, Videos und Audiodateien hinzufügen

- Text-Prompt-Box: Wo Sie Anweisungen mit dem @-Erwähnungssystem schreiben

- Generierungseinstellungen: Dauer (4-15 Sekunden), Seitenverhältnis (16:9, 9:16, 1:1, etc.) und Qualitätsoptionen

- Vorschau und Verlauf: Zugriff auf Ihre generierten Videos und Iterationsverlauf

Das @-Erwähnungssystem: Ihr Schlüssel zu präziser Kontrolle

Das definierende Merkmal von Seedance 2 ist sein @-Erwähnungssystem – ein Ansatz in natürlicher Sprache, um zu spezifizieren, wie jedes hochgeladene Asset verwendet werden soll. Dieses System gibt Ihnen "Kontrolle auf Regie-Ebene" über den Generierungsprozess.

Grundlegende @-Erwähnuns-Syntax

Die Syntax ist intuitiv: @[asset-typ][nummer] gefolgt von Anweisungen, wie es verwendet werden soll.

Beispielstruktur:

@image1 als Hauptcharakter, trägt das Outfit aus @image2,

führt die Tanzbewegungen von @video1 aus, synchronisiert zum Beat von @audio1Praktische @-Erwähnuns-Beispiele

Charakterkonsistenz:

@image1 ist eine junge Frau mit langen schwarzen Haaren. Sie geht bei Sonnenuntergang

durch einen geschäftigen Straßenmarkt in Hongkong und schaut sich verschiedene Stände an.

Die Kamera folgt ihr mit einer sanften Tracking-Aufnahme. Filmische Beleuchtung mit warmen Tönen.Bewegungsreplikation:

@image1 als Subjekt, repliziert exakt die Kamerabewegung und Choreografie

aus @video1. Der Charakter führt bei Dämmerung eine energiegeladene Tanzroutine

auf einem Dach aus. Städtische Skyline im Hintergrund.Stiltransfer mit Audio-Sync:

Erstelle ein Mode-Showcase-Video. @image1 zeigt Gesicht und Ausdruck des Models.

@image2, @image3, @image4 zeigen verschiedene Outfits. Das Model wechselt die Outfits

synchron zu den Beat-Drops in @audio1. Beleuchtung und Kameraführung im Laufsteg-Stil.Multi-Shot Storytelling:

0-3 Sekunden: Nahaufnahme von @image1, Augen fokussiert und entschlossen.

Geräusch: Herzschlag.

4-8 Sekunden: Totale, @image1 steht in Kampfhaltung gegenüber mehreren

Gegnern in Schwarz, unter Bezugnahme auf die Komposition von @image2.

Kamera umkreist die Szene.

9-12 Sekunden: Schnelle Actionsequenz, @image1 besiegt Gegner mit

Bewegungen inspiriert von @video1. Schnelle Schnitte und dynamische Kamerawinkel.

13-15 Sekunden: Schlussszene, @image1 steht siegreich da, schreit "Wer ist der Nächste?".

Dramatische Beleuchtung mit Staubpartikeln in der Luft.Dieses Niveau an Spezifität – das Unterteilen Ihres Videos in Zeitsegmente – ist eines der mächtigsten Features von Seedance 2 für die Erstellung von Inhalten in professioneller Qualität.

Sieben essentielle Techniken zur Meisterung von Seedance 2

Basierend auf umfangreichen Tests durch professionelle Kreative und der Analyse tausender erfolgreicher Generierungen sind hier die Kerntechniken, die Amateur-Ergebnisse von professionellem Output unterscheiden.

1. Regie-Denkweise: Denken in Einstellungen und Sequenzen

Traditionelle KI-Videotools generieren einzelne Clips. Seedance 2 denkt wie ein Regisseur und erstellt automatisch Einstellungssequenzen mit logischen Übergängen, Kamerabewegungen und Rhythmus.

Wie man dies nutzt:

Anstatt eine einzelne Szene zu beschreiben, strukturieren Sie Ihren Prompt als eine Sequenz von Einstellungen mit klarer narrativer Progression:

Der letzte Kampf eines Kampfkunstmeisters:

Eröffnung: Halbnahaufnahme des wettergegerbten Gesichts des Meisters, Augen geschlossen in Meditation.

Umgebungsgeräusche eines Tempels.

Steigende Handlung: Kamera zieht zurück und enthüllt, dass er von 20 Gegnern in

einem runden Innenhof umgeben ist. Spannung steigt mit dramatischer Musik.

Höhepunkt: Explosive Actionsequenz – der Meister bewegt sich blitzschnell,

besiegt Gegner mit präzisen Schlägen. Mehrere Kamerawinkel: Untersicht

für Macht, Obersicht für Choreografie-Übersicht, Nahaufnahmen für Wirkung.

Auflösung: Finaler Schlag in Zeitlupe. Gegner fällt. Meister steht allein,

atmet schwer. Kamera umkreist ihn langsam, während sich der Staub legt.Pro-Tipp: Seedance 2 ist hervorragend darin, Filmsprache zu verstehen. Verwenden Sie Begriffe wie "Rack Focus", "Dolly Zoom", "Dutch Angle", "Tracking Shot" und "Crane Shot", um Kamerabewegungen zu spezifizieren. Das Modell wurde auf professioneller Kinematografie trainiert und reagiert akkurat auf diese Fachbegriffe.

2. Die Strategie des perfekten ersten Frames

Eine der zuverlässigsten Techniken für konsistente, hochwertige Ergebnisse ist der Image-to-Video-Workflow. Anstatt nur mit Text zu beginnen, erstellen oder beschaffen Sie einen perfekten ersten Frame, der Folgendes etabliert:

- Aussehen und Ausdruck des Charakters

- Beleuchtung und Farbpalette

- Komposition und Bildausschnitt

- Visueller Stil und Stimmung

Workflow:

- Generieren Sie Ihren idealen ersten Frame mit einem Bild-KI-Tool (Nano Banana Pro, Seedream, Midjourney, etc.)

- Laden Sie dieses Bild als @image1 hoch

- Schreiben Sie einen Prompt, der die Bewegung und Änderungen beschreibt, die Sie wollen, und referenzieren Sie @image1 als Startpunkt

Beispiel:

@image1 zeigt eine Cyberpunk-Detektivin in einer neonbeleuchteten Gasse. Die Kamera

fährt langsam auf ihr Gesicht zu, während Regen einsetzt. Ihr Ausdruck wechselt

von neutral zu entschlossen. Neonschilder flackern im Hintergrund. Filmische Noir-Beleuchtung

mit starkem Farbkontrast – pinkes und blaues Neon gegen dunkle Schatten.Dieser Ansatz reduziert drastisch das Problem der "Charakter-Drift", das reine Textgenerierung plagt. Laut erfahrenen Kreativen verbessert die Verwendung eines Referenzbildes die Konsistenz um etwa 80% im Vergleich zu reinen Text-Prompts.

3. Bewegungsreferenz: Die "Mach, was das macht"-Technik

Die Videoreferenz-Fähigkeit von Seedance 2 ist revolutionär. Sie können ein Video hochladen, das die exakte Kamerabewegung, Choreografie oder Actionsequenz demonstriert, die Sie wollen, und das Modell wird es mit Ihren eigenen Charakteren und Umgebungen replizieren.

Anwendungsfälle:

Professionelle Kameraführung replizieren:

@image1 als Produkt (eine elegante Drohne). Repliziere die Kamerabewegung und

Beleuchtung von @video1 (ein Luxusauto-Werbespot). Langsam rotierende Kamera mit

dramatischen Lichtenthüllungen. Studioumgebung mit Verlaufs-Hintergrund.

Betone das Premium-Design und technische Details des Produkts.Tanzchoreografie kopieren:

@image1 ist der Tänzer. Führe die exakte Tanzroutine aus @video1 aus,

aber in einer anderen Umgebung – ein Dach bei Sonnenuntergang statt eines Studios.

Behalte das Timing und die Energie der Originalchoreografie bei.

Kamerawinkel sollten der Kinematografie von @video1 entsprechen.Actionsequenz-Vorlagen:

@image1 und @image2 sind die zwei Kämpfer. Rekreiere die Kampfchoreografie

aus @video1 (eine professionelle Kampfkunst-Filmszene), aber setze sie in

ein modernes Büro. Behalte Timing, Intensität und Kamerawinkel

der Referenz bei.Fortgeschrittene Technik: Sie können mehrere Videos für verschiedene Aspekte referenzieren. Zum Beispiel @video1 für Kamerabewegung, @video2 für Charakterbewegung und @video3 für Pacing und Schnittrhythmus. Das Modell wird diese Referenzen intelligent synthetisieren.

4. Audio-Synchronisation: Beat-Perfektes Video

Die native Audiogenerierung von Seedance 2 ist beeindruckend, aber seine Fähigkeit, Video zu hochgeladenem Audio zu synchronisieren, ist das, wo es wirklich glänzt für Kreative, die an Musikvideos, Tanzinhalten oder rhythmusbasiertem Storytelling arbeiten.

Beat-Matching Workflow:

- Laden Sie Ihren Musiktrack als @audio1 hoch

- Spezifizieren Sie in Ihrem Prompt, dass visuelle Änderungen mit dem Beat synchronisieren sollen

- Optional: Beschreiben Sie, was an bestimmten Zeitmarkern passieren soll

Beispiel:

Mode-Transformations-Video. @image1 ist das Gesicht des Models (konsistent durchgehend).

@image2, @image3, @image4, @image5 zeigen verschiedene Outfits.

Das Model wechselt das Outfit bei jedem Bass-Drop in @audio1. Kamera rotiert 360

Grad um das Model während jeder Transformation. Beleuchtung im Laufsteg-Stil

mit dramatischen Schatten. Jeder Outfitwechsel beinhaltet einen kurzen Flash-Übergang.Pro-Tipp: Für maximale Kontrolle nutzen Sie Audiobearbeitungssoftware, um Marker an Schlüsselmomenten (Drops, Übergänge, Höhepunkte) vor dem Hochladen hinzuzufügen. Referenzieren Sie diese Momente in Ihrem Prompt: "Bei der 3-Sekunden-Marke, wenn der Bass einsetzt, zoomt die Kamera dramatisch hinein..."

5. Storyboard- und Shot-List-Generierung

Professionelle Filmemacher arbeiten mit Storyboards und Shot Lists. Seedance 2 kann diese direkt interpretieren, was es unschätzbar für Kreative mit traditionellem Produktionshintergrund macht.

Zwei Ansätze:

A. Ein visuelles Storyboard hochladen:

Erstellen Sie ein einfaches Storyboard-Bild, das Ihre gewünschten Einstellungen in Sequenz zeigt (selbst grobe Skizzen funktionieren). Laden Sie es als @image1 hoch und prompten Sie:

Folge dem Storyboard-Layout aus @image1. Erstelle ein 15-Sekunden-Video,

das dieser Einstellungssequenz folgt:

Panel 1 (0-3s): Eröffnungsaufnahme eines alten Tempels

Panel 2 (4-7s): Halbnahaufnahme eines meditierenden Mönchs

Panel 3 (8-11s): Nahaufnahme der sich öffnenden Augen des Mönchs

Panel 4 (12-15s): Totale, die enthüllt, dass der Mönch von Schülern umgeben ist

Filmische Beleuchtung, friedliche Atmosphäre, subtile Kamerabewegungen.B. Eine detaillierte Shot List schreiben:

Professionelles Video im Dokumentarstil über traditionelles Handwerk:

Einstellung 1 (0-3s): Extreme Nahaufnahme von verwitterten Händen, die ein Schnitzwerkzeug halten.

Geringe Schärfentiefe. Natürliches Fensterlicht von links.

Einstellung 2 (4-7s): Halbnahaufnahme, die den Handwerker an seiner Werkbank zeigt,

umgeben von Werkzeugen und Holzspänen. Kamera zieht langsam zurück.

Einstellung 3 (8-11s): Aufnahme über die Schulter, die die detaillierte Schnitzarbeit

im Gange zeigt. Fokus wechselt von Händen zum geschnitzten Objekt.

Einstellung 4 (12-15s): Weite Eröffnungsaufnahme des traditionellen Werkstattinneren.

Warmes Licht der goldenen Stunde durch Fenster. Staubpartikel in Lichtstrahlen sichtbar.

Audio: Umgebungsgeräusche der Werkstatt – sanftes Schnitzen, fallende Holzspäne.Diese Technik ist besonders effektiv für Kreative, die von traditioneller Videoproduktion zu KI-gestützten Workflows übergehen.

6. Die Iterationsstrategie: Kleine Änderungen, große Verbesserungen

Einer der häufigsten Fehler von Anfängern ist, ihren Prompt komplett neu zu schreiben, wenn eine Generierung nicht den Erwartungen entspricht. Professionelle Kreative nutzen einen anderen Ansatz: iterative Verfeinerung.

Der Prozess:

- Generieren Sie Ihre erste Version mit einem klaren, detaillierten Prompt

- Identifizieren Sie, was funktioniert hat und was nicht (die guten Teile behalten!)

- Ändern Sie nur ein Element für die nächste Generierung:

- Tauschen Sie ein Referenzbild aus

- Passen Sie das Timing einer Einstellung an

- Modifizieren Sie einen Kamerabewegungs-Deskriptor

- Ändern Sie eine Beleuchtungsanweisung

- Vergleichen Sie Ergebnisse und iterieren Sie weiter

Beispiel Iterationssequenz:

Generierung 1:

@image1 geht durch einen Wald im Morgengrauen. Kamera folgt von hinten.

Dunstige Atmosphäre mit weichem Licht.Ergebnis: Gute Atmosphäre, aber Kamerawinkel fühlt sich statisch an.

Generierung 2 (nur Kameraanweisung geändert):

@image1 geht durch einen Wald im Morgengrauen. Kamera umkreist sie, während

sie sich vorwärts bewegt, was eine dynamische Tracking-Aufnahme erzeugt. Dunstige Atmosphäre mit

weichem Licht.Ergebnis: Bessere Kameraarbeit, aber Beleuchtung fühlt sich flach an.

Generierung 3 (nur Beleuchtung geändert):

@image1 geht durch einen Wald im Morgengrauen. Kamera umkreist sie, während

sie sich vorwärts bewegt, was eine dynamische Tracking-Aufnahme erzeugt. Dunstige Atmosphäre mit

dramatischen Lichtstrahlen, die durch die Bäume brechen. Starkes Gegenlicht erzeugt

Silhouette-Momente.Warum das funktioniert: Seedance 2 generiert schnell genug (typischerweise 2-3 Minuten pro Video), dass Sie 5-10 Variationen in 15-20 Minuten testen können. Dieser iterative Ansatz übertrifft konsistent den Versuch, den "perfekten" Prompt beim ersten Versuch zu schreiben.

7. Realitätsbearbeitung: Echtes Filmmaterial transformieren

Eine der praktischsten Anwendungen von Seedance 2 ist Realitätsbearbeitung – echtes Filmmaterial nehmen und es mit KI transformieren. Dies überbrückt die Lücke zwischen traditioneller Videoproduktion und KI-Generierung.

Anwendungsfälle:

Stiltransfer:

@video1 zeigt Rohmaterial einer Stadtstraße bei Nacht. Transformiere dies in

eine Cyberpunk-Ästhetik mit Neonfarben, holografischen Werbeanzeigen und

futuristischen Fahrzeugen. Behalte die originale Kamerabewegung und Komposition bei,

aber interpretiere den visuellen Stil komplett neu.Unmögliche Elemente hinzufügen:

@video1 zeigt mich, wie ich durch einen leeren Flur gehe. Füge übernatürliche Elemente hinzu:

flackernde Lichter, Schatten, die sich unabhängig bewegen, mysteriöser Nebel, der über den

Boden kriecht. Horrorfilm-Atmosphäre mit entsättigten Farben und hohem Kontrast.

Behalte meine Bewegungen exakt so bei, wie im Originalmaterial gezeigt.VFX mit Budget:

@video1 zeigt einen Schauspieler, der eine Handgeste ausführt. Füge magische Energieeffekte hinzu,

die von seinen Händen ausgehen – leuchtende Partikel, elektrische Bögen und ein Beschwörungskreis,

der auf dem Boden erscheint. Fantasyfilm-Ästhetik mit dramatischer Beleuchtung,

die auf die magischen Elemente reagiert.Pro-Tipp: Wenn Sie echtes Filmmaterial als Referenz verwenden, funktionieren kürzere Clips (5-10 Sekunden) am besten. Das Modell behält bessere Konsistenz mit prägnantem Quellmaterial. Für längere Sequenzen teilen Sie diese in Segmente und verarbeiten sie separat, um sie dann in der Postproduktion zusammenzufügen.

Fortgeschrittene Prompting-Techniken für professionelle Ergebnisse

Sobald Sie die Grundlagen gemeistert haben, werden diese fortgeschrittenen Techniken Ihre Arbeit auf professionelle Standards heben.

Vokabular der Filmsprache

Seedance 2 reagiert außergewöhnlich gut auf professionelle Kinematografie-Begriffe. Bauen Sie diese in Ihre Prompts ein für präzise Kontrolle:

Kamerabewegungen:

- Dolly/Tracking Shot: Kamera bewegt sich horizontal neben dem Subjekt

- Crane Shot: Kamera bewegt sich vertikal, enthüllt oft Größe/Skala

- Steadicam: Sanfte, schwebende Kamerabewegung

- Handheld: Subtiles Wackeln für dokumentarisches/realistisches Gefühl

- Whip Pan: Extrem schnelle horizontale Kamerabewegung

- Dolly Zoom (Vertigo-Effekt): Kamera bewegt sich, während Zoom sich anpasst, erzeugt desorientierenden Effekt

Einstellungstypen:

- Establishing Shot: Weite Ansicht, die Ort/Kontext zeigt

- Master Shot: Weite Aufnahme, die alle Charaktere und Handlung zeigt

- Two-Shot: Bildausschnitt mit zwei Subjekten

- Over-the-Shoulder (OTS): Kamera hinter einem Subjekt, das auf ein anderes schaut

- POV Shot: Kamera zeigt Perspektive des Subjekts

- Insert Shot: Nahaufnahme eines wichtigen Details

Beleuchtungsstile:

- Three-Point Lighting: Klassisches Setup mit Führungs-, Aufhell- und Gegenlicht

- Rembrandt Lighting: Lichtdreieck auf der schattigen Wange

- Butterfly Lighting: Licht direkt vor und über dem Subjekt

- Rim Lighting: Starkes Gegenlicht, das Umrisse erzeugt

- Chiaroscuro: Hoher Kontrast zwischen Licht und Schatten

- Golden Hour: Warmes, weiches Licht bei Sonnenaufgang/-untergang

Emotion und Schauspielführung

Während Seedance 2 bei technischen Aspekten brilliert, können Sie auch emotionale Performance inszenieren:

@image1 ist ein älterer Mann, der allein in einem Café sitzt.

0-5s: Er starrt auf ein altes Foto, Ausdruck wechselt von neutral

zu melancholisch. Subtile Performance – nur die Augen und leichtes Herabziehen des Mundes.

Kamera fährt langsam auf halbe Nahaufnahme zu.

6-10s: Ein kleines, bittersüßes Lächeln erscheint, als er sich erinnert. Kamera hält ruhig,

lässt der Performance Raum. Natürliches Fensterlicht erzeugt weiche Schatten.

11-15s: Er legt das Foto sanft ab, atmet tief ein und schaut mit

stiller Akzeptanz aus dem Fenster. Kamera zieht leicht zurück. Umgebungsgeräusche des Cafés

mit sanfter Klaviermusik.Kontext-Engineering für Konsistenz

Wenn Sie eine Serie verwandter Videos erstellen (z.B. für eine Kampagne oder Geschichte), wahren Sie Konsistenz durch Etablierung von Kontext:

[KONTEXT: Dies ist Episode 3 einer Sci-Fi-Serie. Die Protagonistin ist Dr. Sarah Chen,

eine Xenobiologin, die einen fremden Planeten erkundet. Visueller Stil: realistisches Sci-Fi mit

Practical-Effects-Ästhetik, inspiriert von The Expanse. Color Grading: entsättigt

mit blaugrünen Schatten und warmen Highlights.]

Szene: @image1 (Dr. Chen in ihrem Raumanzug) entdeckt alte Alien-Ruinen.

Sie nähert sich vorsichtig, scannt mit ihrem Handgerät. Kamera folgt

von hinten, umkreist dann, um ihr Gesicht durch das Helmvisier zu zeigen – Ausdruck

von Staunen gemischt mit wissenschaftlicher Neugier. Die Ruinen leuchten schwach mit

biolumineszenten Mustern. Atmosphäre: mysteriös, aber nicht bedrohlich.

Ton: Atmen im Anzug, elektronisches Piepen des Scanners, fremdartiger Umgebungswind.Häufige Fallstricke und wie man sie vermeidet

Selbst erfahrene Kreative stoßen bei Seedance 2 auf Herausforderungen. Hier sind die häufigsten Probleme und ihre Lösungen:

Problem 1: Inkonsistentes Charakter-Aussehen

Problem: Merkmale, Kleidung oder Proportionen des Charakters ändern sich zwischen Einstellungen oder innerhalb einer Generierung.

Lösungen:

- Verwenden Sie immer ein Referenzbild (@image1), das das exakte Aussehen des Charakters zeigt

- Seien Sie spezifisch bei unveränderlichen Elementen: "Während des gesamten Videos behält @image1 die gleiche Frisur, Kleidung und Gesichtszüge bei"

- Für Sequenzen mit mehreren Einstellungen generieren Sie jede Einstellung separat mit demselben Referenzbild und schneiden sie dann zusammen

- Verwenden Sie engere Einstellungen (halbe Nahaufnahme, Nahaufnahme) statt weiter Einstellungen für bessere Gesichtskonsistenz

Problem 2: Prompt ignoriert oder missinterpretiert

Problem: Das generierte Video folgt Ihren Anweisungen nicht.

Lösungen:

- Vereinfachen Sie Ihren Prompt – übermäßig komplexe Prompts verwirren das Modell

- Stellen Sie die wichtigsten Anweisungen an den Anfang

- Verwenden Sie klare, konkrete Sprache statt abstrakter Konzepte

- Teilen Sie komplexe Szenen in mehrere Generierungen auf

- Überprüfen Sie, ob Ihre @-Erwähnungen die korrekten hochgeladenen Dateien referenzieren

Problem 3: Unnatürliche Bewegung oder Physik

Problem: Objekte bewegen sich seltsam, Physik wirkt nicht richtig oder Bewegung fühlt sich "schwebend" an.

Lösungen:

- Verwenden Sie eine Videoreferenz (@video1), die die korrekte Bewegung zeigt

- Seien Sie spezifisch bei Geschwindigkeit und Timing: "schnelle Bewegung", "langsam und bedächtig", "plötzliche Beschleunigung"

- Beschreiben Sie Gewicht und Impuls: "schweres Objekt fällt", "leichter Stoff schwebt"

- Für komplexe Physik nutzen Sie einfachere Prompts und verlassen Sie sich auf das Training des Modells statt übermäßig zu beschreiben

Problem 4: Audio passt nicht zu Visuals

Problem: Generiertes Audio fühlt sich unverbunden mit der Handlung an, oder hochgeladenes Audio ist nicht korrekt synchronisiert.

Lösungen:

- Wenn Sie hochgeladenes Audio verwenden, erklären Sie explizit: "Alle visuellen Änderungen müssen präzise mit @audio1 synchronisieren"

- Beschreiben Sie audio-visuelle Verbindungen: "Schritte des Charakters synchronisieren mit dem Beat", "Kamerabewegungen folgen dem Rhythmus der Musik"

- Für Dialoge spezifizieren Sie: "Lippenbewegungen des Charakters müssen der Sprache in @audio1 entsprechen"

- Erwägen Sie, zuerst das Video zu generieren und dann benutzerdefiniertes Audio in der Postproduktion hinzuzufügen für maximale Kontrolle

Problem 5: Content Review Fehler

Problem: Generierung schlägt aufgrund von Inhaltsprüfung fehl, oft ohne klare Erklärung.

Lösungen:

- Vermeiden Sie Namen von Prominenten, öffentlichen Personen oder urheberrechtlich geschützten Charakternamen

- Laden Sie keine Fotos von echten Menschen (besonders Gesichtern) ohne entsprechende Rechte hoch

- Entfernen Sie potenziell sensible Schlüsselwörter (Waffen, Gewalt, politische Begriffe)

- Formulieren Sie Prompts mit neutralerer Sprache um

- Wenn ein Prompt wiederholt fehlschlägt, versuchen Sie einen komplett anderen Ansatz statt kleinerer Bearbeitungen

- Testen Sie zuerst mit einfacheren Prompts, fügen Sie dann schrittweise Komplexität hinzu

Praktische Workflows für häufige Anwendungsfälle

Lassen Sie uns komplette Workflows für beliebte Anwendungen untersuchen:

Workflow 1: Produkt-Showcase-Video

Ziel: Ein Premium-Produktvideo für E-Commerce oder Social Media erstellen.

Schritte:

-

Assets vorbereiten:

- Hochwertiges Produktfoto (sauberer Hintergrund, gute Beleuchtung)

- Optional: Werbevideo einer Luxusmarke als Referenz für Kamerabewegung

- Optional: Peppige Hintergrundmusik

-

Generierungs-Prompt:

@image1 zeigt [Produktname]. Erstelle ein Luxus-Produkt-Showcase-Video.

0-3s: Kamera umkreist langsam das Produkt, beginnend von vorne.

Studiobeleuchtung mit weichen Schatten und subtilen Reflexionen.

Verlaufs-Hintergrund, der von tiefblau zu schwarz übergeht.

4-8s: Kamera fährt näher heran, hebt Hauptmerkmale und Details hervor.

Beleuchtung wechselt, um Premium-Materialien und Handwerkskunst zu betonen.

Zeitlupeneffekt (60fps-Gefühl).

9-12s: Kamera zieht zurück, um das Produkt aus einem Hero-Winkel zu zeigen.

Dramatisches Kantenlicht erzeugt einen leuchtenden Umriss.

Produktname erscheint mit eleganter Typografie.

Referenziere den Kamerabewegungsstil von @video1 (falls Referenz verwendet).

Synchronisiere Kamerabewegungen zum Beat von @audio1 (falls Musik verwendet).

Ästhetik: Premium, sophistiziert, Produktvideo im Apple-Stil.

Hoher Kontrast, perfekte Reflexionen, filmische Schärfentiefe.- Post-Produktion:

- Markenlogo und Textüberlagerungen hinzufügen

- Color Grading für Markenkonsistenz

- Finalen Audiomix hinzufügen, falls nötig

Workflow 2: Social Media Content Erstellung

Ziel: Ansprechende Kurzform-Inhalte für TikTok, Instagram Reels oder YouTube Shorts erstellen.

Schritte:

-

Konzept: Trendiger Tanz, Transformation oder Storytelling-Format

-

Asset-Vorbereitung:

- KI-generierter Charakter oder persönliches Foto

- Referenzvideo des Trends, den Sie nachstellen

- Trendiger Audiotrack

-

Generierungs-Prompt:

@image1 ist der Hauptcharakter. Rekreiere den viralen Tanztrend aus @video1,

aber an [einzigartigem Ort]. Passe das Timing der Choreografie exakt an.

Kameraarbeit sollte die Winkel und Bewegungen von @video1 replizieren.

Synchronisiere alle Bewegungen zu den Drops und dem Rhythmus von @audio1.

Hohe Energie, lebendige Farben, optimiert für vertikales 9:16 Format.

Beleuchtung: Hell und vorteilhaft, mit starker Farbsättigung für

Social-Media-Attraktivität.- Optimierung:

- Im 9:16 Seitenverhältnis generieren

- Dauer 7-15 Sekunden halten für maximales Engagement

- Untertitel und Hashtags im Post hinzufügen

Workflow 3: Bildungs-/Tutorial-Inhalte

Ziel: Erklärvideos oder visuelle Tutorials erstellen.

Schritte:

-

Segmente skripten:

- Komplexe Themen in 3-5 visuelle Segmente unterteilen

- Schlüsselkonzepte identifizieren, die visuelle Darstellung benötigen

-

Jedes Segment generieren:

Segment 1 - Einführung:

Animiertes Diagramm, das [Konzept] zeigt. Beginne mit einfachen Formen, dann

steigt die Komplexität, da Elemente nacheinander hinzugefügt werden. Saubere,

minimale Ästhetik mit weißem Hintergrund. Verwende Pfeile und Labels, um

Schlüsselbeziehungen hervorzuheben. Sanfte, professionelle Animation.

Segment 2 - Prozesserklärung:

Schritt-für-Schritt-Visualisierung von [Prozess]. Jeder Schritt erscheint sequenziell

mit kurzer Pause zum Verständnis. Verwende konsistente Farbcodierung:

Blau für Inputs, Grün für Prozesse, Orange für Outputs.

Isometrische Perspektive für technische Klarheit.

[Fortfahren für jedes Segment...]- Zusammenbau:

- Segmente im Videoeditor kombinieren

- Voiceover oder Texterklärungen hinzufügen

- Übergänge zwischen Segmenten einfügen

Kostenoptimierungsstrategien

Das Preismodell von Seedance 2 (8 Punkte pro Sekunde auf Jimeng) bedeutet, dass ein 15-Sekunden-Video 120 Punkte kostet, oder ungefähr $12-15 je nach Plan. So maximieren Sie den Wert:

Strategie 1: Mit kürzeren Dauern testen

Generieren Sie 5-Sekunden-Testclips (40 Punkte), um zu verifizieren, dass Ihr Konzept funktioniert, bevor Sie sich zu vollen 15-Sekunden-Generierungen verpflichten. Sobald Sie den perfekten Prompt und Referenzen eingestellt haben, generieren Sie die Vollversion.

Strategie 2: Image-to-Video für Konsistenz nutzen

Image-to-Video-Generierungen haben höhere Erfolgsraten als reine Textgenerierungen, was verschwendete Generierungen reduziert. Die Vorabkosten für die Erstellung eines perfekten Referenzbildes zahlen sich durch weniger gescheiterte Versuche aus.

Strategie 3: Ähnliche Inhalte bündeln

Wenn Sie mehrere Videos mit ähnlichen Stilen erstellen (z.B. eine Produktlinien-Showcase), generieren Sie diese in einer Sitzung. Sie können Referenzvideos und Audiodateien wiederverwenden, und Ihre Prompts werden zu Vorlagen, die nur minimale Anpassungen erfordern.

Strategie 4: Strategischer Einsatz von Erweiterungen

Seedance 2 bietet Videoerweiterungsfunktionen, aber jede Erweiterung ist eine separate Generierung. Planen Sie Ihren Kerninhalt so, dass er in eine einzelne Generierung passt, wenn möglich, und nutzen Sie Erweiterungen nur, wenn die Erzählung wirklich eine längere Dauer erfordert.

Strategie 5: Die SeaDance AI Plattform nutzen

Für professionelle Kreative und Unternehmen, die regelmäßigen Zugriff auf mehrere KI-Modelle benötigen, kann die Nutzung einer einheitlichen Plattform wie SeaDance AI einen besseren Wert bieten als die Verwaltung mehrerer Abonnements. Die Plattform bietet:

- Zugriff auf Seedance 2 neben anderen Spitzenmodellen

- Flexible Preisstufen basierend auf Nutzung

- Optimierter Workflow ohne Plattformwechsel

- Professioneller Support und Dokumentation

Die Zukunft von KI-Video: Was kommt als Nächstes?

Seedance 2 repräsentiert einen Wendepunkt, aber die Technologie entwickelt sich rasant weiter. Basierend auf Branchentrends und aktuellen Entwicklungen ist Folgendes zu erwarten:

Kurzfristig (2026):

- Erweiterte Dauer-Fähigkeiten (30+ Sekunden)

- Verbesserte Charakterkonsistenz über noch längere Sequenzen

- Verbesserte Audiogenerierung mit natürlicheren Dialogen

- Bessere Integration in traditionelle Videobearbeitungs-Workflows

Mittelfristig (2027-2028):

- Echtzeit-Generierung für Live-Anwendungen

- Vollständige Szenenbearbeitungs-Fähigkeiten (spezifische Elemente in generierten Videos ändern)

- Multi-Charakter-Interaktion mit individueller Steuerung

- Fotorealistische Menschengenerierung mit angemessenen Einwilligungsrahmen

Langfristige Vision:

- Vollständige KI-gestützte Filmproduktions-Pipelines

- Personalisierte Inhaltsgenerierung im großen Maßstab

- Nahtlose hybride Workflows, die echtes Filmmaterial und KI-Generierung kombinieren

- Demokratisierung von High-End-Visuelleffekten

Fazit: Ihre nächsten Schritte

Seedance 2 ist nicht nur eine weitere inkrementelle Verbesserung in der KI-Videogenerierung – es ist ein fundamentaler Wandel, wie wir Videoerstellung angehen. Das multimodale Referenzsystem, die Kontrolle auf Regie-Ebene und die Ausgabequalität in Profi-Qualität machen es zum ersten KI-Videotool, das wirklich bereit für kommerzielle Produktion ist.

Ihr Aktionsplan:

- Zugang erhalten: Besuchen Sie https://seadanceai.com/seedance-2, um mit Seedance 2 zu kreieren und andere hochmoderne KI-Modelle auf einer bequemen Plattform zu erkunden

- Einfach anfangen: Beginnen Sie mit Image-to-Video-Generierungen unter Verwendung eines einzelnen Referenzbildes und klarer, prägnanter Prompts

- Grundlagen meistern: Üben Sie das @-Erwähnungssystem und experimentieren Sie mit verschiedenen Referenzkombinationen

- Beispiele studieren: Analysieren Sie erfolgreiche Videos anderer Kreativer, um zu verstehen, was funktioniert

- Unerbittlich iterieren: Generieren Sie mehrere Variationen, lernen Sie aus jedem Versuch und verfeinern Sie Ihren Ansatz

- Bibliothek aufbauen: Erstellen Sie eine Sammlung von Referenzvideos, Bildern und Audiodateien für verschiedene Stile und Anwendungsfälle

- Der Community beitreten: Tauschen Sie sich mit anderen Kreativen aus, teilen Sie Techniken und Entdeckungen

Der "ChatGPT-Moment" für Video ist da. Da KI-Videogenerierung zur Standardpraxis in allen Branchen wird, werden diejenigen, die diese Tools jetzt meistern, einen erheblichen Vorteil haben. Die Frage ist nicht, ob KI die Videoproduktion transformieren wird – sondern ob Sie diese Transformation anführen oder später aufholen werden.

Fangen Sie heute an zu kreieren und entdecken Sie, was möglich ist, wenn Sie menschliche Kreativität mit den beispiellosen Fähigkeiten der KI kombinieren.

Bereit, die Zukunft der Videoerstellung zu erleben? Besuchen Sie SeaDance AI, um auf Seedance 2 zuzugreifen und beginnen Sie, Ihre kreativen Visionen mit den fortschrittlichsten verfügbaren KI-Videogenerierungstools in die Realität umzusetzen.